全部新闻

尽管大型科技公司在人工智能领域投入巨资,但英伟达股价仍然下跌

彭博社报道称,尽管主要科技公司增加了人工智能基础设施支出,但英伟达的股价仍然停滞不前,自第四季度初以来下跌了 1% 以上,落后于标准普尔 500 指数。由于高资本支出,人们越来越担心投资回报,一些分析师表示潜在收入可能与宣布的资本支出不匹配。由于预计英伟达的收入增长将放缓,其估值可能会随着支出增长的放缓而下降。投资者等待 Nvidia 定于 2 月 25 日发布的收益报告,以获得对芯片需求趋势的进一步指导和见解。

我利用克劳德为一名家庭成员的医院账单讨价还价 163,000 美元

马特·罗森伯格 (Matt Rosenberg) 在人工智能助手克劳德 (Claude) 的帮助下,通过谈判将 195,000 美元的医院账单降至 32,500 美元。在他的妹夫心脏病发作后,罗森伯格收到了一份模棱两可、夸大的医院账单,之后,罗森伯格利用克劳德将这些费用与医疗保险价格进行比较来分析这些费用,揭露了不当的分拆和多收费。凭借这些信息,他成功协商获得了 163,000 美元的折扣,凸显了人工智能在医疗账单纠纷中为患者提供帮助的潜力。

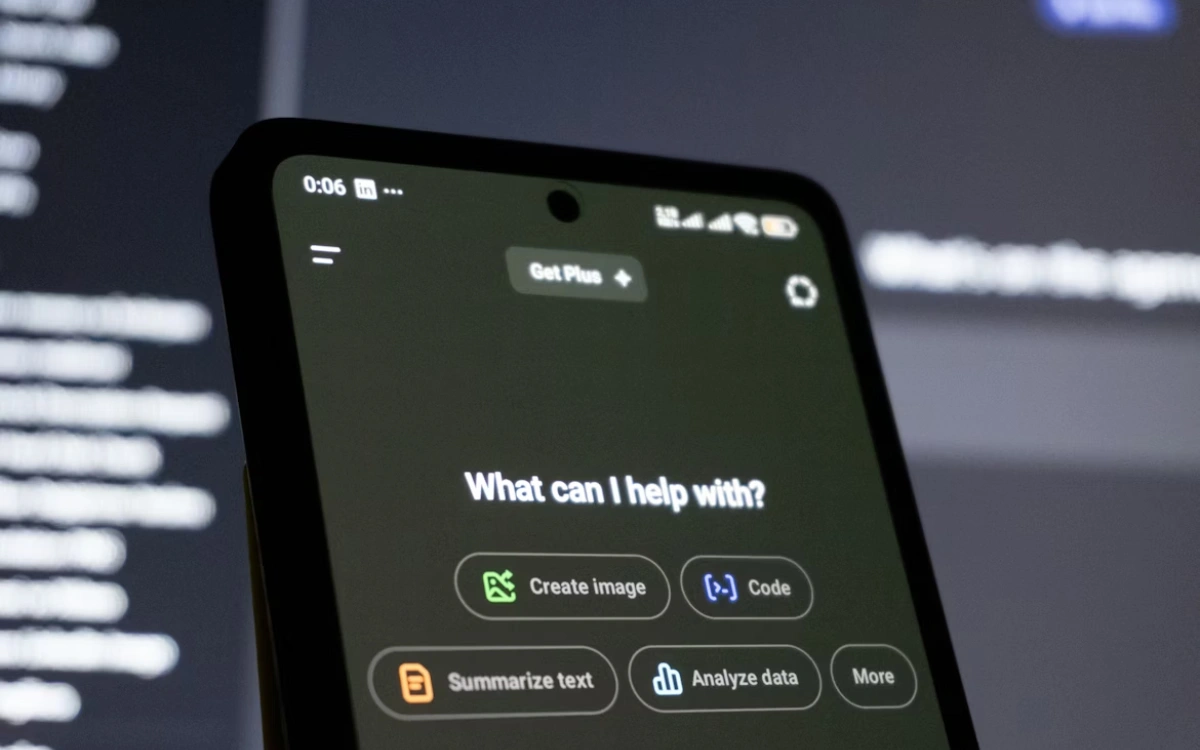

我要求 ChatGPT 透露我的“影子角色”——结果准确得令人不安

本文讨论了“AI Shadow Persona”的概念,这是当用户启用内存时由 ChatGPT 等 AI 工具创建的行为指纹。这个角色反映了用户的真实模式和习惯,没有社交过滤器,可以深入洞察他们的心理。作者提出了通过详细分析聊天记录来揭示这一影子角色的五个提示,包括识别个性特征、回避话题、确定主题的优先顺序、预测未来的焦点领域,以及基于与人工智能的交互生成残酷诚实的传记。这些练习可以利用人工智能的模式识别功能,帮助用户获得自我意识并改善个人成长,而无需人类的判断反馈。

农历新年前夕,中国百度将 OpenClaw AI 添加到面向 7 亿用户的搜索应用中

百度计划从周五开始将其主要智能手机应用程序与流行的人工智能工具OpenClaw集成,允许用户通过百度的搜索应用程序执行调度和编码等任务。百度拥有 7 亿月活跃用户,其目标是在中国农历新年假期之前扩展 OpenClaw 的电子商务和其他服务能力。此前,随着科技巨头争夺人工智能领域的用户参与度和货币化机会,阿里巴巴和腾讯也进行了类似的整合。

Anthropic 首席执行官表示我们正处于软件工程的“半人马阶段”

Anthropic 首席执行官达里奥·阿莫迪 (Dario Amodei) 将人工智能和人类工程师之间的协作比作半人马,表明这种伙伴关系提高了生产力,并可能暂时增加对软件工程师的需求。然而,他警告说,由于人工智能技术的进步,未来几年入门级白领工作将受到重大干扰。

汤姆·克鲁斯与布拉德·皮特战斗的人工智能视频受到顶级作家警告:“我们可能已经结束了”

由人工智能生成的汤姆·克鲁斯和布拉德·皮特打斗的逼真视频引发了好莱坞业界的担忧。爱尔兰电影制片人 Ruairi Robinson 使用字节跳动(TikTok 母公司)旗下的 Seedance 2.0 制作了这段 15 秒的剪辑,突显了人工智能技术的快速进步。美国电影协会 (MPA) 批评字节跳动侵犯版权,而美国演员工会 (SAG-AFTRA) 则谴责未经许可使用演员肖像。编剧瑞德·里斯 (Rhett Reese) 警告称,此类人工智能工具可能会彻底改变或摧毁好莱坞,并对失业和创意控制的变化表示担忧。

大多数人不知道 ChatGPT 中的“GPT”代表什么,但这实际上是理解 AI 的关键

自ChatGPT出现以来,生成式AI受到了广泛关注。用户使用它来执行各种任务,从家庭作业辅导到电子邮件起草,但许多人不知道 GPT 的含义。GPT 的缩写如下:“G”代表 Generative,表示系统创造新内容的能力;“P”表示预训练,指的是在根据人类反馈进行微调之前对大型文本数据集进行广泛的训练;“T”代表 Transformer,这是一种神经网络架构,使其能够理解句子结构并预测连贯的文本。ChatGPT 的迅速崛起引发了关于其对工作、教育以及人工智能未来在社会中的作用的影响的争论。

随着科技行业裁员,IBM 初级员工数量增加了两倍

IBM 今年在美国的入门级招聘人数增加了两倍,在人工智能采用率不断上升的情况下,该公司重新设计了初级职位,以专注于更高价值的任务。该公司首席人力资源官指出,传统的入门级工作越来越多地被人工智能取代,促使人们转向强调解决问题和与人工智能系统协作的角色。该战略旨在为年轻的科技求职者提供机会,同时适应自动化未来不断变化的工作性质。

“汤姆·克鲁斯”与“布拉德·皮特”打斗的人工智能视频疯传后,电影协会谴责 Seedance 2.0 的“大规模”侵权

美国电影协会谴责字节跳动的新型人工智能视频生成器 Seedance 2.0,称其自推出以来涉嫌造成广泛的版权侵权。字节跳动声称该模型显着提高了生成质量,但 MPA 呼吁立即停止侵权活动,理由是其无视美国既定的版权法。OpenAI 在 Sora 2 上也遇到了类似的问题,并实施了保护措施,而迪士尼则授权角色在 Sora 2 上使用。然而,目前尚不清楚字节跳动是否会遵循类似的路径,或者版权所有者是否会诉诸法律诉讼。鉴于人工智能的进步,一些创作者对好莱坞的未来表示悲观。

研究人员发现,主要的“氛围编码”平台 Orchids 很容易被黑客攻击

BBC 发现 Orchids 存在重大网络安全风险,Orchids 是一个流行的“氛围编码”人工智能平台,允许非技术用户通过文本提示构建应用程序和游戏。网络安全研究员 Etizaz Mohsin 演示了如何利用该平台的安全漏洞来获得对用户项目的未经授权的访问,并可能远程控制他们的设备。尽管多次尝试向 Orchids 发出有关该漏洞的警报,但该公司尚未做出回应。该事件凸显了为了方便而允许人工智能工具深度访问用户计算机所带来的风险,特别是在此类平台被谷歌、优步和亚马逊等大公司更广泛采用的情况下。