人工智能驱动的科学搜索引擎如何加速您的研究

作者:Pearson, Helen

当萨姆·罗德里克斯(Sam Rodriques)还是一名神经生物学研究生时,他对科学的根本局限性感到震惊。他说,即使研究人员已经产生了理解人类细胞或大脑所需的所有信息,“我不确定我们是否会知道”,“因为没有人有能力理解或理解它们”。阅读所有文献并获得全面的看法。 –

五年后,罗德里克斯表示,他更接近利用人工智能 (AI) 解决这个问题。9 月,他和他在美国初创公司 FutureHouse 的团队宣布,他们构建的基于人工智能的系统可以在几分钟内生成比维基百科页面更准确的科学知识综合1。团队迅速生成维基百科风格的条目大约 17,000 个人类基因,其中大部分此前缺乏详细页面。

人工智能驱动的科学搜索引擎如何加速您的研究

罗德里克斯并不是唯一一个求助于人工智能来帮助综合科学的人。几十年来,学者们一直在努力加快将研究成果汇编成评论的艰巨任务。在国王学院研究综合研究的伊恩·马歇尔 (Iain Marshall) 表示,“它们太长、太密集,而且在写成时往往已经过时”伦敦学院。人们对大型语言模型 (LLM) 以及作为 ChatGPT 等工具基础的生成式人工智能程序的兴趣激增,引发了人们对自动化任务的新兴趣。

一些较新的人工智能驱动的科学搜索引擎已经可以帮助人们通过查找、排序和总结出版物来制作叙述性文献评论——书面研究之旅。但他们还无法自己撰写高质量的评论。其中最严峻的挑战是“黄金标准”系统审查,它涉及严格的论文搜索和评估程序,通常还需要进行荟萃分析来综合结果。大多数研究人员都认为,这些距离完全自动化还有很长的路要走。“我确信我们最终会实现这一目标,”澳大利亚黄金海岸邦德大学的证据和系统评价专家 Paul Glasziou 说道。“我只是无法告诉你那是 10 年后还是 100 年后。”

但与此同时,研究人员担心人工智能工具可能会导致更多草率、不准确或误导性的评论,从而污染文献。“令人担忧的是,几十年来关于如何进行良好证据综合的研究开始受到破坏,”伦敦大学学院研究证据综合的詹姆斯·托马斯 (James Thomas) 说。

几十年来,计算机软件一直在帮助研究人员搜索和解析研究文献。早在法学硕士出现之前,科学家们就开始使用机器学习和其他算法来帮助识别特定的研究或快速从论文中提取研究结果。但 ChatGPT 等系统的出现引发了人们对通过将法学硕士与其他软件相结合来加速这一过程的狂热兴趣。

人工智能科学搜索引擎的数量呈爆炸式增长——它们有什么用吗?

研究人员表示,要求 ChatGPT 或任何其他人工智能聊天机器人从头开始撰写学术文献综述是非常天真的。这些法学硕士通过大量写作训练来生成文本,但大多数商业人工智能公司不会透露模型训练的数据。马歇尔说,如果被要求审查某个主题的研究,像 ChatGPT 这样的法学硕士很可能会利用可信的学术研究、不准确的博客以及谁知道还有哪些其他信息。“我们不会权衡什么是最相关、最优质的文学作品,”他说。而且,由于法学硕士的工作方式是重复生成统计上合理的单词来回答查询,因此他们对同一问题会产生不同的答案,并“产生幻觉”错误,其中包括臭名昭著的不存在的学术参考文献。“研究综合中被视为良好实践的过程都没有发生,”马歇尔说。

一个更复杂的过程包括将预先选定的论文集上传到法学硕士,并要求其从中提取见解,仅根据这些研究得出答案。这一代“检索增强的一代”似乎减少了幻觉,尽管它并不能阻止幻觉。还可以设置该流程,以便法学硕士能够参考其获取信息的来源。

这是专业化的基础,人工智能驱动的科学搜索引擎例如共识和引出。大多数公司不会透露其系统如何工作的确切细节。但他们通常会将用户的问题转化为跨学术数据库(例如 Semantic Scholar 和 PubMed)的计算机搜索,从而返回最相关的结果。

然后,法学硕士总结了每一项研究,并将它们综合成一个引用其来源的答案;用户可以选择多种选项来过滤他们想要包含的作品。“它们首先是搜索引擎,”新加坡管理大学数据服务和人工智能工具博客负责人 Aaron Tay 说道。“至少,他们引用的内容绝对是真实的。”

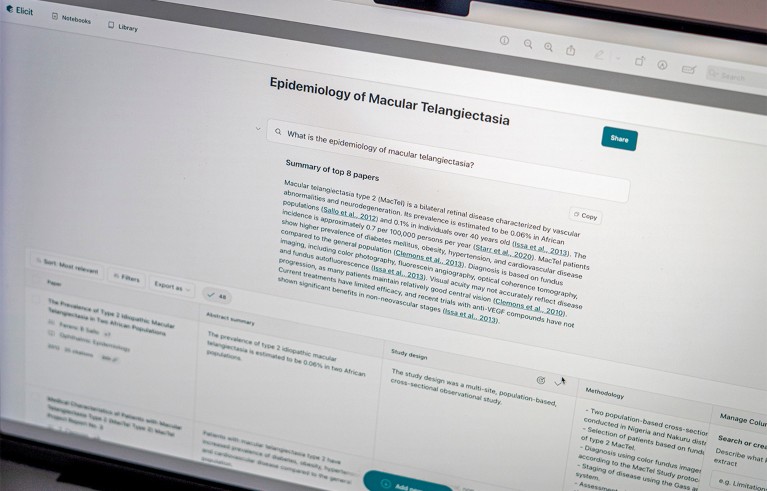

欧登塞南丹麦大学博士后研究员 Mushtaq Bilal 表示,这些工具“肯定可以提高你的审阅和写作过程的效率”,他对人工智能工具的学者进行培训,并设计了自己的工具,称为研究踢。另一个人工智能系统称为赛特例如,可以快速生成支持或反驳某个主张的论文的详细分类。Elicit 和其他系统还可以从论文的不同部分提取见解——方法、结论等。比拉尔说,“有大量劳动力可以外包”。

与一些人工智能驱动的工具一样,Elicit 旨在通过总结论文和提取数据来帮助进行学术文献综述。信用:自然

但比拉尔说,大多数人工智能科学搜索引擎无法自主生成准确的文献综述。他们的成果更像是“本科生通宵达旦地想出几篇论文的要点的水平”。他说,研究人员最好使用这些工具来优化部分审查过程。Elicit 的工程主管詹姆斯·布雷迪 (James Brady) 表示,其用户正在增加审核步骤,“效果非常好”。

包括 Elicit 在内的一些工具的另一个限制是它们只能搜索开放获取论文和摘要,而不是文章全文。(加利福尼亚州奥克兰的 Elicit 搜索了约 1.25 亿篇论文;马萨诸塞州波士顿的 Consensus 搜索了超过 2 亿篇论文。)Bilal 指出,大部分研究文献都是付费的,搜索大量论文需要大量计算。全文。“运行一个人工智能应用程序来浏览数百万篇文章的全文将花费大量时间,而且成本将变得令人望而却步,”他说。

对于罗德里克斯来说,资金供应充足,因为位于加利福尼亚州旧金山的非营利组织 FutureHouse 得到了谷歌前首席执行官埃里克·施密特和其他资助者的支持。FutureHouse 成立于 2023 年,旨在利用人工智能实现研究任务自动化。

人工智能可以帮助你写下一篇论文吗?

今年 9 月,Rodriques 和他的团队公布了 FutureHouse 的开源原型人工智能系统 PaperQA21。当收到查询时,PaperQA2 会在多个学术数据库中搜索相关论文,并尝试访问开放获取和付费内容的全文。(罗德里克斯说,该团队可以通过其成员的学术关系获得许多付费论文。)然后,系统会识别并总结最相关的元素。他说,部分原因是 PaperQA2 会消化论文的全文,因此运行它的成本很高。

FutureHouse 团队测试了该系统,使用它生成有关人类个体基因的维基百科风格的文章。然后,他们向由博士和博士后生物学家组成的盲人小组提供了这些文章中的数百条人工智能撰写的陈述,以及来自真实(人类撰写的)维基百科关于同一主题的文章的陈述。该小组发现,人工撰写的文章所包含的“推理错误”(其中书面主张没有得到引文的适当支持)是人工智能工具撰写的文章的两倍。由于该工具在这方面优于人类,因此该团队将其论文命名为“语言代理实现了科学知识的超人综合”。

美国初创公司 FutureHouse 的团队推出了人工智能系统来总结科学文献。他们的董事兼联合创始人萨姆·罗德里克斯 (Sam Rodriques) 坐在椅子上,右三。图片来源:FutureHouse

Tay 说 PaperQA2 和另一个名为暗中与传统搜索引擎相比,它们需要更长的时间(几分钟而不是几秒)才能返回结果,因为它们进行更复杂的搜索,例如使用初始搜索的结果来追踪其他引文和关键短语。“这一切加在一起,计算成本非常高,而且速度很慢,但搜索质量却要高得多,”他说。

对文献进行叙述性总结已经很难了,但系统性的评论就更难了。人们可能需要几个月甚至几年的时间才能完成2。

根据 Glasziou 团队的详细分析,系统审查至少涉及 25 个仔细的步骤。梳理文献后,研究人员必须过滤长列表以找到最相关的论文,然后提取数据,筛选研究是否存在潜在偏差并综合结果。(其中许多步骤是由另一位研究人员重复完成的,以检查是否存在不一致。)这种费力的方法(被认为是严格的、透明的和可重复的)在医学上被认为是有价值的,例如,因为临床医生使用结果指导有关治疗患者的重要决策。

类似 ChatGPT 的人工智能即将出现在主要科学搜索引擎中

2019 年,在 ChatGPT 出现之前,Glasziou 和他的同事们着手创造一项科学世界纪录:两周内完成系统评价。他和其他人,包括马歇尔和托马斯,已经开发了计算机工具来减少所涉及的时间。当时可用的软件菜单包括 RobotSearch,这是一种经过训练的机器学习模型,可以从一组研究中快速识别随机试验。机器人审稿人例如,另一个人工智能系统,有助于评估一项研究是否存在偏见风险,因为它没有充分盲法。“所有这些都是缩短系统评价时间的重要小工具,”Glasziou 说。

2019年1月21日星期一上午9点30分开始计时。经过9个工作日,团队于2月1日星期五午餐时间顺利过线。3。“我很兴奋,”英国牛津大学流行病学家安娜·梅·斯科特 (Anna Mae Scott) 说道,她在邦德大学领导了这项研究;大家都用蛋糕庆祝。从那时起,该团队已将记录减少到五天。

这个过程可以变得更快吗?其他研究人员也一直在努力实现系统评价的自动化。2015 年,Glasziou 创立了系统评价自动化国际合作组织,这是一个利基社区,该社区恰如其分地制作了几篇关于自动化系统评价工具的系统评价4。但即便如此,“没有多少[工具]被广泛接受”,马歇尔说。“这只是技术成熟程度的问题。”

Elicit 是一家公司,该公司表示,其工具可以帮助研究人员进行系统评论,而不仅仅是叙述性评论。布雷迪表示,该公司不会通过按按钮提供系统审查,但其系统确实会自动执行一些步骤,包括筛选论文以及提取数据和见解。布雷迪说,大多数使用它进行系统评价的研究人员都上传了他们使用其他搜索技术找到的相关论文。

系统审查爱好者担心人工智能工具可能无法满足研究的两个基本标准:透明度和可重复性。“如果我看不到所使用的方法,那么它就不是系统综述,而只是一篇综述文章,”贾斯汀·克拉克 (Justin Clark) 说道,他是 Glasziou 团队的一员,负责构建自动化评审工具。Brady 表示,审稿人上传到 Elicit 的论文是他们起始文献的优秀、透明的记录。至于再现性:“我们不保证重复相同步骤时我们的结果总是相同,但我们的目标是在合理范围内做到这一点,”他说,并补充道随着公司改进其系统,透明度和可重复性将变得很重要。

审查专家表示他们希望看到更多已发表的准确性和再现性评估旨在帮助生成文献评论的人工智能系统。“构建很酷的工具并尝试新东西真的很有趣,”克拉克说。“进行核心评估性研究是一项艰巨的工作。”

立即审核人工智能搜索工具,以免它们扭曲研究

今年早些时候,克拉克领导了对使用生成人工智能工具来帮助系统审查的研究进行了系统审查。他和他的团队发现,只有 15 项已发表的研究将人工智能的表现与人类的表现进行了充分的比较。尚未发表或同行评审的结果表明,这些人工智能系统可以从上传的研究中提取一些数据并评估临床试验的偏倚风险。“它在阅读和评估论文方面似乎做得不错,”克拉克说,“但它在所有其他任务上表现得很糟糕,包括设计和进行彻底的文献检索。(现有的计算机软件已经可以完成使用荟萃分析合成数据的最后一步。)

Glasziou 和他的团队仍在尝试通过改进的工具来缩短审阅记录的时间,这些工具可以在他们称之为证据审查加速器。——这不会是一件大事。格拉齐奥预测,每年你都会变得越来越快。例如,在 2022 年,该小组发布了一种名为“方法向导”的计算机化工具,该工具向用户询问一系列有关其方法的问题,然后在不使用人工智能的情况下为他们编写协议。

自动化信息合成也伴随着风险。研究人员多年来就知道许多系统评价是多余的或质量很差5,而人工智能可能会让这些问题变得更糟。作者可能有意或无意地使用人工智能工具来快速完成不遵循严格程序或包含低质量工作的评审,并得到误导性的结果。

Glasziou 表示,相比之下,人工智能还可以鼓励研究人员快速检查以前发表的文献,而他们以前不会这样做。“人工智能可能会提高他们的水平,”他说。Brady 表示,未来,人工智能工具可以通过寻找 P-hacking(一种数据操纵形式)等明显迹象来帮助标记和过滤掉质量较差的论文。

Glasziou 将这种情况视为两种力量的平衡:人工智能工具可以帮助科学家做出高质量的评论,但也可能助长不合格评论的快速产生。“我不知道这会对出版的文献产生什么净影响,”他说。

有些人认为,综合和理解世界知识的能力不应仅仅掌握在不透明的营利性公司手中。克拉克希望看到非营利组织构建并仔细测试人工智能工具。他和其他研究人员对上个月两位英国资助者宣布他们正在在证据合成系统上投资超过 7000 万美元。“我们只是想谨慎小心,”克拉克说。“我们希望确保[技术]为我们提供的答案是正确的。”