您可能没有听说过 Ben Goertzel 博士,他是人工超级智能 (ASI) 联盟的首席执行官,也是世界上第一个去中心化人工智能平台 SingularityNET 的创始人,但他的使命是加速我们在实现历史上的一个点被普遍称为奇点,当人工智能变得如此聪明以至于超越人类智能并进入自我完善循环的递归序列时,导致无限强大的出现超级智能。

AGI(通用人工智能)一词是由包括 Goertzel、Shane Legg 和 Peter Voss 在内的一群人在为 Goertzel 正在编辑的一本书(Legg 和 Voss 撰写了章节)考虑书名时发明的,用来描述超级智能。这本书于 2005 年出版,书名是通用人工智能,然后 Goertzel 在 2006 年推出了 AGI 会议系列。(他后来发现物理学家 Mark Gubrud 在 1997 年的一篇文章中使用了这个术语,所以虽然是 Goertzel 向世界推出了这个术语并被采用,但它之前网上也出现过。)

萨姆·奥特曼开放人工智能,流行AI的创造者聊天机器人 聊天GPT,预测人类将创造超级智能(AGI)“几千天”,而戈策尔同样雄心勃勃。

——我个人认为,我们将在三到五年内达到人类水平的 AGI,这与 Ray Kurzweil(2005 年书籍的作者)大致相同奇点临近),他把这个时间定在 2029 年,”戈策尔在西雅图的家中通过视频电话告诉我。“我并不是说在一两年内不可能取得突破,只是这不是我个人的感觉。是的,但是事情进展得很快,对吧?”

“我不能说导致糟糕结果的可能性为零”

确实如此。一旦达到人类水平的通用人工智能,事情就会进展得相当快,无论是好的还是坏的。我们都看过类似的电影终结者。如果 AGI 决定不需要人类在身边和妨碍它,并且想要摆脱我们怎么办?

Goertzel 继续说道:“Ray Kurzweil 认为我们将在 2029 年达到与人类相当的 AGI,然后在 2045 年达到超人类的 AGI,他将奇点等同于奇点,这意味着技术进步如此之快,以至于看起来是无限的。”相对于人类,就像你的手机每秒都有一个新的诺贝尔奖级别的发现。

“我不能说导致坏事的可能性为零。我不明白为什么超级人工智能会奴役人类或将它们用作电池,甚至仇恨我们并试图屠杀我们我们;但我的意思是,如果我要建造一座房子,我会砍掉一群蚂蚁和它们的蚁丘,我会放一堆松鼠离开了他们的家;我可以看到人工智能对我们表现出同样的冷漠态度,就像我们大多数时候对非人类动物和植物一样。”

在你过于担心之前,戈策尔在谈到 AGI 的影响时确实看到了一些乐观的空间:“另一方面,我不明白为什么这种情况绝对有可能发生,因为我们正在构建这些系统,我们构建它们的目标是让它们帮助我们并最喜欢我们,所以似乎没有理由为什么它们一旦变得比我们聪明一倍他们会突然转身,不再试图帮助我们,而是想要毁灭我们。

“即使我们担心危险,我们能做的最好的事情就是直接让 AGI 变得富有同情心、乐于助人,对吧?这就是我一直在 SingularityNET 所做的事情。”

Ben Goertzel 博士的使命是加速人类水平的通用人工智能 (AGI) 和超级智能的出现,造福全人类。

Goertzel 有两个耦合在一起的大型 AGI 项目。一是OpenCog Hyperone,这是一种根据合理的认知架构构建 AGI 的尝试,它是一个知道自己是谁、我们是谁的具体代理,并试图以整体方式实现世界目标。

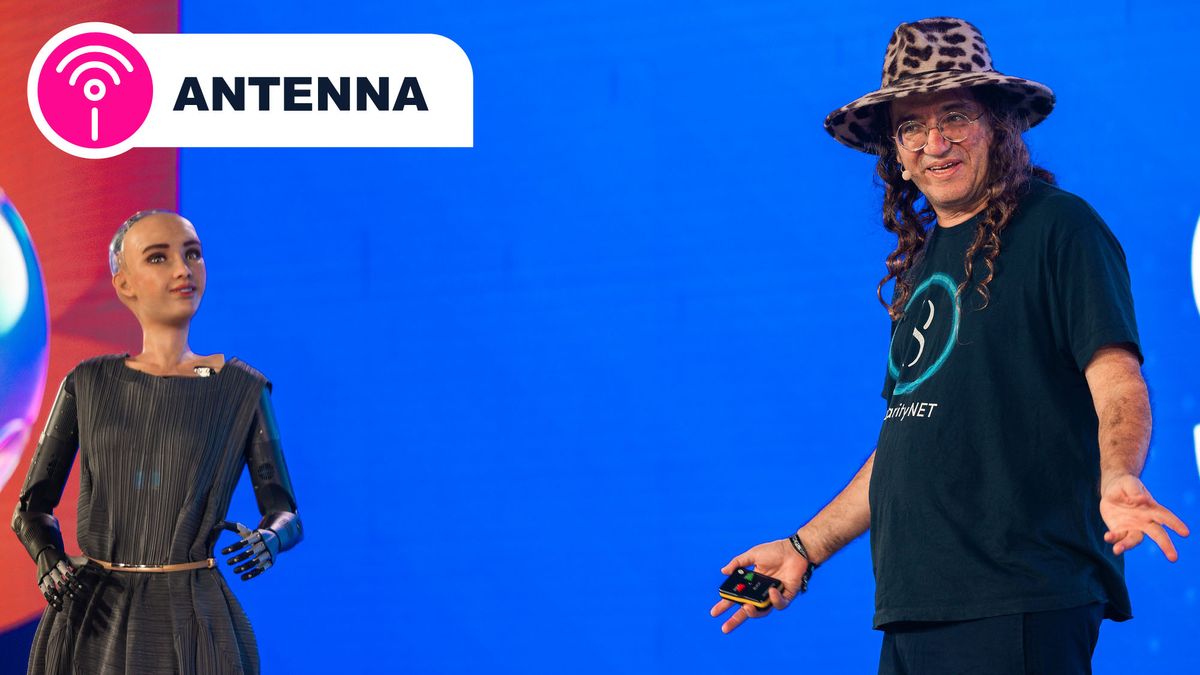

本文中戈策尔的一些照片显示他与两个机器人共享舞台汉森机器人公司– 索菲亚和苔丝狄蒙娜。索菲亚是一个可以模仿社交行为的“社交机器人”,有着光头;而苔丝狄蒙娜,也被称为“德西”,是一支乐队的主唱,其中键盘手还有戈策尔。德西戴着猫耳朵,有三条腿。这些照片来自 TOKEN2049,这是 2024 年在新加坡举行的加密货币会议,但这些人工智能机器人的历史可以追溯到更早的时候,代表了人工智能和机器人技术的一些早期进步,在我们今天的大型语言模型 (LLM) 出现之前。事实上,Goertzel 仍然认为它们的发展具有价值,因为它们的创建初衷与今天的聊天机器人有所不同。

– 虽然聊天GPT(和其他聊天机器人)已经进步了很多,它们并不是具体的代理,”他说。“当你与 ChatGPT 交谈时,它不知道它是谁,也不知道你是谁,或者试图创建一个与你结下不解之缘。它完全客观化了交互。这些机器人背后的人工智能的目标是从不同的角度出发的。它从与交互的人建立一种丰富的情感或社会关系开始,这似乎仍然是一件重要的事情,尽管人工智能的其他一些方面到目前为止已经通过大型语言学习模型等取得了进展。。

“别担心,一切都不受控制”

“像深度神经网络这样的大型语言模型可以成为 AGI 的一部分,但我认为你还需要其他部分,所以我们有逻辑推理系统,我们有通过进化学习(如遗传算法)来发挥创造力的系统。这是一个相当不同的系统比世界上的 ChatGPT 更先进的 AGI 方法。 –

戈策尔的信号网络,是一个旨在运行分散在世界各地许多不同计算机上的人工智能系统的平台,因此它们没有中央所有者或控制器,就像区块链模型一样。这要么对于使通用人工智能符合道德非常重要,要么非常危险和可怕,具体取决于你的观点。

戈策尔属于前者阵营。——我童年时代的导师拉姆·达斯(Ram Dass)有一句美丽的格言,“别担心,一切都无法控制”,所以要么你认为这很好,而且它必须如此,要么你认为“会发生什么?”我们需要一个无所畏惧的领导者来指挥一切!”显然,我属于那些认为当我们在通用人工智能领域取得突破时人工智能被某一方控制的人中,那是很糟糕的,因为该方有一些狭隘的利益集团,这些利益集团会以一种非常特殊的方式引导通用人工智能的思想。这不利于全人类。我更愿意看到 AGI 以互联网或 Linux 的形式发展操作系统– 某种程度上是为每个人而不是为任何人,这就是 SingularityNET 和 ASI 联盟平台等平台所允许的。 –

戈策尔言出必行。SingularityNET 提供的不仅仅是100万美元的补助金面向有益 AGI 的开发者,但他们需要在 2024 年 12 月 1 日之前申请。

“衰老和死亡的终结不会是坏事”

我对一切的未来感到有点担忧。Goertzel 能做些什么来让我确信 AGI 对人类有一些好处吗?他能给我一些可能发生的好事的例子吗?

——好吧,衰老和死亡的终结不会是坏事,”他建议道。“如果你能治愈所有疾病并结束非自愿死亡,让每个人从 20 岁开始重新长出身体,并保持尽可能长的时间如他们所愿……我的意思是,这意味着摆脱癌症、痴呆症和精神疾病。这将是一个显着的优势。或者,假设无人机在每个人的后院空投一个小盒子,只需口头指令即可 3D 打印出您想要的任何形式的物质,例如分子纳米组装机……将非常有利。”

我此时意识到他正在谈论来自星际迷航。

“你可能需要在上面加一些护栏”,他几乎是漫不经心地补充道。– 如果你关注环境和全球变暖等问题,就会发现利用太阳能、地热能和水发电的更有效方法。毫无疑问,AGI 能够比我们更快地解决这些问题。我的意思是,好处是相当显着的。”

嗯,这是一种表达方式。此时我的脑子里充满了各种可能性。

——即使抛开脑机接口等更疯狂的东西,我的意思是,你也可以升级你自己的大脑,”Goertzel 继续说道。“你可以将你的思维与 AGI 融合到你认为合适的任何水平。如果你做得太多,你可能会迷失自己,有些人可能不介意,但如果你做得一点点,你可以说,在半小时内学会演奏一种乐器,而不是 10 年,对吗?¤

“只是把它们放在太空中,让东西冷却下来”

对于任何读过大量科幻小说的人来说,通用人工智能可能带来的好处似乎都是显而易见的。但我想知道我们是否有足够的资源来使这一切在地球上发生,因为即使是我们当前的人工智能聊天机器人也需要消耗大量资源才能执行相对简单的工作。

我可能应该预料到戈策尔的回答:“好吧,我们不知道如何在地球上开采很多东西,但 AGI 会,”

确实如此,但是人工智能冷却所需的水量又是多少呢?

——只要把它们放在太空中,让物体冷却下来,”他说。“将 AGI 放在太空卫星上,利用太阳能以及从月球和小行星上开采的资源。一旦你拥有比人类聪明数倍的东西,它就不必受到实践中约束我们的约束。我们不明白的事情太多了,即使是比我们聪明两倍的系统也能理解。我们不知道限制是什么。”

在与戈策尔的谈话结束时,我试图想象哪些限制可能适用于超出人类水平的思维。我所能想到的只是威廉·布莱克(William Blake)在描述自然界最可怕的掠食者老虎的面孔时所说的话:“什么样的不朽的手或眼睛,可以塑造你可怕的对称性?”

我仍然不确定 AGI 是否会成为一种善或恶的力量,或者这些只是适用于低等凡人的概念,而不适用于即将到来的超级智能神;但现在我们仍然可以在一定程度上控制 AGI 的发展方向,并且令人欣慰的是,世界上有像 Ben Goertzel 这样的人,正在推动未来新世界的道德和富有同情心的 AGI。