我们真的可以选择退出在线人工智能吗?

作者:Malavika Madgula

2024 年 9 月的最后一周,数百万 Instagram 用户向他们的账户发布了某些文本。这个想法?避免在线人工智能 (AI) 的瘟疫……

该消息称,“再见 Meta AI”,指的是这家社交媒体巨头的母公司,然后继续遵循用户不允许 Meta 或任何其他人使用其任何照片、个人资料信息或个人数据,与任何发布和共享这些数据的人一起。然而,在急于打击所谓的人工智能侵犯的过程中,他们似乎都忘记了这样一个事实:仅仅分享模因或消息不会改变他们对 Meta 或任何其他技术平台的合法权利。

以 OpenAI 为例,它声称不可能创建聊天GPT不使用受版权保护的作品。另一方面,Snapchat 声称使用某些人工智能功能可能会导致你的脸出现在广告中。就连 LinkedIn 也不甘落后,利用用户简历完善其人工智能模型。有什么办法可以在线选择退出这些人工智能模型吗?

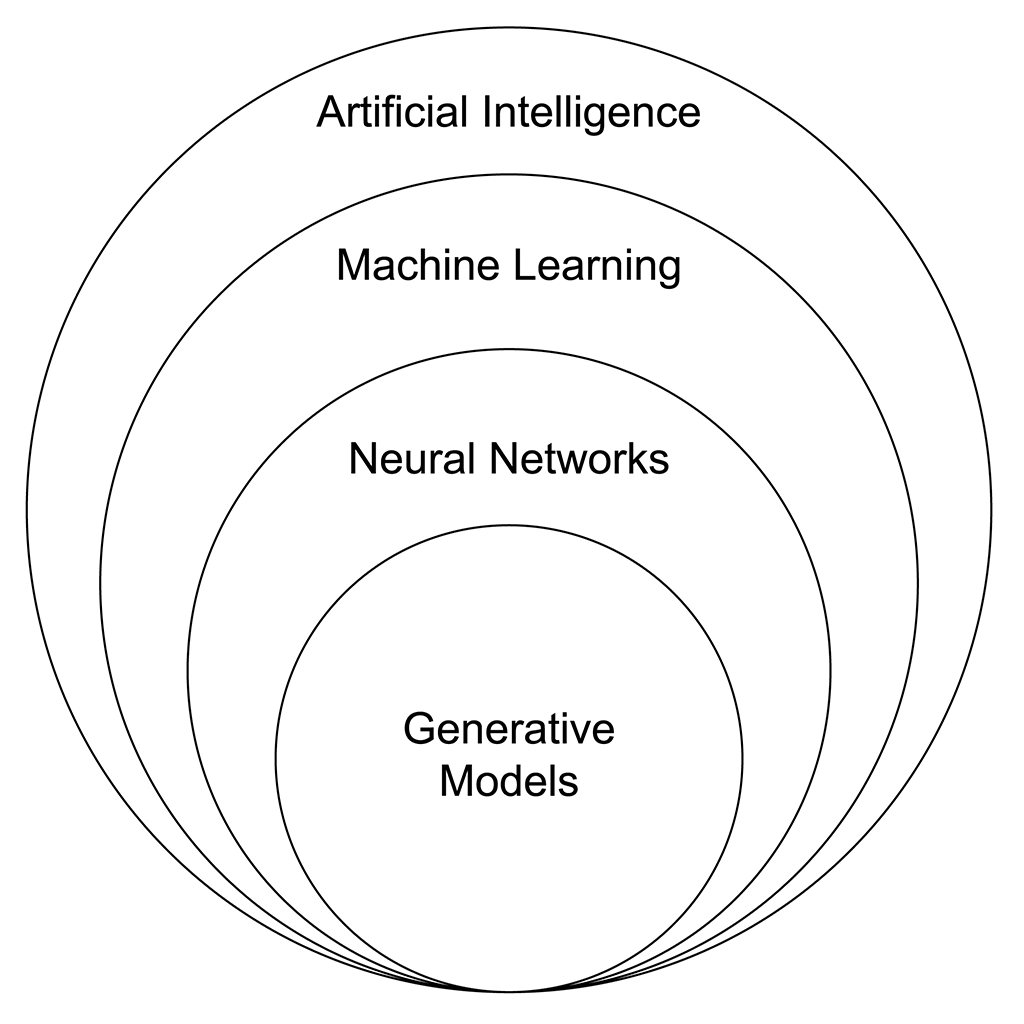

人工智能训练模型消耗数据的速度比人类生成数据的速度还要快。他们使用各种方法在网络上抓取信息并学习如何回答问题。例如,组织使用社交媒体查找语言数据,帮助大型语言模型 (LLM) 了解最新趋势以及人们如何交谈。ChatGPT 等人工智能聊天机器人从网络中提取信息,并用它来制定问题的答案。

公司甚至使用人工智能来捕获人们的社交媒体帖子以进行有针对性的广告,从他们的点赞和帖子中了解更多关于他们的信息。这些模型依赖于来自社交媒体的非结构化数据,包括视频、图像和文本,使用计算机视觉和自然语言处理等技术来分类和理解数据。我们的想法是接触用户,更多地了解他们,并使用人工智能找出对他们有吸引力的东西,即使问题是人工智能与道德遗迹。

然而,社交媒体是混乱的,跨越多种环境、语言等。因此,人工智能无法准确地学习任何东西,导致它很容易误解它所看到的东西。

选择退出人工智能培训

选择退出人工智能培训实际上可能吗?嗯,最多有部分可能。首先,不同平台之间的选择退出设置差异很大。此外,并非所有平台都提供这些选择退出选项,有关各个平台如何使用隐藏在服务和隐私政策中的数据的更多详细信息。

以 Discord 为例,它自首次亮相以来就犯了很多错误,其中一些功能甚至被称为“监视”用户。它甚至在 2024 年初的群聊中发生了大量数据泄露。其最新的端到端加密功能 DAVE 协议可以对您的个人交互和信息提供一定程度的控制。

在其“隐私与安全”设置下,您将找到“我们如何使用您的数据”,您可以在其中选择“使用数据定制我的 Discord 体验”和“使用数据改进不和谐——关闭。LinkedIn 更大胆,概述了它如何使用个人数据进行生成人工智能。在“LinkedIn 如何使用您的数据”选项卡的“数据隐私”部分下,您可以关闭“用于生成 AI 改进的数据”选项。然而,如果人工智能模型过去使用过你的数据,它不会改变,只会为未来做出改变。

Meta 直言不讳地声称,它可能会使用公开的 Instagram 和 Facebook 帖子、音频、个人资料照片和评论来训练人工智能系统,包括自己的人工智能聊天机器人元人工智能。虽然将您的帐户设置为私有是一种选择,但它并不排除您可能在任何公共群组上共享的任何内容。此外,所有 Meta 应用程序的选择退出设置都不同,包括 WhatsApp、Facebook 和 Instagram。Reddit 有点棘手,因为它是一个公共平台,因此用户无法选择不分享公共帖子。更重要的是,Reddit 的隐私政策规定,用户同意他们的共享内容可用于训练 AI 模型,并与 Google 的 Vertex AI 达成了协议。

Snapchat 的印度用户数量最多,它不仅具有“我的自拍照”功能,还具有人工智能聊天机器人,允许用户从自拍照中获取人工智能生成的图像。Snapchat 术语明确指出这些图像可用于开发和训练机器学习(ML) 模型和广告中也是如此。您可以在“我的帐户”选项卡中的“我的自拍照”功能下关闭“在广告中查看我的自拍照”。此外,您还可以转到“隐私控制”下的“清除数据”,并选择“清除我的 AI 数据”。

然而,自埃隆·马斯克掌舵以来,X(前身为 Twitter)的用户流失量最大。X 的更新服务条款于 2024 年 11 月 15 日生效,规定 X 将使用用户发布的任何数据来训练 AI 模型及其自己的 AI 机器人 Grok。虽然一些用户可能仍然能够看到选择退出选项,但这可能在法律上没有任何意义,Grok 仍然能够从您的帖子、点赞甚至私人消息中获取信息。

如果您觉得这可能意味着言论不再自由,那么它可能就是这样。虽然几乎每个网站都有退出选项,但这并不意味着它不会收集您的数据。随着侵入式数据收集的实践达到其自然且不可避免的结论,这里唯一的举措是不要玩游戏并接受不幸的后果,即不参与新技术可能是限制数据范围的唯一方法 - 因为互联网上的一切都不会被遗忘。