应用生成人工智能影响气候变化决策

作者:Worden, David

气候变化决策是复杂的,并且受到具有不同议程的参与者试图施加的影响。生成人工智能(GenAI)技术正在成为影响公共话语和决策的新工具,并将越来越多地应用于气候变化问题。我们定义了 GenAI 气候决策影响的类型,提供了示例案例,并强调了该领域的紧迫研究需求。

生成人工智能 (GenAI) 是一套新兴算法,可以生成新内容,通常是文本、图像、音频或视频。GenAI 的内容与人类创作的内容没有什么区别,甚至超过了许多人创作的艺术或写作的质量。GenAI 技术经济高效且易于使用,几乎任何人都可以创建大量材料。GenAI技术将影响公共话语和政治,并影响全球范围内人类决策的未来1,2,3。GenAI 技术很可能已经被气候变化讨论的不同方面的参与者所使用,但我们对其影响个人、组织或国家决策的潜力知之甚少4。

气候变化决策非常复杂,涉及世界各地数十亿参与者以及从个人选择到社区进程再到国际外交的社会复杂程度5,6。必须就气候变化减缓和适应战略以及这些目标之间的有限资源分配做出决定7,8。气候变化决策历来受到参与者之间的影响和操纵,关于人类引起的气候变化本身的科学共识的争议性就是例证。9,10。纵观这段历史,科学、媒体和政治领域的参与者对普遍的科学共识表示怀疑,即人类引起的气候变化有证据支持,并对社会构成严重风险9,10,11。最近,包括社交媒体在内的在线平台利用错误信息和宣传继续挑战这一共识4,12。

GenAI 可应用于影响气候决策各个层面和各个方面的决策。从高层来看,GenAI 涉嫌试图影响国家领导层。例如,旨在抹黑斯洛伐克相对支持环保的进步党领导人的逼真“深度伪造”视频在 2023 年大选期间广泛传播13,个性化的 GenAI 聊天机器人鼓励个人对英国君主进行暗杀企图14。在气候变化决策的更局部范围内,使用 GenAI 可以促进和扩大现有的错误信息活动。例如,有关美国东海岸海上风能的讨论主要是社交媒体上传播的错误信息,称该行业导致了鲸鱼死亡15。通过 GenAI 创建情感图像,或者由 GenAI 机器人自动发布和评论,可能会加剧此类错误信息的传播并使其更具说服力16。

在个人决策规模上,GenAI 语音克隆可用于个性化说服性电话3。2024 年,英国野生动物信托基金会主席的语音克隆被骗子成功用于谈判广告合同17 号。虽然我们没有发现有影响力人士的声音克隆用于说服人们关注环境问题的报道示例,但所需的模型在公共领域广泛存在。例如,我们于 2024 年 11 月 8 日搜索了 Civitai(GenAI 模型的开源存储库),发现有影响力的环境广播员大卫·阿滕伯勒爵士的语音模型已被下载超过 1000 次18。

GenAI 驱动的骚扰有可能影响个别有影响力的领导人做出的决策,可能会加剧许多环保活动家和研究人员面临的持续网络欺凌19。虽然我们没有发现 GenAI 材料被用于有针对性地骚扰气候活动人士的例子,但开源 GenAI 社区内的参与者已经开发出了所需的技术。对开源 Civita 存储库的进一步搜索发现了五个单独的模型,它们经过专门训练来生成著名活动家 Greta Thunberg 的图像,这些模型的下载次数总计超过 8700 次18。虽然无法评估这些特定模型的当前使用情况或相关人员的动机,但 Civita 模型的公众使用很大一部分是滥用的20。

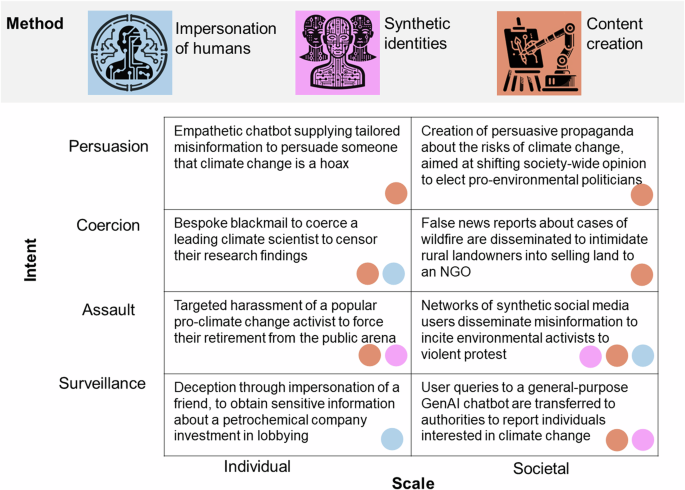

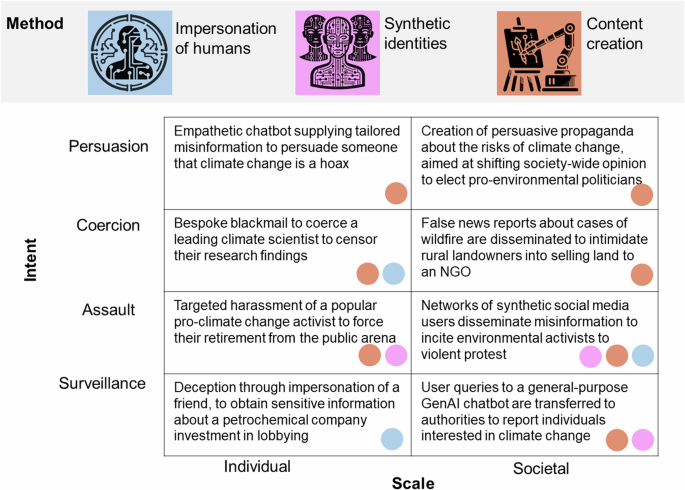

GenAI 可以作为一种工具,通过三种直接机制影响气候变化决策,针对不同的意图,并跨越社会复杂性的尺度(图 1)。1)。基于 GenAI 恶意应用的现有类型3,我们定义了三种可用于影响气候变化决策的近端 GenAI 方法(图 1)。1)。首先,GenAI 工具可以模仿存在的人类个体,例如通过创建类似于个体写作或说话风格的文本或音频。二、GenAI可以创造综合身份那些不存在但足够现实足以说服人类决策者的人3。例如,在线调查的 GenAI 受访者可以在成功伪装成人类的同时执行许多任务21。最后,GenAI 可用于创建内容例如图像或视频,可用于交流想法4,22。

GenAI 影响决策的三种近端机制可以应用于不同的意图和跨尺度(图 1)。1)。目前 GenAI 在气候变化决策中的许多应用都是为了说服人们;例如,通过促进定制化的信息或错误信息的创建和传递给个人,或者创建用于宣传的有说服力的材料4,5,22。GenAI 能够快速、经济高效地创建数千个高质量图像和视频,这使得传播比过去更多的信息或虚假信息的可能性更大,从而影响更多的受众4,22。GenAI 工具使大多数人能够创建逼真的图像,并且可用于创建技术上困难且有说服力的图像,包括隐藏在照片中的潜意识信息(图 1)。2a),以及真实人物在虚假情况下的真实感再现(图 1)。2b)。此外,通过 GenAI 进行的算法个性化可以为个人创建高度针对性的内容,这些内容经过定制后更有可能影响他们23。

1)。GenAI 能够创建处于妥协情况下的个人的深度伪造照片级真实再现,或冒充他们的朋友和家人来获取敏感信息,这为勒索提供了新的机会24。在社会层面,传播有关社会动乱或暴力的虚假报道可能会恐吓社区以特定方式接受决定或投票2,24。

GenAI 将用于通过对个人或组织的直接攻击来影响复杂的决策过程(图 1)。1)。GenAI 的使用日益激进,包括非身体攻击和煽动人们实施身体暴力25。使用自主 GenAI 代理可以扩大对决策过程中关键个人的有针对性的骚扰,特别是与可能造成声誉损害的错误信息相结合时3,25。GenAI 特工可以接触到的大量人群,以及它们似乎向人类强调和说服人类的能力,增加了煽动大量人口群体的暴力或政治叛乱的可能性25。

除了直接应用 GenAI 来影响决策外,还有一些用途可以间接影响决策(图 1)。1)。在对气候认知和竞争对手活动的监视和间谍活动中,GenAI 工具可用于欺骗个人并获取信息26。例如,音频 GenAI 可能会冒充朋友或家人的声音,在电话交谈期间欺诈性地获取信息,或者 GenAI 可能会被用来编写大量个性化、令人信服且富有同理心的网络钓鱼电子邮件,以解锁网络安全。组织的防御26,27。

伦理复杂性

先前的研究强调了 GenAI 在社会中的邪恶潜力2,3,并且在气候变化决策领域内,特别关注大规模传播气候错误信息的风险4,22。然而,GenAI 可以用来以不同的视角和目标影响气候变化决策,从支持环境到彻底否认的视角,从各方温和到激进的行为者28。GenAI 的这些潜在应用跨越了道德梯度,从提供客观信息到支持决策的规范良性目标5、勒索和骚扰等非法和不道德案件24,25,29。

GenAI 在确定某项活动是否符合道德方面的作用因用途而异。在勒索等情况下,在大多数司法管辖区,行为本身被认为是不道德且非法的。因此,利用GenAI进行勒索从道德角度来看可能是无关紧要的,但该技术可能允许更多的案例被尝试并成功实现3。相反,制作针对个人的广告材料是司空见惯的,并且为社会所容忍。在这种情况下,GenAI 的同理心本质、无限的耐心以及以越来越人性化的方式说服人们的能力,都属于伦理问题30。定义 GenAI 在气候决策中的应用的法律和道德界限至关重要,以保护全球气候变化决策的民主和完整性。这些界限可能因文化和法律管辖范围的不同而有所不同,在制定此类框架时,我们必须认识到在政策和治理中代表性不足的群体的道德问题。考虑原住民的道德问题至关重要,他们在制定气候变化解决方案方面具有不成比例的影响力,他们拥有影响他们对 GenAI 看法的截然不同的道德框架,但在制定 GenAI 监管方面代表性不足5,31。

研究需求

关于 GenAI 的邪恶和犯罪应用的许多紧急研究需求已得到充分记录2,3,22,25,26,包括对理解具体意图的技术和立法方法的研究24,27,29。例如,已经开发出检测合成媒体的算法,并将这些算法纳入内容验证系统,这可能会降低深度伪造内容的风险32。我们没有重复这些一般性讨论,而是强调了两个专门针对 GenAI 应用影响气候决策的紧迫研究领域。首先,我们对气候辩论的现状和 GenAI 的决策影响缺乏基本的了解。目前还没有系统地尝试量化使用 GenAI 影响气候变化决策的关键参与者,以及正在创建的材料或采取的行动的数量。此外,GenAI 对实际气候变化决策影响的成功率几乎没有量化。由于许多活动本质上是秘密的,量化影响决策的活动具有挑战性,但 GenAI 内容的数字签名是存在的并且可以量化2,25。在某些情况下,还可以通过向商业 GenAI 提供商付款或对训练和运行模型所需的高级计算机硬件进行投资的形式追踪 GenAI 使用的财务签名25,27。

其次,我们需要更好地了解 GenAI 影响不同类型气候变化决策的潜力。特别是,我们需要量化上述各种风险的潜在影响和可能性。气候变化是一个代际问题,现在做出的决定具有深远的影响5。这也是需要全球数十亿人协调一致、持续努力的问题5。因此,在系统层面,了解基于 GenAI 的信息、辩论和决策影响力的增加可能会产生怎样的长期影响非常重要。例如,大量错误信息和积极说服可能会导致双方的意见更加两极分化和行动激进化4。或者,更多地提供客观气候信息可能会导致建立共识,平衡不同利益相关者的需求5。预测 GenAI 对气候决策的影响将需要综合方法,使我们能够分析这些系统级结果,例如使用网络分析、严肃博弈和基于代理的模型6。

结论

在这里,我们概述了 GenAI 在从个人到全球范围内影响气候变化决策过程的潜力。我们根据当前的技术状况概述了此类影响的示例类型,并讨论了所涉及的深层道德和法律复杂性。我们想重申,这里提到的任何方法、意图或社会规模都不是假设的,也不是只有在遥远的未来才有可能实现的。以当前的技术水平,这里的每个例子都是可能的,并且每个例子目前都被用于犯罪、政治或工业领域25。每个例子都可以立即部署,以低成本和很少的技术专业知识来影响气候变化决策。面对这种颠覆性技术,我们既需要对具体用例进行技术研究,又需要整体思维来分析更广泛的影响和潜在的长期影响。

数据可用性

当前研究期间没有生成或分析数据集。

参考

Bai, H.、Voelkel, J.、Eichstaedt, J. 和 Willer, R.人工智能可以在政治问题上说服人类。https://doi.org/10.31219/osf.io/stakv(2023)。

布伦戴奇,M.等人。人工智能的恶意使用:预测、预防和缓解。(2018)。

Ferrara, E. GenAI 反人类:生成人工智能和大型语言模型的邪恶应用。计算机社会科学学报 https://doi.org/10.1007/s42001-024-00250-1(2024)。

加拉兹,V.等人。错误信息气候下的气候错误信息。(2023)。

Richards, D.、Worden, D.、Song, X. P. 和 Lavorel, S. 利用生成人工智能来支持基于自然的解决方案。人与自然 https://doi.org/10.1002/pan3.10622(2024)。

Filatova, T.、Verburg, P. H.、Parker, D. C. 和 Stannard, C. A. 基于空间代理的社会生态系统模型:挑战和前景。环境。模型。软件。 45,1-7 (2013)。

Archie, K. M.、Chapman, R. 和 Flood, S. 新西兰社区的气候变化应对:地方规模适应和缓解规划。环境。开发。 28,19-31 (2018)。

哈维,C.A.等人。气候智能型景观:在热带农业中整合适应和减缓的机遇和挑战。保守莱特。 7,77–90 (2014)。

Pearce, W.、Brown, B.、Nerlich, B. 和 Koteyko, N. 沟通气候变化:渠道、内容和共识。电线爬升。改变 6,613–626 (2015)。

奥雷斯克斯 (Oreskes),N. 和康威 (Conway),E.怀疑的商人:少数科学家如何掩盖从烟草烟雾到全球变暖等问题的真相。(布卢姆斯伯里出版社,美国,2011 年)。

Boykoff, M. T. & Boykoff, J. M. 气候变化和新闻规范:美国大众媒体报道的案例研究。地理论坛 38,1190-1204 (2007)。

我。Treen, K. M.、Williams, H. T. P. 和 OâNeill, S. J. 有关气候变化的在线错误信息。电线气候变化 11,(2020)。

Zuidijk, D. 斯洛伐克的 Deepfakes 预览人工智能将如何改变选举的面貌。彭博社 https://www.bloomberg.com/news/newsletters/2023-10-04/deepfakes-in-slovakia-preview-how-ai-will-change-the-face-of-elections(2023)。

法庭称,M. AI 聊天机器人韦弗“鼓励”计划杀死女王的男子。卫报 https://www.theguardian.com/uk-news/2023/jul/06/ai-chatbot-encouraging-man-who-planned-to-kill-queen-court-told(2023)。

Berger, I. 关于最近鲸鱼死亡的错误信息主导了 Facebook 上关于海上风能的讨论。媒体事务 https://www.mediamatters.org/facebook/misinformation-about-recent-whale-deaths-domulated-discussions-offshore-wind-energy(2023)。

Fredheim, R. 和 Pamment, J. 评估人工智能增强社交媒体影响力操作带来的风险和机遇。地方品牌和公共外交 https://doi.org/10.1057/s41254-023-00322-5(2024)。

继 BBC 主持人盖克索勒 (Gecsoyler) 的肖像被人工智能生成的声音欺骗后,出现在广告中。卫报 https://www.theguardian.com/technology/2024/apr/28/bbc-presenters-likeness-used-in-advert-after-firm-tricked-by-ai- generated-voice(2024)。

Civitai Inc. Civitai:开源生成人工智能之家。https://civitai.com/(2024)。

Lloro-Bidart, T. 对网络欺凌的生态女权主义解释:对环境和社会正义学者-教育家-活动家的影响。J.环境。教育。 49,276–285 (2018)。

Wei, Y.、Zhu, Y.、Hui, P. 和 Tyson, G. 探索滥用生成人工智能模型在 Civitai 上的使用。在第32届ACM国际多媒体会议论文集6949–6958(ACM,美国纽约州纽约市,2024 年)。https://doi.org/10.1145/3664647.3681052。Christoforou, E.、Demartini, G. 和 Otterbacher, J. 用于网络和社交媒体研究的众包生成人工智能:对三个平台工作者的调查。

过程。国际。AAAI 会议网络社会。媒体 18,2097 年至 2103 年 (2024 年)。

van der Ven, H.、Corry, D.、Elnur, R.、Provost, V. J. 和 Syukron, M. 生成式人工智能和社交媒体可能会加剧气候危机。全球。环境。政治。 24,9-18 (2024)。

Asadi, M.、Jamali, M. A. J.、Heidari, A. 和 Navimipour, N. J. 僵尸网络揭晓:关于不断变化的威胁和防御策略的综合调查。新兴电信技术交易 35,https://doi.org/10.1002/ett.5056(2024)。

Romero Moreno, F. 生成人工智能和深度伪造:处理有害内容的人权方法。国际法律、计算机与技术评论1 月 30 日 (2024 年)https://doi.org/10.1080/13600869.2024.2324540。马夏尔,N.等人。

生成式人工智能滥用:现实世界数据的策略和见解分类。(2024)。

Schmitt, M. 和 Flechais, I. 数字欺骗:社会工程和网络钓鱼中的生成人工智能 (2023)。

Eze, C. S. 和 Shamir, L. 基于人工智能的网络钓鱼电子邮件攻击的分析和预防。电子。(巴塞尔) 13,1839(2024)。

谷歌学术一个

Spadaro, P. A. 气候变化、环境恐怖主义、生态恐怖主义和新出现的威胁。J. 战略安全 13,58–80 (2020)。

Kirhengast, T. Deepfakes 和图像处理:刑事定罪和控制。信息。交流。技术。法律 29,308–323 (2020)。

马茨,S.C.等人。生成式人工智能在大规模个性化说服方面的潜力。科学。代表。 14,4692(2024)。

泰乌鲁,K.怀唐伊/特蒂里蒂条约和毛利道德准则:人工智能、算法、数据和物联网。(2020)。

Heidari, A.、Jafari Navimipour, N.、Dag, H. 和 Unal, M. 使用深度学习方法进行 Deepfake 检测:系统全面的综述。WIRE 数据挖掘和知识发现 14,(2024)。

致谢

这项工作得到了新西兰商业、创新和就业部科学与创新小组为皇家研究所提供的战略科学投资资金的支持。我们感谢审稿人富有洞察力的评论。

道德声明

利益竞争

作者声明没有竞争利益。

附加信息

出版商备注施普林格·自然对于已出版的地图和机构隶属关系中的管辖权主张保持中立。

权利和权限

开放获取本文根据知识共享署名 4.0 国际许可证获得许可,该许可证允许以任何媒介或格式使用、共享、改编、分发和复制,只要您对原作者和来源给予适当的认可,并提供链接到知识共享许可证,并指出是否进行了更改。本文中的图像或其他第三方材料包含在文章的知识共享许可中,除非材料的出处中另有说明。如果文章的知识共享许可中未包含材料,并且您的预期用途不受法律法规允许或超出了允许的用途,则您需要直接获得版权所有者的许可。要查看该许可证的副本,请访问http://creativecommons.org/licenses/by/4.0/。转载和许可

引用这篇文章

Richards, D.、Worden, D. 应用生成人工智能影响气候变化决策。

npj 气候。行动 3,117(2024)。https://doi.org/10.1038/s44168-024-00202-5

已收到:

公认:

已发表:

DOI:https://doi.org/10.1038/s44168-024-00202-5