人工智能已经在改变我们抗击癌症的方式

作者:Mack DeGeurin

美国有 61 万人死于癌症去年。这几乎与该国的死亡人数相同四年内战。到 2024 年,至少将有 200 万人被诊断出患有某种癌症,这一数字近年来还在不断攀升。早期检测仍然是决定一个人是否最终能从癌症中存活下来的最大因素之一,幸运的是,医学治疗的进步可以提供帮助。研究人员和医学科学家相信人工智能模型可以在早期检测过程中发挥关键作用。尽管人工智能仍然无法取代医生的现实医学专业知识,甚至无法产生真正的医疗诊断,但它可以作为提高诊断效率的关键工具。

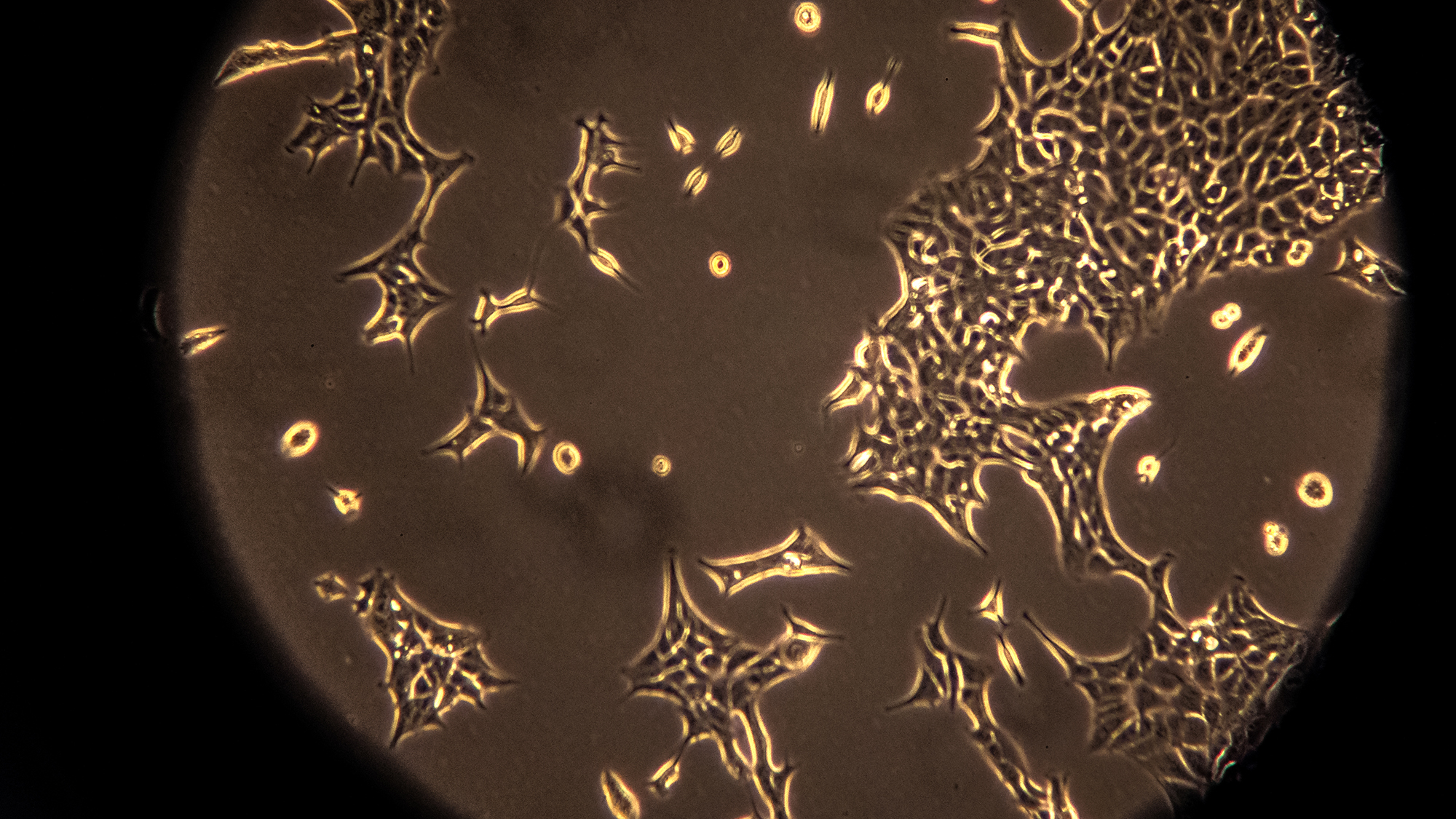

人工智能能够解析大量数据并寻找模式,这可能使其非常适合寻找器官和组织图像中的不规则之处,并在癌细胞转移之前发现它们。一项研究今天发布在日记中自然哥伦比亚大学的研究人员描述了一种新的医学人工智能模型,他们说该模型可以在细胞水平上准确预测基因的活动。理论上,这种粒度水平可以为研究人员了解导致癌症发生的基因突变开辟新途径。

“拥有准确预测细胞活动的能力将改变我们对基本生物过程的理解,”该论文的资深作者、哥伦比亚大学教授劳尔·拉巴丹(Raul Rabadan)在一份声明中表示。“它将把生物学从一门描述看似随机过程的科学转变为一门可以预测控制细胞行为的基础系统的科学。”

如今,医生已经在使用人工智能来帮助发现肿瘤并加快诊断。科学家和制药公司同样在不同程度上使用该技术来协助创建新的抗癌疗法。虽然人工智能几乎肯定不会很快取代训练有素的肿瘤学家,但所有迹象都表明,在不久的将来,从最早的时刻到晚期治疗,这些模型在抗击癌症方面将发挥越来越重要的作用。

人工智能让研究人员了解癌症如何在细胞水平上开始

哥伦比亚大学的研究人员开发了能够预测基因活动的人工智能,称为 GET(通用表达转换器),他们表示他们在 130 万个人类细胞的图像上训练了他们的模型。研究人员将这种注入患病基因和健康基因的大量训练数据的过程与打开 AI 的 ChatGPT大型语言模型吸收了大量书面互联网语料库。拉巴丹指出,一旦医学人工智能模型学会了“许多不同细胞状态下的语法”,它就可以根据这些信息预测模式。研究人员在测试人工智能时表示,它能够预测以前从未见过的细胞类型中的某些基因表达。

“这些方法可以有效地进行大规模计算实验,促进和指导传统的实验方法,”拉巴丹补充道。

哈佛医学院的科学家们在这篇论文发表几个月后还描述了另一种与癌症相关的人工智能检测工具自然。在该示例中,研究人员在观察医学患者图像后训练他们的模型来检测 19 种不同类型肿瘤的迹象。据报道,该模型能够检测癌症并预测肿瘤的分子特征,所有这些都基于其训练数据中包含的细胞特征。它还可以预测患者在不同癌症类型中的生存潜力。该模型称为 CHIEF (临床组织病理学影像评估基金会)接受了来自肺、前列腺、结肠和其他器官组织的 60,000 张完整幻灯片图像的训练。研究人员表示,CHIEF 比其他癌症检测人工智能模型更进一步,因为其广泛的训练数据使其比其他更专业的模型更全面地解释医学图像。

“如果进一步验证并广泛部署,我们的方法以及与我们类似的方法可以早期识别出可能受益于针对某些分子变异的实验性治疗的癌症患者,这种能力在世界各地并不普遍存在,”哈佛医学院教授兼研究资深作者 Kun-Hssing Yu在一份声明中说。

人工智能正在应用于癌症研究的各个阶段

人工智能对癌症治疗的前景大致分为五类:预测、检测、药物发现和治疗实施。在检测方面,放射科医生和其他医生正在已经在使用人工智能工具来帮助发现肿瘤。就在本周,一新研究发表于自然医学 一项涉及德国近 50 万名患者的研究发现,使用 AI 检测模型的医生确认的乳腺癌病例比自行采取行动的医生还要多。具体来说,使用人工智能的医生的癌症检出率比未使用人工智能的医生高 17.6%。FDA也已经人工智能软件的批准营销旨在帮助识别前列腺癌的迹象。

美国国立卫生研究院 (NIH) 的研究人员创建了一个单独的人工智能模型,称为洛里斯(基于逻辑回归的免疫治疗反应评分)证明了预测哪组癌症患者可能从某些免疫治疗中获益最佳的能力。这种方法利用人体的免疫系统来瞄准癌细胞,比化疗和放疗等更传统的抗癌治疗方法侵入性更小,但只对一小部分人有效。像 LORIS 这样的模型可以帮助医生更好地发现那些可能受益的患者的治疗方法,同时避免让其他人接受不必要的治疗。

在发现方面,芝加哥大学医学综合癌症中心 (UCCCC) 的研究人员最近从联邦政府收到了 1600 万美元作为一个项目的一部分,该项目使用强大的机器学习模型来梳理大型医学数据集,并寻找可能激发耐药癌症新疗法开发的模式。参与这项工作的人员表示,希望人工智能的进步能够加快寻找新药所需的时间,希望能及时为不久的将来可能需要它们的患者提供帮助。

–癌症患者没有时间等待新的治疗方法,因此迫切需要压缩药物发现时间表,我们的目标是通过利用[能源部]的新型协同方法来实现这一目标s] 超级计算能力,– UCCCC 主任 Kunle Odunsi在一份声明中说。一个

与此同时,过快地过度相信人工智能筛查和检测工具也存在风险。前面提到的几个模型仍处于研究阶段,在大规模部署到医疗机构之前需要进行更多测试。还存在机会主义者利用过于宽泛的术语“人工智能”来宣传未经测试的模型比实际更有效的风险。已经有大量案例人的接收错误与流行的大型语言模型交互后可能会出现危险的错误诊断。一项研究发表于《美国医学会杂志》儿科去年发现 OpenAI 的 ChatGPT83% 的儿科案例研究被错误诊断它被提出了。像这样的模型偶尔也容易出现产生虚假事实的幻觉并以自信的语气这样做。当要求它提供蛋糕食谱时,这可能会导致有趣的结果,但当有人使用它们进行自我治疗时,这些同样的不准确可能会被证明是危险的。

[有关的:我们能相信人工智能的健康建议吗?]

即使人工智能模型(可能)在未来几年提高检测不同癌症的能力,但从根本上来说,它们仍然无法完成与训练有素的医生相同的工作。正如纽约大学新闻学教授 Meredith Broussard她在《2023》中的笔记书不仅仅是一个小故障,即使是最先进的人工智能模型,本质上也是将静态图像与人类已经标记的其他图像的语料库进行比较,并快速查看两者是否存在数学相似性。这可能会带来令人印象深刻的结果,但这个过程最终是一个预言这与诊断不同。诊断仍然需要人类医生来检查证据并根据多年的现实经验得出自己的专家结论。

我们已经生活在一个医生可以使用这些工具来增强自己能力的世界。不过,目前尚不清楚人工智能是否足够可靠,足以将医生完全排除在这种动态之外。

通过 PopSci 的礼品指南赢得假期

为任何人购物?PopSci 团队的节日礼物推荐意味着您永远不需要在最后一刻购买另一张礼品卡。