今年,每个行业的企业都将推出AI服务。对于微软,甲骨文,困惑,快照和其他数百家公司,NVIDIA AI推理平台包括世界一流硅,系统和软件的完整堆栈是提供高通量和低延迟推断,并在降低成本的同时实现出色的用户体验的关键。

NVIDIA在推理软件优化方面的进步和Nvidia Hopper平台正在帮助行业提供最新的生成AI模型,在优化总拥有成本的同时提供出色的用户体验。霍珀平台还有助于实现多15倍 能源效率与前几代相比,用于推理工作负载。

AI推断是众所周知,因为它需要许多步骤来在吞吐量和用户体验之间取得正确的平衡。

但是,基本目标很简单:以较低的成本生成更多的令牌。代币表示大型语言模型(LLM)系统且通常每年产生的百万个代币的AI推理服务,这一目标提供了最明显的AI投资和每项任务所使用的能源的回报。

全栈软件优化为改善AI推理性能并实现这一目标提供了关键。

具有成本效益的用户吞吐量

企业通常会在平衡推理工作负载的绩效和成本方面受到挑战。尽管某些客户或用例可能与开箱即用的模型一起使用,但其他客户可能需要自定义。NVIDIA Technologies简化了模型部署,同时优化了AI推理工作负载的成本和性能。此外,客户可以通过选择部署的模型来体验灵活性和可定制性。

NVIDIA NIM微服务,NVIDIA TRITON推理服务器和Nvidia Tensorrt库是NVIDIA提供的推理解决方案之一,可满足用户的需求:NVIDIA NIM

- 推理微服务被预先包装和性能优化,以快速在任何基础架构,数据中心,边缘或工作站上快速部署AI基础模型。nvidia triton推理服务器,

- 公司最受欢迎的开源项目,允许用户打包并提供任何模型,而不管受过训练的AI框架如何。nvidia tensorrt

- 是一个高性能的深度学习推论库,其中包括运行时和模型优化,以提供对生产应用程序的低延迟和高通量推断。在所有主要的云市场中可用,

NVIDIA AI Enterprise软件平台包括所有这些解决方案,并提供企业级支持,稳定性,可管理性和安全性。借助框架 - 不合稳定的NVIDIA AI推理平台,公司可以利用生产力,开发和基础架构和设置成本。

使用NVIDIA Technologies还可以通过帮助公司避免停机时间和欺诈性交易,提高电子商务购物率转换率并产生新的AI驱动收入来源来提高业务收入。

基于云的LLM推理

为了简化LLM部署,NVIDIA已与每个主要的云服务提供商密切合作,以确保可以将NVIDIA推理平台无缝地部署在云中,而无需代码最少或不需要代码。Nvidia Nim与云原生服务集成在一起,例如:

- 亚马逊萨格人AI,亚马逊基岩市场,亚马逊弹性Kubernetes服务

- Google Cloud的顶点AI,Google Kubernetes引擎

- Microsoft Azure AI铸造厂即将推出,Azure Kubernetes服务

- Oracle Cloud基础架构的数据科学工具,Oracle云基础架构Kubernetes引擎

另外,对于定制的推理部署,NVIDIA TRITON推理服务器已深入集成到所有主要的云服务提供商中。

例如,使用OCI数据科学平台,部署NVIDIA TRITON就像在模型部署期间打开命令行参数中的开关一样简单,该命令线参数立即启动了NVIDIA TRITON推理端点。

同样,与Azure机器学习,用户可以通过Azure Machine Learning Studio部署NVIDIA TRITON,或者通过Azure Machine Learning CLI部署无代码部署。AWS从SageMaker Marketplace和Google Cloud在Google Kubernetes Engine(GKE)上提供一单击部署选项。Google Cloud在Google Kubernetes引擎上提供一单击部署选项,而AWS在其AWS深度学习容器上提供Nvidia Triton。

NVIDIA AI推断平台还使用流行的通信方法来提供AI预测,自动调整以适应基于云的基础架构中用户的不断增长和不断变化的需求。

从加速LLM到增强创意工作流程和改变协议管理,NVIDIA的AI推理平台正在推动各个行业的现实影响。了解协作和创新如何使下面的组织能够实现新的效率和可扩展性水平。

每月提供4亿次搜索查询,并具有困惑AI

AI驱动的搜索引擎的困惑AI处理超过4.35亿个每月查询。每个查询代表多个AI推理请求。为了满足这一需求,困惑AI团队转向NVIDIA H100 GPU,TRITON推理服务器和Tensorrt-llm。

支持20多种AI模型,包括Llama 3变体,例如8B和70B,使人们的困惑过程包括搜索,摘要和提问等各种任务。通过使用Nvidia Triton管理的较小分类器模型将任务路由到GPU POD,该公司在严格的服务水平协议下提供了成本效益,响应式服务。

通过模型并行性,将LLMS跨GPU拆分,Plelxity在保持低潜伏期和高精度的同时,成本降低了三倍。这个最佳实践框架展示了它如何满足不断增长的AI需求,优化总拥有成本并通过NVIDIA加速计算。

用复发的起草者(Redrafter)减少响应时间

开源研究进步有助于使AI推论民主化。最近,Nvidia融合了Redrafter,投机解码的开源方法由苹果出版,进入nvidia tensorrt-llm。

Redrafter使用较小的草稿模块并联预测令牌,然后由主要模型验证。该技术大大减少了LLM的响应时间,尤其是在流量低时期。

与Docusign转换协议管理

数字协议管理领导者DocuSign转向NVIDIA增压其智能协议管理平台。全球有超过150万客户,DocuSign需要在提供AI驱动的见解的同时优化吞吐量和管理基础设施费用。

Nvidia Triton为所有框架提供了一个统一的推理平台,通过将协议数据转换为可行的见解,从而加速了上市的时间并提高了生产力。DocuSign的NVIDIA推理平台的采用强调了可扩展AI基础架构对客户体验和运营效率的积极影响。

DocuSign的高级产品经理Alex Zakhvatov说,Nvidia Triton使我们的生活更加轻松。我们不再需要为我们的AI模型部署定制的定制,特定于框架的推理服务器。我们利用Triton作为所有AI框架的统一推理服务器,还使用它来确定正确的生产方案,以优化节省成本和绩效的工程工作。

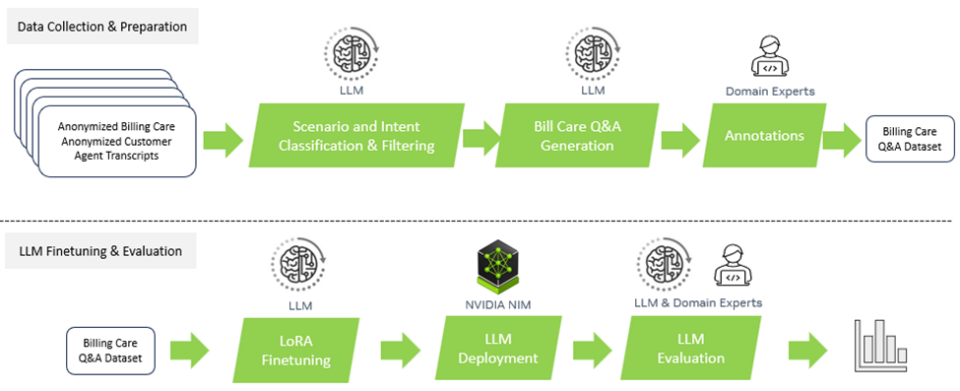

通过AMDOCS增强电信公司的客户服务

Amdocs是通信和媒体提供商的软件和服务的领先提供商,建立了Amaiz,一种针对电信公司的特定领域的生成AI平台,作为开放,安全,成本效益和LLM-Agnostic框架。AMDOCS使用了NVIDIA DGX Cloud和Nvidia AI企业软件为了提供基于市售LLMS和域适应模型的解决方案,使服务提供商能够构建和部署企业级生成AI应用程序。

使用NVIDIA NIM,AMDOCS将用于部署用例的代币数量减少了60%的数据预处理和40%的推断,可提供相同水平的准确性,每个代币的成本明显较低,具体取决于所用的各种因素和量。该协作还将查询延迟降低了约80%,以确保最终用户几乎实时响应。这种加速可增强在商务,客户服务,运营以及其他方面的用户体验。

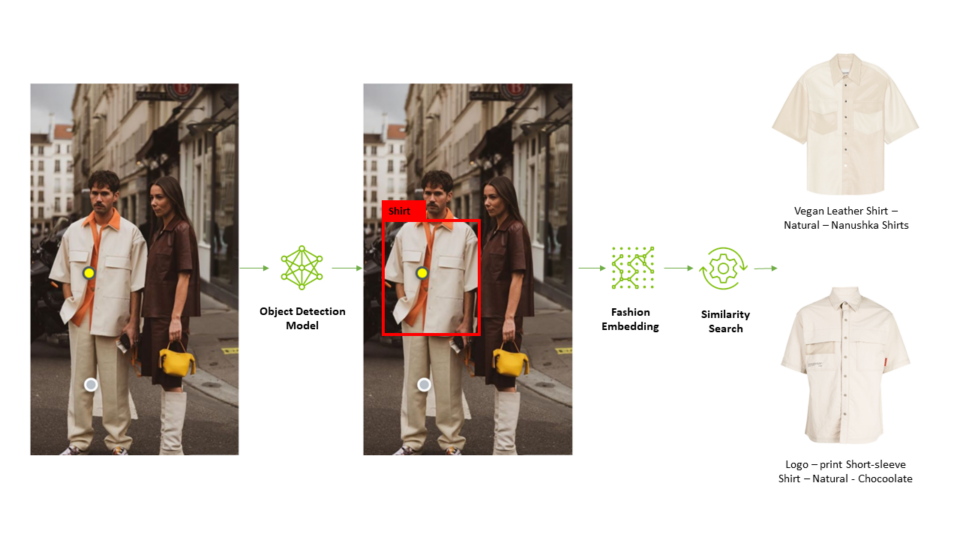

用AI在快照上革新零售

由于Snap的屏幕快照功能,购买完美的服装从未如此简单。该AI驱动的工具集成到Snapchat中,可帮助用户找到照片中看到的时尚项目。NVIDIA TRITON在启用屏幕截图的管道中发挥了关键作用,它使用多个框架来处理图像,包括Tensorflow和Pytorch。

通过将其管道整合到单个推理服务平台上,SNAP大大缩短了开发时间和成本,同时确保了更新模型的无缝部署。结果是由AI提供动力的无摩擦用户体验。

SNAP的机器学习工程师ke Ma解释说,我们不想为我们的屏幕快通管道部署定制的推理服务平台,用于张量的TF服务平台,Pytorch的Torchserve平台。特里顿(Triton)的框架 - 静局部设计和对多种后端(例如Tensorflow,pytorch和onnx)的支持非常引人注目。它使我们能够使用单个推理服务平台服务端到端的管道,这减少了我们的推理成本以及更新生产模型所需的开发日数。

在成功推出了在马萨诸塞州Nvidia Triton上成功推出了屏幕快照服务之后,他的团队转向nvidia tensorrt进一步提高他们的系统性能。通过在编译过程中应用默认的NVIDIA Tensorrt设置,Screenshop团队立即看到了3倍的吞吐量激增,估计可提供惊人的66%的成本降低。

由AI提供财富的财务自由

WealthSimple是一个管理超过300亿加元资产的加拿大投资平台,它通过NVIDIA的AI推理平台重新定义了其机器学习方法。通过标准化其基础架构,财富简单将模型交付时间(从几个月到15分钟)削减,消除了停机时间并授权团队提供机器学习作为服务。

通过采用Nvidia Triton并通过AWS运行其模型,财富可以达到99.999%的正常运行时间,确保了每年超过1.45亿次交易的无缝预测。这种转变突出了如何健壮的人工智能基础设施可以彻底改变金融服务。

Mandy Gu说:,,,,Wealthsimple的高级软件开发经理。通过Let的增强来提升创意工作流程

AI驱动的图像生成改变了创意工作流程,可以应用于企业用例,例如为营销视觉效果创建个性化的内容和富有想象力的背景。

尽管扩散模型是增强创意工作流程的强大工具,但模型在计算上可能很昂贵。

优化其使用稳定扩散XL模型的工作流程在生产中,让我增强,开创性的AI初创公司选择了NVIDIA AI推理平台。

让我们增强的最新产品AI Photoshoot使用SDXL模型将普通产品照片转换为电子商务网站和营销活动的精美视觉资产。

凭借Nvidia Triton对各种框架和后端的强大支持,再加上其动态批处理功能集,Let's Enhance能够无缝地将SDXL模型无缝地集成到现有的AI管道中,并释放了工程团队的最少参与,从而释放了他们的时间进行研发工作。

使用OCI加速基于云的视觉AI

Oracle云基础架构(OCI)集成Nvidia Triton为其愿景AI服务提供动力,将预测吞吐量提高高达76%,并使潜伏期减少51%。这些优化改善了客户体验的应用程序,包括自动化运输机构的通行费和简化全球企业的发票识别。

借助Triton的硬件不可吻合的功能,OCI扩大了其AI服务组合,在其全球数据中心提供了强大而有效的解决方案。

OCI的数据科学服务部产品管理总监Tzvi Keisar说,我们的AI平台是为了我们的客户的利益,为我们的客户有利。用户。

Microsoft的实时上下文化智能和搜索效率

Azure提供了由NVIDIA AI提供和优化的虚拟机的最广泛和最广泛的选择之一。这些虚拟机包括NVIDIA GPU的多代Nvidia Blackwell和Nvidia Hopper系统。

基于这一丰富的工程合作历史,NVIDIA GPU和NVIDIA TRITON现在有助于加速AI的Microsoft 365的AI推断。Microsoft 365 Copilot可作为Windows PC上的专用物理键盘键,将LLMS的功能与专有企业数据相结合,以提供实时上下文化的智能,使用户能够增强其创造力,生产力和技能。

Microsoft Bing还使用NVIDIA推理解决方案来应对包括延迟,成本和速度在内的挑战。通过整合nvidia tensorrt-llm技术,微软为其深度搜索功能大大提高了推理性能,该功能优化了Web结果。

由Microsoft提供深入的搜索演练

Microsoft Bing Visual搜索使世界各地的人们可以使用照片作为查询找到内容。该功能的核心是Microsoft的Turingmm Visual Embedding模型,该模型将图像和文本映射到共享的高维空间中。由于它在整个网络上都有数十亿张图像,因此性能至关重要。

Microsoft Bing使用NVIDIA TENSORRT和NVIDIA加速库(包括CV-CUDA和NVIMAGECODEC)优化了Turingmm管道。这些努力导致了5.13倍的速度和显着的TCO减少。

通过硬件创新释放AI推断的全部潜力

提高AI推理工作负载的效率是一项多方面的挑战,它需要跨硬件和软件的创新技术。

NVIDIA GPU位于AI支持的最前沿,为AI模型提供了高效率和性能。他们也是最重要的节能:NVIDIA加速了计算Nvidia Blackwell建筑具有在过去的十年中,将代币产生的能量削减100,000倍用于推断万亿参数AI模型。

这Nvidia Grace Hopper Superchip,结合了Nvidia Grace CPU和Hopper GPU架构NVIDIA NVLINK-C2C,提供各个行业的大量推断绩效改进。

用Meta Andromeda的行业领先ML解锁广告商的价值

meta仙女座正在使用超级棋子高效且高性能的个性化广告检索。通过在Facebook和Instagram上创建具有更高的计算复杂性和并行性的深度神经网络,它在某些细分市场上取得了8%的广告质量改进,并改善了6%的召回率。

通过优化的检索型号和低延迟,高通量和内存感知的GPU操作员,与以前的基于CPU的组件相比,Andromeda的功能提取速度可提高100倍。AI在检索阶段的这种集成使Meta能够领导该行业的广告检索,从而解决了诸如可伸缩性和潜伏期之类的挑战,以获得更好的用户体验和更高的广告支出回报。

随着尖端AI模型的大小不断增长,生成每个令牌所需的计算量也会增长。为了实时运行最先进的LLM,企业需要多个GPU共同工作。像NVIDIA集体沟通库或NCCL,使多GPU系统能够以最小的通信时间在GPU之间快速交换大量数据。

未来的AI推理创新

AI推断的未来有望在绩效和成本方面取得重大进步。

NVIDIA软件,新技术和高级硬件的组合将使数据中心能够处理日益复杂和多样化的工作量。AI推断将通过实现更准确的预测,更快的决策和更好的用户体验来继续推动医疗保健和金融等行业的进步。”

了解有关NVIDIA如何提供突破性推理绩效结果的更多信息,并保持最新状态AI推理性能更新。