这是一项基本权利。

注册Slatest为了获得最有见地的分析,批评和建议,每天都向您的收件箱交付。

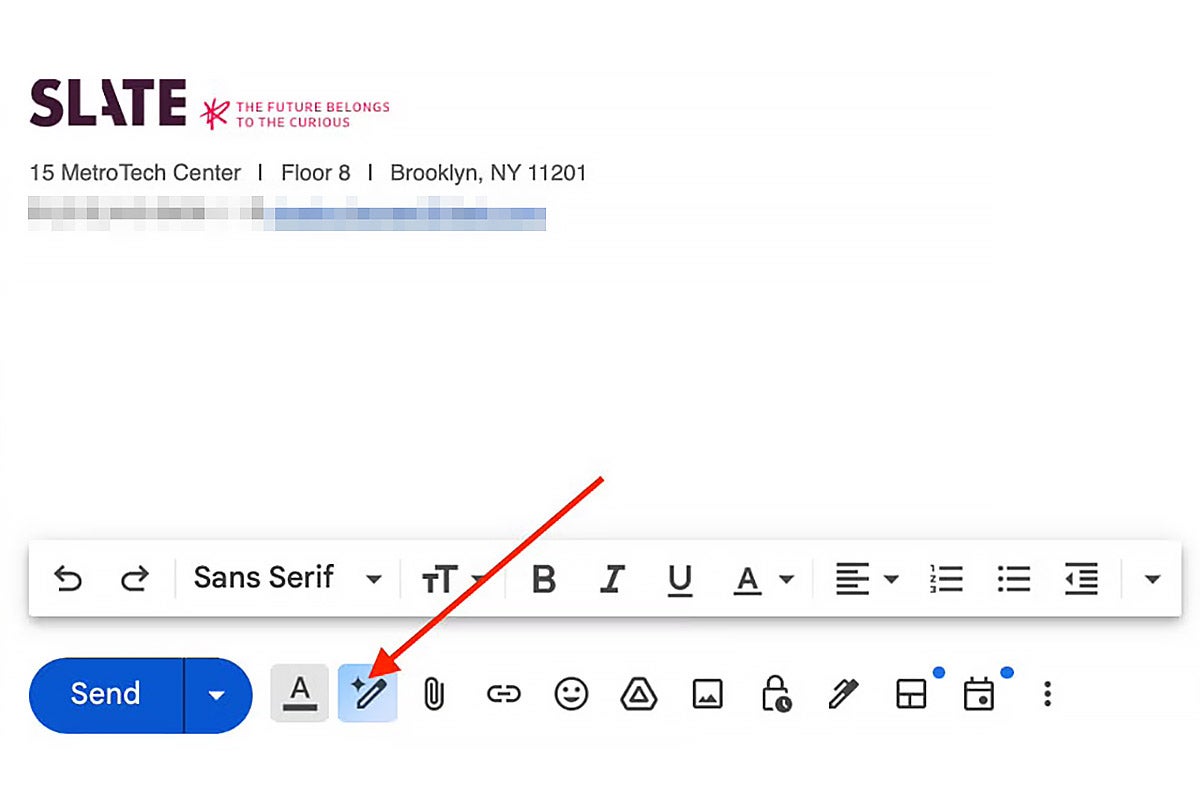

上周二,我从一个幸福的无计算机假期出国回来,登上工作,只是在我的收件箱中找到了一个不请自来的访客:Gemini,Google S A.I.助理,已被部署到我的工作区,没有任何警告。当我在两周内首次登录Gmail时,一个侧面面板突然出现,像Clippy过去的幽灵一样介绍了自己。``嗨,莎莎,今天我该如何帮助您?如果那个弹出窗口没有开始。人工智能。

是有争议的,有充分的理由。同时威胁生计和传播有害的错误信息。更不用说巨大的环境影响这些资源耗尽的系统具有。毫无疑问,AI。这里要留在这里,但问题是有什么能力和受益的能力。从道德上讲,尽管没有毯子的答案,但它应该始终涉及个人同意,尤其是当一家十亿美元公司推定该同意书时。

因此,我前往用户设置以关闭双子座。但是,如果您也将Google用于工作并尝试这样做,那么您还注意到它不可能。现在,这是大多数人的斗争都将在选择的地方结束,并且可能会给他们的IT人烦恼。

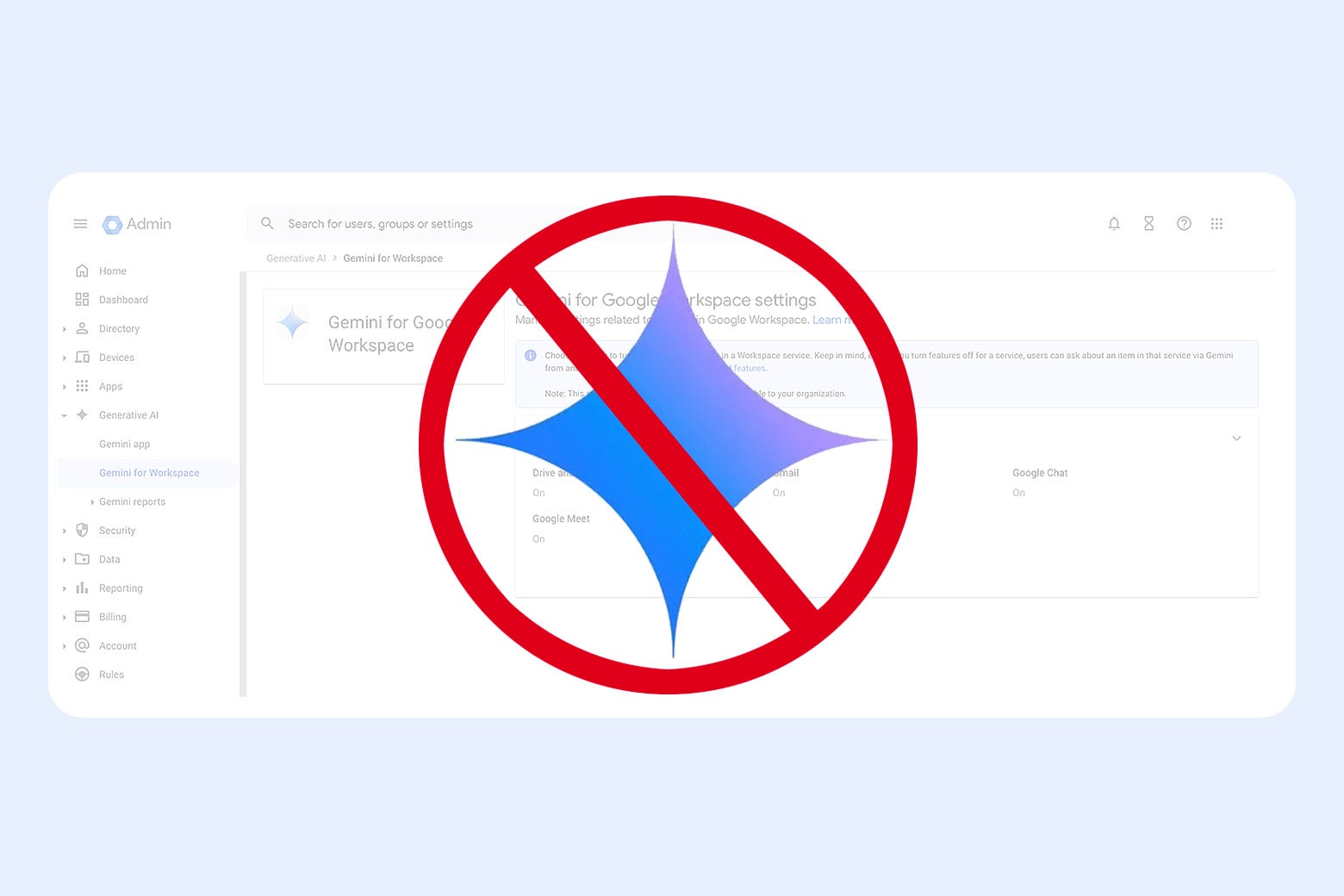

但是我碰巧是Slate很生气了,所以我登录了我的管理面板,位于崭新的Ai ai tab,并导航到我关注的对象:gemini for Google workspace只是发现没有设置可以管理任何设置,也没有任何选择可以关闭它。

鉴于大多数工作空间功能都是可以通过管理面板定制的,这尤其令人困惑。从字面上看,我们为Google支付的费用。

例如,如果我想为某些用户管理驱动器外部/内部查看设置,我可以做到这一点。如果我想限制用户在日历中的共享能力,我可以做到这一点。如果出于某种原因,尽管我想完全关闭这些功能,尽管是用户工作流的主要组成部分,我可以做到这一点。双子座为什么会有什么不同?

第二次猜测自己,我关闭了双子座应用程序,并希望能够生效所需的更改(Google警告您可以花点时间)。但是几天过去了,双子座仍然问我是否需要帮助在Gmail完成句子,所以就像其他任何烦人且长期以来的互联网居民一样,我前往Reddit,看看其他Sysadmins对此还要说什么。我发现我不安的东西。

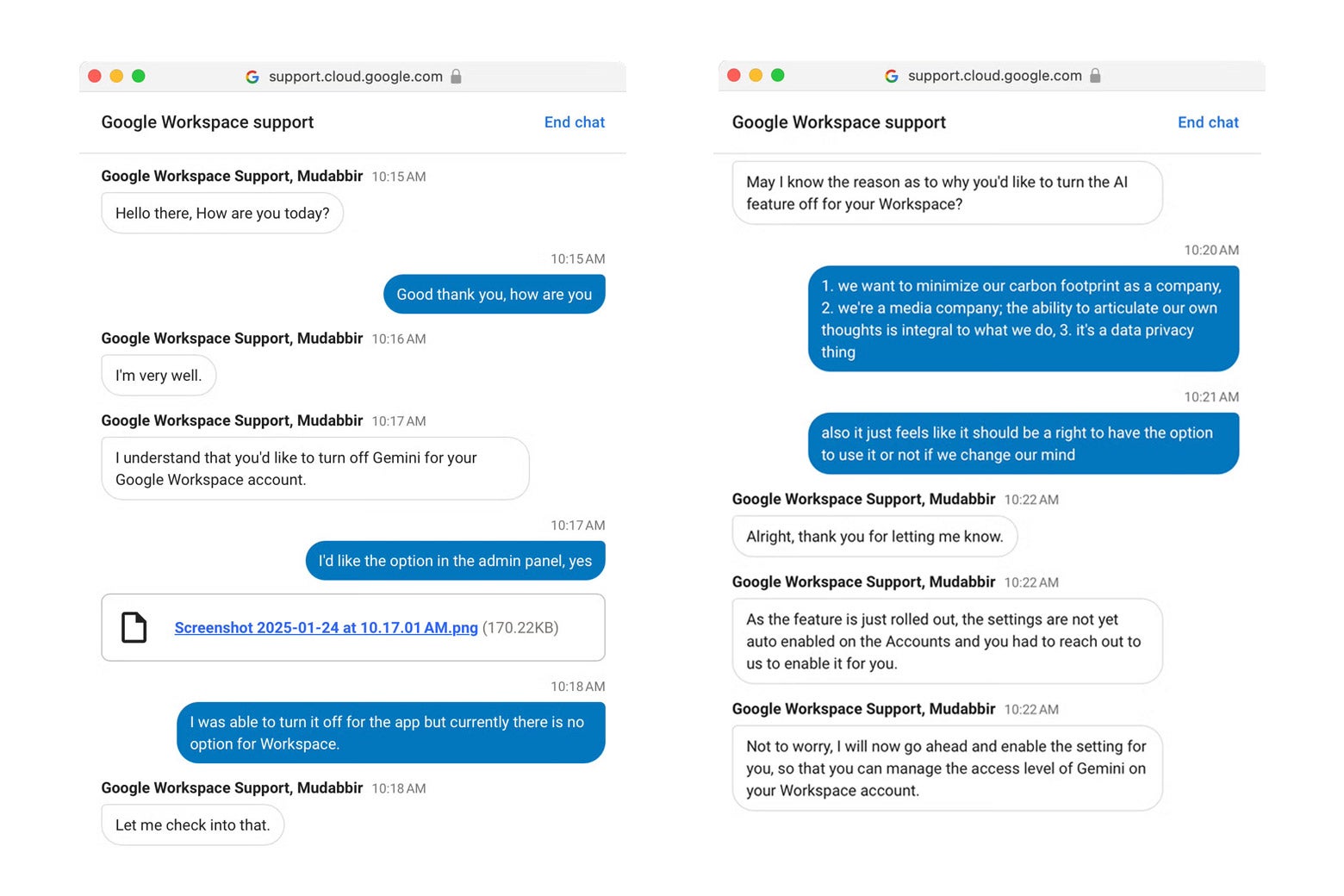

在一个帖子中,reddit用户Heretocomplen123描述了他们如何在Google Workspace上遇到Gemini,但无法立即将其关闭。最终,他们在与Google代表联系后能够找到解决方案。用户写道,我与客户支持聊天,并应我的要求添加了设置,之后我能够切换所有Gemini进行工作空间设置(Gmail等)。”

您必须去询问Google可以将其关闭。

多亏了附加的屏幕截图,我们中的许多人都得以效仿,有些人在客户支持队列中等待几个小时,有些等待几天才能终于消失。我等了10分钟。这是我与Google Workspace支持的聊天中的屏幕截图。

根据我刚刚经历的事情,以及其他许多付费用户正在经历的事情,Google选择了生成型A.I.默认值。您必须加倍努力,等待几个小时,以支撑队列才能选择退出。就像Meta的搜索栏兼作AI。搜索或运输安全管理局如何在机场进行默认的生物识别筛查,这些形式是一种操纵设计策略的形式,除非都强迫您与A.I.进行培训。(这也是一个很好的例子分解)

虽然同意的道德规范是这里最直接的,但要确认有充分记录的生成性A.环境的影响以及其在现代的 战争, 喜欢META打开其A.I.美国军方的模型,进一步损害环境。通常没有用户投入的技术将技术使用正常化提出了有关问责制和可持续性的紧急问题。

Google支持聊天向SubredDit中的自己保证,最终将为所有人推出Gemini退出Gemini的选项。但手头的问题是Gemini for Google Workspace被推广为成品没有选择退出或管理其设置的能力。这个问题与双子座的侵入性无关,而是关于用户自主权的侵蚀。通过制造A.I.选择退出而不是选择加入,Google设定了一个危险的先例:默认情况下的同意推定。

Utpal Dholakia在文章中描述了此默认今天的心理学作为对影响他人行为的任何人使用的技术,也代表不对称的动力动态。他写道,操纵器很强大,并且操纵很弱。政府和企业利用行为推动来影响公民和雇员,而不是相反。<如果我试图推动美国政府降低税收法案,这毫无疑问,我可能会认为自己是贤惠和可以接受的,我很快就会发现自己在监狱中。”

他补充说,默认的选择会造成巨大的权力失衡,这可能会对许多人造成巨大且不可逆转的伤害。”

在最近的一个面试Openai的首席执行官Sam Altman是最大,最有影响力的A.I.在美国的公司表示,社会的整个结构将成为A.I.的辩论和重新配置。继续发展。如果是这种情况,那么我们的使用方式或制成使用A.I.在Google将Gemini在我们的工作空间上推动的实例中积极进行谈判。

我不得不与Google的支持联系以要求将Gemini关闭我的工作空间是不道德的,因为所有用户都应该选择选择。或者出去,如果他们这样选择。借此权利无权说出我们的烦人或徒劳,这是至关重要的,因为它塑造了已经偏斜的动力动态的未来,在这种情况下说不再是不可能的。

有人可能会争辩说,这种方法对于确保广泛采用并通过用户反馈改进工具是必要的。因为AI。模型依靠数据来发展,使Gemini成为默认功能可确保参与度。尽管这种推理似乎有效,但它忽略了同意的伦理。默认情况下,假定同意会破坏信任,并为科技公司与用户互动设定了危险的先例。

而AI。的数据用法表明大众兴趣很大,在用户自动选择进入体验的情况下,很难将这些数字以表面上的价值进行。只是因为我们都醒来了纯真之歌在我们的iPhone上,这并不使其成为有史以来最受欢迎的专辑。此不可靠和夸大的数据随后燃烧了一个恶性循环:大型科技公司对A.I.的加倍,将Gemini之类的产品用于工作空间,用户可以选择退出,然后期望其股东立即回报,同时等待用户等待用户热情地拥抱它。

现在,对于Slate的所有人,Google为用户提供选择选择自己的选择。作为A.I.在我们的数字生活中变得越来越普遍,尤其是在没有太少的立法来防止其滥用的情况下,我们必须要求问责制和拒绝的权利。选择绝不应该是高级功能,这是一项基本权利。

注意:否A.I.在写作中使用了帮助文章。

注册Slate的晚间通讯。