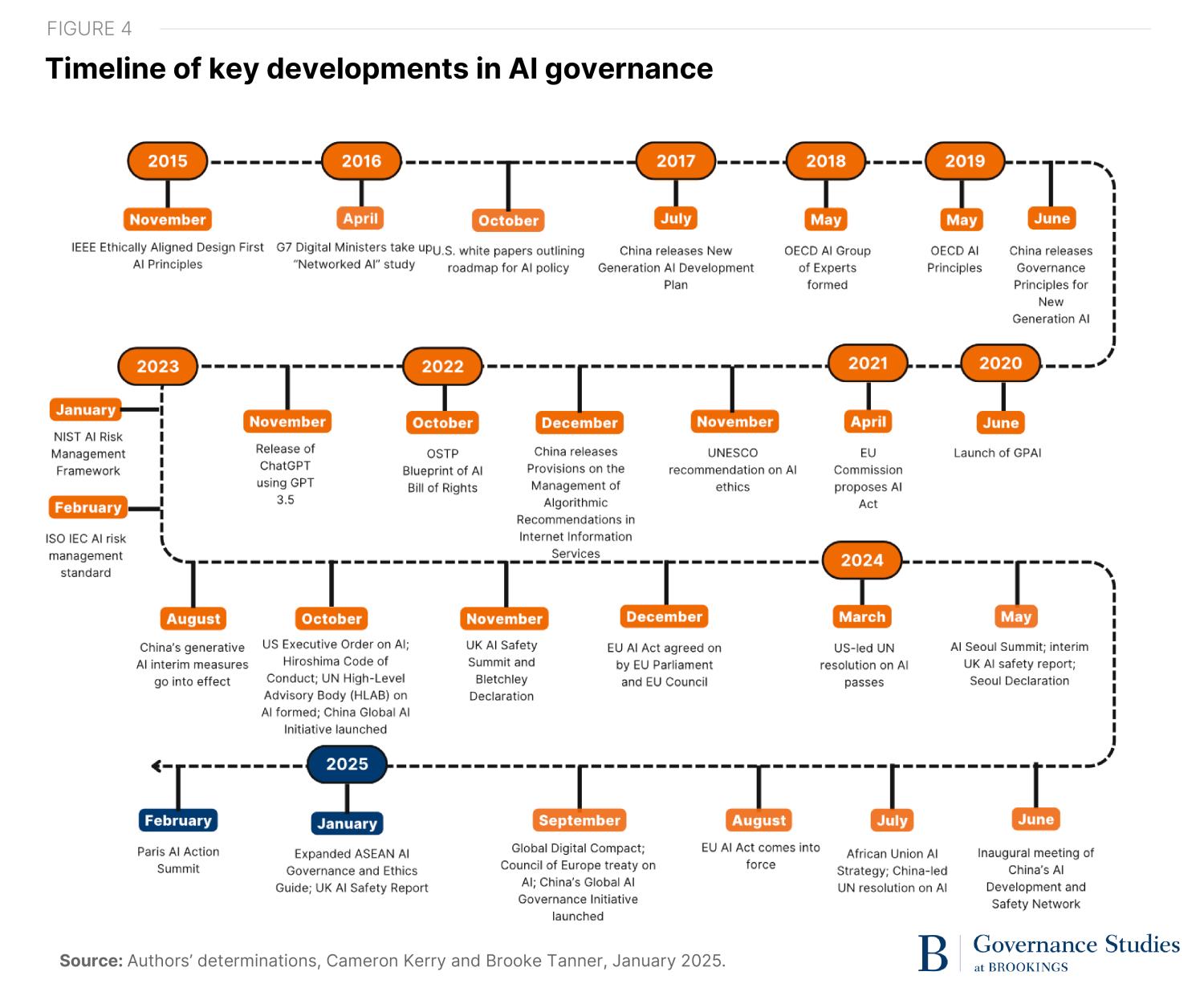

十年前,人工智能引起了几个政府的关注。自2022年分水岭发行Chatgpt以来,它已成为许多人的关注。1反过来,这种发展促进了许多国家政府,大多数多边组织以及各种不断发展的团体和临时联盟的政策计划。这些努力既寻求实现AI扩大科学和人类能力前沿的机会,并促进生产力和创造力,并确定和减轻AI对人类和社会的风险。

努力和道路的多样性似乎令人困惑,不连贯或冲突。在国际层面,AI治理包括经合组织和联合国教科文组织通过的AI道德建议等框架和原则,2从那时起,已经扩展到包括许多国家政府的战略文件和非洲联盟的大陆战略;3额外的软法律努力和自愿行为守则,包括七国集团和东盟等多边组织;4欧盟规范高风险AI应用和通用系统的立法;5英国政府召集的Bletchley会议的安全机构网络;6联合国秘书处和英国政府组成的国际专家团体的AI科学与安全报告;7更广泛地关注国际标准发展组织对AI的工作;8而且,在2024年,由46个成员国和其他36位签署的欧洲理事会的约束框架公约以及2024年联合国大会通过的全球数字紧凑型(GDC)启动了联合国科学小组和联合国的探索在AI治理和发展能力建设中的作用。9

这次高速冲动促使一些声音敦促AI治理的某种全球结构,实际上是国际交通警察为这些多样化的努力和国际团体带来秩序和一致性。联合国秘书长安东尼奥·古特雷斯(Antonio Guterres)和Openai首席执行官Sam Altman及其联合创始人Greg Brockman和Ilya Sutskever最有促进这种集中式方法的例证,他们都呼吁由类似于国际原子能机构(International Antomic Energy Agency(Internation Antomic Energy Agency)(类似的机构)监管基础AI(IAEA)。10在巴黎举行的2025年2月AI行动峰会的网站将AI的当前全球治理描述为“无统一的治理”,尽管它得出的结论是 - 一项单一治理计划不是答案11

我们认为,巩固国际AI治理的努力是过早的,并且不适合应对统治高级AI的巨大,复杂,新颖,新颖的挑战,以及当前的多样化和分散的努力是有益的,并且最适合这项复杂,快速发展的技术。

探索AI的巨大陶土,意识到其机遇并管理其风险,需要治理,可以随着AI的出现,对AI风险的出现,对技术及其含义产生深刻的理解,并动员各种资源和倡议,以解决这些风险全球对获得AI的需求不断增长。没有建立多个联盟并与工业,慈善事业,民间社会和学院的专家和机构紧密合作的情况下,没有一个政府或机构能够应对这些挑战。

与集中系统相比,网络分布式网络可以更有效地应对AI治理的挑战和机遇。就像AI所依赖的互连信息技术系统的架构一样,这种分散的系统可以通过将AI治理的功能引导到迭代和多元化流程中最及时,最有效的途径,从而带来冗余,弹性和多样性,从而提供敏捷性在任何点上反对挫折或失败。这些多个努力可以利用网络效应和并行处理的好处。

我们在下面探索了这种分布式和迭代AI治理的模型。首先,我们描述了不断发展的治理基础AI的独特而多方面的挑战。然后,我们展示了全球基础设施和投资如何与人工智能开发和部署,塑造AI活动的网络和枢纽。第三,我们研究了AI治理计划的扩散景观和这些在解决机遇,风险和理解AI方面的关键功能。我们结论是通过研究分布式治理如何适应以满足未来对AI治理的需求的结论。

全球AI治理的景观

基础AI的治理挑战

如今,S先进的AI模型与以前的技术和系统不同,其广度,复杂性和多功能性不同。首先,生成的AI是一种通用工具,具有继续确定的广泛应用。所涉及的机器学习的计算和层次的规模使得很难理解AI模型功能和应用的全部范围。尽管大型生成AI模型已经进行了广泛的测试和对齐能力和开发护栏的一致性,但英国召集的专家小组在其最终的国际AI安全报告中写道,开发人员仍然对他们的通用AI了解一无所知。模型运行。缺乏理解使得预测行为问题并在观察到已知问题的情况下更加困难。”12对于一个值得注意的例子,大型语言模型的计算机编码质量令他们的开发人员感到惊讶。13

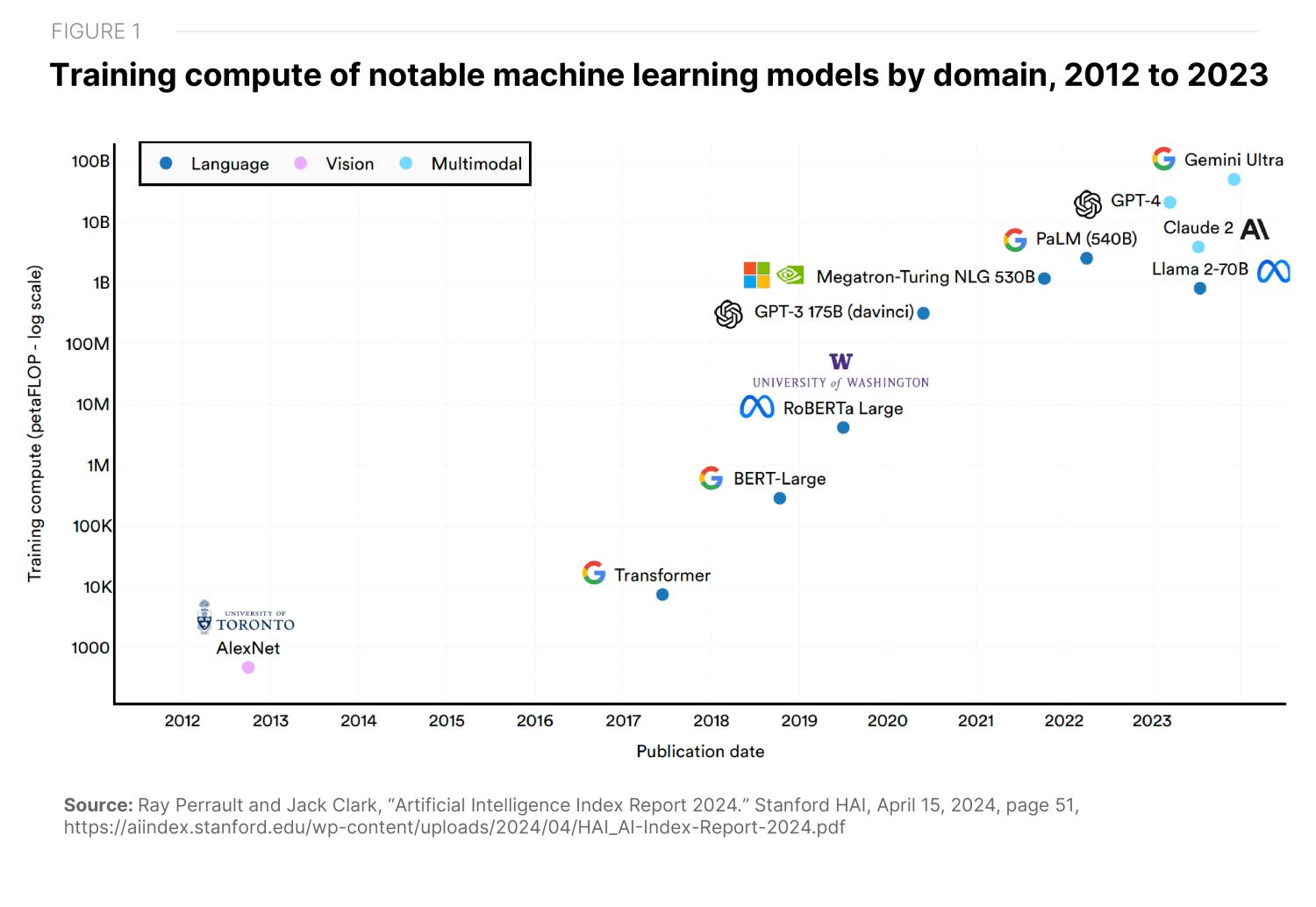

发展的快速速度增加了这些不确定性。自从第一波生成AI释放给公众以来的两年以上,这些模型已经扩大规模并正在开发新的学习技术。下面的图1显示了近年来主要生成模型中训练计算能力的增长,以便对大量培训数据进行更快的计算。14

这些模型出现了移动目标,因为它们正在通过机器学习,持续学习和其他数据的突破来迅速发展。15它们的功能不仅是未知的,并且随着发布的释放而扩大,而且通过使用量身定制的数据集通过加强学习和其他第三方培训后,这些功能可以在释放后增长和变化。16这些不确定性使得很难固定在可以引入或确定发展风险的价值链中的位置。由于这些化合物未知数,了解生成AI模型的用例和滥用将需要开发人员,部署者,政策制定者以及民间社会和学术界的专家进行广泛而连续的监控。这将需要深入了解,敏捷和适应性的治理。

Frontier AI的规模和复杂性意味着,至少在2024年底之前,只有少数国家和大型科技公司拥有财务能力和数据来开发基础AI模型。17从AI治理的角度来看,复杂性增加了了解新引入模型的能力和风险,衡量其性能并评估遵守适用规则,标准和自愿行为守则的挑战。它需要与行业和专家进行AI治理的密切合作。

尽管Frontier AI不确定性,但许多应用和风险仍然很明显。最突出的是,这些包括偏见和歧视,虚假或恶意内容,增强的网络攻击以及放大的隐私入侵以及AI对能源消耗,竞争,知识产权,劳动力市场或系统影响的附带影响。对这些的反应将在国家一级重要,并取决于用例,现有机制在法律或其他方面的效果和适用性。这些回应还将从基于共同利益的国际合作中受益,以实现关键的质量和对齐方法。

引起治理挑战的另一个已知用例是AI的双重用途功能,其有益应用与潜在的破坏性应用程序相吻合。举一个突出的例子,AI驱动的蛋白质折叠量被授予诺贝尔奖,也可以用于开发生物武器。18这些双重用途的特征将AI与通用电力区分开来,这些电力并未产生立即的国家安全风险,而不是核能,这不是广泛的通用技术。在控制AI使用具有国家安全影响的同时,在经济和社会上最大程度地部署AI的目标将国家安全考虑到治理讨论,从而进一步使AI治理方法变得复杂。

生成AI及其广度和潜力的国家安全维度也使地缘政治成为全球治理格局的重要因素。美国,中国和其他大国认为AI在战略上对竞争力和国家安全在战略上很重要,因此旨在使AI发展领导,使像AI这样的技术使中国与G7国家及其盟友之间的竞争中心,以及对地缘政治愿望像印度和巴西这样的中大国。结果是,志趣相投的经济和国家安全联盟将在AI治理上实现最深入的合作。包括更广泛国家的AI治理机制将受到较窄的共同点的限制。尽管美国和中国可以从事AI治理,但在联合国等机构中进行深入合作的机会将受到限制。例如,每个人都支持彼此平行的联合国大会(UNGA)决议,但是他们在AI上的双边合作一直是暂时而狭窄的,最具体地避免了自主武器系统中意外的冲突。19

围绕AI的地缘政治也涉及低至中等收入(LMI)国家的公平和获取问题。访问AI的发展的重要性越来越重要,这是GDC的基础,并补充了联合国可持续发展目标。20对于私营部门的领先AI开发商,LMI国家提供商业机会;对于领先的人工智能国家的政府,他们还提出了地缘政治机会,如美国和中国联合国联合国联合国大学决议所反映的那样。在大多数情况下,LMI渴望参与新出现的AI的承诺,该竞争是对LMI开发的支持和美国,中国和其他地缘政治参与者的AI治理的支持。

人工智能提出的问题的广度将延长建立共识和联盟所需的时间,这些时间将需要获得更连贯的国际治理。尽管某些问题将更具定义性和可进行,但政府之间各种地缘政治,经济和发展利益的范围都会塑造论坛和合作伙伴的选择,而其他政府则需要时间来成熟。为了兼顾多个通用AI技术的多个且快速发展的属性,将需要不同的联盟和时间表。建立此类联盟将从中心核心向外锻炼,以在同心圆中建立临界质量。例如,在美国和中国进行军事使用AI的护栏的关键途径是因为在这两个之间没有达成共识的情况下,就不可能达成更广泛的共识。所有这些都强调了国际AI治理将需要进行多方面,多层和多利益相关者。

全球AI的架构

图2,可以在电视学,显示全球互联网骨干网络网络网络的示意图,该网络由众多集线器在全球范围内分布,并由电缆互连。21每个圆圈代表一个集线器,在该集线器中,流量相交并从电缆往返路线,并且圆圈和弧的大小和宽度表示将流量和内容传输到其他位置或区域所需的带宽。

我们认为该图既是隐喻,又是全球人工智能发展和治理状态的代表。AI开发在互联网的网络和枢纽上行驶。这些网络可实现云服务,计算功率以及训练数据和代码的运动,即AI研发的引擎。这些网络的地理也塑造了AI治理的地图和影响AI发展的地缘政治线。

网络和节点的浓度与AI R&D的中心相关,并且在这些中心集中,许多AI模型的领先开发人员也是如此。反过来,这将其映射到国内AI治理中早期推动者的各个政府和团体上,以及在国际层面上在AI治理中建立合作的领导人。

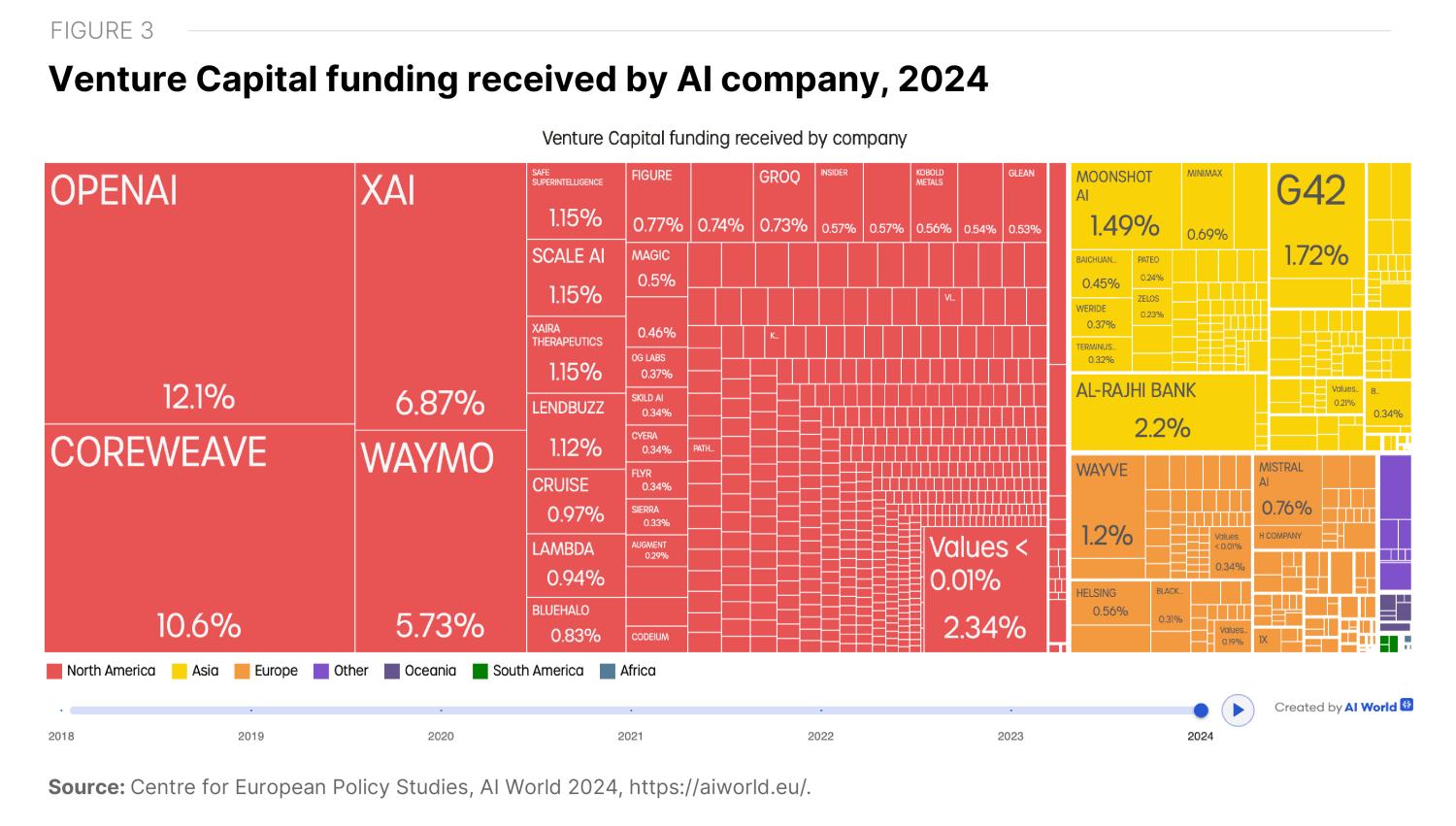

AI的另一个重要的投入也塑造了AI治理的景观,这是资本投资于AI公司。图3显示了这些公司所在的国家或地区的特定AI公司的2024年风险投资的相对数量。22它表明,到目前为止,美国(红土)是风险投资的最大来源,其次是亚洲(黄色)和欧洲(橙色)。

这种模式不仅限于风险投资。安全与新兴技术中心的国家活动追踪器AI估计,美国总投资为7630亿美元,中国为970亿美元,法国和德国的合计为460亿美元。23

有关AI投资的数据和涉及的公司强调了美国最初的领导者在开发生成AI的模型和用例中。投资数据还表明,即使欧洲是AI R&D的中心,尽管在世界上最密集的Internet Hub集中反映了基础架构和知识的集中,但这些枢纽仍未充分互连,并且欧盟没有产生欧盟。引发投资的初创公司和AI进步。这些数字还反映了全球数字鸿沟:非洲的网络基础设施(图2中右下方的浅蓝色)与非洲大陆地区和人口相关,并具有风险投资(几乎没有明显的蓝色广场)而言不成比例。在图3的右下方)甚至更小,使其急切地清除了其通往AI扩散的临界路径。24

基础设施和支持AI开发和部署在技术中的领导层的投资,因此是地缘政治利益。例如,这些转变,如果像中国那样成功地建立在开放模型上的能力,而DeepSeek R1改变了景观25然后,AI治理地图也将改变。因为很难预测AI的开发以及它们将如何影响未来新兴人工智能的地图,所以治理对改变企业,能力和风险的反应至关重要。人工智能发展将保持动态,因此也必须进行治理。

AI治理的联网方法

上面的这些数字为国际AI治理的结构提供了有用的概念模板。首先,正如下一节更详细地讨论的那样,AI治理的现有格局正在通过各种网络扩展和发展,这些网络反映了图中所示的渠道和浓度。其次,网络网络在应对AI治理的多方面挑战方面具有优势。诸如Internet之类的信息网络的主要特征是多样性,冗余和弹性,它们相互补充。互联网体系结构几乎无限的各种节点,集线器和链接的固有多样性和流动性使信息能够以最快的速度移动。这种丰富的途径导致冗余作为特征。反过来,这种多样性和冗余为特定点的延迟或故障提供了弹性。

网络的另一个特征是所谓的网络效应现象。26因此,多种互连网络可以加速信息的传播,可能会加速AI的开发并扩展可用于监视和评估AI风险的信息。

基础AI模型的规模和复杂性,所涉及的问题的多样性和不确定性以及参与者之间的利益和进步差异并不能使自己有系统地订购解决方案。相反,AI治理的形状需要适应这些变化和现有景观。各种具有适应性参与的国际论坛创造了AI治理系统的枢纽和互连,该系统可以迭代并适应各种AI治理需求。一些努力可能会复制其他工作,但是由此产生的多样性和冗余引入了人工智能治理中的自然实验,一些努力超出了预期,有些生存以及有些失败。

图2中所示的互联网基础设施的治理对AI治理具有启发性。27互联网没有中央理事机构;取而代之的是,通过有限的政府参与度有限的多方利益相关者组织的宽松聚合,建立了使流量在网络和节点上移动的系统,标准和协议。这些组织之一,即指定的姓名和数字的Internet Corporation(ICANN),最初是为了管理Internet域名和数字系统作为非营利性公司的系统,由美国机构任命的董事会,但很大程度上留给它自己的设备。28在美国决定完全与政府建立任何联系的任何联系之后,制定了一项新的治理计划,使董事会对互联网的利益相关者负责(这是一位作者Kerry的过程首先是政府官员,后来在新治理计划的律师事务所担任律师。29与数字通信系统的技术互操作性相比,AI的治理涉及更广泛的公共政策问题,因此需要对政策制定者和利益相关者的更广泛的横截面进行更多的参与。然而,AI治理还涉及高水平的技术复杂性,互联网体验既提供了自我组织利益相关者治理可以在国际层面上以持久的方式工作的证明,并且在网络效应扩大了扩大的范围内,有害信息和互联网工程的脆弱性需要改造安全和隐私。

网络应该提出一个管理AI的模型可能是很合适的。毕竟,它是将机器学习系统作为神经网络的构想,为生成AI提供了关键的突破。约翰·霍普菲尔德(John Hopfield)的诺贝尔奖获奖论文总结了这些网络的运作,因为它们是从大量简单处理元素或神经元的集体行为中自发地出现的 -[T]继承异步并行处理能力将为某些类别的计算问题提供快速解决方案。30也许众多治理过程的集体行为可以同时解决AI本身的治理问题的解决方案。下一节介绍国际景观中出现的主要能源中心,他们执行的治理功能以及它们反映网络体系结构的方式。

新兴网络和节点的功能

AI治理的总体目的是在探索和管理风险时实现AI的好处。这个双重目标为几乎所有关于国家和国际层面的主题的陈述提供了一个框架,无论国家和地区利益,文化和能力的差异如何。这些也有一个一般的前提,即AI治理的目标需要国际合作,因为甚至比以前的数字技术,AI的风险,开发和应用甚至更多。

结果是AI的发展和政策促使国际合作促进了高度的国际合作。国家政府很快就接受了国际参与,并认识到,随着人工智能在重要方面超越全国边界,仅国内AI治理就不足以最大程度地提高机遇和解决风险。31例如,对识别和减轻AI风险的共同和可互操作方法的政策保持一致,将有助于AI公司为全球市场建立负责任的AI,并加强国家管理这些风险。如果没有有效的全球合作,就无法实现扩大LMI中AI的访问权限。

对于LMI国家的许多国家,围绕AI治理的许多工作都被视为更广泛的AI开发议程的子集,该议程将AI用作满足开发需求的工具。该议程不仅在联合国,而且在多边和地区发展银行,政府援助计划,慈善事业和私营部门行为者中仍在拼凑在一起。所有这些在满足满足这些需求的AI开发方面都具有必要的作用,可以在满足当地发展需求和资助AI开发资金中发挥作用。尽管联合国可以在促进AI发展作为全球问题的发展方面发挥领导作用,但动员了政治关注,也许是资助了发展AI治理机制的工作,扩大了对AI基础设施的访问,建立相关应用程序以及资金将休息主要与这些分布更多的演员一起。

在十年的时间里,围绕AI治理的许多国际努力已经迅速发展。32这些涵盖了多边组织和分组,其他国际组织和民间社会组织,公司,学术界和杰出个人。甚至梵蒂冈也都对道德,透明和负责人的AI进行了权衡。33最初,治理计划的重点是广泛的原则和研究,尤其是围绕AI伦理。但是,随着AI的进步和公众意识的提高,这些已从这些广泛的愿望转向了特定的用例和规则(无论是立法,法规和其他行政行动,或软法),标准,措施,工具和流程,具有不同功能。本节关注此进步,涉及的功能以及跨各种渠道的思想传播的关键示例。

G7作为孵化器

第一组基于广泛的国际AI伦理原则来自标准发展组织,即2015年IEEE在道德上一致的设计。34政府间推动最早的是G7。即使在大多数国家政府之前,日本向G7数字部长提出了对网络AI的研究,就在2016年进行了AI。35反过来,该项目被任命为经合组织,并将其发展为OECD关于AI伦理学的建议,该建议于2019年通过,扩大了对经合组织成员以及其他44个国家的吸收。36经合组织的原则成为G20政策声明的基础,并影响了其他原则和政策。37

在2017年和2018年的加拿大和法国总统任期下,G7启动了全球AI(GPAI)的合作伙伴关系,该合作于2020年与15名成员启动。38GPAI最初被认为是国际气候变化小组(IPCC)的AI界的国际小组,并将工作组的专家和政府参与者召集在一起,以实施经合组织原则,成长为29名成员。OECD和GPAI随后在2024年通过进入综合合作伙伴关系,与来自七大洲的44个参与政府进行了重叠的会员和专家网络。39

在日本总统任期下,G7是在Chatgpt和其他大型生成模型发行后的几个月内进行进一步倡议的场所。那个国家发起了有关生成AI的广岛AI流程,40在美国 - 欧盟贸易技术委员会中,达成了为此类模型制定拟议的行为守则的协议。41反过来,白宫从基础模型的主要开发商那里获得了一系列自愿承诺,42这成为2023年末通过的G7广岛原则和行为准则的基础。43这一结果催生了一个广岛流程朋友团体,以支持该行为守则,该守则现在构成了49个政府以外的政府。44在2024年,另一个枢纽和网络,通过GPAI完成的多方利益相关者开发,为公司实施广岛行为守则而延长了其范围。45这项工作将补充经合组织为开发AI事件报告系统的持续工作。46

这说明了G7如何作为AI治理的关键枢纽,其计划迅速传播并通过其他枢纽(经合组织秘书处)和网络(G20,OECD成员,GPAI成员,Hiroshima Friends Friends Group)建立。即使G7是一个明显狭窄且富裕的群体,但这些举措从基地中出现是合乎逻辑的。47这些是正在开发和部署最快和最宽的国家的国家;48因此,他们对所涉及的实体具有明确的管辖权,并面临更直接的责任,以应对其人口或国家利益的潜在风险。49由于这些国家是有动力和相对志趣的,因此这些较小的群体被证明更加敏捷,更有能力使国家利益保持一致。他们还可以利用广泛的专业知识和其他资源,使他们能够从事评估AI问题所需的复杂基于研究的工作和参与度。

G7及其链接的枢纽和网络的例子强调了如何建立AI的国际合作的各种努力相互建立,但也独立存在。这样的多个能量中心通过避免单个失败和分发功能来建立AI治理中的弹性。他们还创造了机会,以各种国家和其他利益相关者的意愿和参与能力取得进展。相比之下,官僚主义和地缘政治紧张局势会减缓国际AI治理风险的更大或更集中的结构。

不断发展的全球网络和枢纽

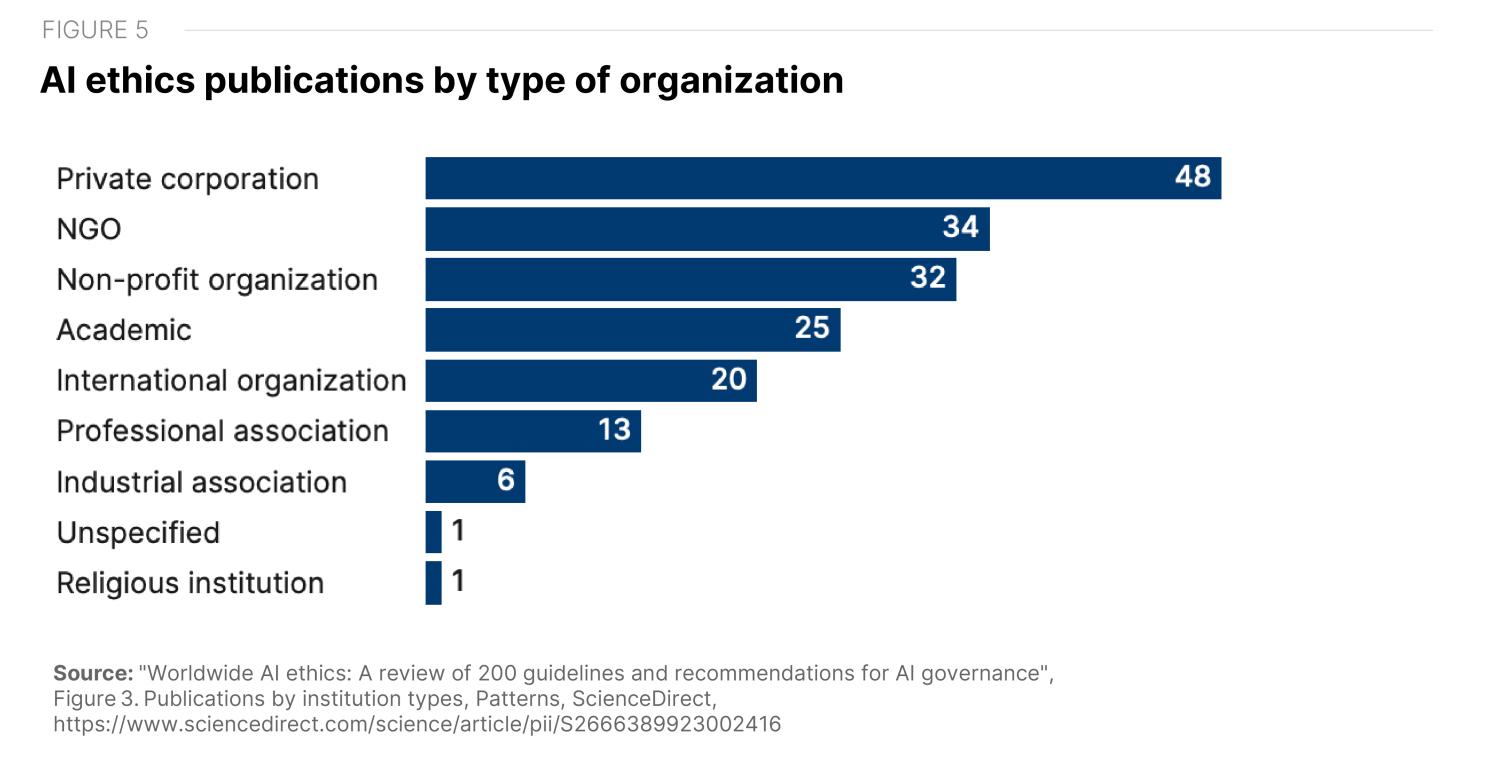

与上述G7和其他枢纽链接的网络相比,还有更多,更多的分布式网络。经合组织原则在塑造AI的方法方面具有广泛的影响力,但是经合组织并不是一个人在为AI的道德原则中培养。到2023年,一项研究确定了各种组织的200个道德原则和框架。50图5显示了组织和公司的许多组织类型的细分,其中最大的部分来自非政府组织和非营利组织的组合。51

对道德文件的其他分析发现,跨道德文件的价值观和原则相当大。52这些基础上的反复原则是,AI应该值得信赖,即可靠,安全和以人为本的)增强人类的经验,而不是取代或损害他们。

当前的大多数治理网络与民间社会和行业团体以及学术研究人员交织在一起,所有这些都为治理职能提供了信息。在某些情况下,这些专家正在进行纯粹的研究。在其他情况下,它们在多利益相关者论坛中运作,参与全球标准机构的AI标准,与模型的开发人员进行咨询或建议政府间论坛。53这些专家的分布式网络有助于识别和解决一系列AI风险,例如潜在的滥用或生成AI模型的错误,但也更具专利或直接风险,例如对合成内容,偏见和歧视的恶性使用。许多人参加了经合组织和GPAI的专家网络,54联合国高级咨询机构和英国模型安全科学小组等专家小组,55其他国际组织的会议或本文作者召集了将近五年的圆桌会议。56

针对人工智能的新政府举措仍在新兴中,这是一种治理企业家精神的形式,表现为政府为AI领导而竞赛。最具体的先进是在风险和安全领域,英国于2023年10月召集了其Bletchley AI安全峰会。57从该活动中出现了越来越多的AI安全机构(AISIS),英国,美国,韩国,加拿大和法国建立或宣布了AISI和欧盟AI办公室和新加坡的安全功能,并参与了AISIS网络,并宣布了AISIS网络2024年11月。58中国加入了其他27个国家的Bletchley宣言,从最初的峰会出现了,而不是随后的首尔宣言。59即便如此,中国还是建立了一个中国人工智能发展和安全网络,这是领先的大学和研究机构的合作。60

安全研究可以在测试,测量和红色团队等领域制定政策和指导,重点是合成内容风险,基础模型测试以及常见的风险评估方法,以使AI安全的各种方法保持一致和认可。这是从游泳中浮现的。公司财团还通过边境模型论坛,AI联盟以及法国Argimi联盟测试主要模型,并遵守广岛原则中体现的承诺。61法国将于2025年2月举行下次安全峰会,将其作为AI行动峰会进行计费,并提出雄心勃勃的议程,而不是AI安全性要广泛。62

评估和管理AI风险和安全的渠道的扩散既表明了生成AI的出现以及AI治理的各种节点和网络的相互作用产生的催化影响。其他国家和地区正在评估他们是否需要针对其人口和社会的其他安全分析,而安全机构的传播可以建立事件报告网络,以帮助填补有关AI风险的具体信息的空白。

治理企业家精神的另一种形式是规范高风险系统和通用AI的欧盟AI法案;它主要是为了为AI系统提供一个单一市场,它还旨在为AI的全球规则塑造全球规则63就像欧盟的一般数据保护法规是采用隐私和数据保护法并寻求在欧盟贸易的其他国家的重要模板一样。64欧盟委员会正在努力通过有关通用AI的透明度,降低风险和内部治理的行为守则来实施《 AI法》,并采用合格评估的技术标准制定。65值得注意的是,尽管欧洲委员会将监督遵守《 AI法案》,并有助于塑造行为和标准守则,但大量利益相关者的起草是制定法规的。66美国国家标准技术研究所(NIST)AI风险管理框架于2023年发布,绘制了一种更灵活的方法,特别是旨在不适合千篇一律的,并且可以适应不同水平的风险。67巴西和印度正在制定AI立法,巴西的类似于欧盟和印度,希望采用更轻松的触觉,以期待创新和发展,同时仍在解决风险。68

中国采用了一些最早的国内AI立法,像欧盟法律一样,在数字舞台上增加了一系列法律。69它特定于AI的规则将重点放在建议算法和深层效果上,需要标记和禁止社会秩序的破坏;另一条规则为使用公共面向公共的生成AI和使用尊重知识产权的高质量培训数据而创建的非法内容的责任;中国还要求生成的内容与中国学说和XI Jinating Iss的共产党一致。”70尽管这种监管计划和美国对最强大的加工芯片的控制权,但2025年1月,DeepSeek发行了一种聊天机器人模型,其功能似乎使其在某些基准测试中与美国领先的模型具有竞争力。71

AI治理互操作性

依赖国际合作的另一个关键治理领域是为AI治理互操作做出国内处理。与人工智能政策和法规的互操作性和一致性的努力相比,与在国家国家运作的法律,法规和国家安全的方法相比,与人工智能风险和安全的方法相比,与AI风险和安全相比,更异质的问题和国家利益。结果,随着国家政府对其法律和价值观制度量身定制了对用例和风险的规定,这种治理功能涉及更广泛的倡议,并有更大的分歧空间。但是,最大程度地减少国内AI法规中不必要的差异对于降低成本和扩大访问AI的障碍至关重要。发散的AI法规还可能会损害对已知的AI风险的有效监督,这些风险不会停止在边界,并使竞赛成为底部,或者使公司能够仲裁不同的AI法规。在这方面,互操作性还与AI风险管理和安全性有关:需要互操作以加强安全性,包括加强安全性,包括红色团队的通用方法和建立网络安全,以防止恶意参与者通过AI系统获得AI系统的访问,并通过AISIS相互认可。工作。数据治理的常见方法可以增强数据质量和可靠性,并促进跨边界的数据共享。

目前的三位作者在2021年在AI上进行合作论坛的报告确定了国际合作的几个具体重点领域:围绕共同定义的监管一致性;了解风险和红线,审计方法以及部门合作;共享数据的机制;标准发展;以及在社会有益的技术(例如隐私增强技术(PET))中的联合项目或挑战。72

政府正在努力促进互操作性。从一开始,此功能是国际道德框架,人工智能安全以及其他多边和双边倡议的国际合作的核心。政府继续围绕共同方法建立网络。欧盟-U.S。贸易与技术委员会和美国的技术与数据对话均于2022年启动,都是具体努力以在AI治理中保持特定主题的具体努力的例子,例如定义,风险方法,以及在双边发展标准。73``并非所有努力从国际合作中建立互操作性流动。美国NIST的AI风险管理框架(RMF)和2024 RMF用于生成AI概况是美国与私营部门合作制定的国内努力。74AI RMF结合了基于过程的指导和对国际AI标准的参考,提供了一种工具,组织在全球范围内可以用来识别和管理AI风险。中国在2023年作为其腰带和道路网络的一部分发起了全球AI治理计划,到目前为止,该计划进行了外交运动。75

贸易协定在建立数字治理问题的共识中发挥了核心作用,例如如何平衡跨境数据与适当的政策以确保隐私和安全性,在解决许多AI治理问题方面受到限制与国际贸易相交。没有关于数字贸易问题的政府间讨论不应忽略AI治理。

OECD和GPAI等群体的研究和多方利益相关者参与建立的AI的共同理解使AI治理领导者能够在G7,OECD和其他渠道中更快,连贯地达成共识。GDC的重要特征旨在扩大这种理解。The UN plan for an international scientific panel is aimed explicitly at “scientific understanding through evidence-based impact, risk, and opportunity assessments…â€76In addition, the GDC set in motion UN-hosted “global dialogues†on AI governance to take place alongside UN General Assemblies and other UN gatherings.77

The work of technical standards development organizations (SDOs) is perhaps the most broad, concrete, and advanced set of efforts on interoperability. Engagement on standards development has been a recurring subject of governmental initiatives on AI because standards can provide the technical and management architecture for implementing outcomes expressed in principles and policies and do so in ways that can bridge differences in laws or legal systems. This is why the EU-U.S. Trade and Technology Council discussions on AI included sharing priorities for standardization,78and the G7 Hiroshima summit in 2023 affirmed support for “standards development organizations through multi-stakeholder processes.â€79The EU AI Act provides for standards to establish conformity assessment with the Act’s requirements, with a strong preference for adoption of international standards.80The pan-European SDO CEN-CENELEC is working on additional European standards requested by the European Commission.81The GDC identifies needs for a variety of standards and calls on SDOs “to collaborate to promote the development and adoption of interoperable [AI] standards that uphold safety, reliability, sustainability, and human rights†(side-stepping a proposal by the UN’s High-Level Advisory Body on AI for a new UN standards coordinating body).82

英国标准枢纽跟踪国际标准的开发,并确定通过或正在开发的254个AI特定标准。The largest number of these—21 published and eight more under development—come from the joint committee of the International Standards Organization and International Electrical Commission formed to deal with AI standards, ISO/IEC JTC 1/ SC 42.83This committee has members from 59 countries, a larger number than the OECD, GPAI, and the Friends of Hiroshima group.84The two other international SDOs most involved in AI standards, the IEEE Standards Organization,85and International Telecommunications Union,86have even broader networks.这些过程的产品可以为互操作性提供重要的途径。

Expanding AI opportunities

图2和图3阐明了较富裕的国家与人口与世界大部分地区之间存在的差距。如果财富流到人工智能价值链的顶部或低至中等收入的国家无法超越他们面临的障碍,AI可能会突出这些差距。对于后一种国家而言,克服AI部署和采用的障碍是在短期内实现AI机会的关键问题。对于AI已经发展的国家,从长远来看,未能克服这些障碍是其经济,社会和政治资本的机会成本。While some that have AI associate it with existential risk,87most with little AI see不是deploying it as the existential risk.88

The African Union’s broad continental strategy adopted in July 2024 aims at realizing opportunities to use AI as a positive force for achieving Sustainable Development Goals.89It notes “limited infrastructure and skills†as key inhibitors of AI uptake and therefore identifies “infrastructure capabilities, particularly in the area of energy, broadband connectivity, data centers and cloud computing, computing platforms such as high-performance computing and IoTs and quality data…[as] key to the development of AI solutions and systems.â€90Building these capabilities will need to involve a multitude of coalitions and networks of high-GNP and LMI countries along global, regional, geopolitical, and functional lines. Unlike, say, conducting red-teaming, a small handful of players is insufficient for this large task. The UN has a vital organizing function as an institution that cuts across all these lines and can be a catalyst for building the networks and hubs needed.

The form and scope of this UN role is yet to be determined. Both the U.S. and China General Assembly resolutions on AI addressed bridging the digital divide,91with China’s version putting “capacity-building†in the title and affirming for a “central and coordinating role†for the UN.92In the run-up to the adoption of the GDC, the U.S. announced a $100 million commitment for program to expand access to AI models, building human capacity, and developing local data sets around the world, with $30 million in U.S. foreign aid and the rest from leading AI companies in funding or credits.93During this time, China proposed an “AI capacity-building action plan for good and all,†calling for all parties to increase investment in capacity-building and to conduct a further capacity-building workshop.94These reflect differences in approach, with the U.S. relying on stakeholder participation and China “upholding multilateralism†(i.e., operating entirely within the UN system where member states decide). The Belt and Road Initiative has made China the largest provider of development financing; the creation of a Belt and Road AI initiative makes AI finance a component of this investment. Between 2000 and 2017, the Chinese government supported global development finance projects worth nearly $4.5 billion in over 50 countries.95

The UN HLAB and a draft of the GDC language proposed funding for AI capacity-building to be managed by the UN Secretariat.96The General Assembly did not support this proposal; instead, it called for the development of “international partnerships†and “leverag[ing] existing United Nations and multi-stakeholder mechanisms†for AI capacity-building and expanded access.97This outcome reflects the competing views on the role of the UN in AI governance and the difficulty of reaching meaningful agreement within the UN given geopolitical tensions between the U.S. and China and others, in particular when it comes to AI.

Infrastructure is not the sole means for promoting AI opportunities for LMI countries. They also need datasets and models capable of training on smaller data volumes than those used by well-known LLMs, which are less compute-intensive and can be fine-tuned to applications that serve the distinct needs of their populations. For example, IBM Research Brazil and the University of Sao Paulo have worked on fine-tuning models with small datasets for languages like Guarani Mbya and Nheengatu, involving community leaders in guiding the projects.98Meta’s “No Language Left Behind†program offers open-source AI models that translate between 200 languages, including indigenous ones.99In South Africa, LelapaAI’s InkubaLM is a small language model trained on isiZulu, Yoruba, Swahili, isiXhosa, and Hausa.100

In parallel with these efforts, smaller models and new “reasoning†models —such as Microsoft’s Phi-4, OpenAI’s GPT-4o mini models, and DeepSeek R1—use less compute power while outperforming larger models at certain tasks, enabling broader access to AI language technologies, including on mobile devices.101Collaborations between companies and local researchers are crucial to ensuring these models are culturally-appropriate and effective.

这些在国际和国内层面发展AI治理的各种途径描述了一个流动的治理空间,并具有建立联盟的范围,确定进步的机会,并对AI技术的发展做出明智的反应。如果给定的治理倡议拟合的情况取决于与AI风险或机会相关的功能,并且不同的机构,论坛或部门具有不同的比较优势。现在或确切地绘制景观为时过早,因为所涉及的节点和网络与技术一起广泛分布和迅速发展。展望未来,重点应该放在扩大这种分布的全球景观上,以确保以涉及提供有效成果的最多利益相关者的方式来实现国际AI治理职能。

The range of distributed AI governance forums across intergovernmental forums in various combinations, standards development organizations, and stakeholder groups remains a work in progress. More will be needed as issues that need international cooperation continue to expand, and the inclusivity of these AI governance forums will need to be both functionally appropriate and sufficient to achieve legitimacy. In particular, these dual needs will require building out G7 outcomes to a wider range of governments and additional stakeholders. The inclusion in the G7 of the African Union as a participant and of 56 governments from all continents in the Friends of the Hiroshima process are significant steps, but broader outreach is still needed.102Development of AI standards in global standards bodies is another area where expanding access to governments, industry, and civil society, especially in LMI countries, is needed to strengthen the legitimacy of these standards and ensure that the resulting standards respond to diverse AI needs.

As AI governance initiatives progress, networked and distributed governance will remain the singular form of international cooperation that can respond to the rapid pace at which AI is developing. While the future course of AI is uncertain, it is certain that AI models and applications will develop in ways that raise new challenges and opportunities. Such new developments will demand rapid iterative governance responses from ad-hoc coalitions of governments, industry, and civil society, just as the six-month span of response to the ChatGPT-3 produced the Hiroshima Process, the White House voluntary commitments on AI, the Bletchley Declaration, and codes of conduct implementing the Hiroshima Principles. Whatever impact DeepSeek has on how and where models are trained going forward, its development underscores that, for AI governance to be effective, it must adapt and respond to rapid and dazzling technological changes. Building and expanding an iterative and networked approach to AI governance will be key.

The Brookings Institution is committed to quality, independence, and impact.

We are supported by adiverse array of funders。In line with ourvalues and policies, each Brookings publication represents the sole views of its author(s).