Meta推出Llama 4型号,驾驶改进了AI性能

作者:By

梅塔(Meta)在其AI计划中迈出了又一步Llama 4 AI模型在测试中,事实证明,这几乎在所有战线上都比其竞争对手提供了更好的性能。

好吧,至少基于元选择释放的结果,但我们会做到这一点。

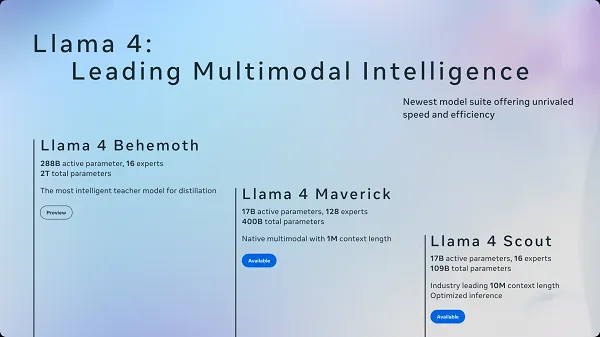

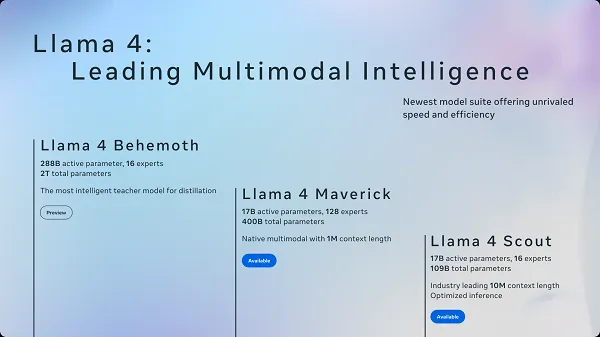

首先,梅塔(Meta)宣布了四个新型号,其中包括比以前的Llama模型更大的系统培训和参数推断。

Meta的四个(是的,四个,最后一个在此图像中没有特征)新的Llama模型是:

- Llama 4 Scout立即成为可用的最快的小型型号,并且已设计为在单个GPU上运行。Scout包括170亿参数和16位专家,使系统能够根据每个查询的性质优化其响应。

- Llama 4 Maverick还包括170亿个参数资源,但还包含128位专家。专家的使用意味着,仅针对每个查询激活总参数的一个子集,从而通过降低模型成本和延迟来提高模型效率。这意味着使用这些模型的开发人员可以通过较少的计算获得相似的结果。

- Llama 4庞然大物包含超过200万亿个参数,使其成为当前可用的最大系统。至少从理论上讲,这使得它具有更大的能力,能够通过高级学习和推理理解和回应查询。

- Llama 4推理是最终模型,Meta还没有共享许多信息。

这些模型中的每一个都有一个不同的目的,具有元释放的变量选项,可以使用较少或更强大的系统运行。因此,如果您想构建自己的AI系统,则可以使用Llama Scout,这是最小的模型,可以在单个GPU上运行。

那么,这在外行术语中意味着什么?

为了澄清,这些系统中的每一个都是建立在Meta开发团队为改善系统推理的一系列参数上建立的。这些参数不是数据集本身(这是语言模型),而是系统内置的控件和提示的量,以了解其所在的数据。

因此,理想情况下,具有170亿个参数的系统将具有比参数更少的系统更好的逻辑过程,因为它提出了有关每个查询的更多方面的问题,并基于该上下文响应。

例如,如果您有一个四个参数模型,它基本上会问'谁,什么,何时何地,每个其他参数都会添加越来越多的细微差别。作为一种比较,Google搜索使用了您输入的每个查询的200多个排名信号,以便为您提供更准确的结果。

因此,您可以想象一个170亿个参数过程将如何扩展。

Llama 4的参数是Meta先前模型范围的两倍以上。

进行比较:

因此,随着时间的流逝,您可以在更多的系统逻辑中构建Meta的构建,以提出更多问题,并进一步研究每个请求的上下文,然后还应根据此过程提供更相关,准确的回答。

同时,元专家是Llama 4中的一个新元素,并且是系统的控件,可以将这些参数中的哪一个(或不应用于每个查询)。这减少了计算时间,同时仍保持准确性,这应该确保使用Meta Llama模型的外部项目能够在较低的规格系统上运行它们。

因为从字面上看,没有人具有Meta在这方面所具有的能力。

元目前有周围350,000 NVIDIA H100芯片为其AI项目供电,随着它继续扩展其上网数据中心容量,虽然也是开发自己的AI芯片这种外观将进一步建立在此基础上。

据报道,Openai有大约在200k H100,而Xai的巨像超级中心目前正在运行200k H100芯片也是如此。

因此,Meta现在可能会以其竞争对手的能力增加两倍,尽管Google和Apple也在开发自己的方法。

但是,就有形的,可用的计算和资源而言,元很明显,其最新的庞然大物模型将在整体绩效方面将所有其他AI项目吹入水中。

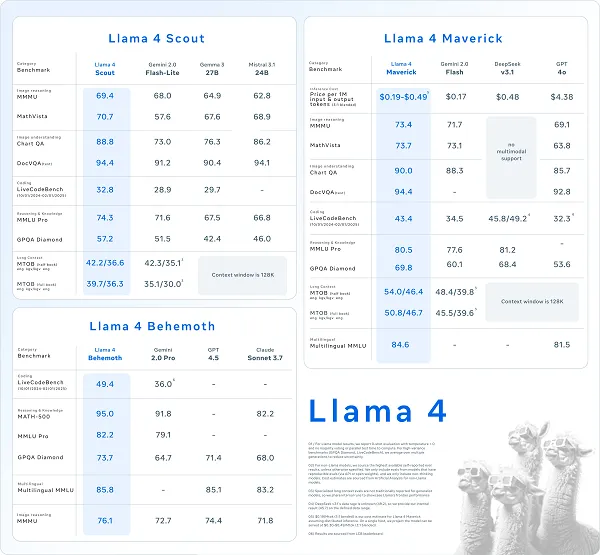

您可以看到主要AI项目之间比较性能的比较此图表, 尽管一些问题也提出了至于元测试过程的准确性和适用性,以及它选择与其Llama模型相比的基准。

这将是在测试中出现的,无论哪种方式,都值得注意的是,并非Llama 4产生的所有结果都像Meta所暗示的那样令人震惊。

但总的来说,在所有方面,它似乎都取得了更好的成绩,而元人士还说,较低的入口模型比竞争对手便宜,而且更好。

这很重要,因为Meta还将所有这些模型用于外部AI项目,这可以使第三方开发人员能够为各种目的构建新的专用AI模型。

无论哪种方式,这都是一个重大升级,它可以将Meta置于AI开发的顶部,同时使外部开发人员能够利用其Llama模型也使Meta成为许多AI项目的关键负载基础。

已经,LinkedIn和Pinterest是众多融合了元模型的系统,并且随着它继续构建更好的系统,似乎Meta在AI竞赛中赢得了胜利。因为所有这些系统都在这些模型上依赖,并且像它们一样,这增加了它们对元的依赖及其持续的美洲驼的依赖,从而为它们的演变提供动力。

但是,考虑到AI开发的复杂性以及运行此类过程所需的过程,很难简化这一点的相关性。

对于普通用户,此更新中最相关的部分将是Meta自己的AI聊天机器人和发电模型的性能得到改善。

Meta S还将其Llama 4型号集成到其应用内聊天机器人中,您可以通过Facebook,WhatsApp,Instagram和Messenger访问。更新的系统处理也将成为元广告定位模型,其广告生成系统,其算法模型等的一部分。

基本上,利用AI的元应用程序的每个方面现在都会在评估中使用更多逻辑参数,这将变得更聪明,这应该导致更准确的答案,更好的图像世代和改进的AD性能。

很难完全量化这将逐案的含义,因为个人结果可能会有所不同,但我建议考虑考虑元优势+广告选项作为一个实验,可以看到其性能变得多么出色。

Meta将在接下来的几周内整合其最新的Llama 4车型,此版本仍有更多的升级。