微软通过揭示其最新型号,PHI-4-REONING,PHI-4-ROSONING-PLUS和PHI-4-MINI-RENOSING,继续增加对话。”

Aiâ的新时代

一年前,微软介绍了小语言模型(SLM)向客户发布PHI-3在Azure AI铸造厂,利用对SLM的研究来扩展客户可用的高效AI模型和工具。

今天,我们很高兴介绍PHI-4-RENOSED,PHI-4-RONESTIN-RENISTIN-RENISTING和PHI-4-MINI-RENOSICT标记小语言模型的新时代,并再次重新定义了小小的和高效的AI的可能性。

推理模型,下一步向前推理模型

接受培训以利用推理时间缩放来执行需要多步分解和内部反射的复杂任务。它们在数学推理方面表现出色,并且正在成为具有复杂,多方面任务的代理应用程序的骨干。这种功能通常仅在大型边界模型中找到。PHI-Reoning模型引入了新的小语言模型。使用蒸馏,增强学习和高质量数据,这些模型平衡了尺寸和性能。它们足够小,适合低延迟环境,但保持强大的推理能力,以与更大的模型相匹配。这种混合物允许甚至资源有限的设备有效执行复杂的推理任务。

PHI-4-RONESTING和PHI-4-ROONING-PLUSâ PHI-4改良

是一个1,40亿个参数开放式推理模型,可与复杂的推理任务相匹配。Phi-4-Reason通过对Openai O3-Mini精心策划的推理演示进行了对PHI-4的监督微调培训,生成了详细的推理链,可有效利用额外的推理时间计算。该模型表明,细致的数据策展和高质量的合成数据集允许较小的模型与较大的同行竞争。

Phi-4-Reoning-plus建立在PHI-4发展功能的基础上,通过增强学习的进一步培训,以利用更多的推理时间计算,使用1.5倍的代币,而不是PHI-4-ROSONING,以提供更高的准确性。

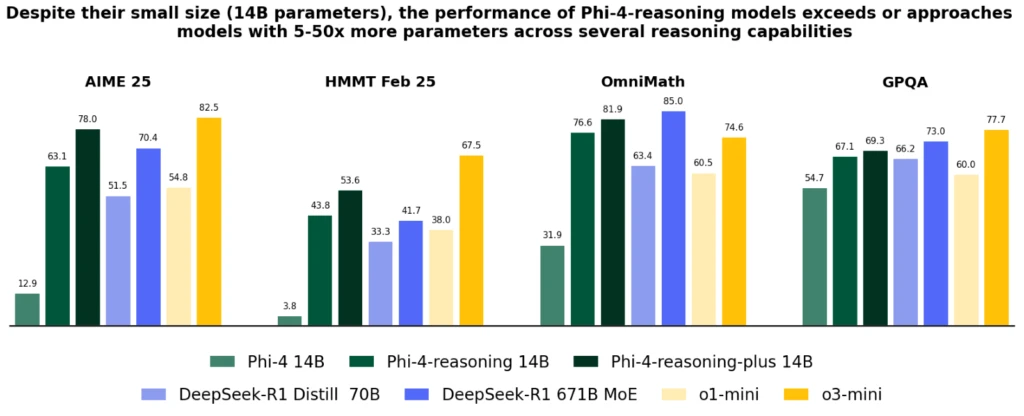

尽管大小的尺寸明显较小,但在大多数基准中,包括数学推理和博士学位的OpenAi O1-Mini和DeepSeek-R1-Distill-lalama-70B的性能都更好。水平科学问题。他们在AIME 2025测试(美国数学奥林匹克运动会的2025年预选赛)上,在AIME 2025测试中的完整DeepSeek-R1模型(具有671亿次参数)的性能更好。两种型号都可以在Azure AI铸造厂和拥抱面,这里和这里。

PHI-4反应模型在PHI-4上引入了较大的模型,超过了较大的模型,例如DeepSeek-R1-Distill-70B,并在各种推理和一般能力中进行了Deep-seek-R1,包括数学,编码,算法解决问题和计划。这技术报告通过各种推理任务提供了这些改进的广泛定量证据。

PHI-4-MINI-RENISINGPHI-4-MINI-RENISING

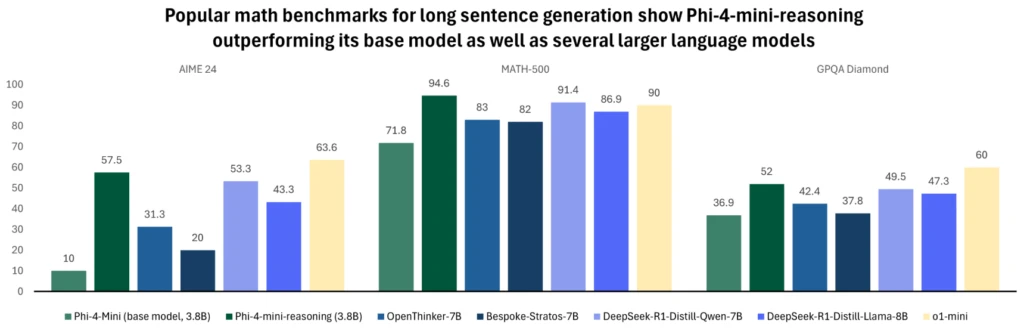

旨在满足对紧凑推理模型的需求。该基于变压器的语言模型已针对数学推理进行了优化,在具有约束的计算或延迟的环境中提供了高质量的逐步解决问题。通过DeepSeek-R1模型生成的合成数据进行了微调,PHI-4-MINI-RENOSINE-RONESINE衡量效率与先进的推理能力。它非常适合教育应用,跨越的辅导以及在边缘或移动系统上轻巧的部署,并接受了超过一百万种不同的数学问题,从中学到博士学位,这些数学问题跨越了多个级别的难度。级别。尝试模型Azure AI铸造厂或者拥抱面今天。

有关该模型的更多信息,请阅读该模型技术报告这提供了其他定量见解。

去年,菲的演变一直不断推动这一质量和尺寸的信封,扩大了家庭以满足各种需求的新功能。在Windows 11设备的规模上,这些模型可在CPU和GPU上本地运行。

随着Windows致力于创建新型的PC,PHI模型已成为副铜+ PC不可或缺的一部分Phi二氧化硅变体。这种高效且具有OS管理的PHI版本旨在预装在内存中,并提供大量的快速时间以首先令牌响应,并提供功率高效的令牌吞吐量,因此可以与PC上的其他应用程序同时调用。

它用于核心体验点击要做,为屏幕上的任何内容提供有用的文本智能工具,并且可作为开发人员API很容易整合到已在Outlook等几种生产力应用中使用的应用程序,并脱机提供了其副总结功能。这些小而强大的模型已经进行了优化和集成,可在我们的PC生态系统的几个应用中使用,以在我们的PC生态系统的整个广度上使用。npus。

安全和微软负责AI的方法

在微软,负责人AI是指导AI系统(包括我们的PHI模型)的开发和部署的基本原则。PHI模型是根据Microsoft AI原则开发的:问责制,透明,公平,可靠性和安全性,隐私,安全以及包容性。”

PHI模型家族采用了一种强大的安全后培训方法,利用了监督的微调(SFT),直接偏好优化(DPO)以及从人类反馈(RLHF)技术中学习的结合。这些方法利用了各种数据集,包括关注有用性和无害性的公开可用数据集,以及各种与安全有关的问题和答案。虽然PHI模型家族旨在有效执行各种任务,但必须承认所有AI模型都可能表现出局限性。为了更好地了解这些限制以及解决这些限制的措施,请参考下面的型号卡,该卡提供了有关负责的AI实践和指南的详细信息。

在这里了解更多信息:

- 尝试新型号Azure AI铸造厂。

- 阅读PHI食谱。

- 阅读边缘设备上的PHI推理模型。

- 了解更多有关PHI-4-MINI-RENISING。

- 了解更多有关PHI-4改良。

- 了解更多有关Phi-4-Reoning-plus。

- 阅读有关PHI推理的更多信息教育工作者开发人员博客。