Schneier警告说,AI由于公司偏见而失去诚信

RSAC公司AI模型已经偏向于服务于其制造商的利益,除非政府和学术界加紧建立透明替代方案,否则技术风险只是商业操纵的另一种工具。

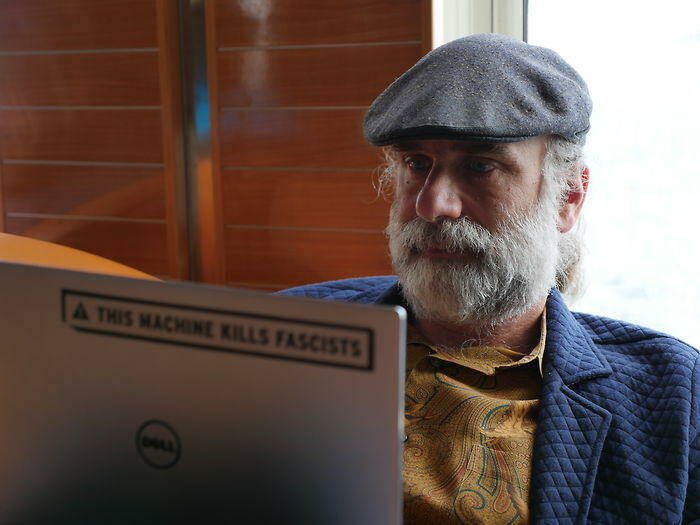

这是根据密码学和隐私专家布鲁斯·施尼尔(Bruce Schneier)的说法寄存器上周,在主题演讲之后RSA会议在旧金山。

他告诉我们:“我担心它会像搜索引擎一样,就像它们是中立的第三方一样,但实际上是在试图操纵您。他们试图让您访问广告客户的网站。”“这是我们真正需要思考的诚信,作为安全属性的完整性以及它如何与AI一起工作。”

在他的RSA主题演讲中,Schneier问:“您的聊天机器人是否推荐了特定的航空公司或酒店,因为这对您来说是最好的,还是由于AI公司从这些公司那里获得了回扣?”

为了应对这一难题,Schneier建议政府应该开始采取更加动手的立场来调节AI,迫使模型开发人员对他们收到的信息以及如何构思的决策方式更加开放。

他称赞欧盟AI法,指出它提供了一种随着技术发展而适应法律的机制,尽管他承认存在磨牙问题。该立法于2024年8月生效,根据AI系统的风险水平提出了分阶段要求。部署高风险AI的公司必须维护技术文档,进行风险评估,并确保围绕其模型的建立方式以及如何做出决定。

他认为,由于欧盟是世界上最大的交易集团,因此预计该法律将对任何想在那里开展业务的公司产生重大影响。这可能会将其他地区推向类似的法规,尽管他补充说,在美国,有意义的立法运动在当前政府下仍然不可能。

- 欧盟AI的行为仍处于婴儿期,但是那些具有“智能”人力资源应用程序的行为更好

- 美国参议员建议政府AI购买和运营的护栏

- 准备您的审核:欧盟委员会批准首次批准AI法案

- 人工智能大wigs敦促AGS阻止Openai的利润枢纽

Schneier指出,AI代理商中的偏见问题很难解决,这主要是因为用户通常更喜欢采用他们支持的系统。他举了一个为法官设计的AI代理的榜样 - 就像法官选择与自己的观点保持一致的法律书记员一样,他们可能会选择具有同样情况的数字助手。

他认为,解决此问题的关键是透明度,以便人们可以知道会发生什么。在这里,政府和学术界可以通过建立透明的AI模型来提供帮助,以对立商业系统。

我想我只想要非公司AI

他告诉我们:“我想我只想要非公司的AI。”“法国正在建立AI,对吗?建立一个非营利组织的AI。我想建立大学,以及您是否相信它们很复杂。您是否会相信中国政府AI?可能不是。”

法国计划于2025年2月启动时被称为当前AI,是一家公私合作伙伴,涉及法国政府,Salesforce,Google和几个慈善组织。

该倡议得到了4亿美元的合并资金支持,并得到了欧盟内部和外部的九个政府的支持。目的是促进开源基础架构的开发,改善对高质量数据集的访问权限,并支持以更大的透明度和问责制为公共利益服务的AI工具。

“当前的人工智能可以改变人工智能世界,”说当时法国总统伊曼纽尔·马克龙(Emmanuel Macron)。“通过为许多合作伙伴提供对数据,基础设施和计算能力的访问,目前的AI将有助于开发我们在法国和欧洲的AI生态系统,以公平透明的方式促进市场多样化,并在全球范围内促进创新。”

Schneier说,这样的模型是一个很好的前进道路,但是公司将与这种努力作斗争。Schneier说,尽管如此,它必须为消费者做,而立法者这次负担不起。

他断言:“我们在社交媒体上失败了。我们在搜索方面失败了,但是我们可以用AI做到这一点。”“这是技术和政策的结合。”®