AI使用损害专业声誉,研究表明

根据杜克大学的新研究,使用AI可以是双刃剑。尽管生成的AI工具可能会提高某些人的生产力,但它们也可能秘密损害您的专业声誉。

星期四,美国国家科学院(PNAS)的会议记录出版一项研究表明,使用AI工具的员工chatgpt,,,,克劳德, 和双子座在工作中,他们对同事和经理的能力和动力面临负面判断。

“我们的发现揭示了考虑采用AI工具的人们的困境:尽管AI可以提高生产力,但其使用却带来了社会成本,”研究人员写道杰西卡·雷夫(Jessica A. Reif),,,,理查德·拉里克(Richard P. Larrick), 和杰克·B·索尔杜克大学的富夸商学院。

杜克队对4,400多名参与者进行了四项实验,以检查对AI工具用户的预期和实际评估。他们的发现在题为“使用AI的社会评估罚款的证据”的论文中揭示了对从AI获得帮助的人的偏见。

对于研究人员而言,尤其是对研究人员的惩罚的是,其在人口统计学方面的一致性。他们发现,针对人工智能使用的社会污名不仅限于特定群体。

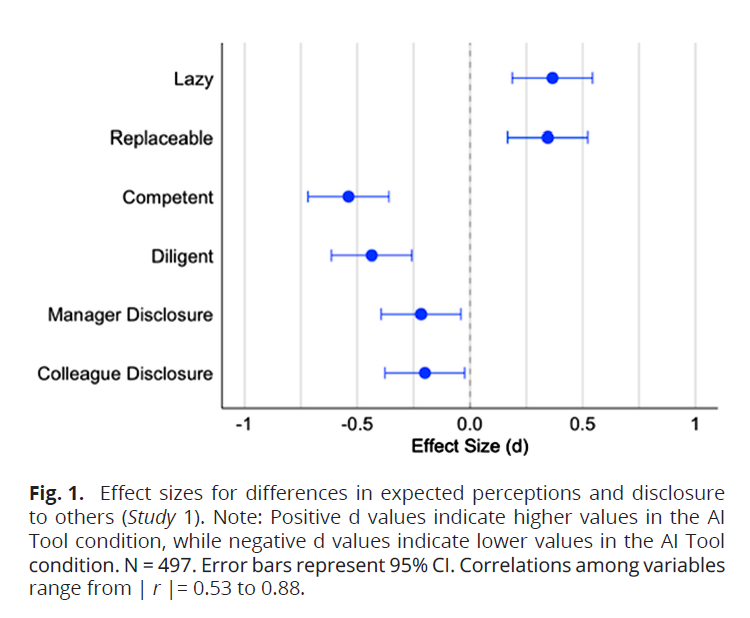

图1来自“使用AI的社会评估罚款的证据”。信用:Reif等。

作者在本文中写道:“测试广泛的刺激使我们能够检查目标的年龄,性别或职业是否有资格从AL接受这些评估的帮助的效果。”“我们发现,这些目标人群属性都不会影响接受AL帮助对懒惰,勤奋,能力,独立性或自我保证的感知的影响。这表明AI使用的社会污名不限于在特定人群中使用。结果似乎是一般的人。”

AI采用的隐藏社会成本

在杜克(Duke)团队进行的第一个实验中,参与者想像使用AI工具或工作仪表板创建工具的参与者。它表明,与使用常规技术的人相比,AI集团中的人们预计将被判断为懒惰,胜利,勤奋降低,更可靠的人。他们还报告说,向同事和经理透露其AI使用的意愿较少。

第二个实验证实了这些恐惧是合理的。在评估员工的描述时,参与者一致地将接受AI帮助的人评为懒惰,胜任,少勤奋,独立和自我保证的人比从非ai来源获得类似帮助的人或根本没有帮助。