人工智能综合视频分析船只区域变化和微度外科技能评估的仪器运动

作者:Fujimura, Miki

介绍

外科医生的技术水平至关重要,并且与术后不良事件,发病率和死亡率有关1,,,,2。在颅外颅(EC-IC)旁路手术中,脑动脉的脆弱性需要先进的显微外科技能才能实现受体和供体动脉之间的完全直接近似3,,,,4,,,,5。这种苛刻的技术需要精确的仪器处理,平稳有效的运动以及轻柔的组织操纵,以防止容器壁眼泪6,,,,7。对微观外科技能的全面,客观的评估提供了一种可靠的手段,可以通过建设性的反馈来识别手术学员的缺陷,并验证外科医生的能力,最终提高了患者的安全性8。

传统上,微手术技能评估依赖于大师外科医生的主观评估9。尽管已经开发了各种基于标准的评分系统来降低主观性,但它们需要大量的人类和时间资源,使实时反馈不切实际10,,,,11,,,,12,,,,13。已经探索了定量方法,例如固定在手术仪器上的力和运动传感器14,,,,15,,,,16;但是,他们对专业传感器和设备的依赖限制了其广泛采用,并引起了人们对概括性和可重复性的担忧17,,,,18。

随着手术视频记录的供应越来越多,视频分析正在获得各种过程的技能评估的吸引力19,,,,20,,,,21。人工智能(AI)驱动的视频分析也日益应用于手术技能评估22,,,,23。在这一趋势的基础上,我们以前开发了两个用于评估微血管吻合性能的AI模型:一种结合语义分割算法以评估血管区域(VA)的变化24另一种使用对象检测算法来分析手术仪器尖端运动25。

这项研究检查了结合这些AI模型是否提高了外科医生绩效评估的准确性,并确定了微表外技能的哪些方面与AI衍生参数相关。

方法

合并的AI模型

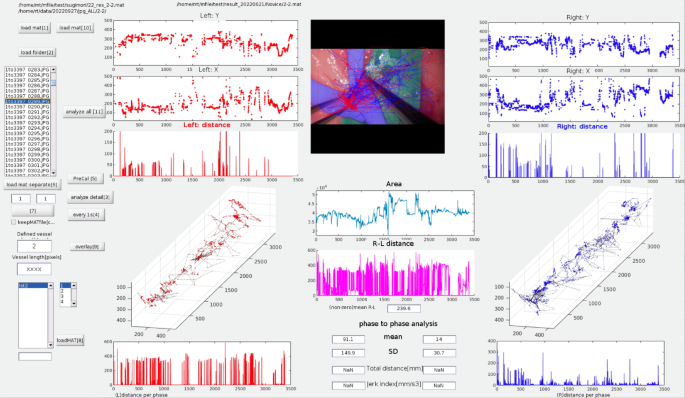

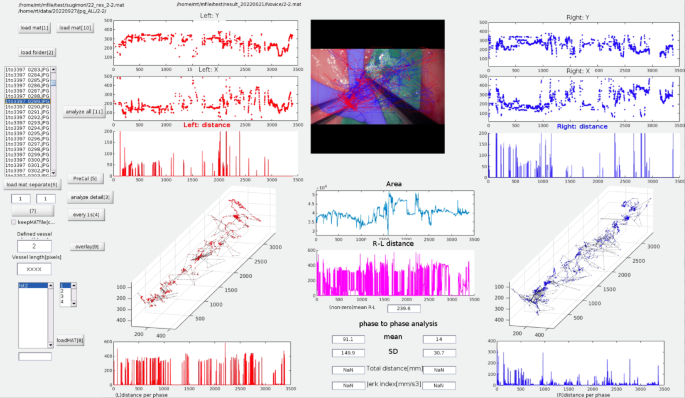

如前所述开发了两个AI模型:VA的语义分割算法和仪器尖端的轨迹跟踪算法24,,,,25。这些模型基于剩余网络50(Resnet-50),您只能看一次版本2(Yolov2),该版本是在临床微外科视频和微血管吻合术实践视频中接受培训的。

Resnet-50是一个50层深度卷积神经网络,它利用残留学习,实现非常深的体系结构的培训,并广泛应用于医学成像中的分割和分类等任务26。Yolov2是一种实时,深度学习的对象检测算法,旨在在单个通行证中快速准确地检测对象。它将输入图像划分为网格,并同时预测每个网格单元中存在物体的存在,使其非常适合高速实时应用,例如用于检测人员和车辆的监视系统,并识别医学图像中的解剖结构27。两种模型均在MATLAB(Mathworks,Natick,MA,美国,美国)实施。每个模型的详细培训程序可以在我们以前的研究中找到24,,,,25。

这些模型的准确性是通过在0.93的联合和平均骰子相似性系数为0.87的相交来确保的。24,,,,25。我们集成了两个AI模型,以全面分析微手术性能,如图所示。 1。

参与者

这项研究遵守了赫尔辛基的乡绅指南和声明。这项研究是在北海道大学医院(No. 018-0291)的机构批准下进行的。由于我们的设施定期举办了用于教育目的的室外微血管吻合术培训课程,因此从这些课程中招募了包括教练和学员在内的外科医生参与者。从研究生年(PGY)1到28岁的14名具有不同水平的显微外科经验的外科医生参加了实验手术性能分析。桌子1总结参与外科医生的特征。所有参与者都是右手的。

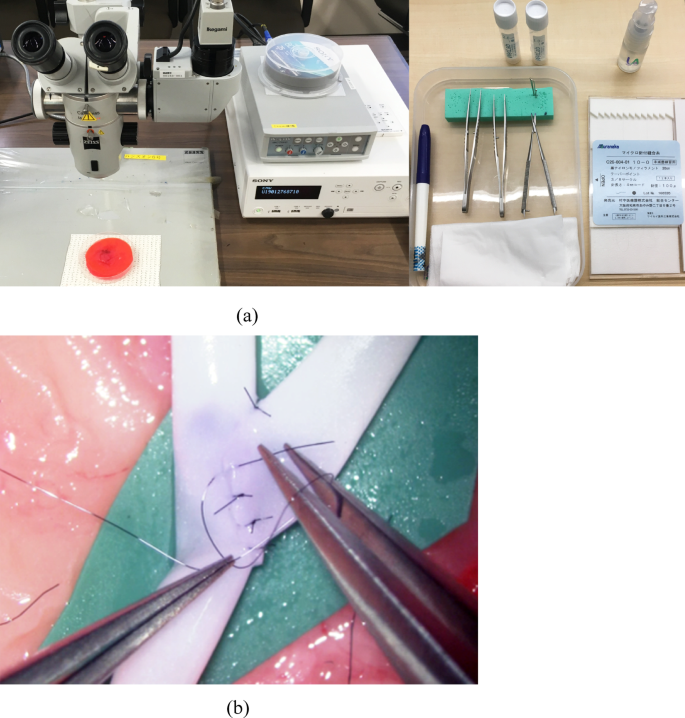

显微外科任务

两位外科医生都被分配在端到一侧吻合术后使用人造血管(2.0毫米血管模型,Wetlab Incorporated,Shiga,日本)和10-0尼龙单丝线(C26-004-01)(C26-004-01)(C26-004-01),Muranaka Medical Instrument co.,ltd co.,ltd co.,OSAKA,OSAKA,OSAKA),在端到吻合中进行中断缝合。(图 2)。为了标准化吻合程序并最大程度地减少程序性变异性,诸如稳定两个容器,切割供体动脉,对受体血管进行动脉切开术以及准备两种停留缝合线等任务,并由一位教练进行了确认。手术试验被定义为单个缝合过程的完成,由四个阶段组成:A期,抓握和插入针头;B期推动和提取针;C阶段,将螺纹拉到第一个结;和D期,绑三个结并切割线25。为了最大程度地减少重复试验的学习效果,只选择了每个外科医生的前两个试验进行绩效评估。

基于标准的客观评估

斯坦福大学微型外科和居民培训量表用于评估每个外科医生的表现10,,,,11。该评级量表包括九种技术类别:(1)仪器处理,(2)尊重组织,(3)效率,(4)缝合处理,(5)缝合技术,(6)结的质量,(7)最终产品,(8)操作流量,(9)整体性能。三名专家以盲目的方式对所有技术类别的所有外科医生的表现分别以1到5的比例评分,以确保参与者的身份仍然被隐藏起来。在三个评估者中平均的前两个试验的得分被用作每个外科医生的代表分数。

双重AI模型的视频参数

桌子2介绍组合AI模型生成的参数。这些包括所有测得的VA值(CV-VA)的变化系数(CV),VA随时间的相对变化(VA),步骤(Max-îVA)中VA的最大绝对值(Max-îVA),组织变形误差的数量(TDE)的次数(pd)的左路(PD),左和左派(pd),左和左右(pd),以及左右的PISP,左右的级别,和左右的级别,和左侧的级别,和左右的级别,以及右派的plys,左右的级别,电压,电压(pd)。镊子提示24,,,,25。由于所有外科医生在所有试验中的平均值1.96 – 1.96 - 在先前的研究中均计算为1.13,因此该阈值用于TDE的定义。24。

我们分析了所有外科医生试验的视频,并计算了每个参数。前两个试验的平均值用作每个外科医生的代表性参数。

统计分析

结果表示为平均标准偏差。使用Cronbach的三个评估者中的Cronbach S±系数评估了基于标准的客观评级量表的间可靠性。使用Spearman的等级相关系数(!)分析了基于AI的参数与评级量表的每个类别之间的相关性。

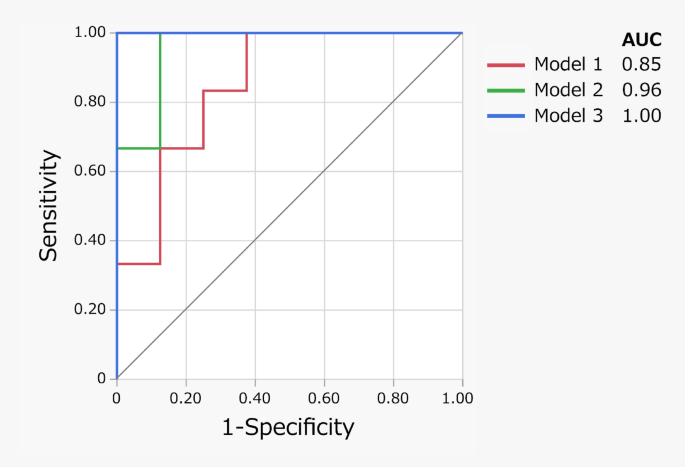

为了评估每个AI模型参数的判别能力,我们进行了判别分析好的-和绩效不佳根据基于标准的评级量表得分分配的组。对于每个AI模型,我们选择了显示出显着相关性的参数(p<0.05)具有最多的技术类别,并将其包括在判别分析中(模型1和2)。最后,为了评估两个AI模型的合并使用,模型1和2的所有参数都包含在判别分析中(模型3)。

使用JMP Pro(版本17.0.0; SAS Institute Inc.,美国北卡罗来纳州卡里)进行统计分析。统计显着性设定为p<0.05。结果

基于标准的规模

通过Cronbach s±系数为0.88 0.97(补充表),确认了基于标准的评分量表的高率可靠性(补充表

1)。桌子中提供了每个外科医生的原始标准量表分数1并在补充表中进行详细说明2。

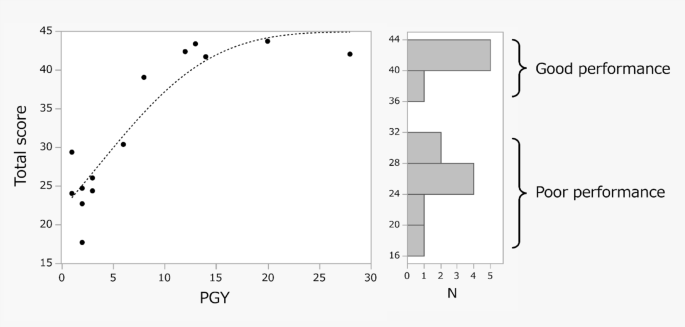

基于标准的评分量表的总分数与外科医生的经验显着相关(图 3)。由于14位外科医生的基于标准的评分量表的总分数表现出双峰分布,因此得分超过35分的表现被认为是好的,而得分低于35的试验被认为是贫穷的(图 3)。

基于AI和基于标准的性能分析之间的相关性

补充表3为每个外科医生提供AI衍生的性能参数。桌子3提出p - 来自Spearman的等级相关分析和补充表的价值4提供Spearman的等级相关系数(!)。表3 Spearman的等级相关分析(p

尽管所有阶段的CV-VA和Max-va均未显示与技术类别的显着相关性,但B期VA的Max-va与仪器的处理和对组织的尊重显着相关。因此,对于后续的判别分析,将C阶段C和Max-va的TDE编号包括在模型1和3中。

所有阶段的右镊子(RT-PD)和左镊子(LT-NJI)的NJI的PD与几乎所有性能类别都显着相关。所有阶段的正确镊子的NJI(RT-NJI)与五个技术类别显着相关,而C期和D期的RT-NJI与七个类别显着相关。左镊子(LT-PD)的PD与效率,缝合处理,缝合技术和操作流程显着相关。因此,对于随后的判别分析,将所有阶段的RT-PD,LT-PD和LT-NJI和C阶段C的RT-NJI包括在模型2和3中。

每个模型的歧视能力以进行手术性能

补充表5提供模型1的判别功能。

用于区分模型1的接收器操作特性(ROC)曲线好的和性能不佳如图所示 4。模型1和2的AUC值分别为0.85(95%置信区间[CI]:0.53 - 0.97)和0.96(95%CI:0.67 1.00)。模型3证明了最高的AUC值为1.00。

讨论

我们采用了基于AI的组合视频分析方法来通过整合VA变化和仪器运动来评估微血管吻合性能。通过将技术类别分数与AI生成的参数进行比较,我们证明了两个AI模型的参数涵盖了微血管吻合所需的广泛的技术技能。此外,ROC曲线分析表明,与使用单个AI模型相比,从两个AI模型中进行集成参数提高了手术性能的能力。这项研究的一个独特特征是整合了多种AI模型,这些AI模型既包含工具和组织元素。

基于AI的技术分析方法

多个盲人专家外科医师基于标准的评分是一种高度可靠的方法,可用于评估外科医生的性能,并以最小的间偏见评估(图。 2和补充表1)。但是,对人类专业知识和时间的重大需求使得实时反馈在手术和培训期间不切实际10,,,,11,,,,18。最近的一项研究表明,与传统教师主导的培训相比28。但是,在迈向更高级的技能水平和实际临床实践时,教师的直接反馈继续发挥着关键作用。

AI技术可以迅速分析现代运营剧院中产生的大量临床数据,并提供实时反馈功能。提出的方法依赖手术视频分析使其非常适用于临床环境18。此外,本研究中使用AI的方式解决了有关透明度,解释性和可解释性的担忧,这是与AI采用相关的基本风险。一个预期的应用程序是AI辅助设备,可以迅速提供有关技术挑战的反馈,使学员可以更有效地完善其手术技能29,,,,30。此外,对显微外科技能的客观评估可以促进医学界内的外科医生认证和证书过程。

从理论上讲,这种方法可以帮助实现实时警告系统,在仪器运动或组织变形超过预定义的安全阈值时提醒外科医生或其他人员17,,,,31。但是,需要大量涉及不良事件的临床病例数据集,例如血管损伤,旁路阻塞和缺血性中风。对于实时临床应用,需要进一步的数据收集和计算优化来减少处理延迟并增强实际可用性。鉴于我们的AI模型可以应用于临床外科视频,因此未来的研究可以在这种情况下探索其效用。

相关作品:AI集成仪器跟踪

为了使我们的结果与之相关,我们将我们的AI集成方法与在微手术实践中实施仪器跟踪的最新方法进行了比较。Franco-Gonzâlez等。将基于立体标记的跟踪与基于Yolov8的深度学习方法进行了比较,报告了高精度和实时能力32。同样,Magro等。提出了一个强大的双仪器Kalman基于Kalman的跟踪器,有效地减轻了由于遮挡或运动模糊而导致的跟踪错误33。Koskinen等。利用Yolov5进行微型外科仪器的实时跟踪,证明了其在监测仪器运动学和眼手协调方面的有效性34。

我们的集成AI模型采用语义分割(RESNET-50)进行血管变形分析和轨迹跟踪算法(Yolov2)来评估仪器运动。我们方法的主要优点是它对组织变形和仪器处理平稳性的全面和同时评估,即使在有挑战性的条件下,例如可变照明和部分遮挡,也可以实现稳健和客观的技能评估。由于其在实时对象检测中的计算速度和精度,因此选择了Yolo,因此特别适合实时微型视频分析。选择Resnet在详细的图像分割中的有效性,从而促进了组织变形的准确定量。但是,与三维(3D)跟踪方法不同32,我们当前的方法仅依赖于2D成像,潜在地限制了深度感知精度。

这些比较强调了我们方法的优势和局限性,强调了未来的研究的必要性,并结合了3D跟踪技术和扩展的数据集,以进一步验证和完善AI驱动的微表外技能评估方法。

未来的挑战

微血管吻合任务通常由不同的阶段组成,包括船只制备,针头插入,缝合位置,螺纹拉拉和结束。正如我们在每个手术阶段(阶段A d)的视频参数所证明的那样,对每个手术阶段的单独分析对于提高技能评估和训练效率至关重要。但是,我们当前的AI模型没有能力自动区分这些手术阶段。

使用卷积神经网络(CNN)和复发性神经网络(RNN)的先前研究表明,在识别手术阶段和步骤方面表现出很高的精度,尤其是通过分析术中视频数据35,,,,36。可汗等人。尽管手术程序和视频外观显着差异,但成功地应用了CNN-RNN模型合并的CNN-RNN模型,以实现对内窥镜垂体手术期间手术工作流程的准确自动识别35。同样,前庭造型术手术中的自动手术阶段和步骤识别进一步突出了这些模型处理复杂而冗长的手术任务的能力36。可以将这种方法集成到我们当前的AI框架中,以分割并单独评估微血管吻合的每个不同阶段,从而实现详细的性能分析和精确的反馈。

此外,建立视频录制的全球标准对于在手术环境中广泛实施和增强计算机视觉技术至关重要。制定针对视频记录的指南,标准化分辨率,框架速率,摄像头,照明和手术场覆盖范围可以大大减少由阴影或仪器阻塞引起的算法错误分类问题18,,,,37。这种标准化确保了一致的数据质量,对于培训准确且广泛适用的AI模型至关重要37。这些准则将促进大规模的数据共享和协作,从而大大提高了全球基于AI的手术评估工具的可靠性和有效性。

技术考虑

语义分割AI模型旨在评估针头操纵过程中对组织的尊重24。正如预期的那样,最大VA与B期(从针插入到提取)中的组织有关。适当的针提取需要遵循其自然曲线,以免撕裂容器墙6,,,,7,这些参数很好地捕获了这些技术细微差别。此外,TDE的数字与C相对于组织的相关,表明即使在拉螺纹的过程中,外科医生也必须谨慎行事以防止螺纹引起的容器壁损伤6,,,,7。这些参数还与仪器处理,效率,缝合技术和整体性能相关,因为正确的仪器处理和缝合技术是尊重组织的基础。因此,技术类别相互关联且相互影响。

轨迹跟踪AI模型旨在评估运动经济和外科仪器运动的平稳性25。运动经济可以在过程中由PD代表。经常使用基于混蛋的指标评估运动的平稳性和协调,其中混蛋被定义为加速度的时间导数。由于这些混蛋索引都受到运动持续时间和振幅的影响,因此我们使用了NJI,最初是由Flash和Hogan提出的38。通过将混蛋索引乘以[(持续时间间隔)来计算NJI5/(路径长度)2],较低的值表示移动更顺畅。无量纲的NJI已被用作定量度量标准,以评估各种情况下的运动不规则,例如咀嚼过程中的下颌运动39,,,,40,腹腔镜技能41和微手术技能16,,,,25。在这项研究中,RT-PD和LT-NJI与广泛的技术类别相关。尽管在微血管吻合术中起着独特的作用,但协调的双人操作对于最佳手术性能至关重要6,,,,7。关于RT-NJI,这些趋势在C阶段C和D中尤为明显,强调了运动平滑度在螺纹拉伸和打结中的重要性,并在确定整体手术能力方面。

总体而言,整合这些参数可以对复杂的显微外科技能进行全面评估,因为每个参数都捕获了不同的技术方面。尽管具有有效性,但该模型在区分之间仍然表现出一定程度的错误分类好的和性能不佳。值得注意的是,程序时间是手术表现的关键决定因素24,,,,25被故意排除在分析之外。尽管对其他参数的进一步探索仍然是必不可少的,但是整合程序时间可以显着提高分类准确性。

这项研究采用了斯坦福显微外科和居民培训量表10,,,,11作为基于标准的客观评估工具,它涵盖了广泛的显微外科技术方面。未来的研究结合了泄漏测试或吻合失误指数13确定了十种不同类型的吻合错误,可以为最终产品质量与各种技术因素之间的关系提供更深入的见解。

限制

如上所述,这种分析方法的基本技术局限性是缺乏3D运动学数据,尤其是在没有深度信息的情况下。另一个约束是,当手术工具不在显微镜外部视野之外时,无法捕获手术仪器的运动学数据25。此外,语义分割模型偶尔会误分类图像,这些图像包含手术仪器或手中的阴影24。为了减轻此问题,未来的研究应扩展培训数据集以包括阴影图像,从而改善模型的鲁棒性。鉴于本研究中的AI模型利用了Resnet-50和Yolov2网络,因此有必要进行进一步的研究以优化网络体系结构选择。探索替代性深度学习模型或微调现有架构可以进一步提高外科视频分析的准确性和概括性18。

关于参与外科医生的数量,我们的研究的样本量相对较小,尽管它包括具有多种技能的外科医生。此外,我们没有评估重复培训课程的数据以估计学习曲线或确定反馈是否可以提高训练功效。未来的研究应评估AI辅助反馈对手术学员学习曲线的影响,并评估实时绩效跟踪是否会导致更有效的技能获取。

结论

结合AI的视频分析方法结合了VA变化和仪器运动有效地捕获了广泛的微型技术技能,并评估了微血管吻合性能。此外,这种方法高度适应临床应用,可以推进计算机辅助的手术教育,并有助于改善患者安全。

数据可用性

由于隐私和道德限制,数据集无法公开可用。根据合理的要求,可以从通讯作者获得支持本研究发现的数据和材料。

参考

Birkmeyer,J。D。等。减肥手术后的手术技能和并发症率。N. Engl。J. Med。 369,1434年1442(2013)。

CAS一个 PubMed一个 Google Scholar一个

Fecso,A。B.,Szasz,P.,Kerezov,G。和Grantcharov,T。P.技术表现对手术患者结局的影响。安。外科。 265,492 - 501(2017)。

PubMed一个 Google Scholar一个

Rashad,S.,Fujimura,M.,Niizuma,K.,Endo,H。&Tominaga,T。通过通过直接直接直接间接血运重建手术治疗的儿科莫亚马亚病的长期随访:单一研究所的经验,具有手术和围手术管理的经验。Neurosurg。修订版 39,615â623(2016)。

PubMed一个 Google Scholar一个

Matsuo,M。等。因粘膜周围基质改变而导致的剪切应激的脆弱性是Moyamoya病的关键特征。科学。代表。 11,1 12(2021)。

Fujimura,M。&Tominaga,T。Moyamoya病的流动副本旁路。J. Neurosurg。科学。 65,277 286(2021)。

PubMed一个 Google Scholar一个

Villanueva,P。J。等。使用工程方法(Kaizen和Micromovements Science)来改善并提供有关微型手术手技能的证据。世界神经外科。 189, e380–e390 (2024).

PubMed一个 Google Scholar一个

Sugiyama, T.Mastering Intracranial Microvascular Anastomoses-Basic Techniques and Surgical Pearls。(MEDICUS SHUPPAN, Publishers Co., Ltd, 2017).

Sugiyama, T. et al.Forces of tool-tissue interaction to assess surgical skill level.JAMA Surg. 153, 234–242 (2018).

PubMed一个 Google Scholar一个

Reznick, R. K. Teaching and testing technical skills.是。J. Surg。 165, 358–361 (1993).

CAS一个 PubMed一个 Google Scholar一个

McGoldrick, R. B. et al.Motion analysis for microsurgical training: Objective measures of dexterity, economy of movement, and ability.塑料。Reconstr.Surg. 136, 231e–240e (2015).

CAS一个 PubMed一个 Google Scholar一个

Satterwhite, T. et al.The stanford microsurgery and resident training (SMaRT) scale: Validation of an on-line global rating scale for technical assessment.安。塑料。Surg. 72, S84–S88 (2014).

CAS一个 PubMed一个 Google Scholar一个

Zammar, S. G. et al.The cognitive and technical skills impact of the congress of neurological surgeons simulation curriculum on neurosurgical trainees at the 2013 neurological society of India meeting.World Neurosurg. 83, 419–423 (2015).

PubMed一个 Google Scholar一个

Ghanem, A. M., Al Omran, Y., Shatta, B., Kim, E. & Myers, S. Anastomosis lapse index (ALI): A validated end product assessment tool for simulation microsurgery training.J. Reconstr.Microsurg. 32, 233–241 (2016).

PubMed一个 Google Scholar一个

Harada, K. et al.Assessing microneurosurgical skill with medico-engineering technology.World Neurosurg. 84, 964–971 (2015).

PubMed一个 Google Scholar一个

Sugiyama, T., Gan, L. S., Zareinia, K., Lama, S. & Sutherland, G. R. Tool-tissue interaction forces in brain arteriovenous malformation surgery.World Neurosurg. 102, 221–228 (2017).

PubMed一个 Google Scholar一个

Ghasemloonia, A. et al.Surgical skill assessment using motion quality and smoothness.J. Surg。Educ. 74, 295–305 (2017).

PubMed一个 Google Scholar一个

Sugiyama, T. et al.Tissue acceleration as a novel metric for surgical performance during carotid endarterectomy.Oper.Neurosurg。 25, 343–352 (2023).

PubMed一个 Google Scholar一个

Sugiyama, T., Sugimori, H., Tang, M. & Fujimura, M. Artificial intelligence for patient safety and surgical education in neurosurgery.JMA J. 8, 76–85 (2024).

Sarkiss, C. A. et al.Neurosurgical skills assessment: Measuring technical proficiency in neurosurgery residents through intraoperative video evaluations.World Neurosurg. 89, 1–8 (2016).

PubMed一个 Google Scholar一个

Davids, J. et al.Automated vision-based microsurgical skill analysis in neurosurgery using deep learning: Development and preclinical validation.World Neurosurg. 149, e669–e686 (2021).

PubMed一个 Google Scholar一个

Sugiyama, T. et al.A pilot study on measuring tissue motion during carotid surgery using video-based analyses for the objective assessment of surgical performance.World J. Surg. 43, 2309–2319 (2019).

PubMed一个 Google Scholar一个

Sugimori, H., Sugiyama, T., Nakayama, N., Yamashita, A. & Ogasawara, K. Development of a deep learning-based algorithm to detect the distal end of a surgical instrument.应用。科学。 10, 4245 (2020).

CAS一个 Google Scholar一个

Khalid, S., Goldenberg, M., Grantcharov, T., Taati, B. & Rudzicz, F. Evaluation of deep learning models for identifying surgical actions and measuring performance.JAMA Netw.打开 3, e201664 (2020).

Tang, M. et al.Assessment of changes in vessel area during needle manipulation in microvascular anastomosis using a deep learning-based semantic segmentation algorithm: A pilot study.Neurosurg。修订版 47, 200 (2024).

PubMed一个 Google Scholar一个

Sugiyama, T. et al.Deep learning-based video-analysis of instrument motion in microvascular anastomosis training.Acta Neurochir.(Wien). 166, 6 (2024).

PubMed一个 Google Scholar一个

He, K., Zhang, X., Ren, S. & Sun, J. Deep residual learning for image recognition.在:Proceedings of the IEEE Computer Society Conference on Computer Vision and Pattern Recognition770–778 (2016).https://doi.org/10.1109/CVPR.2016.90。Redmon, J., Divvala, S., Girshick, R. & Farhadi, A. You only look once: Unified, real-time object detection.

在:Proceedings of the IEEE Computer Society Conference on Computer Vision and Pattern Recognition779–788 (2016).https://doi.org/10.1109/CVPR.2016.91。DÄ…browski, F. et al.

Video-based microsurgical education versus stationary basic microsurgical course: A noninferiority randomized controlled study.J. Reconstr.Microsurg. 38, 585–592 (2022).

PubMed一个 Google Scholar一个

Baghdadi, A. et al.A data-driven performance dashboard for surgical dissection.科学。Rep. 11, 15013 (2021).

CAS一个 PubMed一个 PubMed Central一个 Google Scholar一个

Baghdadi, A., Lama, S., Singh, R. & Sutherland, G. R. Tool-tissue force segmentation and pattern recognition for evaluating neurosurgical performance.科学。Rep. 13, 9591 (2023).

广告一个 CAS一个 PubMed一个 PubMed Central一个 Google Scholar一个

Curtis, N. J. et al.Clinical evaluation of intraoperative near misses in laparoscopic rectal cancer surgery.安。Surg. 273, 778–784 (2021).

PubMed一个 Google Scholar一个

Franco-González, I. T., Lappalainen, N. & Bednarik, R. Tracking 3D motion of instruments in microsurgery: A comparative study of stereoscopic marker-based vs. deep learning method for objective analysis of surgical skills.Informat.医学解锁 51, 101593 (2024).

Magro, M., Covallero, N., Gambaro, E., Ruffaldi, E. & De Momi, E. A dual-instrument Kalman-based tracker to enhance robustness of microsurgical tools tracking.int。J. Comput。协助。Radiol.Surg. 19, 2351–2362 (2024).

Koskinen, J., Torkamani-Azar, M., Hussein, A., Huotarinen, A. & Bednarik, R. Automated tool detection with deep learning for monitoring kinematics and eye-hand coordination in microsurgery.计算。生物。医学 141, 105121 (2022).

PubMed一个 Google Scholar一个

Khan, D. Z. et al.Automated operative workflow analysis of endoscopic pituitary surgery using machine learning: Development and preclinical evaluation (IDEAL stage 0).J. Neurosurg。 137, 51–58 (2022).

PubMed一个 Google Scholar一个

Williams, S. C. et al.Automated operative phase and step recognition in vestibular schwannoma surgery: Development and preclinical evaluation of a deep learning neural network (IDEAL Stage 0).Neurosurgery https://doi.org/10.1227/neu.0000000000003466(2025)。

文章一个 PubMed一个 Google Scholar一个

Garrow, C. R. et al.Machine learning for surgical phase recognition: A systematic review.安。Surg. 273, 684–693 (2021).

PubMed一个 Google Scholar一个

Flash, T. & Hogan, N. The coordination of arm movements: An experimentally confirmed mathematical model.J. Neurosci. 5, 1688–1703 (1985).

CAS一个 PubMed一个 PubMed Central一个 Google Scholar一个

Yashiro, K., Yamauchi, T., Fujii, M. & Takada, K. Smoothness of human jaw movement during chewing.J. Dent.res。 78, 1662–1668 (1999).

CAS一个 PubMed一个 Google Scholar一个

Takada, K., Yashiro, K. & Takagi, M. Reliability and sensitivity of jerk-cost measurement for evaluating irregularity of chewing jaw movements.生理学。Meas. 27, 609–622 (2006).

PubMed一个 Google Scholar一个

Chmarra, M. K., Kolkman, W., Jansen, F. W., Grimbergen, C. A. & Dankelman, J. The influence of experience and camera holding on laparoscopic instrument movements measured with the TrEndo tracking system.Surg.Endosc. 21, 2069–2075 (2007).

CAS一个 PubMed一个 Google Scholar一个

致谢

We would like to thank Yasuhiro Ito, Haruto Uchino, Masayuki Gekka, Masaki Ito, and Katsuhiko Ogasawara together with the Hokkaido University Neurosurgery Residency Program, for their participation in this study.We thank Masaki Mizuhara (Integra Japan Co., Ltd.), Kazuhiro Goto (Zeiss Japan Co., Ltd.), and Shusaku Tsutsui (Johnson & Johnson Inc.) for their support in organizing microvascular hands-on training courses.We thank Editage (www. editage.com) for English language editing.

资金

This work was supported by JSPS KAKENHI (grant number JP21K09091 and JP24K15785).

道德声明

竞争利益

作者没有宣称没有竞争利益。

道德认可

This study was approved by the Institutional Review Board of Hokkaido University Hospital (No. 018-0291), Sapporo, Japan.

Consent to participate

Informed consent was obtained from all the participants included in this study.

附加信息

Publisher’s note

Springer Nature remains neutral with regard to jurisdictional claims in published maps and institutional affiliations.

补充信息

Below is the link to the electronic supplementary material.

权利和权限

开放访问This article is licensed under a Creative Commons Attribution 4.0 International License, which permits use, sharing, adaptation, distribution and reproduction in any medium or format, as long as you give appropriate credit to the original author(s) and the source, provide a link to the Creative Commons licence, and indicate if changes were made.The images or other third party material in this article are included in the article’s Creative Commons licence, unless indicated otherwise in a credit line to the material.If material is not included in the article’s Creative Commons licence and your intended use is not permitted by statutory regulation or exceeds the permitted use, you will need to obtain permission directly from the copyright holder.To view a copy of this licence, visithttp://creativecommons.org/licenses/by/4.0/。Reprints and permissions

引用本文

Sugiyama, T., Tang, M., Sugimori, H.

等。Artificial intelligence-integrated video analysis of vessel area changes and instrument motion for microsurgical skill assessment.Sci代表15 , 27898 (2025).https://doi.org/10.1038/s41598-025-13522-1

已收到:

公认:

出版:

DOI:https://doi.org/10.1038/s41598-025-13522-1