研究人员要求AI向典型的澳大利亚父亲展示:他是白人,有鬣蜥|TAMA LEEVER和SUZANNE SRDAROV进行谈话

大型科技公司炒作销售生成人工智能(AI)是聪明,创造性,理想,不可避免的,即将在许多方面重塑未来。

由牛津大学出版社出版,我们的新研究关于生成的AI如何描绘澳大利亚主题直接挑战了这一观念。

我们发现,当生成的AIS生成澳大利亚和澳大利亚人的图像时,这些产出充满了偏见。他们在该国想象中的单一文化过去在家中更多地繁殖性别歧视和种族主义漫画。

基本提示,疲倦的对象

在2024年5月,我们问:澳大利亚人和澳大利亚根据生成的AI是什么样的?

为了回答这个问题,我们将55个不同的文本提示输入了五个最受欢迎的产生图像生成的AI工具:Adobe Firefly,Dream Studio,Dall-E 3,Meta AI和Midjourney。

提示尽可能短,以查看澳大利亚的基本思想的样子,以及哪些单词可能会在表示形式中产生重大变化。

我们没有更改这些工具上的默认设置,而是收集了第一个图像或返回的图像。一些提示被拒绝,没有结果。(用“儿童或儿童”一词的要求更有可能被拒绝,显然将儿童标记为某些AI工具提供者的风险类别。)

总体而言,我们最终得到了大约700张图像。

他们提出了一种理想的理想,即依靠疲惫的比喻,例如红色的污垢,乌鲁鲁,内陆,未驯服的野生动植物和在海滩上古铜色的澳大利亚人。

我们特别关注澳大利亚家庭和童年时代的形象,这是关于澳大利亚人和文化规范的更广泛叙述的指示符。

根据生成AI的说法,理想化的澳大利亚家庭默认情况下是绝大多数白色,郊区,异规范,并且在定居者的过去中非常锚定。

澳大利亚父亲和鬣蜥

关于家庭和人际关系的提示,产生的图像为这些生成的AI工具烤出来的偏见提供了一个清晰的窗口。

``澳大利亚母亲通常会导致白色的金发妇女穿着中性颜色,并在良性的家庭环境中和平地抱着婴儿。

唯一的例外是萤火虫,该萤火虫在国内环境外产生了仅仅是亚洲妇女的图像,有时甚至没有明显的视觉联系。

值得注意的是,除非明确提示,否则澳大利亚妇女产生的任何图像都没有描绘出澳大利亚母亲的原住民。对于AI,白人是在澳大利亚背景下育种的默认。

同样,澳大利亚父亲都是白人。它们不是家庭环境,而是在户外发现,与儿童进行体育锻炼,或者有时是奇怪地藏着野生动植物而不是儿童的。

一个这样的父亲甚至在拿起一只鬣蜥 - 一只不是澳大利亚本地的动物,所以我们只能猜测负责这一和其他的数据明显的故障在我们的图像集中找到。

种族主义刻板印象的令人震惊的水平

提示包括原住民澳大利亚人的视觉数据浮出水面,这些图像浮出水面,通常具有野生,不文明的视觉效果,有时甚至是敌对的本地人。

这在我们选择不出版的典型原住民家庭的图像中令人震惊。它们不仅会永存有问题的种族偏见,而且还可能基于数据和图像已故的个人那理所属于原住民。

但是,关于住房的提示,种族刻板印象也急切地存在。

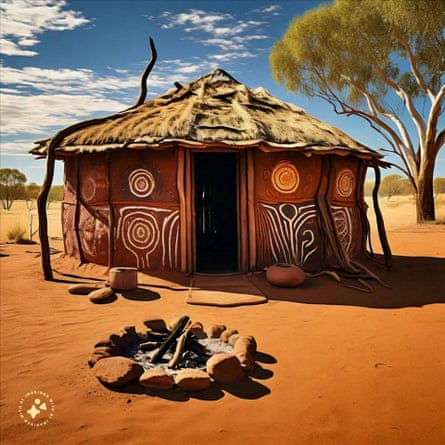

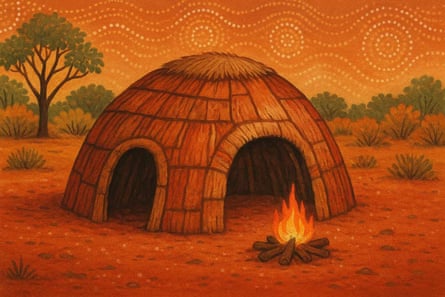

在所有AI工具中,澳大利亚人的房屋之间存在明显的区别 - 大概是在白人,郊区的环境中,由上面描绘的母亲,父亲及其家人居住 - 澳大利亚的家人和一个原住民的澳大利亚人的房子。

例如,当提示澳大利亚人的房屋时,Meta AI产生了一个郊区砖房,带有一个良好的花园,游泳池和郁郁葱葱的绿色草坪。

然后,当我们要求建立一个原住民的澳大利亚人的房屋时,发电机想出了一个红色污垢的草屋顶小屋,在外墙上装饰着“原住民风格的艺术主题”,并在前面装饰着火坑。

这两个图像之间的差异令人震惊。他们反复出现在我们测试过的所有图像发生器中。

这些表示显然不尊重土著数据主权对于原住民和托雷斯直岛人民来说,他们将拥有自己的数据并控制访问它。

有什么改善了吗?

自从我们的研究首次进行以来,我们使用的许多AI工具都对其基础模型进行了更新。

8月7日,Openai发行他们最近的旗舰模型GPT-5。

为了检查最新一代人的AI是否更好地避免偏见,我们要求Chatgpt5绘制两张图像:澳大利亚人的房屋和澳大利亚原住民的房屋。

第一个显示了相当典型的红砖郊区家庭住宅的影像图。相比之下,第二张图像更加卡通片,在内陆地区显示了一个小屋,燃烧着火和原住民风格的点绘画图像。

这些结果仅在几天前就产生了卷。

为什么这很重要

生成的AI工具无处不在。它们是社交媒体平台的一部分,融入了手机和教育平台,Microsoft Office,Photoshop,Canva以及大多数其他流行的创意和办公软件。

简而言之,它们是不可避免的。

我们的研究表明,当被要求对澳大利亚人的基本描述时,生成的AI工具将很容易地产生不准确的刻板印象。

鉴于它们被广泛使用,因此,AI正在制作澳大利亚的漫画,并以还原,性别歧视和种族主义的方式来形象化澳大利亚人。

鉴于对这些AI工具进行了对标记数据的培训的方式,将培养物减少到陈词滥调很可能是生成AI系统的一个功能,而不是错误。

Tama Leaver是Curtin University的互联网研究教授。Suzanne Srdarov是科廷大学媒体和文化研究研究员

本文最初发表在对话