超分辨率机器学习方法的限制降水降级

作者:Thatcher, Marcus

通用循环模型(GCM)提供了有关我们未来气候如何在各种温室气体排放方案下发展的关键信息。

这些GCM气候预测通常在大气中具有约100公里的空间网格分辨率1,,,,2限制其准确表示局部到区域规模的大气过程的能力,并准确模拟局部极端事件3,,,,4。为了增强GCM投影的空间分辨率,应用了动力学和统计缩减。使用区域气候模型(RCM)进行动态降压。RCMS利用GCM作为横向边界条件来模拟所选空间域上高空间分辨率下的物理过程。RCM的高空间分辨率模拟在计算上很昂贵5,,,,6这使得许多GCM投影在计算上具有挑战性。但是,使用统计和机器学习(ML)方法的缩小降低在计算上便宜且快速,从而使各种GCMS的多个合奏降低了7,,,,8,,,,9,,,,10。

ML模型在气候降低范围内的潜在效用引起了极大的兴趣,因为它们有可能大大减少产生高分辨率模拟所需的计算成本和时间。先前的几项研究应用了ML方法,例如多层感知器和支持向量机器,以降级表面变量,例如温度和降水量11,,,,12。最近,基于卷积神经网络(CNN)的高级ML模型被广泛用于降水降低后缩放之后12,,,,13,,,,14,,,,15,,,,16,,,,17,,,,18。在降水降尺度中,使用超分辨率方法ML模型了解高分辨率沉淀与粗分辨率沉淀数据之间的映射以产生高分辨率沉淀。超分辨率的机器学习模型训练用于降水缩放的训练通常分为两种方法:完美的缩减和不完美的降尺度9,,,,19。在完美的降尺度方法中,首先,通过保守的平均或其他平均技术来使高分辨率沉淀变得粗糙分辨率,然后训练超分辨率的ML模型,以降低缩放的高分辨率低分辨率降水量到高分辨率目标。大多数研究都集中在ML模型训练中进行降水降压的完美降压方法12,,,,15,,,,16,,,,20,,,,21。他们表明,与目标高分辨率降水数据相比,ML模型在降低沉淀方面的表现很好,当与完全排列的粗分辨率沉淀作为输入时。完美的问题很有用,因为它提供了一种非常清晰的方法来证明和评估ML模型学习粗分辨率和良好分辨率并提供高分辨率信息之间映射的能力。

但是,要实现ML模型在气候降低范围中的好处,必须解决不完美的问题。在不完美的降尺度问题中,来自低分辨率模型模拟的数据用于训练ML模型,以将低分辨率数据降低到由高分辨率模拟产生的高分辨率目标数据。在这种情况下,用作输入数据的粗分辨率仿真与高分辨率模拟并未完全对齐,因为模型的分辨率会改变概要天气特征的行为。对于不完善的问题,ML模型需要学习粗分辨率模拟中的偏见,并增强其空间分辨率以模拟高分辨率模拟。这是一个更具挑战性的问题。但是,先前的研究没有研究不完美问题的ML模型功能12,,,,15,,,,16,,,,20,,,,21。在这项研究中,我们探讨了基于澳大利亚领域的降尺度降水量的完美和不完美降尺度的超分辨率ML模型的潜力。我们讨论了不完善问题和可能解决方案的挑战。与改善不完美问题解决方案的策略有关的是需要进一步开发评估ML模型的方法。

黑盒的性质,缺乏身体理解以及对复杂ML模型的不良评估引起了人们对来自ML模型的缩小数据的适用性和使用的担忧。这需要在降尺度上下文中进一步对ML模型进行进一步的稳健评估,以帮助了解ML模型的行为以及与模型相关的潜在问题。可解释的人工智能(XAI)技术被广泛用于解释和解释气候研究中机器学习模型的行为7,,,,8,,,,22,,,,23,,,,24,,,,25,,,,26。最近的研究利用XAI方法(例如显着图)来评估机器学习模型在降低气候变量(例如表面温度)中的性能23。显着性图技术量化了使用基于梯度的近似值的特定模型预测的输入(例如,输入变量和网格点)的重要性。这些梯度近似图绘制的输入如何影响ML输出,但它们不将复杂的非线性过程包含在解释中22,,,,26也没有提供简洁有效的方法来评估ML模型的物理现实主义。在这里,我们提出了一种简单的灵敏度型方法,以了解执行降水超分辨率降低降低的ML模型行为。我们使用基于新的基于灵敏度的诊断方法评估了超分辨率机器学习模型的性能,这些诊断超出了传统验证框架。这些诊断有助于我们了解模型的行为,并发现标准验证方法无法检测到的任何结构性问题。

结果与讨论

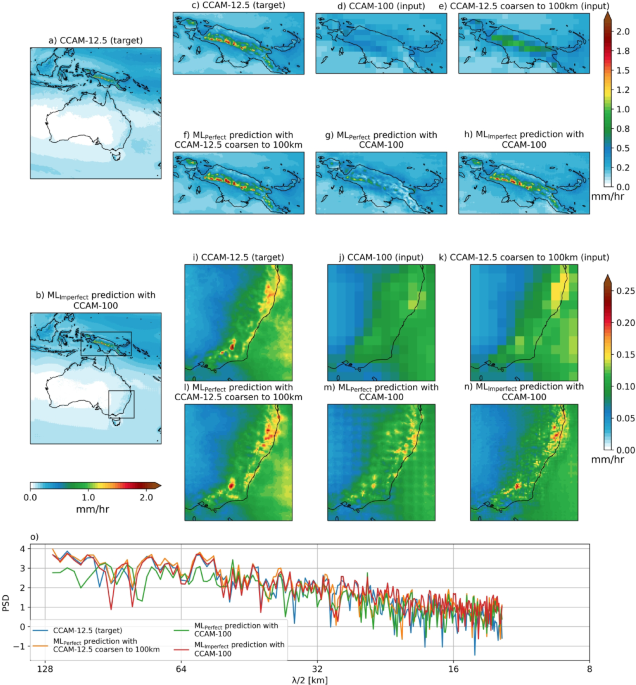

在这项研究中,我们以12.5 km的水平分辨率(CCAM-122.5)和100 km的水平分辨率(CCAM-100)运行CCAM。两种CCAM配置都使用频谱练习来强制进行风,空气温度和表面压力,这是欧洲中等范围天气预报中心第五代的大气重新分析(ERA55)27)在1980年至2020年期间。这两个CCAM模拟具有相似的大规模特征,从淡化到ERA5,但它们代表天气天气的方式有所不同。这两个模拟会产生明显不同的降雨量,尤其是在具有强大地形和高平均降雨量的地区(图。 1)。两个模拟之间的巨大差异表明,ML必须克服降低CCAM-100的挑战,以分辨为CCAM-122.5。例如,CCAM-122.5的平均气候小时降雨约为CCAM-100值的5倍。随着人们比较CCAM-122.5的极端小时降雨,缩放率进一步增加,在90时大5倍Th百分位数和10倍大于99Th百分比比CCAM-100(图。 2和3)。小时降雨的ML降尺度必须纠正平均值,增加空间变异性并增强极端以模仿CCAM-122.5的行为(图。 1和2)。在下面的讨论中,我们首先证明了超级分辨率ML模型可以准确地从100 km分辨率到CCAM-122.5值(目标数据)以100 km的COARSEN CCAM-122.5降低小时降雨。我们称此ML降尺度模型为ML完美的。然后我们应用ML完美的到CCAM-100,以查看其能够重现CCAM-122.5值的能力。降低降雨缺乏CCAM-122.5模拟中存在的可变性,这激发了我们尝试另一种ML模型。最后,我们训练超级分辨率ML,以降低CCAM-100值至CCAM12.5,并将其称为ML不完善。

超分辨率ML方法的适用性降水降级

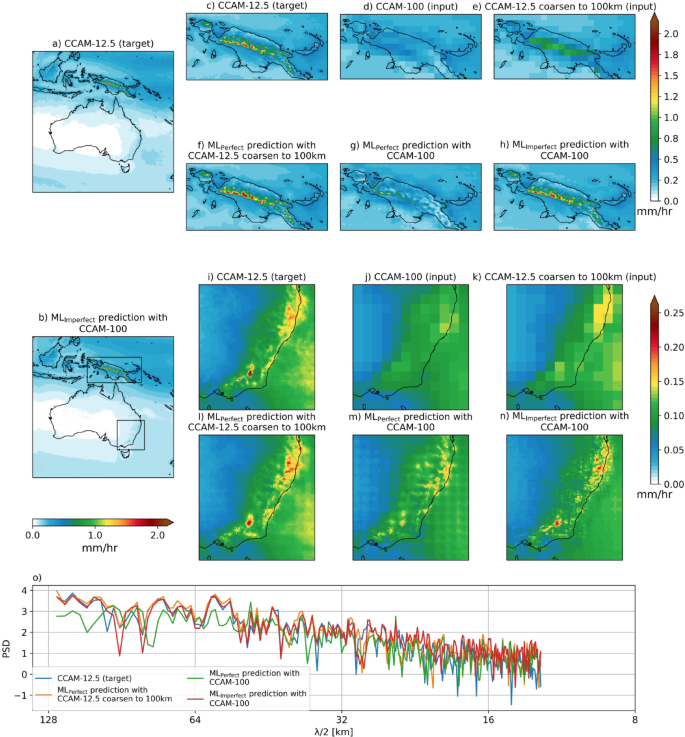

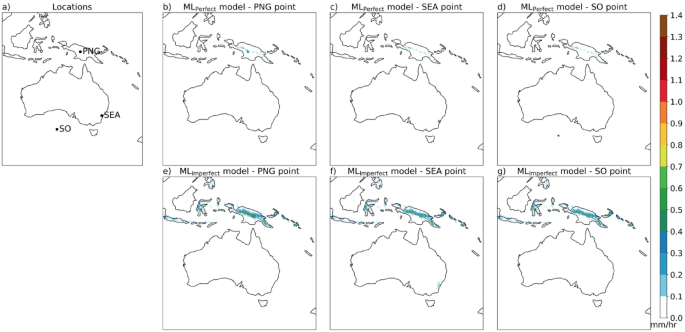

首先,我们评估了ML模型预测测试期(201220年)小时降水气候的能力,我们将其称为图2中的目标数据。 1a,c,i。ML完美的使用COARSEN CCAM-122.5输入可以很好地捕获目标数据(图 1a,b)。ML不完善随着CCAM-100的输入,如巴布亚新几内亚(PNG)和澳大利亚东南部(SEA)所示,还可以很好地捕捉气候降雨(图。 1H,n)。即使与目标相比,这两个模型都很好地代表了气候学的细尺度空间结构,即使在PNG和SEA等复杂地形区域进行了放大。ML完美的模型可以更好地预测目标数据的细尺度空间模式的强度不完善模型(比较图 1câf,h,i l,n)。这是因为ML完美的只需要学习完美对齐的输入和目标之间的映射(图 1与低分辨率CCAM-100模拟相比 1eâd,kâj)。ML不完善有更艰巨的任务,因为它必须学习从输入到目标的映射,其中包括学习空间不一致(比较图。 1D,c)。

为了进行比较,CCAM-100模拟用作ML的输入完美的模型(图 1G,m)。由此产生的预测未能捕获PNG和海洋地区气候学的空间结构(见图。 1G,m)。此外,该预测在中央PNG地区的西南部地区的平均降雨量很高,并且与目标相比,海洋域的高平均降雨区域的空间不匹配也具有很高的平均降雨区域(比较图。 1c vs. g,我vs. m)。这是因为ML完美的似乎已经学到了粗略输入和目标之间的映射,这正在锐化和增加降雨量,并在中等降水值的区域周围具有细尺度的空间结构,例如中央PNG区域(见图 1E,F)和海洋域的东北部(图 1K,L)。因此,ML完美的通过CCAM-100模拟作为输入,在西南PNG地区产生高降水平均水平,在CCAM-100 km模拟中可以看到高降雨气候(图。 1D,G)。海域也是如此。ML长官锐化并增加了CCAM-100公里模拟的高平均降水区域附近的降雨平均值(图。 1J,M)。如Reddy等人(2023)(2023))气候学表明ML的功率谱密度(PSD;使用二维快速傅立叶变换计算完美的与目标PSD相比 1o)。这些结果突出了应用ML的局限性完美的从粗分辨率CCAM模拟中输入ML完美的不适合气候缩小。相反,ML不完善使用相同的低分辨率CCAM-100输入可以重现目标气候的降水气候学的微尺度空间模式,并且似乎成功地降低了降级气候降雨(图。 1C vs. H)。图1

一个)和ML不完善模型预测(b)在测试期间的研究区域。顶面板(ch)在巴布亚新几内亚(PNG)的放大地区展示气候学。控制板 (c)显示了CCAM-122.5 km目标(d)CCAM-100 km输入((e)CCAM-122.5 km coarsen至100 km输入,(f)ML完美的具有12.5 km coarsen 100 km输入的模型预测((g)ML完美的使用CCAM 100 km输入和(H)ML模型不完善分别在PNG区域进行模型预测气候。类似于顶面板,中间面板(我n)显示了澳大利亚东南地区(海洋)的气候学。底部面板中的线图(o)显示了整个域的气候密度(仅适用于中端和短波长),以实现不同考虑的模型预测和目标。使用Python Cartopy软件包(V0.24.1)绘制地图。

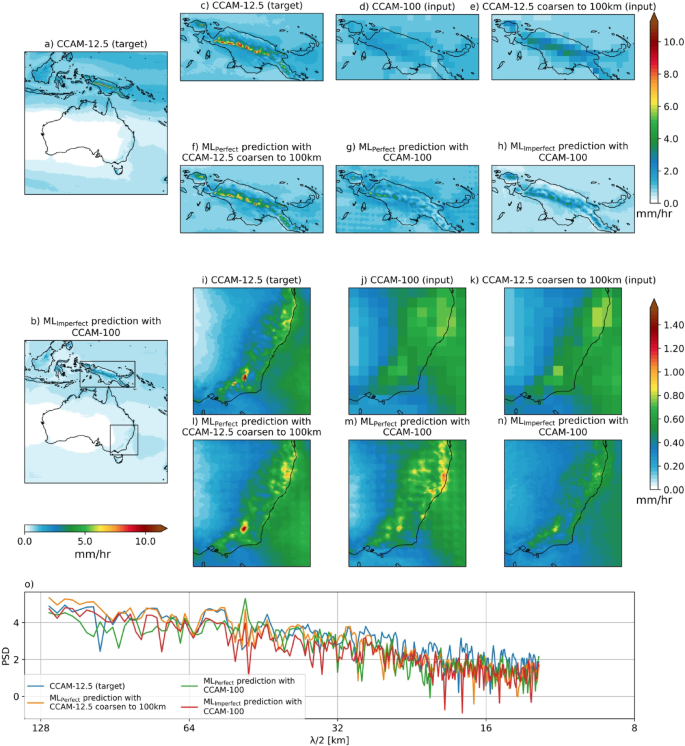

数字2显示95ThCCAM 12.5 km目标的小时降水的百分位图,ML完美的使用Coarsen CCAM-122.5至100 km输入,ML完美的使用CCAM-100输入和ML不完善使用CCAM-100输入。与气候结果相似,ML完美的使用Coarsen CCAM-122.5输入再现了极端的细尺度空间模式(95Th百分比)在PNG的复杂地形区域中很好(图 2C,F)和海(图 2我,l)。但是,ML完美的使用CCAM-100,输入无法获得极端的极端空间模式,并且具有与上述气候相似的空间不一致之处(图。 2g vs. c,m vs. i)。而ML不完善可以重现极端的细尺度空间结构,但低估了大小(图 2h vs. c,n vs.i)。

与图 1但是对于95Th测试期间的小时降水百分比。使用Python Cartopy软件包(V0.24.1)绘制地图。

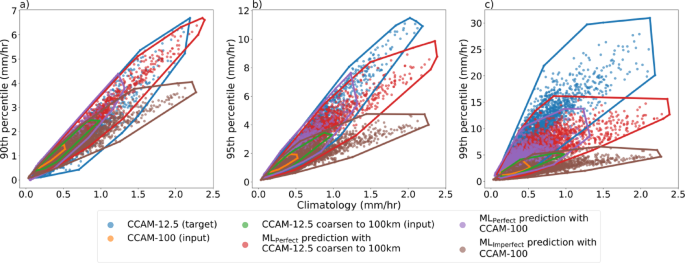

我们通过检查气候与极端之间的关系来评估ML性能(90Th,95Th和99Th百分位数)通过绘制气候平均值与相应的极值(图 3)。这种关系允许人们评估ML模型,而无需关注精确的网格点比较,这由于混乱的天气过程而存在缺陷。CCAM-122.5模拟关系与CCAM-100模拟的比较表明,低分辨率显着低估了气候极端降雨。CCAM-100是CCAM-122.5的不良反射。ML完美的使用CCAM-122.5,COARSEN输入再现了90的目标的平均关系和极端关系Th和95Th百分位数但低估了99Th百分位数。对于99Th百分位数,ML完美的低估了平均降雨量与极端价值的极端价值之间的关系。ML完美的随着CCAM-100的输入,通过低估平均值和极端值的估计,很难预测平均关系和极端关系。ML不完善随着CCAM-100输入略微低估了90时平均值与极端关系的极端值Th与目标相比,百分位数(图 3一个)。ML不完善在极端的预测下,对于90上以上的极端降雨变得更加明显Th百分位数为2.5倍,95倍的低估和6倍Th和99Th百分位数分别(图 3公元前)。图3平均关系与极端关系的散点图比较(气候与90Th百分位数(

不完善

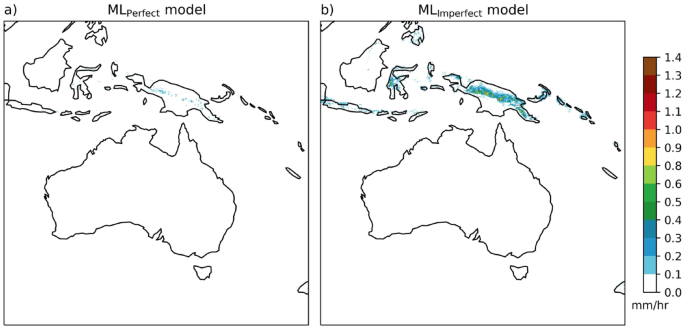

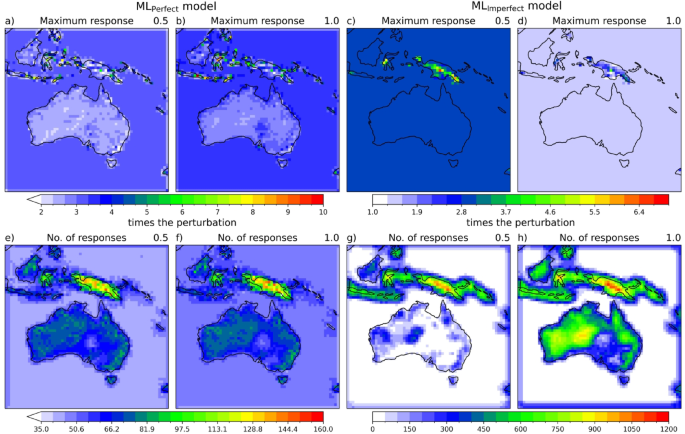

在所有网格点上输入为零降水量时的预测,并带有附加的地形输入(如图所示 4)。ML完美的模型可以预测,除了非常小的0.2 mm/h的PNG高海拔区域以外,到处都有零沉淀(图。 4一个)。但是,ML不完善随着零降雨的投入预测域的非热带区域中的降水量为零,在域的高海拔热带地区,尤其是PNG区域的升高部分中,降水值约为0.2 0.9 mm/h(图)(图) 4b)。ML不完善降雨预测正在将地形输入转换为降水输出(占平均值的40%)。为了进一步了解地形信号对ML预测的降雨的影响,我们在域中的三个选定位置进行了输入扰动实验。在高海拔PNG地区,海地地区和南大洋(SO)地区选择了三个位置(见图 5一个)。现在,在这些位置进行0.5 mm/h的输入扰动,其余的网格点为零。在所有三个位置的扰动中,ML完美的预测集中在扰动点和附近,在高海拔PNG区域的沉淀(<0.1 mm/h)的摄动点(<0.1 mm/h)都可以忽略不计(图。 5bâd)。但是,ML不完善预测在域的高海拔热带区域上,降水量在0.5毫米/小时的降水量均在三个选定的位置上,无论扰动如何(图。 5eâg)。此外,我们在三个选定位置进行了1毫米/h的输入扰动,结果与0.5 mm/h的输入扰动相似(图。S3)。ML不完善无论输入如何,都可以在域的高海拔区域进行降水,因为它正在从其他地层输入中获取信号。ML不完善正在利用模型中的地形将CCAM-100映射到CCAM-122.5仿真中,通过添加降雨量,它始终低估了降雨分辨率的增强。

在这里,我们介绍了各种输入扰动的ML预测结果,以理解和解释降水降级中超分辨率ML模型的行为。图 6显示ML的模型响应诊断(最大响应和响应数)完美的和ML不完善当用0.5和1毫米/h扰动时。ML完美的模型放大了域的所有区域的输入扰动,即用0.5 mm/h的扰动,最大响应的最大响应范围约为扰动的2倍左右,最大响应范围为2倍的最大响应范围为2到10倍(图) 6a,b)。进一步用扰动5和10 mm/h进行了测试,最大响应的最大响应范围分别为2.38 -5和3倍扰动的5倍(图。S4a,b)。ML完美的显示出非线性响应,随着输入扰动的幅度,缩放系数变化。与提高大降雨输入的锐化相一致,最大响应大于1。鉴于纬度和经度的8倍缩小,如果将输入降雨集中在细分辨率网格的一个网格单元中,则最大响应将为输入值64倍。ML的最大响应完美的在整个域上,例如热带土地区域的某些部分具有最高的最大响应值,与域的其他区域相比,澳大利亚的某些部分的最大响应值最低。这是因为在地形区域ML完美的模型在许多网格点响应,这可能意味着该模型正在将输入降水散布在相邻的网格点上,而在扰动点上没有太多或附近的峰值(图。 6e,f)。

此外,我们研究了冲击距离,以查看模型响应与输入扰动的距离。结果表明,在所有网格点上的影响距离的最大值约为500 km(未显示),它非常接近输入扰动网格点。这表明ML完美的模型没有学习任何空间虚假的关系。这是因为ML模型是完全卷积的,其中过滤器/内核主要在有限空间上学习空间约束的信息。类似于ML完美的型号,ML不完善模型推断了整个域上的输入扰动,并在PNG区域上具有最大值。用0.5毫米/h扰动ml不完善模型响应的范围约为扰动的2倍和1 mm/h的扰动,模型响应的范围约为扰动的1.3倍。ML不完善除了在PNG区域外,模型响应在域上的变化不大,在PNG区域中看到了较大的变化(图。 6光盘)。ML不完善无法为其余域的输入产生大量扩展。ML不完善与ML相比,输入降雨的放大要少得多完美的。ML中最大响应的数量很强不完善在澳大利亚。将输入降雨量增加一倍,导致4倍以上的反应。与降雨输入的放大减少一致,ML不完善与ML相比,将1 mm/h的输入降雨量分布在数量级上的降雨点。完美的。ML完美的和ML不完善在最大响应和响应次数以及其在输入值中的变化方式上的行为都大不相同 - 一个响应偏见和一个纠正丢失的功能。

结论

我们探索了超分辨率机器学习(ML)模型方法的潜力,以将降水量从100 km到12.5 km的空间分辨率下降到澳大利亚领域。为此,我们研究了两种超分辨率ML模型训练方法,用于降水降尺度,称为Perfect and Indrectef。在完美的缩减案例中ML长官将粗糙的CCAM-122.5模拟降水降至100 km,作为输入,并经过训练以预测CCAM-122.5降水。在完美的情况下,ML长官了解完美排列的粗分辨率输入和高分辨率目标之间的降尺度功能。在不完美的降尺度情况下,ML不完善获得低分辨率CCAM-100公里的模拟降雨作为输入,并经过训练以预测CCAM-122.5模拟降雨。这是使用ML的气候缩小。ML完美的带有粗糙CCAM-122.5输入的模型在再现气候和极端方面表现良好(即95Th百分位数)。但是,如果ML完美的被赋予CCAM-100模拟降雨作为输入,由此产生的预测低估了与CCAM-122.5降雨的空间不一致的气候和极端降雨。这是因为ML完美的专注于学习降级,而没有学会纠正CCAM-100和CCAM-122.5之间降雨的系统差异。这显示了ML完美的不适用于气候从粗分辨率模拟到更精细的分辨率的降水量。相反,ML不完善使用CCAM-100降雨输入来预测CCAM-122.5降雨输出再现了极端的气候降雨量和空间特征。但是,ML不完善低估了极端的大小。

我们介绍了基于灵敏度的诊断,以阐明ML行为并确定潜在的问题。灵敏度分析显示ML完美的和ML不完善行为不同。对于ML完美的,随着输入值的增加,响应的反应有非线性增加,响应集中在输入点附近。在热带地区的高降雨区域中,输入的降雨缩放非常斑驳,这与该地区气候和极端降雨的精细特征一致。ML的有限程度完美的响应(即响应数量)与试图降低降级并增强降雨的精细特征的ML模型一致。对于ML不完善随着输入降雨的增加,降雨量也有非线性增加。但是,ML不完善与热带地形有关,这与背景降雨有关。这种非物理行为是从本研究中使用的新诊断中揭示的,该诊断方法不会使用标准评估方法来识别,例如查看基于全球网格点的指标,例如均方根误差和峰值信噪比。ML的功能不完善敏感性分析在空间上是降雨的一个空间广泛的,热带地区和澳大利亚西北部的响应量比ML的响应量均高完美的。ML不完善正在分布在更大地区的单个网格点降雨的输入。我们的灵敏度实验显示了ML不完善在高海拔地区具有非物理行为,并且需要进一步的改进才能用于降雨的气候降低。

偏置校正方法,例如分位数映射(QM)28和半参数映射(SPQM)29仅举几例,在纠正偏见方面表现更好,特别是应用于ML不完善模型,低估了极端。但是,我们的结果表明ML不完善模型存在一个结构性问题,即无论输入如何,在高海拔地区输出降水。然而,如上一节所述,用机器学习模型降低了降水量的高度特异性。因此,ML不完善在不太复杂的地形区域到平原的模型输出是有用的,将偏置校正方法应用于这些区域可以改善降水量输出的表示,尤其是极端,这超出了本研究范围。此外,为了改善极端的表示,可以在未来的研究中应用对基于指数和生成的对抗网络(GAN)的对抗损失等损失功能的修改30,,,,31,,,,32。此外,用ML解决不确定性不完善可以在以后的研究中探索模型,生成的ML建模方法,例如gan和扩散模型。32。这项工作有一些局限性,尤其是由于使用CCAM输出进行培训固有的偏见。由于ML模型受到该动态缩小的数据的培训,因此都会承担任何现有的偏见,这意味着模型的性能和评估受到培训数据的质量的限制。然而,询问ML模型对于建立对模型的信心至关重要,即它不会产生非物理行为。这里存在的输入诊断提供了一种研究ML模型行为的有力方法,并且可以轻松地部署它们以评估超分辨率降低缩放ML模型。对于更复杂的ML模型,它们可能需要进一步开发,但是使用对ML模型进行不同输入来评估其预测的想法是阐明ML模型行为并评估其现实主义并应成为评估ML模型的标准方式的有力方法。

数据和方法数据

在这项研究中,我们使用保形立方大气模型(CCAM

33,,,,34)。这是一个基于立方网格的可变分辨率全球气候模型,该模型可以将网格聚焦于区域而不引入横向边界。Hourly precipitation data from 1980 to 2020 was provided at a coarse resolution (at 100 km for the globe using a C96 grid (CCAM-100)) and at a high-resolution (at 12.5 km, focused over Australasia with a C384 grid (CCAM-12.5))33,,,,34。The fifth generation of the European Centre for Medium-Range Weather Forecasts (ECMWF) atmospheric reanalysis (ERA527) data is used to drive the CCAM using spectral nudging for winds, air temperature and surface pressure.We selected the ML model training data from 1980 to 2012 (until 15th September 2012; approximately 286720 samples) and test data from 2012 (from 15th September 2012) to 2020 (i.e., approximately 72704 samples) based on the commonly applied 80−20 split rule.Before the model training in the data preprocessing step, the precipitation and static orography data used in model training are normalized based on the min-max normalization using the training period’s minimum and maximum values.Following the previous study10the model input normalized data is then scaled to 100 because most of the hourly precipitation data has small values, and scaling them to 0–1 produces nearly zero values.

Super-resolution machine learning based downscaling methods

模型架构

We develop a super-resolution ML model using the deconvolution layers with stepwise static orography input called super-resolution deconvolution network – stepwise orography (SRDN-SO)10。SRDN-SO model takes in 100 km of precipitation data input and outputs the 12.5 km high-resolution precipitation, i.e., 8× resolution enhancement.SRDN-SO model has an input, three main hidden deconvolution layers, and three convolution layers at the end.Each deconvolution layer consists of 64 filters of 7 × 7 filter size and is activated non-linearly with rectified linear unit (ReLU).Each deconvolution layer performs a 2× resolution enhancement.The first convolution layer with a filter of 1 × 1 filter size linearly maps the last deconvolution layer feature maps to the next convolution layer.Next follows the second convolution layer with 64 filters of size 7 × 7 with ReLU activation.The last convolution layer with a filter of 1 × 1 size linearly maps the second convolution layer feature maps to the output.The static orography is provided at multiple steps as the feature maps, i.e., 50 km and 25 km orography data, are appended as a feature map to the first and second deconvolution layer’s feature maps, respectively, and 12.5 km orography data is concatenated with the first convolution layer output.To avoid overfitting, L2 regularization with a 1e−9 regularization factor is applied for all the convolution and deconvolution layers in the network.SRDN-SO model architecture is shown clearly in Fig.S1。

模型培训

Super-resolution ML model training for downscaling is broadly categorized into perfect and imperfect downscaling cases9,,,,19。

Perfect downscaling approach

In the perfect downscaling approach, the ML model is trained with a high-resolution target and the coarse-resolution model input, which is the upscaled version of the same high-resolution target.We call this model ML完美的to reflect it was trained for the perfect case, where the CCAM high-resolution precipitation data (12.5Â km resolution) is conservatively interpolated to coarse resolution (100Â km)10。In this case, the input and target data are perfectly aligned, with both having the same weather features, simplifying the model training.The ML完美的only needs to learn the spatial mapping of the coarse resolution spatial information to fine-scale resolution9,,,,19。

ML完美的is trained with mean squared error (MSE) as a loss function.Adam optimizer with a learning rate of 3 × 10− 3and a learning rate reduction factor of 0.1 is applied when the model does not improve the loss value for ten epochs with a minimum learning rate of 1 × 10− 5is used for model training.The model loss value converges at the 30th epoch;further training doesn’t improve the loss (not shown).The model loss curve represents a good fit without overfitting the data (see Fig.S2)。We have chosen the model hyperparameters based on the minimum validation loss and trained the model until the loss curve converges.To test ML完美的, we evaluated its predictions using a coarse version of the high-resolution CCAM-12.5 simulation as input and with CCAM-100 simulation as input.

Imperfect downscaling approach

In the imperfect downscaling case, the ML model is trained using the high-resolution target data (CCAM-12.5) and input from the coarse resolution 100Â km simulation (CCAM-100).This trained model, we call ML不完善, must learn the spatial inconsistencies between the CCAM 100Â km and the CCAM 12.5Â km data.This requires ML不完善to learn the coarse to fine scale spatial relationships and the larger scale model differences of the coarse and fine scale model.Similar to ML完美的model, ML不完善is also trained with MSE as a loss function for 60 epochs because the model loss converges at the 60th epoch.The ML不完善model loss curve shows a good fit without any sign of overfitting (Fig.S2)。ML不完善is evaluated against the target CCAM-12.5 simulation with CCAM 100Â km simulation as input.

A simple explainability and evaluation method for machine learning based super-resolution downscaling

Here we propose a simple sensitivity-type method to understand the ML model behaviour in performing the super-resolution downscaling of precipitation.In this method, first, we perturb a coarse input grid point with a precipitation value of 0.5Â mm/h, with the rest of the grid points made to zero;with this input, we then record the model-predicted responses.This is iteratively performed across all the coarse grid points.The model responses less than 0.1Â mm/h are considered as noise and are removed.Further, we input all zeros at all coarse input grid points and record the model output, and this is used as an additional threshold for recording the model output responses for the input perturbation.The model responses for perturbed inputs less than the all zeros-input based model response value at a particular grid point are considered noise and removed.From these responses, we compute two key diagnostics to assess the model behaviour: one is the maximum response, which is the maximum model predicted value, and the second is the number of responses, which is the number of grid points with values greater than 0.1Â mm/h in the model predictions.Maximum response and number of responses represent how rainfall at the coarse grid is mapped to the fine resolution grid.Further, we considered the impact distance, which is the maximum distance between the input perturbed grid point to the farthest grid point greater than 0.1Â mm/h in the model predictions.Impact distance represents the spatial region of influence, i.e., how far the model response is from the input perturbation.Finally, to assess the non-linearity and extrapolation capabilities of the ML model, we perform the same sensitivity experiments with input perturbation values of 1, 2, 5, and 10Â mm/h.

数据可用性

ERA5 reanalysis data used to drive the CCAM model is freely available at:https://doi.org/10.24381/cds.bd0915c6。The coarse and high-resolution CCAM data can be made available upon request to the corresponding author.

参考

Eyring, V. et al.Overview of the coupled model intercomparison project phase 6 (CMIP6) experimental design and organization.Geosci。Model Dev. 9, 1937–1958 (2016).

Meinshausen, M. et al.The shared socio-economic pathway (SSP) greenhouse gas concentrations and their extensions to 2500.Geosci。Model Dev. 13, 3571–3605 (2020).

CAS一个 Google Scholar一个

Volosciuk, C., Maraun, D., Semenov, V. A. & Park, W. Extreme precipitation in an atmosphere general circulation model: Impact of horizontal and vertical model resolutions.J. Clim。 28, 1184–1205 (2015).

Maraun, D. Bias correcting climate change simulations-a critical review.Curr。Clim.张。代表。 2, 211–220 (2016).

Rummukainen, M. State-of-the-art with regional climate models.Wiley Interdiscip.攀登牧师。张。 1, 82–96 (2010).

Schär, C. et al.Kilometer-scale climate models: Prospects and challenges.公牛。是。陨石。Soc。 101, E567–E587 (2020).

Baño-Medina, J., Manzanas, R. & Gutiérrez, J. M. Configuration and intercomparison of deep learning neural models for statistical downscaling.Geosci。Model Dev. 13, 2109–2124 (2020).

Rampal, N. et al.High-resolution downscaling with interpretable deep learning: Rainfall extremes over New Zealand.Weather Clim.极端。 38, 100525 (2022).

Rampal, N. et al.Enhancing regional climate downscaling through advances in machine learning.艺术品。Intell。Earth Syst. 3, 230066 (2024).

Reddy, P. J., Matear, R., Taylor, J., Thatcher, M. & Grose, M. A precipitation downscaling method using a super-resolution deconvolution neural network with step orography.Environ.Data Sci. 2, e17 (2023).

Goyal, M. K., Burn, D. H. & Ojha, C. S. P. Evaluation of machine learning tools as a statistical downscaling tool: Temperatures projections for multi-stations for Thames River Basin.加拿大。Theor.应用。Climatol. 108, 519–534 (2012).

Vandal, T., Kodra, E. & Ganguly, A. R. Intercomparison of machine learning methods for statistical downscaling: The case of daily and extreme precipitation.Theor.应用。Climatol. 137, 557–570 (2019).

Sharma, S. C. M. & Mitra, A. ResDeepD: A residual super-resolution network for deep downscaling of daily precipitation over India.Environ.Data Sci. 1, e19 (2022).

Harilal, N., Singh, M. & Bhatia, U. Augmented convolutional LSTMs for generation of high-resolution climate change projections.IEEE Access 9, 25208–25218 (2021).

Kumar, B. et al.Deep learning–based downscaling of summer monsoon rainfall data over Indian region.Theor.应用。Climatol. 143, 1145–1156 (2021).

Passarella, L. S., Mahajan, S., Pal, A. & Norman, M. R. Reconstructing high resolution ESM data through a novel fast super resolution convolutional neural network (FSRCNN).地球植物。res。Lett。 49, e2021GL097571 (2022).

Wang, F., Tian, D. & Carroll, M. Customized deep learning for precipitation bias correction and downscaling.Geosci。Model Dev. 16, 535–556 (2023).

Saha, A. & Ravela, S. Statistical-physical adversarial learning from data and models for downscaling rainfall extremes.J. Adv.模型。Earth Syst. 16, e2023MS003860 (2024).

van der Meer, M., de Roda Husman, S. & Lhermitte, S. Deep learning regional climate model emulators: A comparison of two downscaling training frameworks.J. Adv.模型。Earth Syst. 15, e2022MS003593 (2023).

Kumar, B. et al.On the modern deep learning approaches for precipitation downscaling.Earth Sci.通知。 16, 1459–1472 (2023).

Wang, F., Tian, D., Lowe, L., Kalin, L. & Lehrter, J. Deep learning for daily precipitation and temperature downscaling.水资源。res。 57, e2020WR029308 (2021).

Bommer, P., Kretschmer, M., Hedström, A., Bareeva, D. & Höhne, M. M.-C.Finding the right XAI method--A guide for the evaluation and ranking of explainable AI methods in climate science.arXiv Preprint arXiv:2303.00652(2023)。

González-Abad, J., Baño-Medina, J. & Gutiérrez, J. M. Using explainability to inform statistical downscaling based on deep learning beyond standard validation approaches.J. Adv.模型。Earth Syst. 15, e2023MS003641 (2023).

Mamalakis, A., Barnes, E. A. & Ebert-Uphoff, I. Investigating the fidelity of explainable artificial intelligence methods for applications of convolutional neural networks in geoscience.艺术品。Intell。Earth Syst. 1, e220012 (2022).

Mamalakis, A., Barnes, E. A. & Ebert-Uphoff, I. Carefully choose the baseline: Lessons learned from applying XAI attribution methods for regression tasks in geoscience.艺术品。Intell。Earth Syst. 2, e220058 (2023).

McGovern, A. et al.Making the black box more transparent: Understanding the physical implications of machine learning.公牛。是。陨石。Soc。 100, 2175–2199 (2019).

Hersbach, H. et al.The ERA5 global reanalysis.Q. J. R. Meteorol.Soc。 146, 1999–2049 (2020).

Chen, J., Brissette, F. P., Chaumont, D. & Braun, M. Finding appropriate bias correction methods in downscaling precipitation for hydrologic impact studies over North America.水资源。res。 49, 4187–4205 (2013).

Rajulapati, C. R. & Papalexiou, S. M. Precipitation bias correction: A novel semi-parametric quantile mapping method.Earth Sp.科学。 10, e2023EA002823 (2023).

Rastogi, D. et al.Complementing dynamical downscaling with super-resolution convolutional neural networks.地球植物。res。Lett。 52, e2024GL111828 (2025).

Reddy, P. J., Baki, H., Chinta, S., Matear, R. & Taylor, J. PAUNet: Precipitation attention-based U-Net for rain prediction from satellite radiance data.arXiv Preprint arXiv:2311.18306(2023)。

Rampal, N., Gibson, P. B., Sherwood, S., Abramowitz, G. & Hobeichi, S. A reliable generative adversarial network approach for climate downscaling and weather generation.J. Adv.模型。Earth Syst. 17, e2024MS004668 (2025).

McGregor, J. L. & Dix, M. R. An updated description of the conformal-cubic atmospheric model.在High Resolution Numerical Modelling of the Atmosphere and Ocean51–75 (Springer, 2008).

Thatcher, M. & McGregor, J. L. Using a scale-selective filter for dynamical downscaling with the conformal cubic atmospheric model.星期一Weather Rev. 137, 1742–1752 (2009).

致谢

The authors would like to thank National Computing Infrastructure (NCI) Australia for providing computational resources.We would like to acknowledge the funding support of the CSIRO and Australian Climate Service.We also thank TensorFlow, Keras, and Horovod teams for openly providing their APIs.

竞争利益

作者没有宣称没有竞争利益。

附加信息

Publisher’s note

Springer Nature remains neutral with regard to jurisdictional claims in published maps and institutional affiliations.

补充信息

权利和权限

开放访问

This article is licensed under a Creative Commons Attribution 4.0 International License, which permits use, sharing, adaptation, distribution and reproduction in any medium or format, as long as you give appropriate credit to the original author(s) and the source, provide a link to the Creative Commons licence, and indicate if changes were made.The images or other third party material in this article are included in the article’s Creative Commons licence, unless indicated otherwise in a credit line to the material.If material is not included in the article’s Creative Commons licence and your intended use is not permitted by statutory regulation or exceeds the permitted use, you will need to obtain permission directly from the copyright holder.To view a copy of this licence, visithttp://creativecommons.org/licenses/by/4.0/。重印和权限

引用本文

Reddy, P.J., Matear, R., Taylor, J.

等。Limitation of super-resolution machine learning approach to precipitation downscaling.Sci Rep15 , 30070 (2025).https://doi.org/10.1038/s41598-025-05880-7

已收到:

公认:

出版:

doi:https://doi.org/10.1038/s41598-025-05880-7