全部新闻

将Google的“ Ironwood” TPU POD堆叠到其他AI超级计算机

Google将其“ Ironwood” TPU V7P系统与Lawrence Livermore的El Capitan超级计算机进行了比较,但在Google Cloud Next 2025年,比较具有误导性。尽管Ironwood在AI培训和推理方面表现出色,但El Capitan却针对传统的HPC工作量进行了优化,并且由于政府定价交易而引起的成本效率具有更好的价值。尽管Ironwood的高性能(FP8的42.52 exaflops),但其成本明显高于El Capitan(11亿美元和6亿美元)。此外,实际的性能比较表明,El Capitan在混合精度计算中优于Ironwood的2.05倍,这挑战了Google对出色计算能力的主张。

一个扫描错误创建了一个假科学术语,现在会不会让它死

AI系统无意间再现了数十种科学论文中发现的错误:荒谬的术语“植物电子显微镜”。此错误起源于1959年在细菌细胞壁上的论文中的数字化错误,其中软件从两个单独的列中错误地组合了单词。该词后来由于翻译错误而在伊朗研究中重新出现,然后由AI传播在网络上。研究人员发现,包括GPT-4和Claude 3.5在内的当前AI模型仍会产生此错误,这表明它现在已嵌入其知识库中。大型互联网数据存储库CommonCrawl可能是错误术语的来源。从广泛的数据集中消除此类错误对研究人员和AI公司都带来了重大挑战。

(几乎)像我们一样:描述人工智能中的创造力

马克斯·普朗克学院(Max Planck Institute)的研究人员探索了与人类相比的大型语言模型(LLM)的处理方式。通过检查创造力的灵活性和持久性,他们发现LLM和人类在完成任务时都使用类似的策略,例如寻找对象或命名动物的替代用途。但是,LLM在不同任务中表现出的一致性少于人类。灵活的LLM比持续的LLM产生的创造力更多,而人类的创造力是一致的,无论方法类型如何。该研究表明,在共同创造过程中,人与AI之间的协作有可能增强。

新游戏公司的操作如何计划以其AI生成的故事为中心真正的作家和演员

在凌晨1点和三星等投资者的支持下,手术游戏旨在通过生成的AI彻底改变游戏行业,但与人类创意合作。在乔恩·斯诺迪(Jon Snoddy)和乔恩·卡夫(Jon Kraft)的带领下,沃尔特·迪斯尼(Walt Disney)研究与发展和潘多拉媒体(Pandora Media)的前高管,该公司强调与才华横溢的作家合作,以创建具有栩栩如生的AI角色的身临其境的游戏,这些游戏具有与玩家的情感联系。他们的第一场比赛“手术室”具有一个名为Enya的角色,他根据玩家的动作在情感上做出反应。操作计划即将启动其基于订阅的模型,提供的情节游戏体验的价格与典型的视频游戏相当,而不是三倍A标题。该公司还确保对参与其项目的配音演员的公平赔偿,并在正在进行的演员对AI使用的主要游戏出版商罢工期间与道德标准保持一致。

国会要求詹森为DeepSeek的Nvidia筹码辩护

美国官员正在调查NVIDIA,因为担心其AI芯片可能已通过间接渠道转移给了中国公司,从而可能规避了美国出口限制。中国众议院选择委员会要求NVIDIA的详细记录和通讯在2020 - 2025年之间有关东南亚和中国的筹码销售。同时,NVIDIA首席执行官詹森黄(Jensen Huang)正在访问中国,以维持业务关系,尽管美国最近的出口管制导致该公司收取55亿美元的费用。

NTT研究在哈佛推出了人工智能小组的新物理学

NTT Research已建立了一个新的跨学科研究小组,即人工智能小组的物理学小组,以解决AI中的“黑匣子问题”并改善系统的可信度和安全性。在田中田纳卡(Hidenori Tanaka)博士的带领下,该倡议旨在使用将物理学,心理学,哲学和神经科学整合的方法探索生物学和人工智能之间的相似之处。目的是对AI机制有更深入的了解,并促进更和谐的人类合作。这项工作基于对人工智能物理学的五年研究,并计划与哈佛大学和斯坦福大学继续合作。

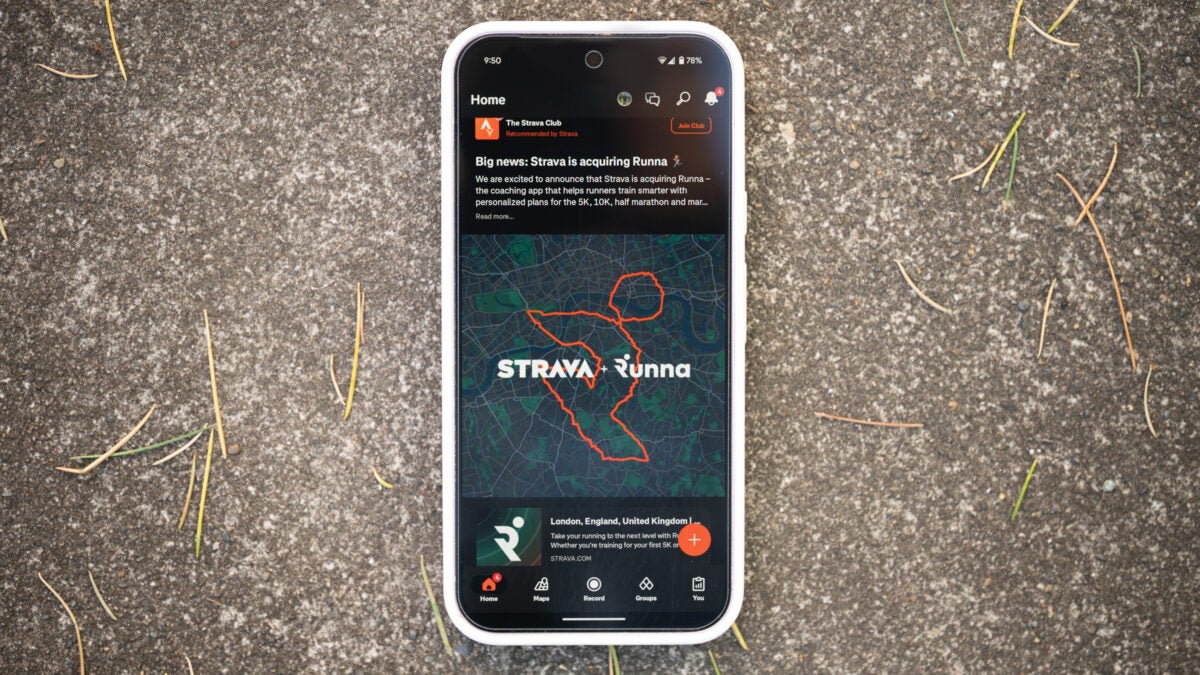

本周技术:Strava策略揭示,颜色使匹配变得容易,在世界各地进行AI培训和协作路线计划

Sweet Protection推出了Hyper Violet,作为一种新的特别版颜色,可在七个头盔型号,太阳镜和护目镜中提供。Vekta是一种用于自行车分析的AI软件,宣布与专业自行车团队Arkéa的合作伙伴关系 - B&B酒店,GreenEdge Cycling和FDJ - Suez。XERT引入了一个耐久性指标,可在长途骑行期间跟踪FTP变化,从而增强其训练平台功能。乘坐GPS启动协作路线计划功能,使多个用户可以同时处理路线。斯特拉瓦(Strava)收购了为跑步者提供的AI驱动教练应用程序Runna,可能为自行车运动的自适应培训计划铺平了道路。Hammerhead为其karoo计算机壳释放新的颜色选项(上升紫色,霜灰色和薄雾蓝色)。

Microsoft研究人员构建了具有2B参数的1位AI LLM - 型号很小,可以在某些CPU上运行

微软研究人员已经开发了B1.58 2B4T,这是一种开放式轻量级语言模型(LLM),其参数为20亿个参数。该模型仅允许三个值(-1、0,+1)允许使用三个值(-1、0,+1)的唯一功能,即使在CPU上也有效地运行,仅需要400MB的非填充内存,并且比较大模型所需的功率更少。尽管与更广泛的AI模型相比,精度较低,但Bitnet在基准测试中表现出色,并且可以通过拥抱脸进行实验。可以在GitHub上访问推理框架bitnet.cpp,对于其有效性能至关重要。

教学机器的语言:缩放大型语言模型以进行下一代单细胞分析

C2S尺度是一个开源大型语言模型(LLMS)的家族,旨在通过将基因表达谱转换为可读的文本,来解释单细胞RNA测序(SCRNA-SEQ)数据。该技术使自然语言与生物数据集的互动,使研究人员更容易访问和更易于理解。C2S尺度支持应用程序,例如预测细胞对治疗的反应,总结复杂的SCRNA-SEQ数据以及通过虚拟细胞建模加速药物发现。模型家族的规模从4.1亿到270亿个参数不等,为不同的研究需求和计算资源提供了灵活性。

现在,美国的大学生免费获得Google AI和2 TB存储的最佳资格

Google为包括2 TB存储的学生提供限时免费计划,并访问高级AI工具,例如Gemini Advanced,NotebookLM Plus和VEO 2,直到2026年春季决赛。此优惠涵盖了本学年和下一个学年,提供了深入的研究功能,音频概述,视觉思维地图以及图像和视频生成的创造力工具。学生可以在官方网站上通过Google一个AI高级计划注册。