全部新闻

“没有人希望人工智能失范”——Joost van Dreunen 谈人工智能的未来和游戏行业不断变化的经济状况

由于宏观经济变化,游戏行业正面临重大转变,影响着消费者和工人。SuperData Research 联合创始人、纽约大学斯特恩商学院教授 Joost van Dreunen 讨论了电子竞技投资降温、教育与游戏行业之间建立更好联系的必要性以及对人工智能在游戏开发中作用的担忧等挑战。Van Dreunen 强调了社区参与对技术奇观的重要性,并指出高科技解决方案与受众实际需求之间的脱节日益严重。他还强调,游戏行业缺乏从学术界到专业角色的明确途径,并讨论了最近大公司裁员的影响,这表明尽管面临经济压力,对游戏的需求仍将持续。

亚马逊的人工智能助手通过 Alexa.com 登陆网络 |TechCrunch

亚马逊推出 Alexa.com,使用户能够在线访问其人工智能数字助理。新网站正在向抢先体验客户推出,并将允许与其他人工智能聊天机器人进行类似的互动。亚马逊旨在通过关注家庭需求(包括智能家居控制和个性化推荐)来使 Alexa 脱颖而出。更新包括移动应用程序中更加“代理转发”的体验以及与 Angi、Expedia、Square 和 Yelp 等服务的集成。该网站具有针对常见任务的快速访问导航功能,并允许共享个人数据以便在家中进行集中管理。Alexa 和 Echo 副总裁 Daniel Rausch 强调了 Alexa 的独特产品,他指出 Alexa+ 的使用率有 76% 是其他人工智能助手无法复制的。

无论人工智能泡沫与否,这三只股票都是 1 月份值得买入的优秀长期股票杂七杂八的傻瓜

建立多元化的人工智能投资组合可以帮助投资者管理股市波动,Motley Fool 调查中 60% 的受访者预计专注于人工智能的公司将取得强劲的长期业绩。ASML、英伟达和微软分别因其在半导体制造、数据中心技术和综合人工智能解决方案方面的关键作用而被列为顶级人工智能股票。建议对整个人工智能价值链进行投资,以最大限度地提高利润潜力和投资组合弹性。

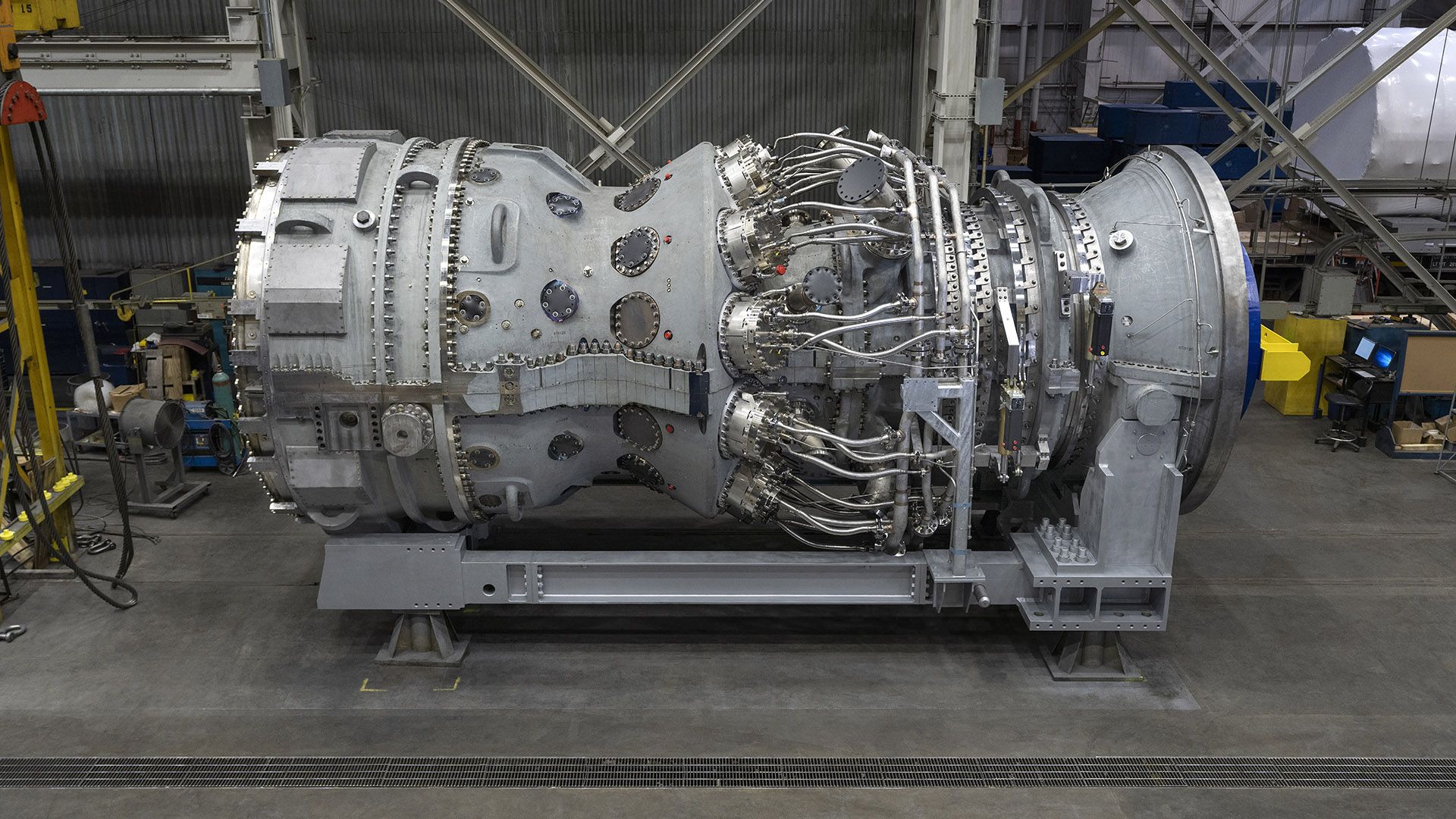

由于数据中心急于打开现场发电机,美国电网捉襟见肘——Meta、xAI 和其他科技巨头竞相解决人工智能无法满足的电力需求

科技巨头在推动人工智能进步时面临电力限制,导致巨大的电力需求。马克·扎克伯格 (Mark Zuckerberg) 在 2024 年 5 月强调了电力限制,促使微软等公司投资核解决方案,促使马斯克在数据中心使用燃气涡轮发电机。其他公司正在考虑通过小型模块化反应堆或离网系统进行现场发电。虽然这些解决方案提供了灵活性,但它们也面临着诸如允许延迟、维护问题和高成本等挑战。随着电网达到容量极限,人工智能公司可能会越来越依赖“能源即服务”模式。

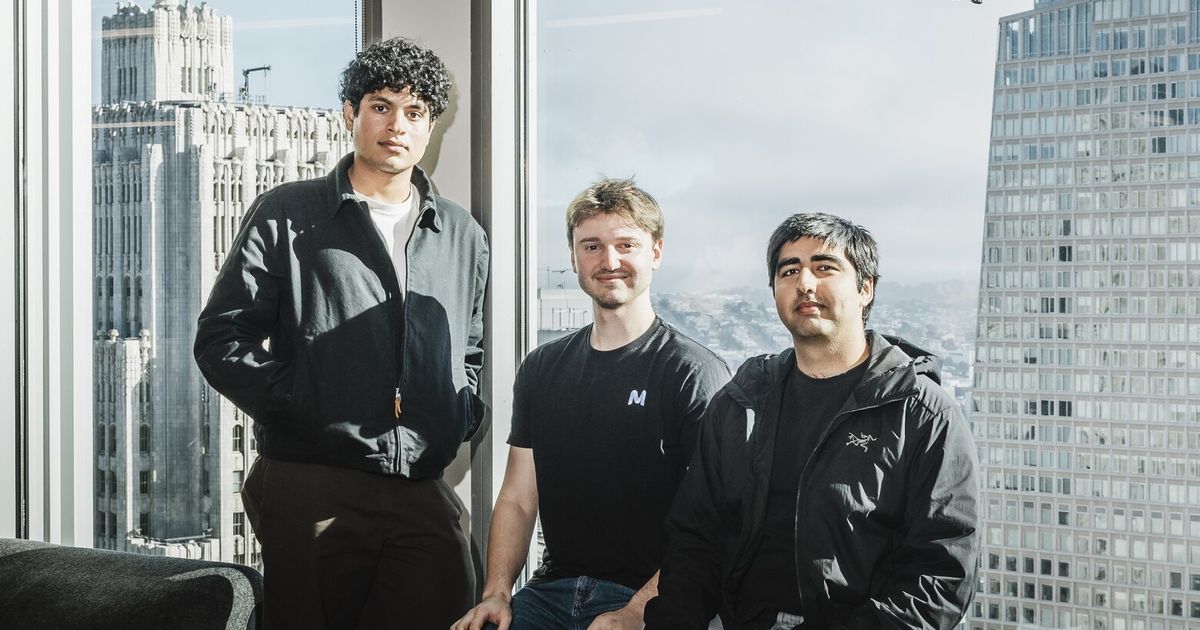

人工智能热潮中的新亿万富翁

人工智能 (AI) 的繁荣迅速创造了新的亿万富翁,并让 Nvidia 的 Jensen Huang 和 OpenAI 的 Sam Altman 等现有技术领导者致富。最近的人工智能初创公司,如 Scale AI、Cursor、Perplexity、Mercor、Figure AI、Safe Superintelligence、Harvey 和 Thinking Machines Lab 的估值迅速增长,几年内将其创始人变成了亿万富翁。这些创业者中很多人都在 40 岁以下,有些公司的创始人只有 20 岁出头,甚至更年轻。然而,如果初创企业不兑现承诺,人们仍然担心这些财富的可持续性。值得注意的是,大多数新晋人工智能亿万富翁都是男性,凸显了科技创业领域的性别差异。

这是未来 10 年最值得持有的人工智能 (AI) 股票之一

Iren 已与微软达成了一项价值 97 亿美元的协议,并为其数据中心管道获取了 3 吉瓦的电力,旨在解决人工智能云服务中日益严重的能源短缺问题。该公司获得大规模清洁电力的能力可能会随着签署更多合同而推动股价进一步增长。考虑到 Iren 的资产和近期交易的价值,其当前的市值被视为合理估值,有可能在未来十年带来可观的回报。

科罗拉多大学博尔德分校的学生新闻网站如何被人工智能接管

CU Independent 是一家由学生运营的报道科罗拉多大学博尔德分校的新闻媒体,它面临着来自一个模仿网站的竞争,该网站似乎使用人工智能生成的内容,并误导读者认为它是官方网站。真正的 CUI 现在位于 cuindependent.org,警告用户注意 cuindependent.com 上的这个欺诈网站。学生们花了自己的钱试图解决这个问题,建立一个新网站,并寻求法律帮助,包括根据域名争议政策提出投诉。记者担心,假冒网站正在损害他们的声誉,并可能从误导性流量产生的广告收入中获益。该案例凸显了学生出版物的网络安全管理问题以及人工智能生成的在线内容带来的挑战。

用于人工智能驱动的搜索可见性的 90 天 SEO 手册

由于人工智能驱动的搜索体验,SEO 现在面临挑战,传统的排名和流量指标的相关性较低,因为页面是在没有点击的情况下进行总结和引用的。SEO 团队需要一个新的剧本来提高生成输出的可见性。这个为期 90 天的行动计划概述了定义 AI 搜索主题、创建 AI 友好的内容结构、优化 AI 答案 (GEO/AEO)、加强 E-E-A-T 信号、构建值得引用的页面以及优化文本之外的阶段以有效跟踪 AI 可见性。该计划强调内容的清晰度、结构和权威性,以增强人工智能驱动的搜索环境中的可见性。搜索引擎优化

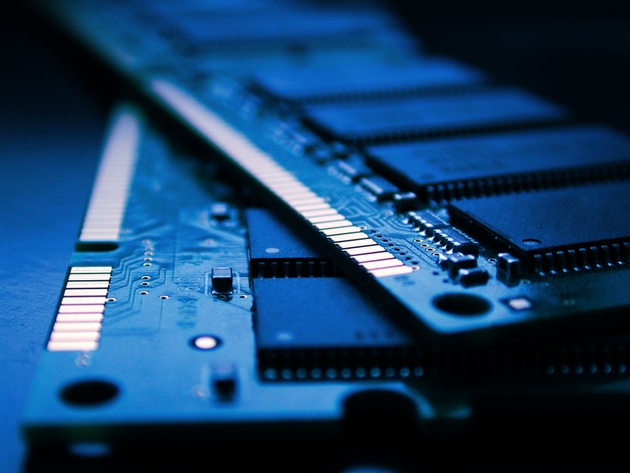

由于人工智能热潮影响供应,三星和 SK 海力士希望将服务器 DRAM 价格提高最多 70%

据《韩国经济日报》报道,由于人工智能需求增长影响了全球供应,三星电子和 SK 海力士计划在第一季度将服务器内存价格提高最多 70%。

聊天机器人现在会见你:如何训练人工智能来发现任何语言的心理健康问题

坎帕拉布塔比卡医院的通话被用来训练人工智能算法,该算法将为非洲当地语言的治疗聊天机器人提供支持。麦克雷雷大学人工智能实验室负责人乔伊斯·纳卡通巴-纳本德教授正在领导该项目,旨在解决非洲精神卫生工作者短缺和耻辱障碍的问题。该聊天机器人旨在提供更快的护理服务,并识别严重情况的早期迹象,以便将情况升级给专家。该倡议由威康信托基金资助,有助于缓解全球心理健康劳动力缺口。然而,随着当局致力于制定框架以确保人工智能工具安全有效,监管挑战仍然存在。