全部新闻

人工智能可以成为财务顾问的超级力量

财务顾问正在利用人工智能为客户提供个性化服务,通过将建议与个人价值观和财务目标保持一致来增强关系。根据 American Century Investments 的一份报告,近 40% 的美国投资者将社会或环境影响置于回报之上,这影响了顾问对可持续基金讨论的方式。人工智能工具通过来自各种来源(包括在线行为和账户交易)的数据分析,在获取客户之前实现个性化外展,并在入职后持续适应。这项技术可以实现及时、相关的沟通,使复杂的财务建议更容易获得,特别是对于继承大量财富的年轻一代来说。最终,人工智能驱动的个性化在 DIY 投资时代至关重要,通过提供量身定制、价值一致的服务,确保顾问始终不可或缺。

为 Messenger 通话引入 AI 背景、高清视频通话、噪音抑制等功能 |元

Facebook 正在通过新的通话功能增强其 Messenger 服务,包括用于视频通话的人工智能背景、具有噪声抑制功能的高清视频通话、音频和视频语音消息以及免提通话功能。这些更新旨在使通话体验更加个性化、可靠且有吸引力。用户可以使用人工智能生成的图像自定义视频通话背景,并在朋友不在时留下语音消息。此外,当用户双手被占用时,还可以通过 Siri 发起呼叫和发送消息。

Pokémon Go 玩家在不知不觉中训练人工智能自动完成现实世界 - IGN

Pokémon Go 的开发商 Niantic 正在创建一个大型地理空间模型 (LGM),利用人工智能根据有限的信息预测现实世界的位置。LGM 将使用从 Pokémon Go 玩家收集的数据进行训练,旨在支持 AR 眼镜和机器人等技术。Niantic 已经在全球范围内收集了 1000 万个扫描位置,并每周接收 100 万个新扫描,这些扫描用于开发其视觉定位系统 (VPS),以实现数字内容叠加的厘米级精度。

谷歌的人工智能错误猎人嗅出了两打以上的代码缺陷

Google 的 OSS-Fuzz 项目利用大型语言模型 (LLM),已识别出 26 个漏洞,其中包括 OpenSSL 中的一个严重缺陷。OpenSSL 错误 (CVE-2024-9143) 于 9 月报告并于 10 月修复。谷歌声称其人工智能驱动的模糊工具可以检测人类驱动方法无法检测到的问题,凸显了人工智能在发现长期存在的安全缺陷方面的潜力。Microsoft 的 365 Copilot 和 Protect AI 的 Vulnhuntr 都是使用 AI 查找漏洞的工具。谷歌的目标是通过法学硕士实现模糊测试过程的完全自动化,并计划尽快为检测到的漏洞生成建议的补丁。

AI 模拟 1000 人,准确复制他们的行为

研究人员使用 ChatGPT 背后的技术 GPT-4 复制了 1000 多人的性格和行为,作为焦点小组和民意调查的替代方案。斯坦福大学的实验旨在比传统统计模型更准确地预测政策影响。这项研究引起了对模仿个体的伦理担忧。

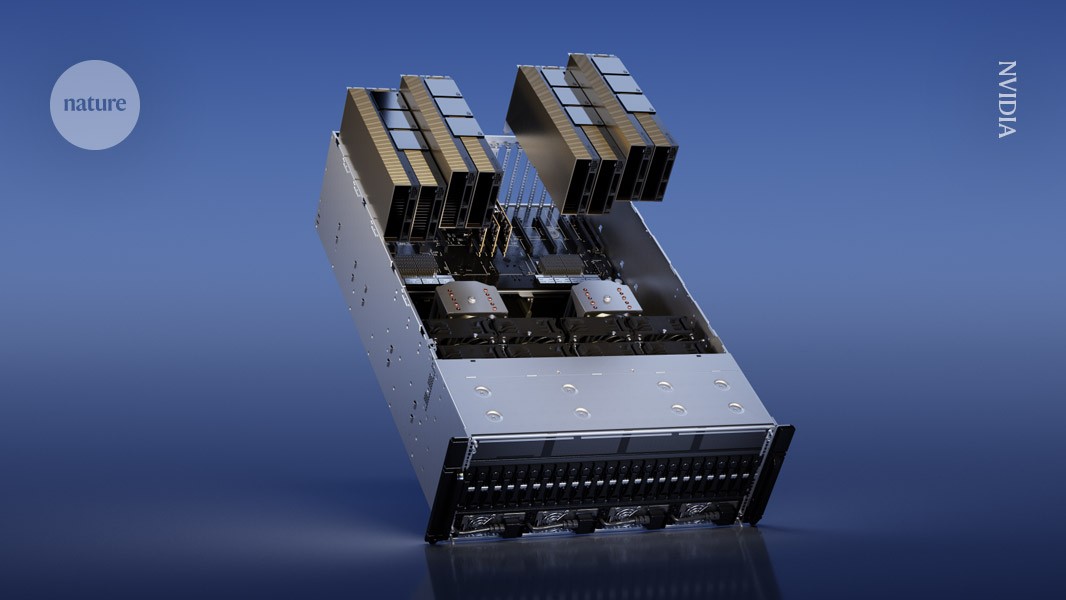

人工智能的计算差距:学术界无法获得研究所需的强大芯片

预印本服务器 arXIV 上发布的一项调查显示,许多大学科学家对人工智能研究的计算能力不足感到沮丧,尤其是无法使用 NVIDIA H100 等先进 GPU。学术和行业资源之间的这种差距阻碍了大型语言模型和其他人工智能进步的发展。研究人员表示,虽然学者面临更长的等待时间和有限的硬件,但他们仍然可以利用现有资源进行有效的培训,强调竞争性学术研究环境对于长期技术增长的重要性。

AlphaQubit 解决了量子计算的最大挑战之一

谷歌 DeepMind 和谷歌 Quantum AI 开发了 AlphaQubit,这是一种基于人工智能的解码器,能够以前所未有的精度识别量子计算系统中的错误。该系统使用神经网络比现有方法更有效地纠正错误,特别是在规模上,这标志着使量子计算机在药物发现和材料设计等实际应用中可靠的重要一步。尽管准确性很高,但 AlphaQubit 仍然面临实时纠错速度的挑战,需要进一步提高机器学习和数据效率。

为了减轻 Gen AI 的风险,请利用团队的集体判断

组织必须采用生成式人工智能的第三层风险管理:基于团队的判断,包括集体判断、领域判断和反思判断。这种方法有助于评估产出、将决策委托给专家,并定期反思经验,以适应不断发展的人工智能格局并减轻未来风险。

美联储指控曾经备受赞誉的 AllHere AI 创始人参与 1000 万美元计划诈骗投资者

AllHere 为学校开发 AI 聊天机器人,该公司面临破产,联邦检察官以证券和电汇欺诈罪起诉 AllHere 创始人兼前首席执行官乔安娜·史密斯-格里芬 (Joanna Smith-Griffin),涉嫌诈骗投资者近 1000 万美元。史密斯-格里芬被指控歪曲财务数据以获取资金并将公司资金用于个人开支。起诉书还涉及身份盗窃的指控。AllHere 与洛杉矶联合学区签订了合同,负责构建人工智能聊天机器人,但该项目因财务问题和对公司交易的调查而停止。

沉默的掠食者:在生成人工智能时代保护儿童

本文讨论了生成式人工智能系统生成儿童性虐待材料 (CSAM) 的复杂问题及其带来的法律挑战。以下是要点总结:1. **虚构场景介绍:**- 8 岁女孩阿德里安娜 (Adrianna) 的故事实际上因人工智能生成的图像而受到虐待,这说明了生成人工智能系统在现实世界中带来的危险。2. **当前的法律框架和挑战:**- 现有法律,例如 18 U.S.C.§§ 2256 和 1466A 将制作或传播 CSAM 定为刑事犯罪,但基于实际受害者。- 最高法院在纽约诉费伯案中的裁决将儿童色情制品排除在第一修正案保护之外,因为其危害严重且缺乏价值。3. **生成式人工智能作为一种新威胁:**- 生成式人工智能系统生成不涉及真实儿童的内容,这使得根据现行法律很难进行法律起诉。- 没有真正的儿童参与人工智能生成的 CSAM 的创建,这引发了关于如何合法起诉涉及不存在受害者的犯罪的问题。4. **所需的法律类比和解释:**- 与言论自由联盟的类比,其中虚拟描述(没有真正的犯罪参与)被认为是有害言论。5. **第230条人工智能系统的豁免漏洞:**- 法院裁定,当平台的算法创建有害内容时,第 230 条平台不受保护。- 根据 Ferber 的裁决,平台策划 FYP 内容纯粹是第三方行为,在安德森诉 Tiktok 案中,算法内容被裁定为非法。6. **提议利用人工智能操纵真实儿童图像并添加虚假色情内容:**- 这说明,根据 230 和言论自由挑战,即使使用没有真实未成年人的合法图像也是非法的。7. **人工智能生成的 CSAM 的法律挑战:**- 对平台开发商进行起诉和辩论,最终被定罪。8. **结论和号召性用语:**- 政府、科技公司和个人必须合作解决这一问题上的法律漏洞。- 随着技术的快速发展,优先考虑儿童福利需要更严格的法规和问责制。### 要点:1. **虚构的虐待故事反映了生成式人工智能系统带来的现实世界危险:**2. 现有法律对非真实受害者生成的内容缺乏适用性。3. 法院必须平衡 230 的意图与让平台对合法生成的有害内容负责,满足更严格监管和加强执法的需要。4. 在技术快速进步的挑战中优先考虑儿童福利。这个问题凸显了随着技术的发展而调整法律框架的迫切需要,以确保根据费伯裁决的第一修正案遏制此类滥用行为。### 建议:- **全球合作:**- 立法措施和更严格执法方面的国际合作。- **技术责任:**- 科技公司必须让人工智能系统对有害内容和严格监管负责。- **法律框架调整:**- 测试证明淫秽案件,法院会认定该作品诉诸淫欲;(2) 根据州法律描述明显具有攻击性的性行为;(3)缺乏严肃的价值。通过解决这些差距和调整法律框架,我们可以更好地保护儿童免受生成人工智能带来的新威胁,同时维护言论自由原则。