全部新闻

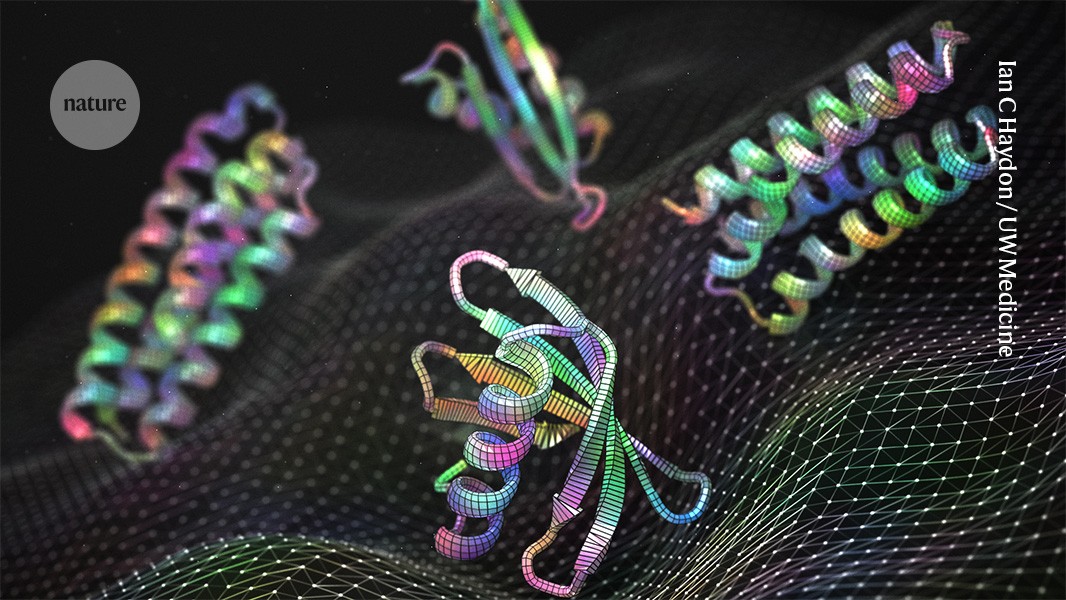

仍然挑战人工智能的五个蛋白质设计问题

本文讨论了计算蛋白质设计的最新进展,重点介绍了人工智能 (AI) 如何彻底改变蛋白质结构和功能的预测。以下是文本中的要点:1. **计算设计的进步**:- 像 Elizabeth Tsai 这样的研究人员正在使用机器学习来预测蛋白质如何折叠成其活性形状。- 蛋白质可以设计为具有特定的特性,例如通过添加某些结合配偶体在两种构象之间切换的能力。2. **挑战和限制**:- 由于缺乏多样化的数据,现有的算法在应用于不同的蛋白质类别时常常会遇到困难。- 设计像酶这样的复杂分子机器需要了解当前人工智能模型可能无法完全捕获的构象动力学。3. **实际应用**:- 第一个由计算设计的蛋白质制成的医疗产品 SKYCovione(一种 COVID-19 疫苗)已获准在韩国和英国使用。- 研究人员正在探索可以将药物或毒素携带到细胞中或隔离不需要的分子的纳米颗粒。4. **构建复杂的分子机器**:- 设计细菌鞭毛等复杂结构需要人类的聪明才智和计算工具的结合。- 分子开关、轮子、轴和逻辑门等组件正在被创建以形成复杂的蛋白质机器。5. **从失败中学习**:- 该领域在物流方面举步维艰;尽管进行了大量的计算机模拟测试,但算法仍然经常失败。- 阴性结果可以提供有价值的信息,但很少发表。- 计算科学家和实验学家之间的合作对于进步至关重要。6. **未来方向**:- 研究人员强调需要弥合计算预测和生物验证之间的差距。- 该领域受益于开放合作和共享知识,加速了蛋白质设计的进步。总的来说,这篇文章强调了人工智能如何改变我们理解和创造蛋白质的方式,其潜在应用范围从医疗到纳米技术。

Meta 的核动力人工智能数据中心计划因稀有蜜蜂而受阻

《金融时报》提供各种数字订阅选项,包括按月、按季度和按年的套餐,具有不同的访问级别,例如基本数字访问、FT 数字版和高级数字版。优惠范围从每月 39 美元的基本访问权限到每月 75 美元的高级访问权限,每年预付款可享受 20% 的折扣。还提供为期 4 周 1 美元的试用优惠,然后每月 75 美元。

人工国家

文本概述了过去几十年来技术(特别是人工智能和社交媒体平台)如何影响政治沟通和治理的历史进展和批评。关键主题包括:1. **政治领域早期采用技术**:肯尼迪竞选团队使用 Simulmatics Corporation 使用 IBM 704 计算机预测选民行为,标志着从传统方法到数据驱动决策的重大转变。2. **对政治互动和信任的影响**:随着时间的推移,对技术的依赖加剧了美国人的两极分化、对政府的信任度降低、孤独、愤怒、容易受到错误信息和阴谋论的影响。3. **通过技术提升民主的承诺**:- 在 20 世纪 70 年代,斯图尔特·布兰德 (Stewart Brand) 设想个人电脑可以增强个人能力。- 主要新闻机构在线民意调查的兴起改变了传统的新闻实践。- 早期的互联网爱好者,如《连线》杂志,预测数字技术将促进宽容和社区。4. **现代现实与承诺**:尽管有这些乐观的预测:- Twitter 和 Facebook 等社交媒体平台在塑造公共话语方面已占据主导地位,但它们是私人控制的公司,不致力于民主治理。- 马克·扎克伯格将公司利益置于国家利益之上的理念引发了人们对言论自由控制的担忧。- 包括 TikTok 在内的新兴社交媒体公司涉嫌宣扬政治极端主义和破坏民主,尽管用户的看法恰恰相反。5. **对企业对公共话语控制的批评**:叙述强调,虽然这些平台声称是民主化工具,但它们从根本上是由利润动机驱动的,而利润动机往往与民主价值观相冲突。这一批评凸显了技术承诺与现实之间在如何影响公众舆论和公民参与方面的紧张关系。总体而言,该文本反对对技术在加强民主方面的作用的天真乐观,并指出对科技公司对政治沟通和治理的影响进行更严格的审查。

芯片巨头英伟达希望将机器人引入医院

Nvidia 的目标是通过 X 光、布草运送等机器人将“物理人工智能”融入医院,作为其主导先进机器人市场战略的一部分。该公司今年在数字健康领域进行了多项投资和合作,包括虚拟护理和药物发现。Nvidia 医疗保健副总裁 Kimberly Powell 设想未来医疗设备将成为智能机器人,将医院转变为人工智能驱动的环境。该公司正在与初创公司和医疗机构合作开发这些技术,但全面采用可能需要几年时间。

谷歌声称人工智能发现 0-Day 安全漏洞是世界第一

谷歌的 Big Sleep 团队首次使用人工智能发现了一个零日漏洞,在广泛使用的开源数据库引擎 SQLite 中发现了一个可利用的内存安全漏洞。这一发现于 11 月 1 日公开,凸显了人工智能在安全研究中的潜力,特别是在识别模糊测试等传统方法可能遗漏的漏洞方面。该漏洞已于 10 月份向 SQLite 团队报告并由 SQLite 团队修复。谷歌认为这是通过人工智能驱动的分析增强网络威胁防御能力的重要一步。

追随苹果的脚步,微软可能将其 Windows AI 功能重新命名为“Windows Intelligence”

根据 X(以前的 Twitter)上出现的一份文件,微软正在考虑将其 Windows 中的人工智能功能重新命名为“Windows Intelligence”,类似于苹果公司的“Apple Intelligence”做法。此前,微软最近更新并大幅改变了 Copilot,导致用户不满。潜在的品牌重塑可能表明微软专注于在 Windows 生态系统内以统一品牌巩固其人工智能工作。

企业希望借助人工智能来弥合网络技能差距,但仍达不到要求

ISC2 网络安全劳动力研究报告显示,全球网络安全劳动力同比增长 0.1%,低于去年的 8.7% 增幅。预算限制被认为是人员短缺的主要原因,组织转向自动化和人工智能来解决技能差距。尽管人们对人工智能增强安全性的潜力持乐观态度,但专家警告称,由于对可靠性和成本的担忧,它不能完全取代熟练的专业人员。近一半的受访者团队已经使用人工智能,但需要提高技能才能有效地整合这些技术。尽管人工智能的采用具有预期的好处,但该研究强调了人才获取方面持续存在的挑战。

谷歌人工智能工具 Big Sleep 发现 SQLite 数据库引擎中的零日漏洞

谷歌使用其名为 Big Sleep 的人工智能辅助框架在 SQLite 中发现了一个零日漏洞,这标志着人工智能代理在现实世界中发现的第一个漏洞。该缺陷是堆栈缓冲区下溢,已通过负责任的披露在成为正式版本的一部分之前得到解决。Google 推出了 Project Naptime(现在的 Big Sleep),通过利用大型语言模型的代码理解和推理功能来增强自动化漏洞检测。虽然谷歌看到了这种方法的巨大防御潜力,但他们指出,该方法仍处于实验阶段,在有效性上可能尚未超越目标模糊器。

尽管存在不确定性,首席信息官仍希望加强人工智能治理

由于创新的快速发展和监管混乱超过了正式标准,IT 领导者正在开发内部方法来减轻人工智能风险。随着生成式人工智能从概念验证转向生产,首席信息官面临着实施人工智能治理政策的压力。尽管有各种可用的框架,包括 NIST 的人工智能风险管理框架和欧盟人工智能法案条款,组织仍需要量身定制的内部政策。TruStone Financial Credit Union 和 Travelers 等公司正在创建工作组和负责任的人工智能框架,以确保透明度、公平性和成本控制。实施人工智能治理平台被认为对于减少道德事件和管理与影子 IT 使用人工智能工具相关的风险至关重要。人工智能法规的不断演变和 ACI 的出现使 CIO 适应治理框架的挑战进一步复杂化。

人工智能工作者寻求举报人掩护以揭露新出现的威胁

人工智能公司的工作人员正在推动国会对举报人提供具体保护,他们认为现行法律不允许他们合法揭露人工智能技术进步所带来的威胁。哈佛大学法学教授劳伦斯·莱西格(Lawrence Lessig)强调了潜在风险,并批评了科技公司可以自我监管的观念。参议员埃德·马基 (Ed Markey) 正在考虑将举报人保护纳入即将出台的人工智能立法中。斯蒂芬·科恩等教授和专家强调国会有必要建立此类保护措施,因为如果不采取立法行动,法院不太可能进行干预。参议员查克·格拉斯利 (Chuck Grassley) 和罗恩·怀登 (Ron Wyden) 主张制定更明确的法规,以加强不断发展的人工智能行业的问责制。然而,由于担心其严格性,加州旨在保护人工智能举报人的法案等努力被否决。工人们在试图揭露公司内部问题时担心遭到报复和缺乏法律明确性。