全部新闻

人工智能的短暂辉煌日子 - SiliconANGLE

人工智能短暂的辉煌日子 本周参加阿姆斯特丹的世界人工智能峰会给了我一种似曾相识的感觉,让人回想起20世纪90年代末的InternetWorld会议。就像那些活动一样,世界人工智能峰会展现出了一种矛盾的组合,既有商业解决方案又有技术展示,仿佛人们无法决定他们想要从一个以AI为中心的会议上得到什么。我们如何才能让AI服务于人类,而不是反过来?令人兴奋但短暂的人工智能会议生命周期 到了2000年,InternetWorld已经从地球上最热门的门票变成了一场专注于电子邮件营销和其他平凡服务的悲哀聚会。照片:Jason Bloomberg 您的支持对我们很重要,它有助于我们保持内容免费。

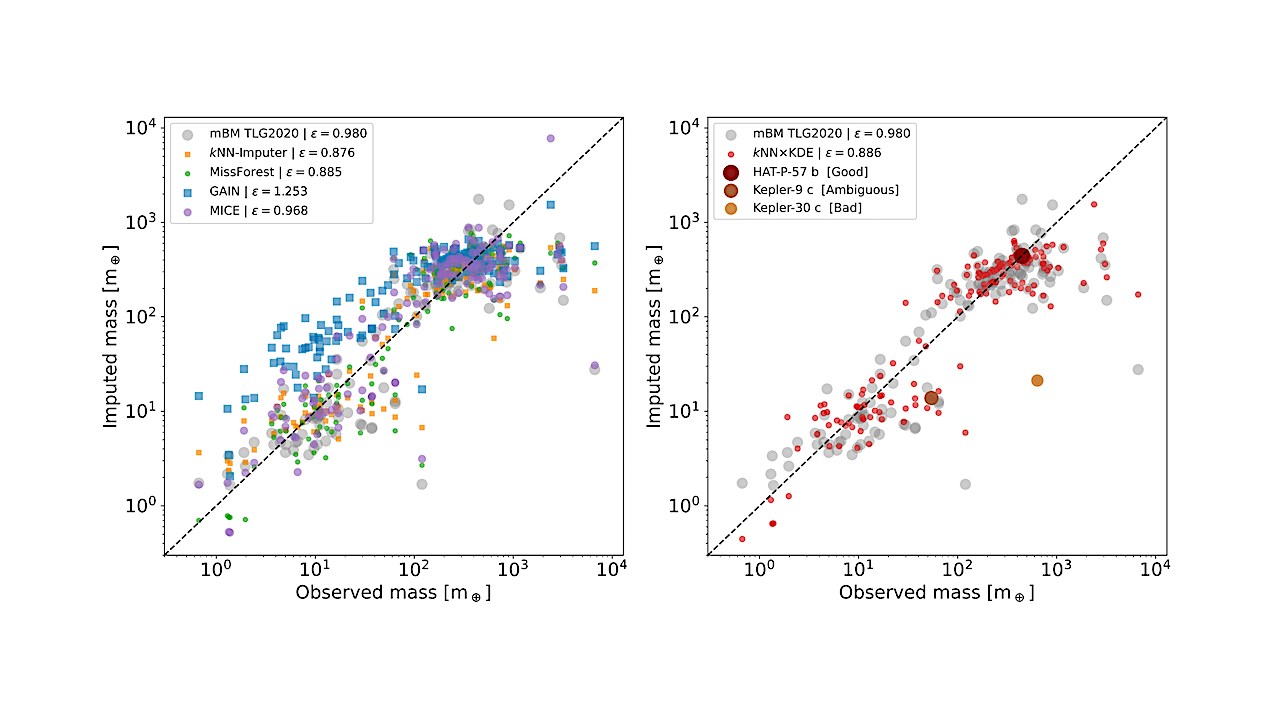

利用机器学习在不完整数据集上估算系外行星质量——天体生物学

状态报告 右图显示了mBM代码和kNN×KDE算法观测质量与推断质量之间的比较。图例显示了所有150个绘制行星的平均误差。我们发现,即使额外数据不完整,随着数据量的增加,推断结果也会改善,并且可以对任何行星进行质量预测,无论已知哪些属性。已被《天体物理学开放期刊》接受发表。 主题:地球和行星天体物理学(astro-ph)

NVIDIA AI峰会小组讨论概述了自动驾驶安全议题

自主驾驶行业由快速的技术进步和制定标准规范的需求塑造,以确保自动驾驶汽车(AV)及其与人类驾驶车辆互动的安全性。“提高道路上的安全性至关重要,”夏皮罗说道,并指出NVIDIA已经与汽车行业合作超过二十年,包括先进驾驶员辅助系统和完全自动驾驶技术的开发。NVIDIA在AV开发方面的做法是以集成三台计算机为中心:一台用于训练AI,一台用于模拟以测试和验证AI,还有一台安装在车辆中,实时处理传感器数据以做出安全驾驶决策。MITRE将使用Mcity的仿真工具以及其Mcity测试设施的数字孪生模型,在其数字试验场中提供一个真实的AV测试环境。“这就是仿真的美妙之处,”夏皮罗说。

顶尖的“第二阶段”人工智能基础设施股票,仍然具有高度信心(NYSEARCA:ARTY)

imaginima/iStock via Getty Images 投资者继续对那些持续在人工智能及其相关基础设施上投入的股票持有坚定信心。高盛表示,AI 实施分为四个阶段,首先是英伟达(NVDA),其次是基础设施,然后是推荐的您相关的赋能阶段

研究表明,人工智能并不一定能在临床实践中提高效率

实施人工智能后的典型工作流程。特别是在基因组学、病理学和放射学等数据密集型领域,AI已经被用于识别大量数据中的模式并优先处理病例,但在效率提升方面的可靠数据却很少。“我们想找出AI解决方案在医学影像中实际提高效率的程度,”该研究的主要作者、波恩大学UKB患者安全研究所(IfPS)的博士生Katharina Wenderott解释道。“然而,由于研究设计和技术使用的异质性,难以进行统一评估。除了为私人学习或研究目的合理使用外,未经书面许可不得复制任何部分。

分析大约7500万篇出版物发现,运用人工智能的论文更有可能成为“热门论文”

衡量人工智能在科学研究中的直接应用。自2015年以来,各学科研究中的人工智能使用量不断增加,这可以通过出版物的标题或摘要中提及与人工智能相关的术语(如“人工智能”、“深度学习”和“卷积神经网络”)来体现。“虽然科学领域中人工智能的应用已经迅速发展,但在每个学科内针对未来科学家进行人工智能技能培训的教育重点却滞后了,”高说。“女性和少数族裔受益最少,那么我们如何缓解这些人口统计数据上的差异?”研究团队的分析支持这样一种假设:领域专家与AI研究人员之间的合作可能是促进跨科学领域的AI应用并填补AI使用与AI培训之间差距的一种有意义的方式。

有一个未来,在那个未来里,你和你的显卡决定游戏的画面效果,而不是开发者决定。

那个充满照片般真实感的游戏天堂。《半条命》搭配极致逼真画面的第三代视频到视频Runway ML人工智能 - YouTube 观看 好的,上述任何一项都不是容易实现的,甚至在处理低延迟用户输入与预渲染视频时也未必是明确可以达成的目标,但如果这些成为我们游戏世界的现实,将会与我们现在所处的世界大不相同。我也很期待使用这样的技术来玩以前的老游戏会是什么样的体验。或者更有趣的是,可能会有一整套完全不同的视觉效果。戴夫从ColecoVision上的Zaxxon和Lady Bug时代就开始玩游戏了,并且还编写过Commodore Vic 20(《死亡赛车2000》!)的代码书。

Instagram 将一些审核问题归咎于人工审核员,而非人工智能 | TechCrunch

Instagram负责人亚当·莫斯里周五就 moderation 问题发表了讲话,这些问题导致 Instagram 和 Threads 的用户失去了对其账户的访问权限、帖子消失等。他表示公司“发现了错误”,这些错误归因于人工审核员。在 Threads 上的一篇帖子中,莫斯里回应了过去几天来困扰社交平台的问题,并补充说到目前为止发现的错误是由于内容审查人员——人而不是自动化系统,在没有提供对话上下文的情况下做出判断,“这是失误。”例如,前《华尔街日报》科技专栏作家沃尔特·莫斯伯格指出,他在 Threads 上的互动迅速降至零。他以一条信息结束了他的帖子,暗示问题可能尚未完全解决,并补充说:“感谢您的耐心,请继续反馈。”更新于 11/11/24, 13:20 美东时间,包含来自 Instagram 的进一步评论。

我是AlphaFold(获得诺贝尔奖的)AI的测试者——它将彻底改变健康研究。

由谷歌的人工智能研究实验室DeepMind创建的深度学习机器AlphaFold已经正在改变我们对支撑健康和疾病分子生物学的理解。如果你没有听说过AlphaFold,你可能很难体会到它对于研究人员来说有多么重要。核磁共振是少数几种可以探测运动中的分子的技术之一,而不是将它们固定在晶体或电子显微镜网格上。里夫卡·伊萨科森 提供(不得重复使用) 成瘾性体验 2024年3月,DeepMind的研究人员来找我测试AlphaFold的最新版本AlphaFold3,当时这个软件即将发布。在其他情况下,结果仍然模棱两可。

硅谷正在讨论是否应允许AI武器决定杀人 | TechCrunch

九月底,Shield AI 的联合创始人 Brandon Tseng 发誓美国的武器永远不会是完全自主的——这意味着不会由人工智能算法来做出最终杀死某人的决定。五天后,Anduril 的联合创始人 Palmer Luckey 表达了对自主武器持开放态度——或者至少是对反对自主武器的观点表示强烈怀疑。“当被要求进一步评论时,Anduril 发言人 Shannon Prior 表示,Luckey 并不意味着机器人应该编程为自行杀死人们,他只是担心“坏人使用坏的 AI。”去年,美国发布了更新版的军事人工智能安全指导方针,得到了许多美国盟友的认可,并且要求高级军事官员批准任何新的自主武器;然而这些指南是自愿遵守的(Anduril 表示将遵循该指南),并且美国官员一直在不断表示现在“还不是考虑对自主武器实施强制性禁令的时候”。他鼓励政策制定者采用更加灵活的方法来确定武器中使用的人工智能比例。