从您打开社交媒体供稿的那一刻起,您就进入了一个数字战场,并非所有政治信息都是他们的样子。

即将举行的联邦大选将涌入大量的深击图像和量身定制的叙述,使事实与虚构之间的界限模糊。

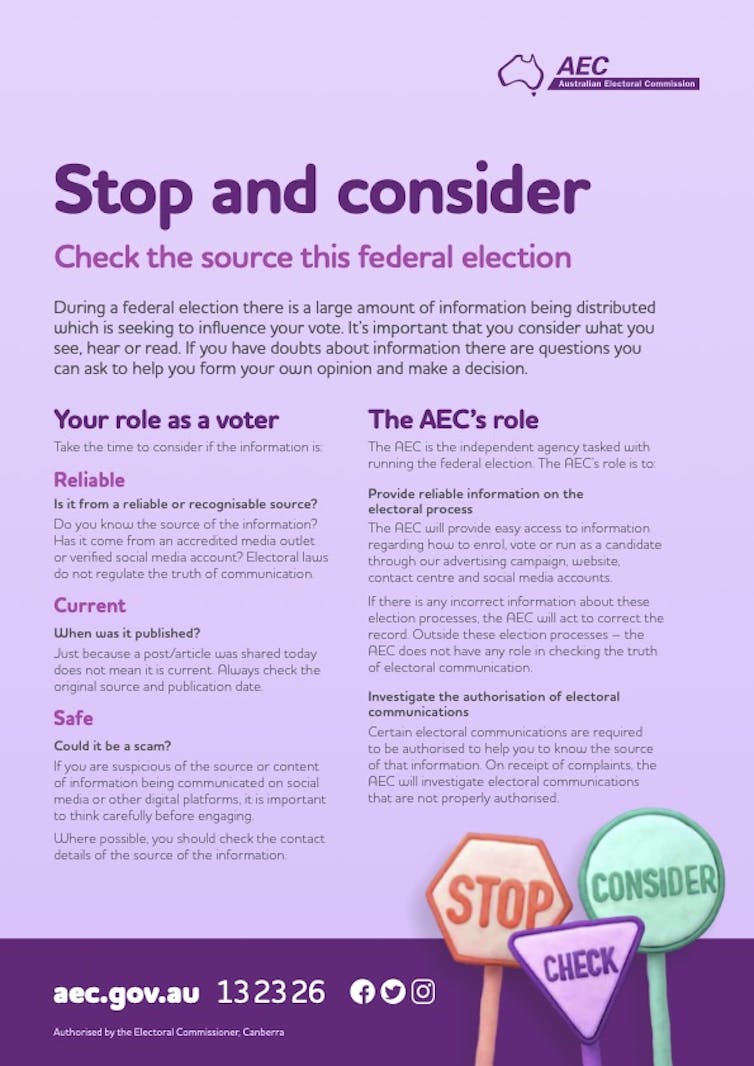

上周,澳大利亚选举委员会(AEC)重新启动了停下来考虑活动。该竞选敦促选民停下来反思,特别是关于如何投票的信息。但是它的信息适用于所有形式的错误信息。

AEC专员Jeff Pope警告:

在接下来的几个月中,必须举行联邦大选,因此,现在是鼓励所有澳大利亚人在他们看到,听到或阅读时都具有健康的怀疑的最佳时机。

该广告系列中概述的简单指令旨在减慢误导信息在数字时代的传播,在数字时代,算法迅速促进参与度。

那么,有可能帮助选民从假货中筛选真实的有效呢?尽管该活动受益于AEC的信誉及其可访问的信息,但它也面临着重大障碍。

数字欺骗

2024年,AI对国际政治运动产生了显着影响。

在美国,联邦通讯委员会罚款政治顾问600万美元用于精心编排的伪造机器人,其中包含AI生成的乔·拜登(Joe Biden)声音的深层演出。

在印度2024年选举期间,Meta(拥有Facebook)批准了AI-Aniped Ads传播虚假信息和仇恨的广告。这加剧了分裂的叙述,无法调节有害内容。

同时,澳大利亚工党部署了AI生成的视频反对派领导人彼得·达顿(Peter Dutton)是其在线努力的一部分。

此外,自由党还有再次订婚二人组Topham Guerin,他们以使用AI和有争议的政治策略而闻名。

政治领导人越来越多地转向像Tiktok这样的平台吸引选票。但是Tiktok for用户的问题之一是,它鼓励无尽的滚动,并可能导致用户错过微妙的不准确性。

增加这些问题是最近的骗局流传了塑造的图像和制作的名人头条。它产生了合法性的幻想,并欺骗了许多澳大利亚人的钱。

这些事件明显地提醒了数字操作能够误导的速度,无论是在商业骗局还是政治消息中。

但是我们是否认真对待吗?

韩国采取了在政治运动中反对AI生成的深击的决定性立场通过完全禁止他们。处罚包括最高七年监禁或5000万韩元的罚款(55,400美元)。该措施构成了一个更广泛的法律框架的一部分,旨在实施透明度,问责制和道德AI使用。

在澳大利亚,蓝绿色独立人士呼吁更严格政治广告法中的真相。拟议的法律旨在以误导政治广告(包括虚假信息和仇恨言论)判处民事处罚。

但是,打击由匿名或未知方创建的错误信息,例如AI生成的深击,仍然是一个挑战,仍然是一个挑战可能需要进一步的监管措施和技术解决方案。

在事实核对方法本身陷入困境的时候,所有这些都在展开。一月份,Meta在美国取消了其第三方事实检查计划,成为头条新闻。这样做是为了获得社区笔记系统。首席执行官马克·扎克伯格(Mark Zuckerberg)倡导了这一变化,以减少审查制度和保护自由表达。

然而,批评家警告说,没有独立监督,错误信息可能更容易传播,可能导致仇恨言论和有害的言论激增。数字政策的这些转变只会增加确保选民获得可靠信息的挑战。

那么,AEC的运动会产生任何影响吗?

在这些挑战中,停止和考虑竞选活动到了关键时刻。尽管有一再的电话到在学校课程中嵌入数字素养和社区计划,这些建议通常会闻所未闻。

该运动是一个积极的一步,在快速数字操作的时代提供了指导。简单的信息暂停和验证政治内容 - 可以帮助培养一个更具挑剔的选民。

但是,鉴于错误信息和复杂的定位技术的数量,仅此运动就不太可能成为银弹。政治运动越来越复杂。随着匿名深层攻击,选民,教育者,监管机构和平台的引入,必须共同努力,以确保事实在数字噪音中不会丢失。

数字素养的强大基础至关重要。不仅要使这项运动的工作,还可以帮助社会区分可信的来源和欺骗性内容。我们必须使未来的选民能够驾驭数字世界的复杂性并更充分地参与民主。

在全球范围内,各种策略提供了宝贵的见解。

尽管澳大利亚停下来考虑运动采取反思的方法,但瑞典Bli Inte Lurad倡议令人耳目一新。它警告公民:不要愚弄。

通过交付清晰,可操作的技巧,以发现骗局和误导性内容,瑞典模式利用其强大的公共教育和消费者保护传统。

这种胡说八道的策略加强了数字扫盲的工作。它还强调,保护公众免受数字操作的影响需要积极主动的教育和强大的监管措施。

澳大利亚监管机构可能是时候采取果断行动来保护民主的正直了。