AI为内部律师提供新的噩梦 - 高于法律

作者:Joe Patrice

我们已经进入了生成AI时代的两年令人尴尬的律师故事。这不是说这项技术可以执行有用的,节省时间的任务,只是除非基本突破像融合能量或量子计算一样,潜在的上限不是替代律师处理成绩单更快现在是时候以惊人但平凡的能力而欢喜,而不是松树,而不是像棕色酸在棕色酸上那样幻觉的自由智力劳动。

对于内部法律团队必须保持一致的非律师来说,这是两倍。

最新总法律顾问报告2025从FTI咨询和 相对论``确认这两年了,内部律师在很大程度上没有为生成AI带来的风险做好准备。

部分原因是他们的错。人工智能正在迅速移动,用户的工作也同样快地创造头痛。人们对面向消费者AI玩具的疑问的数量激增了一家公司一周内报告了32,000次命中。那就是一家律师事务所!将该使用率乘以数十亿美元的公司。无论律师如何试图将用户引导到具有真正安全和护栏的产品,新产品都将到达湿纸袋的安全完整性为了打扰这一指导。

在访谈中,有85%的人表示它们是最小或没有准备的,比上一年的93%略有改善。此外,生成的AI是唯一一个参与者中的唯一一个主题,其中一个参与者的AI准备就绪(以一对一的规模都没有准备好准备做好准备)。以这种速度,内部的律师才能做好准备,直到特朗普的第五任期之前。

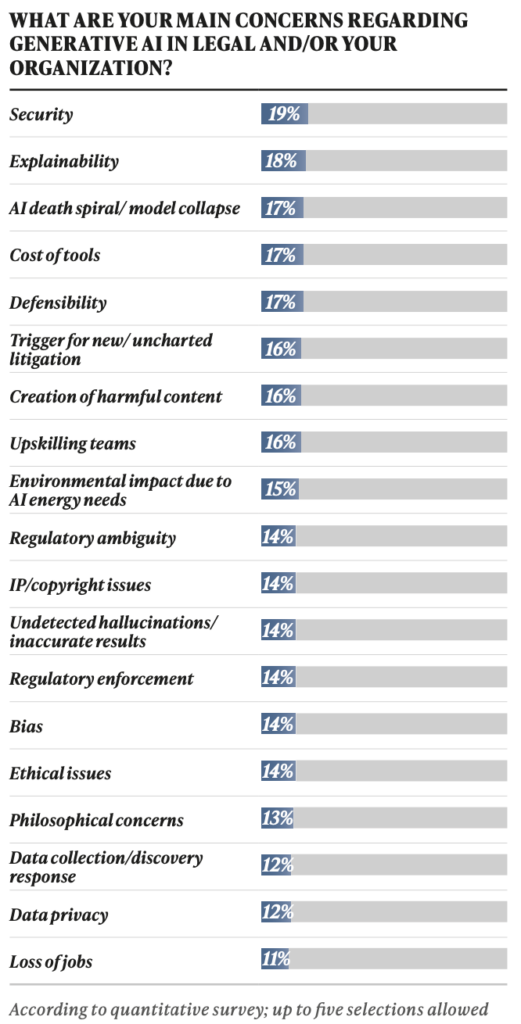

准备准备的另一个障碍是缺乏确切提出最大问题的共识:

底部失业。永远不要改变美国公司!

在AI方面,安全性和数据隐私是单独但重叠的问题。但是更糟糕的是,这些挑战仅限于AI使用。惊人的65%的GC表示,他们不准备处理屋顶下的所有新兴数据源,例如协作应用程序,云存储和链接内容。

一些受访者还报告说,数据泄露(21%)和侵犯隐私或通知的增加(18%)。这些数字与2024年的报告有所不同,当时有38%和21%的人指出违反和侵犯隐私行为的增加。数据隐私和DSAR也被评为造成争议和调查的第二和第三高的问题,分别列为主要驱动因素,分别为33%和29%。

虽然员工可能以多种方式将数据或途径曝光到公司系统中,但将机密的客户数据馈送到总部位于上海和gee之间的AI模型,但您不想知道'风险水平。

一位受访者说,更直截了当地说:“我害怕$ h!+更少的,如果我们受到审计,我们将因员工或患者如何传输数据而被发现不符合统一。”

较早:新的GC报告详细介绍了所有内部问题,例如就职日就不再重要

乔·帕特里斯(Joe Patrice)是法律和共同主持人的高级编辑像律师一样思考。随意 电子邮件任何提示,问题或评论。跟着他 叽叽喳喳或布鲁斯基如果您对法律,政治和健康的大学体育新闻感兴趣。乔也是RPN执行搜索董事总经理。

乔·帕特里斯(Joe Patrice)是法律和共同主持人的高级编辑像律师一样思考。随意 电子邮件任何提示,问题或评论。跟着他 叽叽喳喳或布鲁斯基如果您对法律,政治和健康的大学体育新闻感兴趣。乔也是RPN执行搜索董事总经理。