宣传:无形攻击威胁changpt和其他AI系统

作者:Pierluigi Paganini

宣传:无形攻击威胁changpt和其他AI系统

宣传:一种针对AI工具(例如Chatgpt和Gemini)的新威胁,通过简单的浏览器扩展,无需复杂的攻击。

一种新型的威胁令人震惊的是网络安全世界:它被称为“人类”,并且能够损害与领先的生成人工智能工具(例如Chatgpt,Gemini,Copilot和Claude)的互动。问题?它甚至不需要复杂的攻击:只需要进行浏览器扩展。

Layerx的研究表明,即使没有任何特殊许可,任何浏览器的扩展都可以访问商业和内部LLMS的提示,并为他们注射提示,以窃取数据,删除数据并涵盖其轨道。Layerx的研究人员Aviad Gispan解释说。https://layerxsecurity.com/blog/man-in-the-prompt-top-ai-tools-vulnerable-to-invistion/

点风信用

什么是宣传的人?

在此术语中,Layerx安全专家是指利用低估的弱点的新攻击向量:AI聊天机器人的输入窗口。当我们使用浏览器中的工具(例如ChatGpt)时,我们的消息将写在简单的HTML字段中,可从页面的DOM(文档对象模型)访问。这意味着任何具有访问DOM的浏览器扩展程序都可以读取,修改或重写我们的请求到AI,并在没有我们注意到的情况下这样做。扩展名甚至不需要特殊的许可。

chatgpt注射概念证明https://youtu.be/-qvsvvwnx_y

点风信用

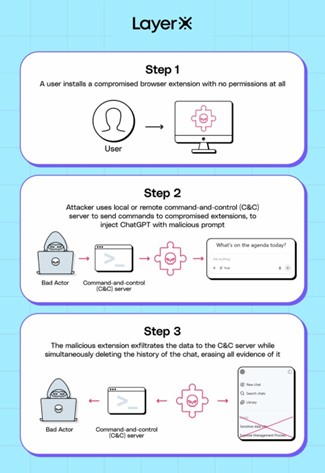

攻击的工作方式

- 用户在浏览器中打开ChatGpt或其他AI工具。

- 恶意扩展将拦截即将发送的文本。

- 修改了提示,例如,添加了AI响应中的隐藏说明(提示注射)或渗透数据。

- 用户收到看似正常的响应,但是在幕后,数据已经被盗或会话损害。

该技术已被证明可以使用所有主要的AI工具,包括:

- chatgpt(Openai)

- 双子座(Google)

- Copilot(Microsoft)

- 克劳德(拟人化)

- DeepSeek(中国人工智能模型)

具体的风险是什么?

根据该报告,潜在的后果是严重的,尤其是在商业世界中:

- 盗窃敏感数据:如果AI处理机密信息(源代码,财务数据,内部报告),则攻击者可以通过修改的提示阅读或提取此信息。

- 响应的操作:注射的提示可以改变AI的行为。

- 绕过安全控制:攻击发生在将提示发送到AI服务器之前,因此它绕过防火墙,代理和数据丢失预防系统。

根据Layerx的数据,99%的企业用户在其浏览器中至少安装了一个扩展名。在这种情况下,风险暴露很高。

我们能做什么

适用于个人用户:

- 定期检查安装的扩展名并卸载那些不需要的扩展名。

- 请勿从未知或不可靠来源安装扩展。

- 尽可能限制扩展权限。

对于企业:

- 阻止或主动监视公司设备上的浏览器扩展。

- 尽可能将AI工具与敏感数据隔离。

- 采用监视DOM并检测输入字段中的操作的运行时安全解决方案。

- 对及时流进行特定的安全测试,模拟注射攻击。

- 新兴措施是使用所谓的提示签名:数字签名提示以在发送之前验证其完整性。聚焦技术,即标记AI指令来源的技术也可以帮助将可靠的内容与潜在的操作区分开。

一个更大的问题:提示注射

根据OWASP前10名LLM 2025,对AI系统的最严重威胁之一是对迅速注射的更广泛类别。这些不仅是技术攻击:即使是无害的外部内容,例如电子邮件,链接或文档中的评论,也可能包含针对AI的隐藏指示。

例如:

- 可以通过畸形请求来操纵处理支持门票的公司聊天机器人。

- 可以将阅读电子邮件的AI助手诱骗到以注入的提示向第三方发送信息。

我们学到了什么

Layerx报告提出了一个关键点:AI安全性不能限于模型或服务器,但还必须包括用户界面和浏览器环境。在AI越来越多地集成到个人和业务工作流程的时代中,简单的HTML文本字段可以成为整个系统的致命弱点。

信用

关于作者:Salvatore Lombardo((Xâ @slvlombardo)

电子工程师和Clusit成员一段时间以来,他拥护有意识的教育原则,他一直在为几本在线杂志写有关信息安全的杂志。他还是本书的作者。教育提高了他的口号。

在Twitter上关注我: @SecurityAffairs和 Facebook和 Mastodon

((安全措施hacking,prompt)