周围有很多辩论人工智能(AI)鉴于其能力的爆炸,担心是否是否担心它将带我们的工作询问是否我们可以信任它首先。

但是今天使用的AI不是未来的AI。科学家越来越坚信我们正在乘坐高速训练来建造人工通用情报(agi)一种高级的AI类型,可以像人类一样推理,在不同领域的表现更好,甚至改善了自己的代码并使自己更强大。

专家称这一刻为奇点。一些科学家说,这可能早在明年,但大多数人都同意到2040年我们将建造AGI的机会很大。

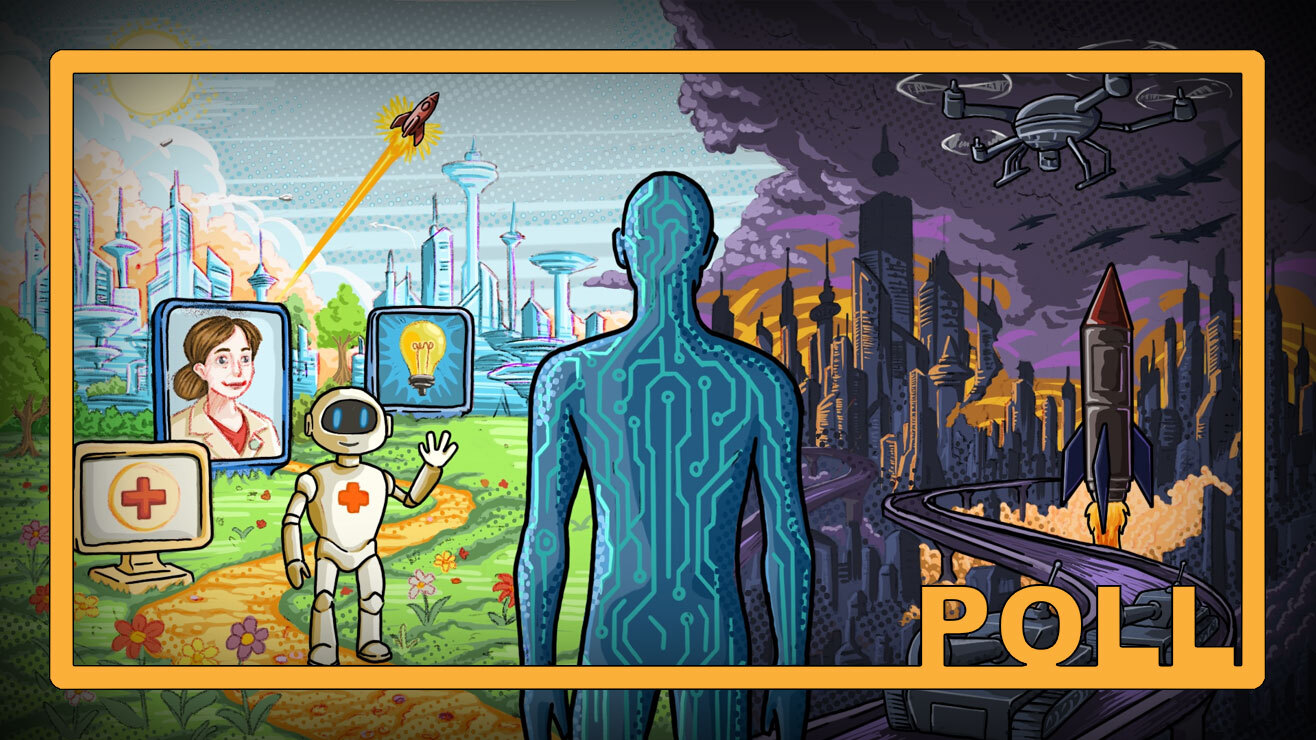

但是什么呢?分娩比人类聪明的人工智能可能带来无数的好处,包括迅速做新科学和新发现。但是一个可以建立越来越强大的版本如果它的利益与人类的利益不符,也可能不是一个好消息。那就是那里人工超级智能(ASI)发挥作用 - 与追求比我们更有能力的东西相关的潜在风险。

正如专家告诉《现场科学》,AI开发是进入“前所未有的政权”。因此,我们是否应该在它变得足够强大之前将其停止,以便将我们的手指sna起我们?在下面的民意调查中让我们知道,并确保告诉我们为什么您在评论部分中以自己的方式投票。

AI进入了“前所未有的政权”。我们应该停止它吗?我们可以在破坏我们之前吗?

科学家们说,从幻觉的答案到人类的完全失误,AI可以流氓有32种不同的方式。威胁AI聊天机器人,它将撒谎,作弊和“让您死”以阻止您,并警告

Keumars是Live Science的技术编辑。他曾为包括ITPRO,《一周数字》,《计算机精神》,《独立报》,《观察家》,《地铁》和Techradar Pro在内的各种出版物撰稿。