一个AI模型如何创建其环境的物理直觉|Quanta杂志

作者:By Anil Ananthaswamy

这里是对婴儿的测试:在桌子上向他们展示一杯水。将其隐藏在木板后面。现在将板移向玻璃杯。如果董事会不断越过玻璃杯,就好像在那儿一样,他们会感到惊讶吗?许多6个月大的孩子已经通过观察来学习的,几乎所有儿童都有对物体永久性的直观概念。现在,一些人工智能模型也可以做到。

研究人员开发了一个AI系统,该系统通过视频了解世界,并在呈现出违背其收集的知识的信息时表现出了“惊喜”的概念。

该模型由Meta创建,称为视频嵌入预测性体系结构(V-JEPA),并未对视频中包含的世界物理学做出任何假设。但是,它可以开始理解世界的运作方式。

他们的主张是先验的,非常合理,结果非常有趣。”迈克尔·海尔布隆,阿姆斯特丹大学的认知科学家,研究大脑和人造系统如何使世界有意义。

更高的抽象

正如制造自动驾驶汽车的工程师所知道的那样,很难获得AI系统来可靠地了解其所见。大多数旨在理解视频的系统以对其内容进行分类(例如,玩网球的人)或识别物体的轮廓,说的是,一辆汽车在所谓的像素空间中工作。

但是这些像素空间模型有局限性。想象一下试图理解郊区的街道。如果场景有汽车,交通信号灯和树木,则该模型可能会过多地关注不相关的细节,例如叶子的运动。它可能会错过交通信号灯的颜色或附近汽车的位置。``当您去图像或视频时,您不想在[Pixel]空间中工作,因为您不想建模的细节太多。Randall Balestriero,布朗大学的计算机科学家。

纽约大学的计算机科学家,Meta的AI Research主管Yann Lecun创建了JEPA,JEPA是V-JEPA的前身,在2022年在静止图像上工作。

EìColePolytechnique大学巴黎 - 萨克莱

V-JEPA架构于2024年发布,旨在避免这些问题。尽管组成V-JEPA的各种人工神经网络的细节很复杂,但基本概念很简单。

普通的像素空间系统通过训练过程,其中涉及掩盖视频和训练神经网络框架中的某些像素,以预测这些掩盖像素的值。V-JEPA还掩盖了视频帧的部分。但这并不能预测单个像素级别蒙面区域的背后是什么。相反,它使用更高级别的抽象或潜在表示来对内容进行建模。

潜在表示仅捕获有关数据的基本细节。例如,给定各种圆柱体的线图,称为编码器的神经网络可以学会将每个图像转换为代表每个气缸基本方面的数字,例如其高度,宽度,方向和位置。这样,将包含数百或数千个像素中包含的信息转换为少数数字 - 潜在表示。然后,一个称为解码器的单独的神经网络学会将圆柱的基本细节转换为圆柱体的图像。

V-JEPA专注于创建和复制潜在表示。在高级别上,体系结构分为三个部分:编码器1,编码器2和一个预测因子。首先,训练算法采用了一组视频帧,掩盖了所有框架中相同的像素集,并将框架馈入编码器1。有时,视频的最后几个帧被完全掩盖。编码器1将蒙版框架转换为潜在表示。该算法还将其完整框架的框架馈送到编码器2中,该帧将它们转换为另一套潜在表示。

现在,预测变量进入了该行为。它使用编码1产生的潜在表示来预测编码器2的输出。从本质上讲,它采用从蒙版框架生成的潜在表示,并预测由未掩盖的框架生成的潜在表示。通过重新创建相关的潜在表示,而不是较早系统的缺失像素,该模型学会了看到道路上的汽车,而不是对树木上的叶子大惊小怪。

``这使模型能够丢弃不必要的信息 - 信息并关注视频的更重要方面。昆汀·加里多(Quentin Garrido),Meta的研究科学家。删除不必要的信息非常重要,V-JEPA旨在有效地进行。”

一旦完成了训练阶段,下一步就是量身定制V-JEPA,以完成特定的任务,例如对图像进行分类或识别视频中描述的操作。这个适应阶段需要一些人类标记的数据。例如,必须将视频标记为有关其中包含的操作的信息。与整个系统的特定下游任务端到头训练相比,对最终任务的改编所需的标签数据要少得多。另外,可以针对不同的任务进行调整相同的编码器和预测网络。

直觉模仿

2月,V-JEPA团队报告他们的系统在理解现实世界的直观物理特性方面的表现如何,例如对象持久性,形状和颜色的恒定以及重力和碰撞的影响。在一个称为的测试中intphys,这需要AI模型来识别视频中发生的动作在物理上是合理的还是难以置信的,V-JEPA几乎准确98%。在像素空间中预测的一个知名模型仅比机会好一点。

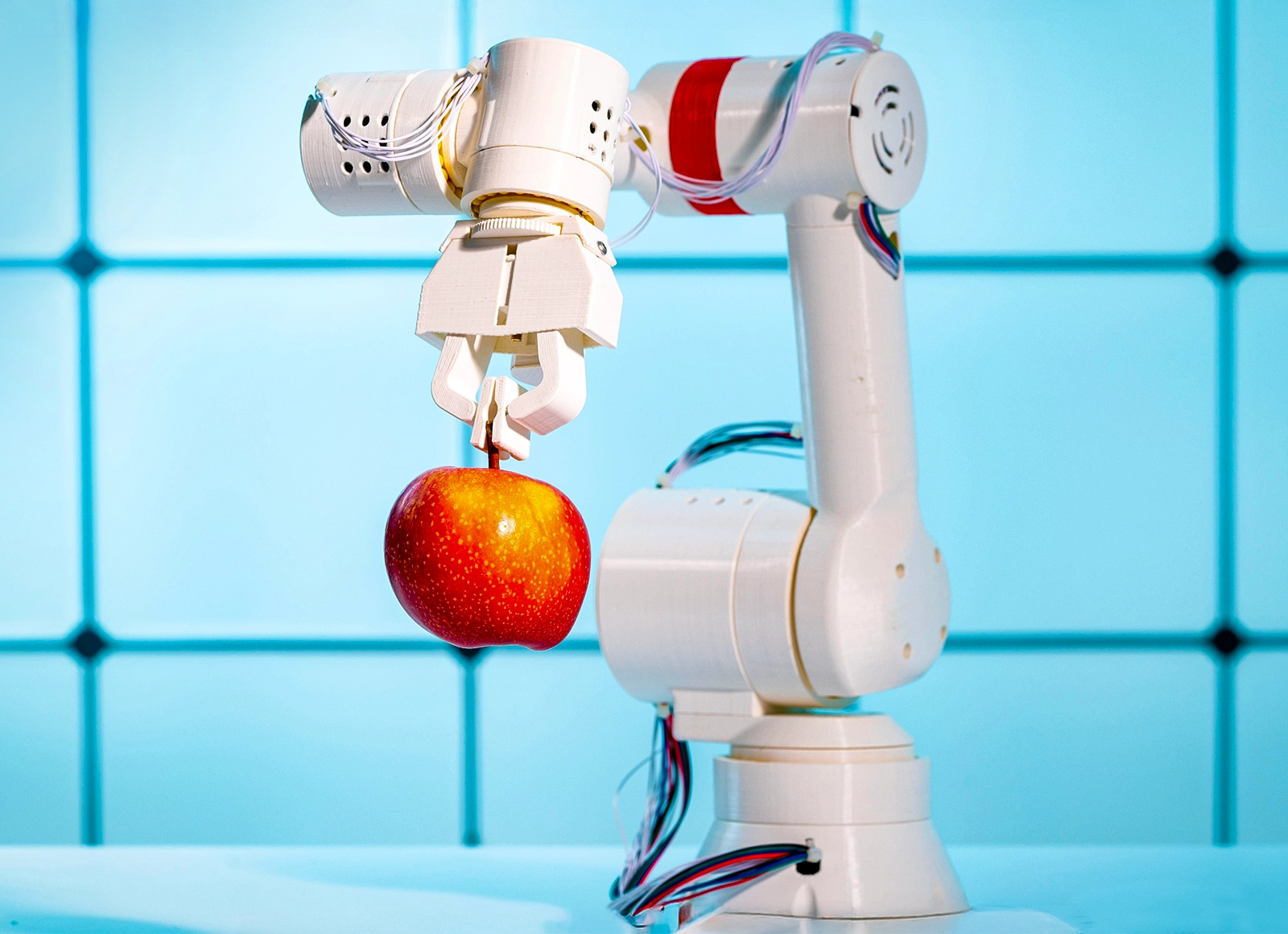

自主机器人需要像物理直觉之类的东西来计划其运动并与物理环境互动。

Wladimir Bulgar/Science图书馆

V-JEPA团队还明确量化了其模型预测不符合观察结果的惊喜。他们采用了在自然视频上预测的V-JEPA模型,对其进行了新的视频,然后数学上计算了V-JEPA期望在视频的未来框架中看到的内容与实际发生的事情之间的差异。该团队发现,当未来框架包含物理上不可能的事件时,预测错误就会出现。例如,如果一个球在某些堵塞物体后面滚动并暂时从视图中消失,那么当球在将来的帧中从物体后面重新出现时,模型就会产生错误。该反应类似于婴儿在婴儿中看到的直观反应。可以说,V-Jepa感到惊讶。

Heilbron对V-Jepa的能力印象深刻。我们从发展文献中知道,婴儿不需要大量的接触才能学习这些类型的直觉物理学。”令人信服的是,他们首先表明它可以学习,您不必与所有这些先天的先验一起使用。

卡尔·弗里斯顿(Karl Friston),伦敦大学学院的一名计算神经科学家认为,在模仿我们的大脑学习和模拟世界的方式方面,V-JEPA处于正确的轨道上。但是,它仍然缺乏一些基本的元素。他说,目前的提案中缺少的是对不确定性的适当编码。”例如,如果过去框架中的信息不足以准确预测未来的框架,则预测不确定,并且V-JEPA不会量化这种不确定性。

6月,META的V-JEPA团队发布了他们的下一代12亿参数模型,V-JEPA 2这是在2200万次视频中介绍的。他们还将该模型应用于机器人技术:他们展示了如何仅使用大约60个小时的机器人数据(包括机器人的视频以及有关其操作的信息)进一步调整新的预测网络,然后使用微型模型来计划机器人的下一个操作。Garrido说:'Garrido说:``这种模型可用于解决简单的机器人操纵任务,并为朝这个方向发展的未来工作铺平了道路。”

为了推动V-JEPA 2,该团队为直观的物理理解设计了一个更困难的基准,称为Intphys 2。在这些艰难的测试中,V-JEPA 2和其他型号仅比机会稍好一些。Garrido说,一个原因是V-JEPA 2只能处理大约几秒钟的视频作为输入,并预测未来几秒钟。一切都被遗忘了。您可以再次与婴儿进行比较,但是Garrido考虑了不同的生物。他说,从某种意义上说,模型的记忆让人想起金鱼。”