佐伊·克莱曼技术编辑

佐伊·克莱曼技术编辑

英国广播公司

英国广播公司

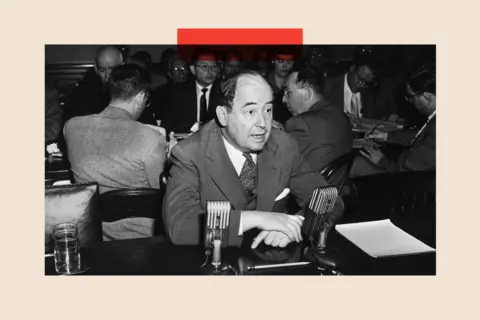

据说,早在 2014 年,马克·扎克伯格就开始了 Koolau Ranch 的建设工作,这是他位于夏威夷考艾岛的占地 1,400 英亩的大院。

据《连线》杂志报道,这里将包括一个避难所,并配有自己的能源和食品供应,不过根据保密协议,在现场工作的木匠和电工被禁止谈论它。

一堵六英尺高的墙挡住了附近道路的视线,无法看到该项目。

去年,当被问及是否要建造一个世界末日掩体时,这位 Facebook 创始人的回答是“不”。他解释说,地下空间占地约 5,000 平方英尺,“就像一个小避难所,就像一个地下室”。

但这并没有阻止人们的猜测——同样,他决定在加利福尼亚州帕洛阿尔托的新月公园附近购买 11 处房产,显然是在下面增加了 7,000 平方英尺的地下空间。

彭博社通过盖蒂图片社

彭博社通过盖蒂图片社

据《纽约时报》报道,尽管他的建筑许可证指的是地下室,但他的一些邻居称其为掩体。或者亿万富翁的蝙蝠洞。

然后是围绕其他科技领导者的猜测,其中一些人似乎一直忙于购买大片带有地下空间的土地,这些土地已经成熟,可以改造成价值数百万英镑的豪华掩体。

LinkedIn 联合创始人里德·霍夫曼 (Reid Hoffman) 曾谈到“末日保险”。他此前曾声称,大约有一半的超级富豪拥有这种资产,而新西兰是受欢迎的购房目的地。

那么,他们真的是在为战争、气候变化的影响或我们其他人还不知道的其他灾难性事件做准备吗?

盖蒂图片社新闻

盖蒂图片社新闻

在过去的几年里,人工智能(AI)的进步只是增加了潜在的生存困境。许多人对事态发展的速度深感担忧。

据报道,Open AI 首席科学家兼联合创始人 Ilya Sutskever 就是其中之一。

到 2023 年中期,这家总部位于旧金山的公司发布了 ChatGPT,该聊天机器人现已被全球数亿人使用,并且他们正在快速进行更新。

但根据记者凯伦·豪 (Karenhao) 所著的一本书,到了那个夏天,苏茨克韦尔先生越来越相信,计算机科学家正处于开发通用人工智能 (AGI) 的边缘——机器可以与人类智能相媲美。

据郝女士报道,在一次会议上,苏茨克韦尔先生向同事建议,在如此强大的技术向世界发布之前,他们应该为公司的顶尖科学家挖一个地下避难所。

法新社通过盖蒂图片社

法新社通过盖蒂图片社

据广泛报道,他曾表示:“在发布 AGI 之前,我们肯定会建造一个掩体。”尽管目前还不清楚他所说的“我们”指的是谁。

它揭示了一个奇怪的事实:许多领先的计算机科学家和技术领导者,其中一些人正在努力开发一种极其智能的人工智能形式,但他们似乎也对人工智能有一天能做什么深感恐惧。

那么 AGI 到底什么时候(如果有的话)会到来呢?它真的足以让普通人感到恐惧吗?

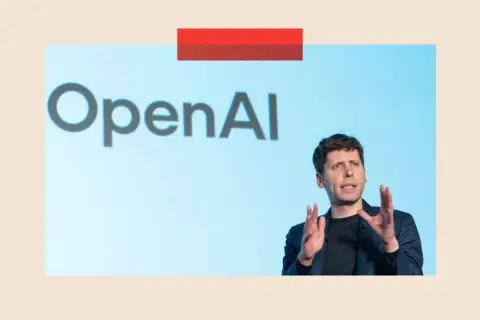

到达“比我们想象的要早”

科技领袖声称通用人工智能即将到来。OpenAI 老板 Sam Altman 在 2024 年 12 月表示,它的到来“比世界上大多数人想象的要早”。

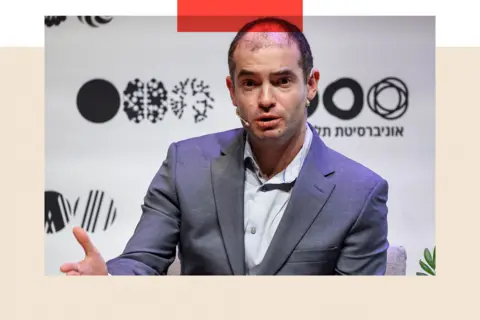

DeepMind 联合创始人 Demis Hassabis 爵士预测未来五到十年,而 Anthropic 创始人 Dario Amodei 去年写道,他最喜欢的术语“强大的人工智能”最早可能在 2026 年出现。

其他人则表示怀疑。“他们一直在改变球门柱,”南安普顿大学计算机科学教授温迪·霍尔夫人说。“这取决于你和谁说话。”我们正在打电话,但我几乎能听到翻白眼的声音。

“科学界说人工智能技术很神奇,”她补充道,“但它与人类智能相差甚远。”

科技公司 Cognizant 的首席技术官巴巴克·霍贾特 (Babak Hodjat) 同意,首先需要实现一些“根本性突破”。

更重要的是,它不太可能一次性到来。相反,人工智能是一项快速发展的技术,它正在不断发展,世界各地有许多公司竞相开发自己的版本。

但这个想法让硅谷的一些人兴奋的原因之一是,它被认为是更先进的东西的先驱:ASI,即超级人工智能——超越人类智能的技术。

早在 1958 年,“奇点”的概念就被追认为出生于匈牙利的数学家约翰·冯·诺依曼。它指的是计算机智能超越人类理解的时刻。

盖蒂图片社

盖蒂图片社

最近,埃里克·施密特 (Eric Schmidt)、克雷格·芒迪 (Craig Mundy) 和已故亨利·基辛格 (Henry Kissinger) 合着的 2024 年书《创世纪》(Genesis) 探讨了一种超强大技术的理念,这种技术在决策和领导力方面变得如此高效,以至于我们最终将控制权完全交给了它。

他们认为,这只是时间问题,而不是是否会发生的问题。

不需要工作,人人都有钱?

那些支持 AGI 和 ASI 的人几乎对它的好处充满了福音。他们认为,它将找到致命疾病的新疗法,解决气候变化问题,并发明取之不尽用之不竭的清洁能源。

埃隆·马斯克甚至声称,超级智能的人工智能可能会迎来一个“普遍高收入”的时代。

他最近认可了这样的观点,即人工智能将变得如此廉价和广泛,以至于几乎每个人都会想要“自己的个人 R2-D2 和 C-3PO”(参考《星球大战》中的机器人)。

“每个人都将获得最好的医疗保健、食物、家庭交通和其他一切。可持续的富裕,”他热情地说。

当然,也有可怕的一面。这项技术是否会被恐怖分子劫持并用作巨大武器,或者如果它自己认定人类是世界问题的根源并毁灭我们呢?

法新社通过盖蒂图片社

法新社通过盖蒂图片社

万维网创始人蒂姆·伯纳斯·李本月早些时候在接受英国广播公司采访时警告说:“如果它比你聪明,那么我们就必须控制住它。”

“我们必须能够将其关闭。”

各国政府正在采取一些保护措施。在许多领先的人工智能公司总部所在地的美国,拜登总统于 2023 年通过了一项行政命令,要求一些公司与联邦政府分享安全测试结果——尽管特朗普总统后来撤销了部分命令,称其为创新的“障碍”。

与此同时,在英国,政府资助的研究机构人工智能安全研究所于两年前成立,旨在更好地了解先进人工智能带来的风险。

还有一些超级富豪拥有自己的末日保险计划。

盖蒂图片社

盖蒂图片社

“说你‘在新西兰买房’有点眨眼,眨眼,别再说了,”里德霍夫曼此前表示。沙坑大概也是如此。

但这是一个明显的人性缺陷。

我曾经遇到过一位亿万富翁的前保镖,他拥有自己的“地堡”,他告诉我,如果这种情况真的发生,他的安全团队的首要任务就是消灭这位老板并自己进入地堡。而且他看起来并不是在开玩笑。

难道都是危言耸听的废话吗?

尼尔·劳伦斯是剑桥大学机器学习教授。对他来说,整个辩论本身就是无稽之谈。

“通用人工智能的概念与‘通用人工智能车辆’的概念一样荒谬,”他认为。

“合适的车辆取决于具体情况。我使用空客 A350 飞往肯尼亚,每天开车去大学,步行去自助餐厅……没有任何车辆可以完成这一切。”

对他来说,谈论 AGI 会分散他的注意力。

“我们[已经]开发的技术首次允许普通人直接与机器对话,并有可能让它做他们想做的事。这绝对是非凡的……并且是彻底的变革。

“最大的担忧是,我们太沉迷于大型科技公司关于 AGI 的叙述,以至于我们忽视了为人们带来更好的生活的方式。”

盖蒂图片社

盖蒂图片社

目前的人工智能工具经过大量数据的训练,擅长发现模式:无论是扫描中的肿瘤迹象还是最有可能以特定顺序出现在另一个单词之后的单词。但他们并没有“感觉”,无论他们的反应看起来多么令人信服。

“有一些‘欺骗性’的方法可以让大型语言模型(人工智能聊天机器人的基础)表现得好像它有记忆和学习一样,但这些方法并不令人满意,而且远远低于人类,”霍贾特先生说。

总部位于加州的 IV.AI 首席执行官文斯·林奇 (Vince Lynch) 也对有关 AGI 的夸大声明持谨慎态度。

“这是很棒的营销,”他说,“如果你是一家正在打造有史以来最智能产品的公司,人们就会想给你钱。”

他补充道,“这不是两年后的事情。它需要大量的计算、大量的人类创造力、大量的试验和错误。”

盖蒂图片社

盖蒂图片社

当被问及他是否相信通用人工智能将会实现时,他停顿了很长时间。

“我真的不知道。”

无意识的智能

在某些方面,人工智能已经占据了人类大脑的优势。生成式人工智能工具前一分钟可以成为中世纪历史的专家,下一分钟就可以解决复杂的数学方程。

一些科技公司表示,他们并不总是知道为什么他们的产品会做出这样的反应。Meta 表示,有一些迹象表明其人工智能系统正在自我改进。

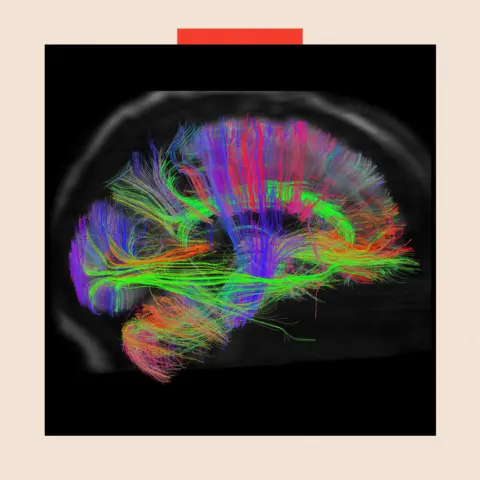

但最终,无论机器变得多么智能,从生物学角度来看,人脑仍然获胜。它有大约 860 亿个神经元和 600 万亿个突触,比人工神经元多得多。

大脑也不需要在交互之间暂停,并且它会不断适应新信息。

“如果你告诉人类在系外行星上发现了生命,他们会立即了解到这一点,这将影响他们未来的世界观。对于 LLM(大型语言模型)来说,只要你不断向他们重复这一事实,他们就会知道这一点,”霍贾特先生说。

“法学硕士也没有元认知,这意味着他们不太知道自己知道什么。人类似乎有内省的能力,有时被称为意识,这让他们知道他们所知道的。”

它是人类智能的基本组成部分,而且尚未在实验室中复制。

热门图片来源:华盛顿邮报,盖蒂图片社/盖蒂图片大师。主图显示了马克·扎克伯格和未知位置的一个掩体的库存图片

英国广播公司深度报道是网站和应用程序上提供最佳分析的主页,提供挑战假设的新鲜视角以及对当今最大问题的深入报告。我们还展示了来自 BBC Sounds 和 iPlayer 的发人深省的内容。您可以注册通知,以便在 BBC InDepth 故事发布时向您发出提醒 - 了解详情如何在这里注册。