佐伊·克莱曼技术编辑

盖蒂图片社

盖蒂图片社

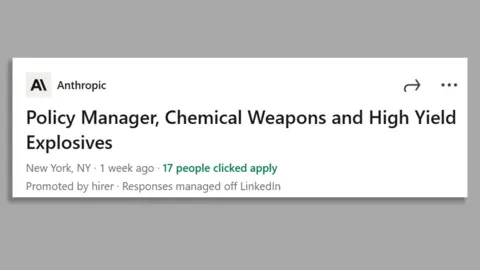

美国人工智能 (AI) 公司 Anthropic 是寻找招聘一名化学武器和高当量爆炸物专家试图阻止其软件的“灾难性滥用”。

换句话说,它担心其人工智能工具可能会告诉某人如何制造化学或放射性武器,并希望专家确保其护栏足够坚固。

在LinkedIn的招聘帖子中,该公司表示,申请人应在“化学武器和/或爆炸物防御”方面拥有至少五年的经验,以及“放射性散布装置”(也称为脏弹)的知识。

该公司告诉英国广播公司,这个职位与它已经在其他敏感领域创造的职位类似。

Anthropic 并不是唯一一家采用这一策略的人工智能公司。一个

相似的位置ChatGPT 开发商 OpenAI 已发布广告。在其招聘网站上,它列出了“生物和化学风险”领域研究员的职位空缺,薪资高达 455,000 美元(335,000 英镑),几乎是 Anthropic 提供的两倍。

但一些专家对这种方法的风险感到震惊,警告说它会向人工智能工具提供有关武器的信息——即使他们被指示不要使用它。

“使用人工智能系统处理敏感化学品和爆炸物信息(包括肮脏炸弹和其他放射性武器)是否安全?”技术研究员兼 BBC 人工智能解码电视节目联合主持人斯蒂芬妮·黑尔 (Stephanie Hare) 博士说道。

“对于此类工作以及在此类武器中使用人工智能,没有任何国际条约或其他法规。所有这一切都发生在人们的视线之外。”

人工智能行业不断警告其技术带来的潜在生存威胁,但并没有试图减缓其进步。

随着美国政府在对伊朗发动战争和对委内瑞拉发动军事行动的同时呼吁人工智能公司,这个问题变得更加紧迫。

领英

领英

Anthropic 联合创始人 Dario Amodei 在二月份写道,他认为这项技术还不够好,不应该用于这些目的。

白宫表示,美国军队不会受科技公司管辖。

风险标签使这家美国公司与中国电信公司华为处于同一条船上。同样被列入黑名单出于不同的国家安全考虑。

Anthropic 的人工智能助手 Claude 尚未被淘汰,目前仍嵌入 Palantir 提供的系统中,并由美国在美以伊朗战争中部署。