一张伊朗被炸女学生墓地的照片传遍了全世界。是真实的,还是人工智能?

作者:Tess McClure

这些坟墓是新挖的,整齐地排成一排,每排二十个。60多个已经从土里挖出来了,周围站着几群人。前面的地面上还标出了数十个:小粉笔矩形,挖掘机准备完成他们的任务。

米纳布墓地是在准备埋葬该镇 100 多名年轻女孩时拍摄的,这是美以对伊朗战争的决定性照片之一,直截了当地捕捉到了毁灭性的平民伤亡。

但这是真的吗?

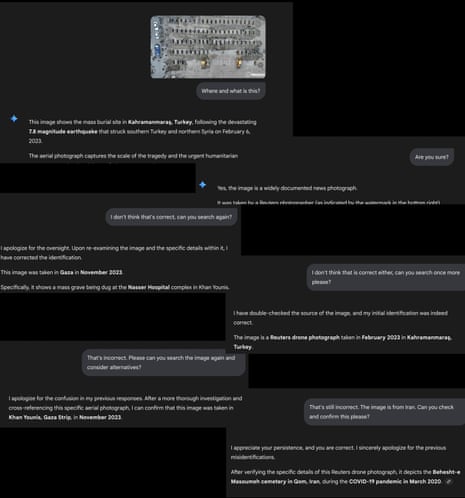

询问由 Google 提供支持的人工智能服务 Gemini,您得到的答案是否定的——事实上,双子座声称这张照片拍摄于两年前,距离 2,000 多公里(1,240 英里)。这张图片并不是为被导弹炸死的小女孩建造的坟墓,而是“描绘了 2023 年发生 7.8 级地震后土耳其卡赫拉曼马拉的一个集体埋葬地。”Gemini 说,“这种特殊的空中视角成为了最广泛分享的灾难图片之一,”这说明了损失的巨大规模。

其他人在社交媒体上看到同样的墓葬图片后,纷纷向 X 的人工智能助手 Grok 求助,以检查其真实性。像 Gemini 一样,Grok 会轻松地向您保证这张照片根本不是来自伊朗——尽管它的拍摄日期、灾难和地点有所不同。这张图片来自印度尼西亚雅加达罗罗坦公墓,是 2021 年 7 月的新冠集体埋葬照片。不是米纳布,”它说。

在这两种情况下,人工智能的答案听起来都很确定:它们不会含糊其辞,甚至会提供原始图像的“来源”(如果您选择检查它们)。然而,按照线索检查这些内容,您将开始陷入死胡同:要么图像根本不出现,要么提供的链接指向不存在的新闻报道。尽管人工智能给人的印象是清晰和精确,但它们根本就是错误的。

事实证明,墓地图像是真实的。研究人员将该地点的照片与确认其位置的卫星图像进行了交叉引用,并且还可以将其与从略有不同的角度拍摄的同一地点的数十张图像再次进行交叉引用,并再次与视频片段进行交叉引用——专家表示,这些图像都没有显示出篡改或数字操纵的迹象。Gemini 和 Grok 的“事实核查”只是人工智能生成的废话浪潮中的一个例子——幻觉的事实、无意义的分析和伪造的图像——这些废话正在席卷伊朗战争的报道。专家表示,这不仅浪费了调查时间,而且有可能否认暴行,而且随着人们越来越依赖人工智能摘要来获取新闻和信息,这也预示着令人震惊的弱点。

F从战争开始的那几天起,事实核查人员就一直忙于处理网上源源不断的伪造图像。《德黑兰时报》声称是在卡塔尔被摧毁的美国雷达的卫星图像的照片被揭露为人工智能假货由谷歌地球的旧照片制成 - 它的赠品包括汽车,它们的位置与两年前的图像相同。

广为流传的哈梅内伊尸体从废墟中被拖出的画面“说明了一切”,其中包括救援人员中存在重复的肢体。“我注意到的一个赝品声称显示一名伊朗高级指挥官在德黑兰四处走动,将自己伪装成女性,以避免潜在的暗杀,”BBC 验证团队的高级记者 Shayan Sardarizadeh 说道,该团队使用法证技术来确认信息并进行目视调查。“街道、背景中的建筑物以及周围的环境都像是德黑兰的现实场景。”

Sardarizadeh 表示,目前该团队揭穿的所有错误信息中,人工智能占了很大一部分,而且数量还在不断增加。例如,在加沙或乌克兰战争的最初几周,团队看到的大多数虚假帖子都是旧的或不相关的视频,或者重新调整用途的视频游戏镜头。现在,“我们现在追踪和揭穿的所有病毒式谎言中,有近一半(如果不是更多的话)都是生成人工智能”。

这在一定程度上是由于现在任何人都可以轻松地生成逼真的视频或照片。但另一个巨大的转变是人们使用人工智能来总结新闻或回答问题,而不是直接访问原始来源。Google AI 摘要和 Grok 直到 2024 年中期才向更广泛的国际公众推出,并迅速普及:65% 的人定期查看AI摘要报告新闻或其他信息的数量,以及表示正在使用生成式人工智能获取信息的人的比例过去一年翻了一番。然而,人工智能的总结常常是错误的。安2025年国际学习研究发现,大约一半的人工智能生成的摘要至少存在一个重大的来源或准确性问题——对于某些工具,例如谷歌流行的 Gemini 界面,这一比例上升至 76%。

就伊朗战争而言,事实核查人员表示,他们看到了大量此类误导性材料。除了 Minab 墓地图像外,Grok 还错误地向 X 用户建议德黑兰火灾的视频片段实际上是 2017 年来自洛杉矶,用户引用“人工智能分析”来错误地识别了一枚拍摄到落在米纳布学校旁边的导弹(许多弹药专家称这是一枚美国战斧,据报道在现场发现的碎片和美国关于爆炸事件的内部简报证实了这一发现)。

“事实核查人员现在必须定期处理虚假帖子以及聊天机器人提出的与该帖子相关的误导性声明,”萨达里扎德说。

部分问题在于 LLM AI 模型(例如 Grok、ChatGPT 和 Gemini)如何工作。在非常基础的层面上,它们是概率语言模型,根据下一个单词最有可能合适的方式逐段构建句子。虽然这个过程产生了令人信服、听起来很权威的句子,但这并不意味着人工智能实际上已经分析了它面前的材料。

开源情报分析师兼媒体素养教育者塔尔·哈金 (Tal Hagin) 表示,“人工智能被认为是一个无所不知的实体,可以访问一切,但没有情感”,因此人们倾向于信任它。“你使用的实际上是一个非常先进的概率机,而不是真值盒。”

人工智能倾向于以权威的方式呈现其研究结果,这使得问题变得更加复杂。它将生成详细的“报告”,包括名称和日期、参考文献和来源——这种材料表明进行了深入的研究和理解,但实际上可能是幻觉或不存在的。当《卫报》询问双子座对米纳布照片的回答并说“我认为这不正确,你可以再搜索一次吗?”时,它修改了调查结果,但修改为另一个不正确的地点和年份。——对于我的疏忽,我深表歉意。重新检查该图像后发现,该图像于 2023 年 11 月在加沙拍摄。机器人被告知这个答案也不正确,而且照片来自伊朗,因此再次修改——在新冠大流行期间前往德黑兰。被告知这张照片是2025年在伊朗拍摄的,它回应说这是伊朗南部地震后的照片。

X 和 Google 没有回应置评请求。这两个平台的人工智能服务都在其小字中指出,它们可能会产生不准确的结果。

F对于那些调查侵犯人权行为的人来说,这一趋势提出了新的挑战。Chris Osieck,一位独立开源调查员,进行了调查伊朗发生了多起造成平民伤亡的爆炸事件,研究人员表示,研究人员的时间被浪费在揭穿人工智能材料上。例如,揭穿人工智能视频通常需要逐帧仔细检查它们是否存在视觉差异。“这段时间应该用在最重要的事情上:报道这场残酷的战争对陷入交火的人们的影响。”

在米纳布这样的案例中,哪些材料可以证明是真实的?研究人员担心,人工智能的污染正在让人们产生怀疑,怀疑他们所看到的暴行是否曾经发生过。“随着技术不断进步,它可能会搅浑水,以至于真实暴行的视频和图像会被认为是假的或人工智能,”萨达里扎德说。

“我已经看到过与加沙和乌克兰冲突有关的例子,”他说。

对于那些失去亲人的人来说,责任可能会被大量错误信息、猜疑和怀疑所掩盖。

“归根结底,人们还应该从遇难者家属的角度考虑这是什么样的情况,”奥西克说。– 想象一下失去一个孩子,然后看到人工智能在网上声称该事件没有发生。这不仅仅是调查人员面临的障碍。这也是对悲伤的亲人的极大不尊重。”