发布 Arm AGI CPU:代理 AI 云时代的硅基础

作者:Mohamed Awad

今天,Arm 宣布推出 Arm AGI CPU,一种建立在手臂新宇宙平台,旨在为下一代人工智能基础设施提供动力。

我们第一次超过35年的历史Arm 正在推出自己的芯片产品,将 Arm Neoverse 平台扩展到 IP 和 Arm 计算子系统 (CSS) 之外,让客户在部署 Arm 计算方面有更多选择,从构建定制芯片到集成平台级解决方案或部署 Arm 设计的处理器。它既反映了人工智能基础设施的快速发展,也反映了生态系统对可快速、大规模部署的生产就绪型 Arm 平台日益增长的需求。

代理人工智能基础设施的兴起

人工智能系统越来越多地在全球范围内持续运行。从历史上看,人类是计算的瓶颈——人们与系统交互的速度决定了工作在系统中移动的速度。在代理人工智能时代,随着软件代理协调任务、与多个模型交互并实时做出决策,这种约束消失了。

随着人工智能系统的持续运行和工作负载的复杂性的增加,CPU 成为现代基础设施的调速元件– 负责保持分布式人工智能系统大规模高效运行。在现代人工智能数据中心中,CPU 管理着数千个分布式任务——编排加速器、管理内存和存储、调度工作负载以及跨系统移动数据——而现在,借助代理人工智能,可以协调大量代理之间的扇出。

这种转变对 CPU 提出了新的要求,这就需要处理器的发展。

Arm Neoverse 已经为当今许多领先的超大规模和人工智能平台提供了支撑,包括AWS引力子,谷歌轴子,微软 Azure 钴和英伟达维拉。随着人工智能基础设施在全球范围内扩展,整个生态系统的合作伙伴都要求 Arm 做更多的事情。Arm AGI CPU 的诞生就是为了应对这一转变。

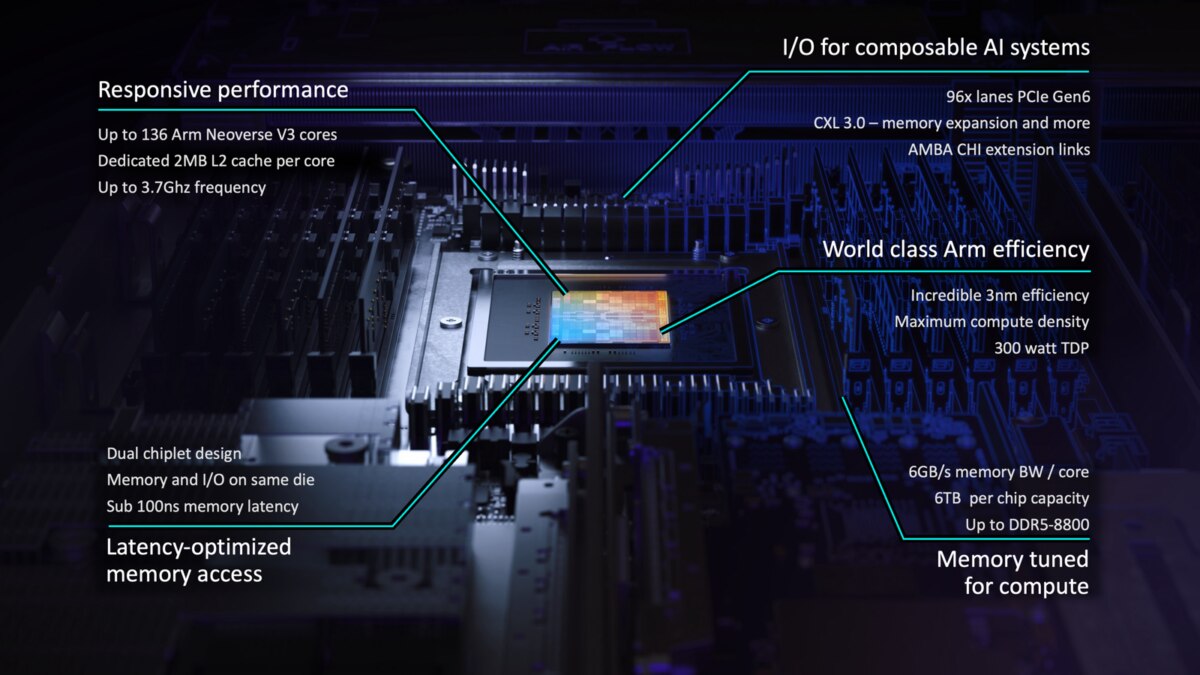

Arm AGI CPU:专为机架级代理效率而打造

代理人工智能工作负载需要大规模的持续性能。的Arm AGI CPU旨在在数千个并行核心的持续负载下提供高每任务性能 - 所有这些都在现代数据中心的电源和冷却限制范围内。

Arm AGI CPU 的每个元素(从工作频率到内存和 I/O 架构)都旨在支持密集机架部署中的大规模并行、高性能代理工作负载。

Arm 的参考服务器配置是 1OU、2 节点设计,封装在两个具有专用内存和 I/O 的芯片中,每个刀片总共有 272 个内核。这些刀片设计用于完全填充标准风冷 36kW 机架 — 30 个刀片,总共提供 8160 个核心。Arm 还与 Supermicro 合作开发了液冷 200kW 设计,能够容纳 336 个 Arm AGI CPU,超过 45,000 个内核。

在此配置中,与最新的 x86 系统*相比,Arm AGI CPU 能够提供超过 2 倍的每机架性能,这是通过 Arm 架构的基本优势以及系统资源与计算的仔细匹配来实现的:

- Arm AGI CPU 领先的内存带宽意味着每个机架的执行线程更加有效;x86 CPU 会因内核在持续负载下竞争而性能下降。

- 高性能、高效、单线程Arm Neoverse V3 CPU内核的性能优于传统架构;每个 Arm 线程都会做更多的工作。

- 更多的可用线程和更多的每线程工作量可以为每个机架带来巨大的性能提升。

整个人工智能生态系统的早期势头

Arm AGI CPU 已经与处于扩展代理 AI 基础设施前沿的合作伙伴一起看到了强劲的商业势头。计划的部署涵盖加速器管理、代理编排以及代理任务横向扩展所需的服务、应用程序和工具的致密化,以及增加网络和数据平面计算以支持人工智能数据中心。

Meta 是我们的主要合作伙伴和客户共同开发 Arm AGI CPU,以优化其 Meta 系列应用程序的千兆瓦级基础设施,并与 Meta 自己的定制 MTIA 加速器配合使用。其他发布合作伙伴包括 Cerebras、Cloudflare、F5、OpenAI、Positron、Rebellions、SAP 和 SK Telecom,每个合作伙伴都与 Arm 合作部署 Arm AGI CPU,以加速跨云、网络和企业环境的 AI 驱动服务。商业系统现已可以从 ASRockRack、联想和 Supermicro 订购。

为了进一步加速采用,Arm 推出了Arm AGI CPU 1OU 双节点参考服务器,开放计算项目 (OCP) DC-MHS 标准外形规格服务器。Arm 计划贡献此参考服务器设计和支持固件,以及进一步的贡献,包括适用于所有基于 Arm 的系统的系统架构规范、调试框架以及诊断和验证工具。进一步的细节将在即将到来的OCP 欧洲、中东和非洲峰会。

Arm 基础设施的新篇章

Arm AGI CPU 的推出标志着 Arm 数据中心之旅的新篇章以及在计算创新方面的持续领先地位。随着人工智能重塑行业,Arm 仍然致力于推动整个生态系统的进步,满足从超大规模云提供商到人工智能初创公司等客户的需求。

Arm AGI CPU 是 Arm 全新数据中心芯片产品线的首款产品,现已开始接受订购。后续产品致力于实现一流的性能、规模和效率。这与Arm Neoverse CSS产品路线图,以便所有 Arm 数据中心客户在平台架构和软件兼容性方面共同前进。

进入新的篇章,我们的使命保持不变:提供支持跨行业创新的计算基础。生态系统完全支持我们:50多家龙头企业跨超大规模、云、芯片、内存、网络、软件、系统设计和制造正在支持 Arm 计算平台向芯片的扩展。借助 Arm AGI CPU,我们不仅定义了 AI 原生数据中心的架构,而且还在构建它。

从我们的 Arm AGI CPU 部署合作伙伴那里了解更多信息:

大脑

– 在 Cerebras,我们构建了专为超快速、大规模推理而设计的 AI 基础设施,随着这成为 AI 中的主要工作负载,可组合的高性能系统比以往任何时候都更加重要 – 这些系统需要专门构建的 AI 加速以及高效、可扩展的 CPU,以大规模编排数据移动、网络和协调。将 Arm 计算平台扩展到 AGI 级基础设施对于生态系统和在全球范围内部署 AI 的客户来说是积极的一步。 – –安德鲁·费尔德曼 (Andrew Feldman),Cerebras 首席执行官

云耀

– 为了继续我们帮助构建更好的互联网的使命,Cloudflare 需要能够在我们的全球网络中高效扩展的基础设施。Arm AGI CPU 提供专为下一代工作负载而设计的高性能、高能效计算。 – –Stephanie Cohen,Cloudflare 首席战略官

元

– 在全球范围内提供 AI 体验需要强大且适应性强的定制芯片解决方案组合,专门用于加速 AI 工作负载并优化 Meta 平台的性能。我们与 Arm 合作开发了 Arm AGI CPU,以部署高效的计算平台,该平台可显着提高我们的数据中心性能密度,并支持我们不断发展的 AI 系统的多代路线图。 – –Santosh Janardhan,Meta 基础设施主管

开放人工智能

– OpenAI 大规模运行人工智能系统。每天有数亿人使用 ChatGPT,企业基于我们的 API 构建,开发人员依赖 Codex 等工具。随着我们的扩展,Arm AGI CPU 将在我们的基础设施中发挥重要作用,加强协调大规模 AI 工作负载的编排层,并提高整个系统的效率、性能和带宽。 – –Sachin Katti,OpenAI 工业计算主管

正电子

– 在 Positron,我们专注于专用推理加速器,利用商品内存实现突破性的代币生成效率。Arm 始终如一地提供业界最节能的计算平台,这使得 Arm AGI CPU 成为下一代 AI 基础设施的天然基础。通过将 Positron 的推理加速技术与节能的 Arm AGI CPU 平台相结合,我们看到了一个强大的机会,可以帮助数据中心运营商大规模部署前沿 AI 模型,并提高每瓦特和每美元的性能。 – –Mitesh Agrawal,Positron AI 首席执行官

叛乱

– 高性能人工智能系统需要通用计算和加速器架构之间的紧密协调。通过在新的高密度服务器配置中将 Arm AGI CPU 与 Rebellions NPU 相结合,我们正在提供一个可扩展、节能的平台,该平台针对大规模 AI 推理工作负载进行了优化。Marshall Choy,Rebellions 首席商务官

SAP

SAP 在基于 Arm 的 AWS Graviton 上成功部署 SAP HANA,凸显了适用于企业工作负载的 Arm 生态系统的成熟度和性能。Arm AGI CPU 扩展了这一机会,提供可扩展、高效的计算,旨在支持下一代人工智能驱动的业务解决方案。 – –Stefan Büerle,SAP 高级副总裁、HANA 和持久性主管

SK电讯

– SK Telecom 正在扩展到大规模、全栈 AI 推理数据中心基础设施,其中包括 Arm AGI CPU 和 Rebellions AI 加速器芯片。通过将我们的主权 A.X 基础模型与推理优化的 AI 服务器结合在一起,我们已准备好将其推向世界,同时提高我们的 AIDC 竞争力。 – –Suk-geun (SG) Chung,SK Telecom 首席技术官兼 AI CIC 主管

前瞻性陈述

本博文包含有关 Arm 产品路线图、未来业绩、计划贡献和合作伙伴部署的前瞻性陈述。这些陈述基于当前的预期,并受到可能导致实际结果存在重大差异的风险和不确定性的影响。有关可能影响 Arm 业绩的因素的讨论,请参阅 Arm 向美国证券交易委员会提交的文件。

性能声明基于 Arm 内部估计,将完全填充的基于 Arm AGI CPU 的服务器与使用行业标准工作负载的基于 x86 的服务器配置进行比较。实际结果可能会因系统配置、工作负载和其他因素而异。

所有产品和公司名称均为其各自所有者的商标或注册商标。

*基于估计