研究发现“认知投降”导致人工智能用户放弃逻辑思维

——降低审查门槛——

总体而言,在 1,372 名参与者和超过 9,500 项个人试验中,研究人员发现,受试者愿意接受错误的人工智能推理的概率高达 73.2%,而推翻它的概率只有 19.7%。研究人员表示,这“表明人们很容易将人工智能生成的输出纳入他们的决策过程,通常很少有摩擦或怀疑。”他们写道,一般来说,“流畅、自信的输出被视为认知上的权威,降低了审查的门槛,并削弱了通常会通过深思熟虑做出反应的元认知信号。”

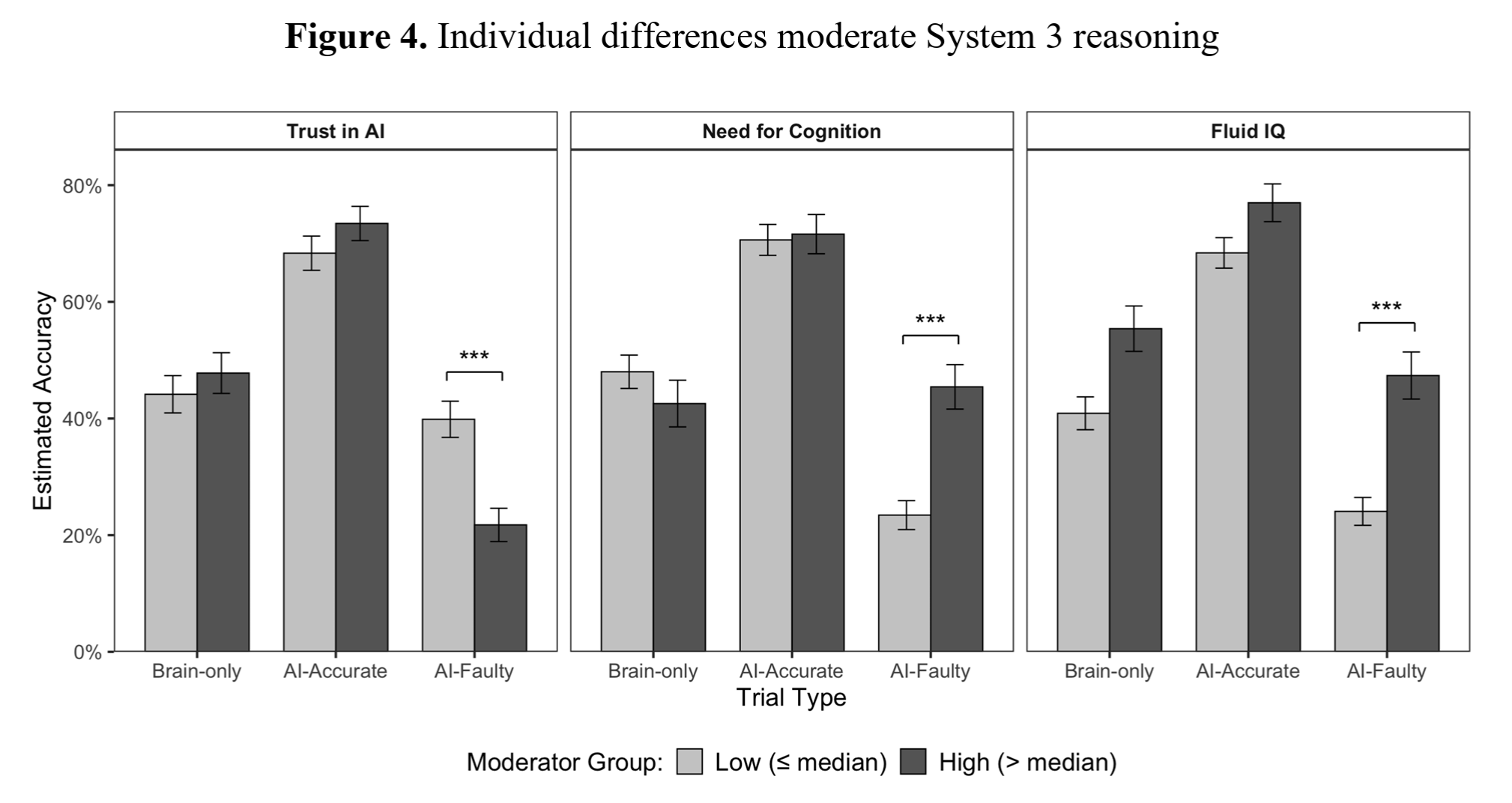

信用:肖和纳夫不过,所有测试对象的这些影响并不相同。

那些得分高的人所谓的流体智商的单独测量不太可能依赖人工智能寻求帮助,并且更有可能在咨询有问题的人工智能时予以否决。另一方面,那些倾向于将人工智能视为调查中权威的人,更有可能被人工智能提供的错误答案引入歧途。

尽管有这样的结果,研究人员指出,“认知屈服并不是本质上非理性的。”虽然依赖一半时间都是错误的法学硕士(如这些实验中)有明显的缺点,但“统计上优越的系统”可能会在“概率设置、风险评估或广泛的领域”等领域给出比人类更好的结果。数据,”研究人员建议。

研究人员写道:“随着依赖度的增加,人工智能的性能会随着质量的提高而变化,准确时会上升,错误时会下降,这说明了超级智能的前景,并暴露了认知屈服的结构性脆弱性。”

换句话说,让人工智能来做你的推理意味着你的推理永远不会和人工智能系统一样好。一如既往,让提示者小心。

关于《研究发现“认知投降”导致人工智能用户放弃逻辑思维》的评论

暂无评论

发表评论

摘要

研究人员发现,在一项涉及 1,372 名受试者和 9,500 多项试验的研究中,参与者在 73.2% 的情况下接受了错误的人工智能推理,而只有 19.7% 的人否决了它。对人工智能的高度信任与被错误反应误导相关,而高“流体智商”则减少了对错误人工智能输出的依赖。该研究表明,流畅且自信的人工智能输出通常被视为具有权威性,从而导致更少的审查和更直接的接受,而无需进一步审议。尽管存在风险,研究人员指出,使用统计上优越的系统可以在某些领域提供更好的结果。然而,对人工智能的依赖增加与反映人工智能质量的性能直接相关,凸显了认知屈服于人工智能系统的潜在好处和弱点。