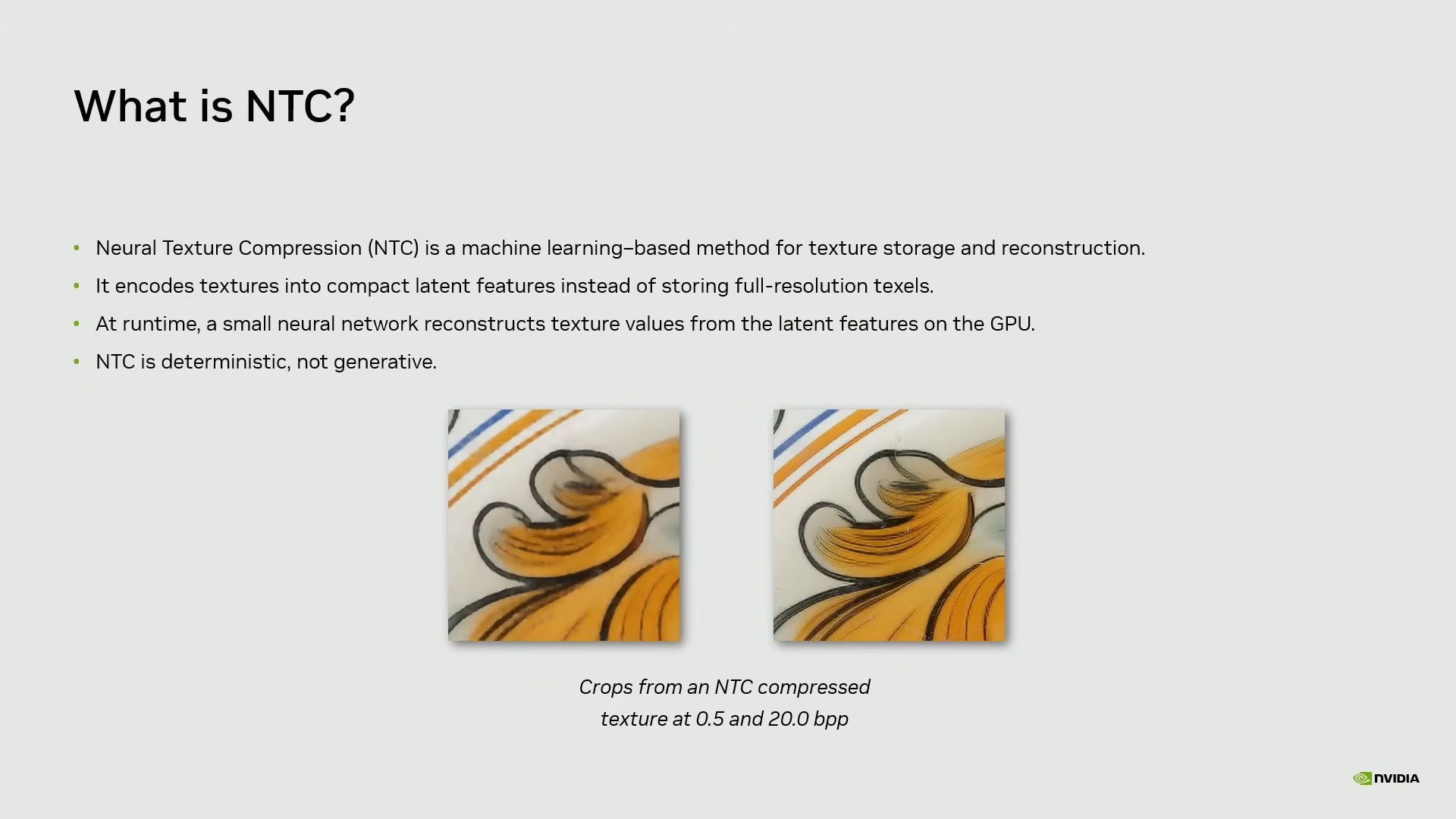

随着游戏变得更加复杂和逼真,该行业越来越依赖升级技术来满足不断增长的硬件需求。这种低于标准的优化带来的最大问题之一是 VRAM 使用率,在过去几年中,VRAM 使用率急剧上升。为了解决这个问题,Nvidia 开发了一项名为《神经纹理压缩》(NTC),在今天的 GTC 演讲中再次被提及。的最好的显卡将能够利用 Nvidia 的 NTC 技术。

深入了解 TH Premium:GPU

在下面的示例中,Nvidia 运行了一个托斯卡纳别墅场景,使用标准块压缩消耗 6.5 GB VRAM,但切换到 NTC 将其减少到仅 970 MB,并且图像看起来相同。此前,该公司的另一个演示展示了一款飞行头盔,其未压缩纹理大小为 272 MB,块压缩将其减少至 98 MB,但 NTC 将其减少至仅 11.37 MB,比原始纹理减少了约 24 倍。

文章继续如下

神经渲染简介 - YouTube

该公司还展示了神经材料,遵循相同的概念:让神经网络评估和解压缩材料纹理数据,而不是依赖计算成本高昂的 BRDF 数学。通常,材质会堆叠多个纹理贴图,GPU 必须计算光线如何在渲染管道中同时与每个层交互。

神经材料只是询问神经网络在这种情况下光线将如何反应,并相应地对像素进行着色。神经网络接受了所有纹理数据的训练,因此它已经知道给定光线和角度的结果。因此,在下面的演示场景中,Nvidia 在 1080p 分辨率下的渲染时间提高了 7.7 倍,且图像质量没有损失。

第 1 张图片(共 2 张)

NTC 之所以如此高效,是因为它使用矩阵加速引擎,而矩阵加速引擎是现代 GPU 中的独立硬件模块,因此基本性能不会受到影响。Nvidia 将其称为 Tensor Core,Intel 将其称为 XMX 引擎,AMD 将其称为 AI 加速器。这也是像 DLSS、FSR 和 XeSS 这样的升级器也存在的地方,因为它们将低分辨率帧重建为更高分辨率的输出,因此它是Nvidia 的神经渲染野心。

神经渲染的概念并不受到最广泛的好评在社区中,“神经网络”这个词可能会让你认为这只是更多的人工智能废话。实际上恰恰相反,这是人工智能的更好用途之一,因为它根本不具有生成性。NTC 将仅接受游戏开发过程中需要参考的特定纹理集的训练,因此不会出现幻觉。

第 1 张图片(共 2 张)

到目前为止,纹理在所有游戏中消耗的 VRAM 最多,因此任何控制纹理的技术都是值得欢迎的补充。也就是说,值得注意的是,这并不是 Nvidia 独有的,因为微软将其标准化为“合作载体“在 DirectX 中。英特尔此前曾展示了自己的演示与块压缩相比,纹理明显更好。AMD 上次谈论该技术是在 2024 年,但它也可能在任务中。

目前,没有游戏支持协作向量或 Nvidia 的神经纹理压缩,但考虑到行业的发展轨迹,我们应该很快就会开始看到它的实施。人工智能似乎已经成为每个古老问题的答案,企业正在发明新的方法将其合并到不属于它的地方。然而,像 NTC 这样的创新表明,它可以通过巧妙的实施来产生实际的、有意义的变化。

关注Google 新闻上的 Tom's Hardware, 或将我们添加为首选来源,在您的源中获取我们的最新新闻、分析和评论。