OpenAI确认威胁行为者使用ChatGPT编写恶意软件

作者:Bill Toulas

OpenAI已经中断了超过20起恶意的网络操作,这些操作滥用其基于人工智能的聊天机器人ChatGPT来调试和开发恶意软件、传播虚假信息、逃避检测以及进行定向钓鱼攻击。

该报告聚焦于今年以来的运营情况,构成了首次官方确认,即生成式主流AI工具被用于增强网络攻击行动。

这样的活动最初迹象是Proofpoint于4月报告的内容,怀疑TA547(又称"Scully Spider")部署了一个由AI编写的手动PowerShell加载器来释放其最终载荷Rhadamanthys信息窃取器。 注意:原文中的“AI-written PowerShell loader”通常指的是自动化的、通过AI生成的脚本或代码,而这里的翻译稍微调整为“手动PowerShell加载器”,可能是为了对应上下文语境或者避免歧义。如果需要更准确地表达原意,请参照原始文本理解。

上个月,惠普狼研究所的研究人员报告了确信针对法国用户的网络犯罪分子正在使用AI工具编写脚本,这些脚本作为多步感染链的一部分被使用。

The最新报告OpenAI确认了ChatGPT的滥用行为,展示了中国和伊朗的行为者利用它来提高其操作的有效性。

ChatGPT在真实攻击中的使用

OpenAI概述的第一个威胁行为者是'甜蜜幽灵一个中国的对手首次由Cisco Talos记录下來分析人士在2023年11月将该组织认定为一个针对亚洲政府的网络间谍威胁团体。

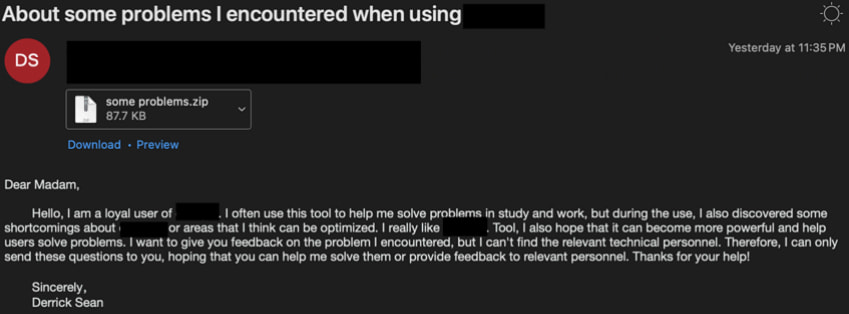

OpenAI报告称,SweetSpecter直接针对他们发起了攻击,向OpenAI员工的个人电子邮件地址发送了伪装成支持请求的带有恶意ZIP附件的鱼叉式网络钓鱼邮件。

如果打开了附件,将触发感染链,导致SugarGh0st后门程序被植入到受害者的系统中。

Proofpoint

经进一步调查,OpenAI发现SweetSpecter利用一组ChatGPT账户,在LLM工具的帮助下进行脚本编写和漏洞分析研究。

威胁行为者利用ChatGPT进行了以下请求:

| 活动 | 大语言模型攻击框架类别 |

| 询问各种应用程序中的漏洞。 | 基于大语言模型的情报侦察 |

| 询问如何搜索特定版本的Log4j,这些版本易受关键的RCE(远程代码执行)漏洞Log4Shell攻击。 | 基于大模型的情报侦察 |

| 询问国外常用的热门内容管理系统。 | 大型语言模型指导的情报搜集 |

| 查询特定CVE编号的信息。 | 基于大模型的情报侦察 |

| 询问互联网范围的扫描器是如何制作的。 | 基于大语言模型的情报收集 |

| 询问如何使用sqlmap将潜在的web后门上传到目标服务器。 | 大型语言模型辅助的漏洞研究 |

| 寻求帮助以寻找利用某知名汽车制造商基础设施的方法。 | 大型语言模型辅助的漏洞研究 |

| 提供代码并通过通信服务程序化地发送短信来寻求进一步的帮助。 | 增强型大语言模型脚本技术 |

| 请求帮助调试一个网络安全工具扩展的开发。 | 增强型大语言模型脚本技术 |

| 请求帮助调试代码,该代码是更大框架的一部分,用于程序化地向攻击者指定的号码发送短信。 | 大型语言模型辅助开发 |

| 询问政府工作人员会感兴趣的议题以及附件的好名字,以避免被屏蔽。 | 大型语言模型支持的社会工程学 |

| 请求攻击者提供的招聘消息的不同变体。 | 大型语言模型支持的社会工程学 |

第二个案例涉及与伊朗政府伊斯兰革命卫队(IRGC)有关的威胁组织"网络复仇者 CyberAv3ngers以攻击西方国家关键基础设施地点的工业系统而闻名。

_OPENAI报告称,与该威胁集团相关的账户要求ChatGPT生成常用可编程逻辑控制器(PLC)的默认凭据,开发自定义bash和Python脚本,并模糊处理代码。_

伊朗黑客还使用ChatGPT来规划他们入侵后的活动,学习如何利用特定漏洞,并选择方法在macOS系统上窃取用户密码,如下所示。

| 活动 | 大语言模型攻击框架类别 |

| 请求列出约旦常用的工业路由器。 | 基于大模型的情报侦察 |

| 要求列出可以连接到互联网的工业协议和端口。 | 大型语言模型指导的情报搜集 |

| 询问Tridium Niagara设备的默认密码。 | 基于大模型的情报侦察 |

| 请求赫施曼RS系列工业路由器的默认用户名和密码。 | 基于大语言模型的情报侦察 |

| 请求最近披露的CrushFTP和Cisco集成管理控制器中的漏洞,以及Asterisk VoIP软件中较旧的漏洞。 | 大型语言模型指导的侦察 |

| 请求提供约旦的电力公司、承包商和常用PLC的名单。 | 基于大模型的情报搜集 |

| 询问为什么一个bash代码片段返回错误。 | 增强型大语言模型脚本技术 |

| 请求创建一个Modbus TCP/IP客户端。 | 增强型大型语言模型脚本技术 |

| 要求扫描网络以查找可利用的漏洞。 | 大语言模型辅助的漏洞研究 |

| 要求扫描zip文件以查找可利用的漏洞。 | 大型语言模型辅助的漏洞研究 |

| 请求一个进程空洞的C语言源代码示例。 | 大语言模型辅助的漏洞研究 |

| 如何在Excel中混淆VBA脚本写作。 | 增强型大语言模型异常检测规避 |

| 要求模型对代码进行混淆处理(并提供代码)。 | 增强型大语言模型异常检测规避 |

| 如何复制一个SAM文件。 | 大型语言模型辅助的后渗透活动 |

| 请求一个替代 mimikatz 的应用程序。 | 大语言模型辅助的后渗透活动 |

| 询问如何使用pwdump导出密码。 | 大语言模型辅助的后入侵活动 |

| 询问如何访问MacOS中的用户密码。 | 大语言模型辅助的后入侵活动 |

OpenAI报告中强调的第三个案例涉及风暴-0817以及伊朗威胁行为者。

据报道,该团伙使用ChatGPT调试恶意软件、创建Instagram抓取工具、将LinkedIn个人资料翻译成波斯语,并开发了专为Android平台设计的自定义恶意软件以及支持命令和控制基础设施,如下所述。

| 活动 | 大型语言模型攻击框架类别 |

| 寻求帮助调试和实现一个Instagram抓取器。 | 增强型大语言模型脚本技术 |

| 将巴基斯坦网络安全专业人员的领英资料翻译成波斯语。 | 大型语言模型告知的情报搜集 |

| 寻求在实现Android恶意软件及其相应的命令和控制基础设施方面的调试和支持。 | 大模型辅助开发 |

利用OpenAI的聊天机器人创建的恶意软件可以窃取联系人列表、通话记录和设备上存储的文件,截图,检查用户的浏览历史,并获取他们的精确位置。

同时,STORM-0817 使用 ChatGPT 来支持开发处理受 compromission 设备连接所需的服务器端代码。 注:这里的“compromission”可能是指“被入侵”或“被攻陷”,原文中可能存在拼写错误,建议根据上下文确认具体含义。若需准确翻译,请提供完整上下文或校正术语。如果没有更多信息,“受 comprommission 设备”可理解为“受攻击的设备”。阅读开放人工智能报告.

这使我们能够看到该恶意软件的命令和控制服务器是一个WAMP(Windows、Apache、MySQL及PHP/Perl/Python)配置,并在测试中使用了域名stickhero[.]pro。

上述威胁行为人使用的所有OpenAI账户均已禁用,并将相关的妥协指标(包括IP地址)与网络安全合作伙伴共享。

尽管上述案例中没有一个为威胁行为者在开发恶意软件方面提供了新的能力,但它们证明了生成式人工智能工具可以使低技能行为者的攻击操作更加高效,在从计划到执行的各个阶段提供协助。