全部新闻

这些人工智能录音机将成为野外的 Google Nest 摄像头

黄石国家公园的录音机正在连续捕捉狼的声音和其他野生动物的声音,帮助科学家利用人工智能技术监测和保护狼。由 Jeff Reed 和 Yellowstone Wolf Project 领导的“Cry Wolf”项目已在 50 万英亩的土地上安装了 50 个录音装置。通过对超过 200,000 小时的记录进行分析,它提供了对狼行为的新见解,包括它们的沟通模式和种群估计,有可能减少对传统侵入性监测方法的依赖。

从事心理学和教育学等“人工智能防护”职业的大学毕业生的学位回报正出现负值财富

高等教育和经济研究中心的一份新报告显示,当考虑到学费等成本时,许多研究生学位的投资回报率为负。心理学和临床心理学学位的投资回报率特别差,成本调整后的回报率分别为 -8% 和 -5%。社会工作、课程和教学等其他领域也产生负回报。与此同时,人工智能技能的工资溢价达 23%,而仅学士学位的工资溢价仅为 8%。研究表明,虽然研究生教育可以使收入提高约 17%,但尽管人工智能自动化在白领工作中兴起,某些专业学位仍然能提供高回报。

人工智能让大学生在课堂上听起来都一样 |美国有线电视新闻网

在耶鲁大学,学生越来越依赖人工智能聊天机器人来完成课堂作业和讨论,导致课堂辩论中思维同质化和原创性下降。这一趋势引起了教育工作者对批判性思维技能和创造力的侵蚀的担忧。虽然一些教职员工正在尝试各种方法来抵消人工智能的影响,例如进行课堂考试和不鼓励使用笔记本电脑,但对于如何在不损害教育诚信的情况下最好地整合人工智能,存在着更广泛的争论。

耶鲁大学经济学家表示 AGI 不会使大多数工作实现自动化,因为它们不值得麻烦 |财富

经济学家帕斯夸尔·雷斯特雷波 (Pascual Restrepo) 的一篇新论文挑战了人们对通用人工智能 (AGI) 将取代大多数人类工作的传统担忧。相反,他认为通用人工智能将专注于未来发展的关键任务,而将较少必要的工作留给人类,这可能会保留酒店和艺术等领域的就业机会。然而,虽然人类劳动力可能不会过时,但随着计算资源主导价值创造,其经济意义就会减弱。这种转变导致财富集中在拥有计算能力的人手中,引发了人们对收入不平等以及对再分配机制(例如全民基本收入或将计算视为公共资源)的需求的担忧。

你真的能相信你的“私人”人工智能助理会保守你的秘密吗?|耶路撒冷邮报

Check Point 在 ChatGPT 系统中发现了一个安全漏洞,攻击者可以通过该漏洞在不触发 DNS 隧道警报的情况下提取数据。此漏洞已被 OpenAI 修复,凸显了用于敏感任务(如工作相关活动和个人决策)的人工智能系统的更广泛的信任问题。研究表明,此类缺陷不仅会损害文档,还会损害人工智能模型生成的有价值的见解,这强调了在所有人工智能平台上采取更强大的安全措施的必要性。

掌握人工智能、数据、安全和工作流程

人工智能正在迅速改变就业市场,公司正在寻找精通人工智能的员工来提高效率和自动化任务。学习这些技能可以带来更好的工作机会、更高的薪水和职业发展。Digitaledify.ai 提供专业课程,包括使用 GenAI 和人工智能代理的数据分析师、使用 GenAI 和人工智能代理的数据工程、人工智能和数据科学家、人工智能和网络安全以及使用人工智能代理的 ServiceNow,每门课程都旨在为学习者提供 Python、SQL、人工智能技术等方面的必要工具和知识。这些课程可通过 Digital Edify 的 2026 年综合培训计划在不同时间段提供。

数据泄露后,Meta 暂停了与人工智能培训初创公司 Mercor 的合作

Meta 已暂停与 Mercor 的合作,并正在对数据泄露事件进行调查。Mercor 估值 100 亿美元,利用数千名承包商和专家,向包括 Meta 在内的主要科技公司提供人工智能模型的训练数据。该公司确认遭遇了与涉及 LiteLLM 的供应链攻击相关的安全事件,并表示他们正在与第三方取证专家进行彻底调查。

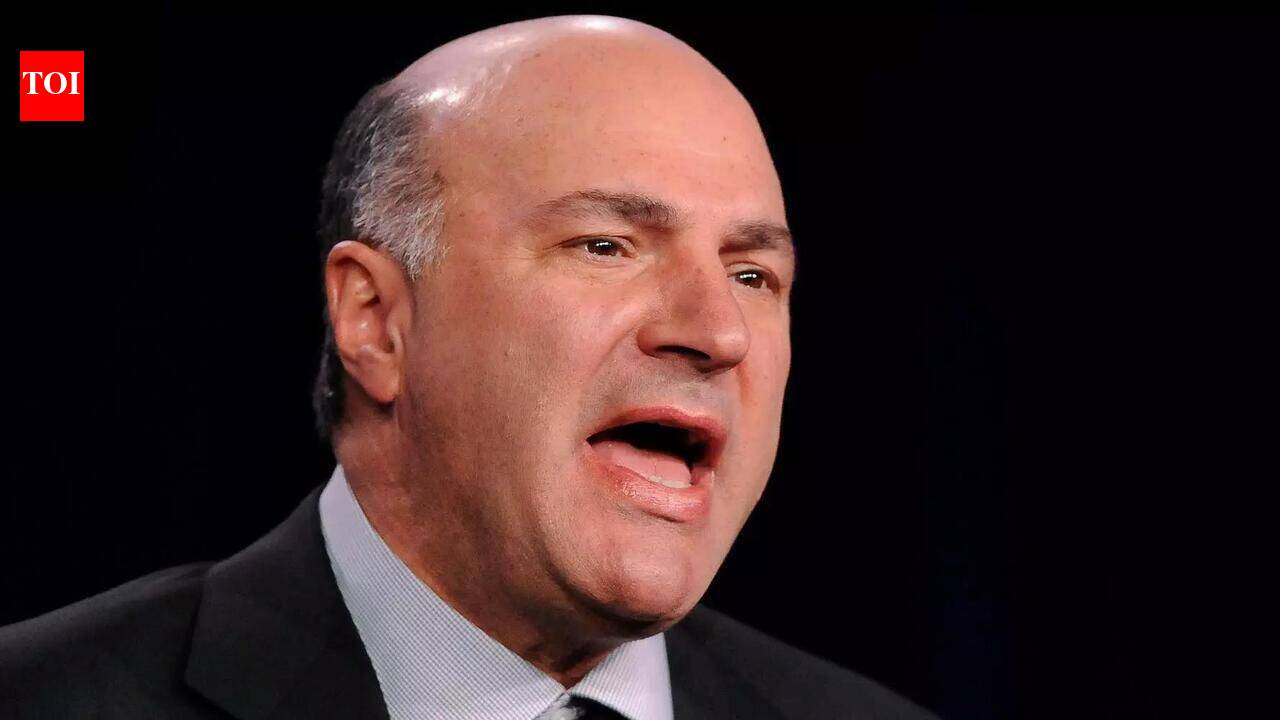

加拿大亿万富翁 Kevin OâLeary 表示,人工智能裁员的一个好处是:每个人都说你必须成为一名工程师,但现在你可以成为…… - 印度时报

加拿大亿万富翁、Shark Tank 前投资人凯文·奥利里 (Kevin OâLeary) 表示,人工智能 (AI) 正在增强人类创造力的价值,而不是取代工作岗位。在冰咖啡时间播客中,他强调,今天的利润丰厚的机会是为那些能够通过社交媒体上创造性的故事讲述将想法转化为结果的人提供的。奥莱里指出,由于可衡量的客户获取成功,内容创作者的收入显着增加,这表明年轻人可以通过制作引人注目的简短内容每年赚取高达 50 万美元。他还强调了人工智能作为各行业生产力工具的作用,消除了人们对人工智能会破坏就业机会、反而会产生新产业的担忧。

Anthropic 切断了 OpenClaw 对 Claude 订阅的支持

Anthropic 正在停止对其 Claude 订阅中对 AI 代理平台 OpenClaw 的支持,因为需求飙升给系统带来了更大的压力。用户将需要替代支付方式或单独的 API 密钥才能继续使用 OpenClaw 等第三方工具。做出这一决定之际,Anthropic 正在努力解决容量问题,并寻求优先考虑直接产品使用而不是第三方集成。

Karpathy 共享“LLM 知识库”架构,该架构通过由 AI 维护的不断发展的 Markdown 库绕过 RAG

特斯拉前人工智能总监兼 OpenAI 联合创始人 Andrej Karpathy 引入了一种名为“LLM 知识库”的创新方法,使用由 LLM 维护的 Markdown 格式的持久记录来管理研究主题。该方法通过使法学硕士能够充当全职研究馆员、编译、检查和互连文档,解决了上下文限制重置带来的挫败感。通过将 Markdown 文件视为事实来源,Karpathy 的系统确保人工智能提出的每项声明都可以追溯到人类可读的数据,从而避免与矢量数据库相关的“黑匣子”问题。这种方法对企业应用程序具有重大影响,提出了一种实时编译和维护结构化知识库的新产品类别,有可能改变公司管理非结构化数据的方式。