全部新闻

我们正在构建的东西

欢迎来到第 126 号安装程序,其中重点介绍了最新的创作,包括新的游戏控制器、《穿普拉达的女王》续集以及各种人工智能相关项目。此外,还有用户制作的提高生产力的应用程序和工具,例如 SCOTUSWatch、Cross app 和 GamePal。亮点包括有关数字订阅的讨论、约翰·奥利弗 (John Oliver) 对人工智能聊天机器人的看法以及提高创造力的电影配乐。

Anthropic最强大的人工智能模型刚刚暴露了公司治理的危机。这是每位首席执行官都需要的框架。|财富

Anthropic 的 Claude Mythos Preview 模型标志着人工智能能力的重大进步,实现了超人的编码和推理。该模型揭示了之前数百万次尝试未能发现的长期存在的软件缺陷。为了解决其代理能力带来的安全风险,Anthropic 启动了 Project Glasswing,为网络安全机构和大公司提供有限的访问权限,以识别关键系统漏洞。如此强大的人工智能的出现凸显了对强大治理框架的迫切需要,以确保问责制、透明度和数据隐私。各个司法管辖区的现行法规差异很大,形成了分散的合规环境。私营部门治理模式对于建立消费者信心和确保安全融入工作场所至关重要。银行、医疗保健、零售和供应链物流等关键行业在部署代理人工智能方面面临着独特的挑战,受到现有监管框架的影响,并且需要严格监督以防止不可逆转的错误和偏见放大。成功的部署需要使治理实践与行业特定的限制和机会保持一致。

Deepfakes 即将入侵你的银行账户

唐纳德·特朗普出现在由 ChatGPT Images 2.0 生成的假 TikTok 视频中,展示了先进的人工智能技术如何能够制作出高度可信的深度伪造品。该工具能够创建带有文本的逼真图像,这对欺诈和错误信息具有重大影响,包括创建处方、银行警报、身份证和护照等虚假文件。这些欺诈性材料的制作非常容易,对防止金融和身份相关诈骗构成了严峻挑战,凸显了人工智能公司需要改进保障措施以及跨行业合作打击此类犯罪。

如何推出自己的本地 AI 编码代理

本文讨论了与人工智能模型订阅相关的不断增加的成本,并建议使用本地模型作为替代的节省成本的解决方案。它重点介绍了阿里巴巴发布的 Qwen3.6-27B,与 Anthropic 的 Claude 或 OpenAI 的 GPT 等较大模型相比,该 Qwen3.6-27B 旨在在功能较弱的硬件上高效运行。本文提供了部署 Qwen3.6-27B 并为其配置编码任务的分步指南,包括设置参数和优化内存使用。它还探讨了不同的代理框架,例如 Claude Code、Pi Coding Agent 和 Cline,详细介绍了如何将这些框架与本地模型集成。最后,本文评估了Qwen3.6-27B在实际编码场景中的性能,并考虑了使用AI代理进行代码开发时的安全问题。

Palantir 来到校园

在耶鲁大学的一次私人会议上,Palantir 基金会及其盟友概述了他们将人工智能与国家权力相结合的愿景。这次活动没有公开宣传,聚集了保守派知识分子、Palantir 高管和政府官员,讨论人工智能时代的国家权力。发言者对人工智能监管持怀疑态度,并强调需要建立更紧密的公私伙伴关系,特别是在支持美国在人工智能发展方面对中国的主导地位方面。

我的人工智能媒人让我失望

Amata 和 Sitch 等新一波人工智能配对应用程序旨在通过一次为用户提供潜在的匹配对象,而不是滚动浏览数千个个人资料,从而彻底改变在线约会。这些服务按约会设置收费,承诺减少聊天并增加神秘感,旨在减少许多人对传统约会应用程序的倦怠感。然而,人们对人工智能的信任度仍然很低,这引发了人们是否准备好将浪漫搜索交给技术的疑问。尽管如此,公司还是看到了人工智能婚介成为主流的未来,尤其是年轻一代对传统在线约会平台表现出不感兴趣的情况下。我

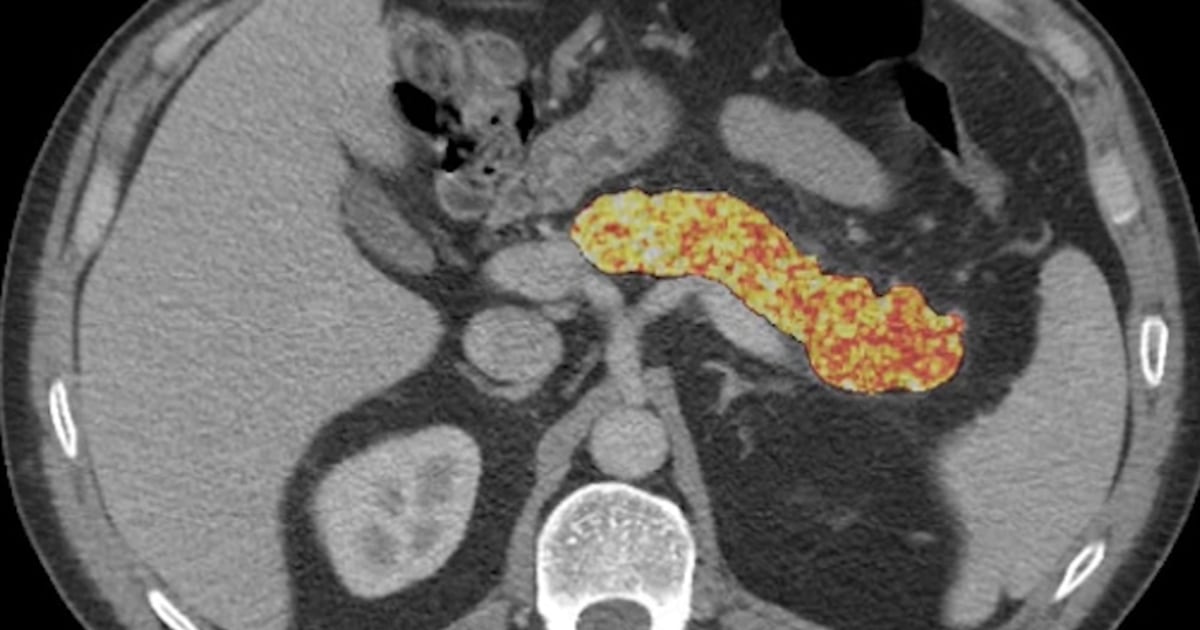

人工智能在肿瘤发展之前发现胰腺癌的迹象

梅奥诊所开发的一种新的人工智能模型有望在 CT 扫描中发现肿瘤之前三年内检测到胰腺癌的早期迹象,从而有可能改善早期诊断和治疗结果。发表在《肠道》杂志上的研究发现,人工智能在识别早期胰腺癌的细微异常方面比放射科医生好三倍。考虑到该疾病的高死亡率和缺乏常规筛查方法,这一进步可能特别重要。进一步的临床试验正在进行中,以评估其在现实环境中的有效性。

ChatGPT 对话如何成为刑事调查中证据的“宝库” |美国有线电视新闻网

据称,南佛罗里达大学的一名研究生在两名同学失踪并被发现死亡之前,曾向 ChatGPT 询问如何处理装在黑色垃圾袋中的人体尸体。这一事件凸显了人工智能聊天机器人对话作为刑事调查证据的情况,引发了人们对此类互动的隐私保护的担忧。法律专家表示,虽然人们越来越依赖人工智能提供个人建议,但这些对话缺乏类似于医生或治疗师等有执照的专业人士所享有的法律保密保护。因此,与人工智能平台的通信可能会被发现并在法律诉讼中针对个人。

人工智能音乐正在涌入流媒体平台。但听众越来越不喜欢

Luminate 最近的一份报告显示,乐迷对人工智能生成的歌曲越来越不舒服,尤其是 Z 世代和 Alpha 世代听众。该研究显示,从 2025 年 5 月到 11 月,人们的兴趣从 -13% 下降到 -20%。虽然一些人工智能项目已经登上了公告牌排行榜,但对真正音乐家收入和黑人音乐真实性影响的担忧仍然存在。该报告强调,人们对人工智能以现有艺术家的风格或声音创作的新歌曲的态度尤其负面,这对流媒体服务提出的未来互动功能构成了挑战。

谷歌刚刚推出了一款专门针对 Android 的新“实验性人工智能助手”应用程序(已更新)

谷歌在 Play Store 上发布了一款名为 COSMO 的实验性 AI 助手应用,其中包括 Gemini Nano 模型和服务器端 AI。该应用程序似乎旨在开发目的而不是向消费者发布,其执行粗糙以及在首次发布后就被提前从商店下架就证明了这一点。COSMO 可以在本地、远程或混合模式下运行,但在通过 Android 的 AccessibilityService API 进行屏幕访问等领域缺乏完整的功能。Play 商店列表还因其质量差、屏幕截图格式不正确而闻名。这表明谷歌可能会在更广泛的发布之前使用 COSMO 在内部测试新的人工智能特性和功能。