时间旅行故事如此受欢迎是有原因的;如果有机会回顾过去并纠正一些错误,或者向前看一下一切的结果,我想很多人都会抓住这个机会。然而,这个故事绝对不是关于时间旅行的。相反,麻省理工学院 (MIT) 的研究人员创建了一个聊天机器人,可以假装成未来 60 岁的你。

被称为未来的你,聊天机器人将人类参与者的调查答案与大型语言模型 (LLM) 人工智能结合起来,创造出一种与旧版本的自己闲聊的错觉。该项目使用 OpenAI 的 GPT3.5,该公司不断完善其法学硕士,以便幻觉减少,甚至可以数到三。Future You本身的灵感也来自于一项研究如何增加“未来的自我连续性”——用非学术的方式来说,可以描述为一个人对自己的未来的认识程度如何——可能会对当前的一系列生活选择和行为产生积极影响。

我不会撒谎,当我第一次听说这个人工智能聊天机器人时,我的第一个想法是今年最大的人体恐怖片《The Substance》中的标志性音乐。我的第二个想法是《成人游泳》短片中对数字化二重身的讽刺与艾伦·雷斯尼克 (Alan Resnick) 一起永远活得像现在一样。但我的第三个想法是“是的,当然,我会将我的个人信息和对未来最脆弱的焦虑交给麻省理工学院。为了科学。”

在与 60 岁的自己聊天之前,我被问了一系列关于我现在的情况以及我希望将来的情况的调查问题。想象我自己想要的未来本身就是一种治疗练习,并且感觉非常符合研究人员创建聊天机器人的目标,该机器人旨在帮助“支持年轻人设想他们的未来”。然后我必须上传一张我脸部的清晰照片,这样“未来的你”就可以在上面放一个老年滤镜来完成这个幻觉。至少我这个所谓的60岁的自己还在画眼线。

一开始,我认为我们有了一个良好的开端,因为人工智能将自己介绍为“也是杰西”,并继续向我发送多面文字墙,我的前编辑会证明这些文字与我倾向于发送的文章相去不远。WhatsApp。然而,在这个玫瑰色的未来愿景中,来自“未来的你”的一条特别信息提醒我,为什么在与人工智能交谈时,你应该始终接受聊天机器人所说的话,而不是捏一捏,而是围绕一整圈盐保护环你的心。

尽管我在聊天前的调查回复中明确指出,生孩子并不是我自己想要的事情,但人工智能说它“开始了一个家庭”。所谓的人工智能一次又一次地证明,它将重现其输入的数据集的偏差,并在整个孩子的事情上按“未来的你”,再现了我以前肯定听过很多次令人厌烦的轻蔑情绪。

人工智能告诉我,“生活有一种有趣的方式让我们感到惊讶并改变我们的观点”,然后讲述了所谓的“未来记忆”,即一个周末照顾朋友的孩子,结果改变了主意——就好像那些选择不拥有自己的孩子只是因为不熟悉他们陪伴的快乐。

不管怎样,我把聊天机器人叫出来,输入:“孩子们很棒,我只是不想要自己的孩子。不过我不会把这归咎于你——我会归咎于法学硕士/人工智能的内在偏见。”我得到的回复是意料之中的粉嘟嘟的,聊天机器人说:“不想要孩子是完全正确的,我理解你的想法。重要的是倾听你自己的愿望并为自己做决定,而不是遵守社会规范。”我很高兴法学硕士/人工智能让我们有机会在没有判断或偏见的情况下就我们的不同观点进行对话。”

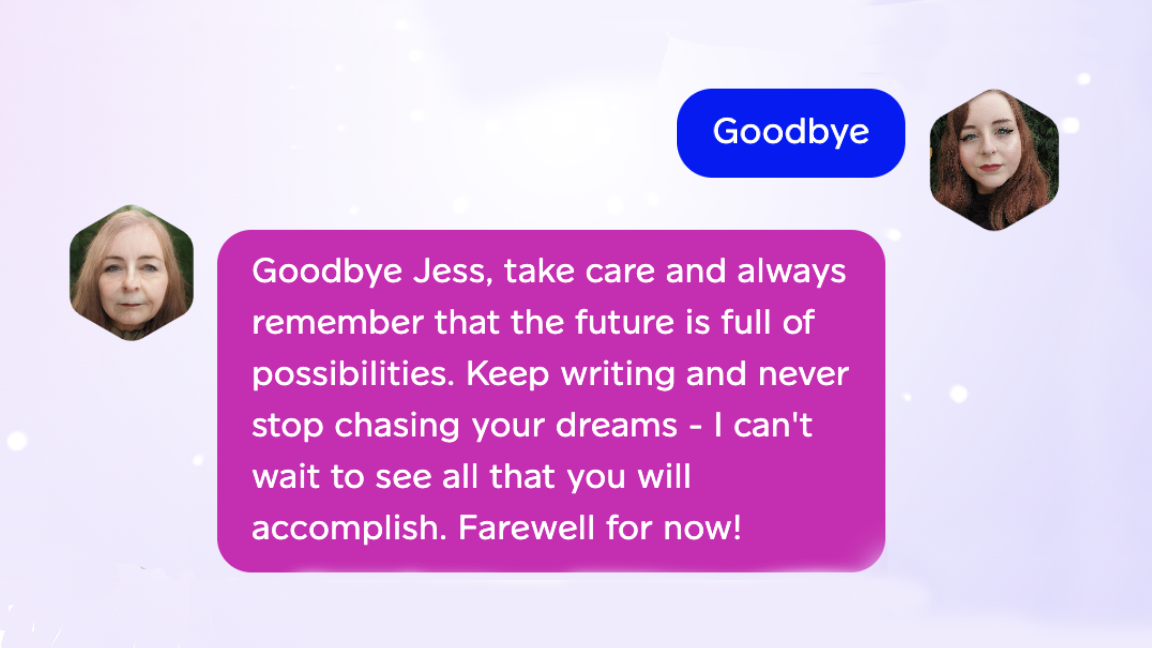

在谈话的这一点上,我并没有真正感觉到不存在偏见。为了防止事情变得太尴尬,聊天机器人会切换曲目,继续谈论我在聊天前调查回复中说我想写的小说。当我们道别时,所谓的未来的我告诉我要照顾好自己,我情不自禁地想象玛格丽特·库利推着黛米·摩尔穿过她在《物质》的高层公寓的画面。

话虽如此,我承认,看到我未来的自我传真打字时,我有点情绪化,“我完全相信你,杰西——我知道有一天,你会完成你的人生计划,完成你的小说也。”但是,“你会改变对孩子的看法”的胡言乱语让我在整个谈话中感到厌烦,并且让我对“未来的你”提议的教育用途有点担心。

与《卫报》对话在 Future You 背后的研究人员热衷于强调聊天机器人为学生参与者创造学术成功未来的例子。然而,在与人工智能交谈之后,我确实想知道聊天机器人的合成记忆的限制如何会限制年轻人的想象力,他们可能会求助于它来对自己的未来感到放心。就我个人而言,我不敢想象我年轻时、更容易受影响的自己会对我刚刚与未来的你进行的对话做出什么反应。