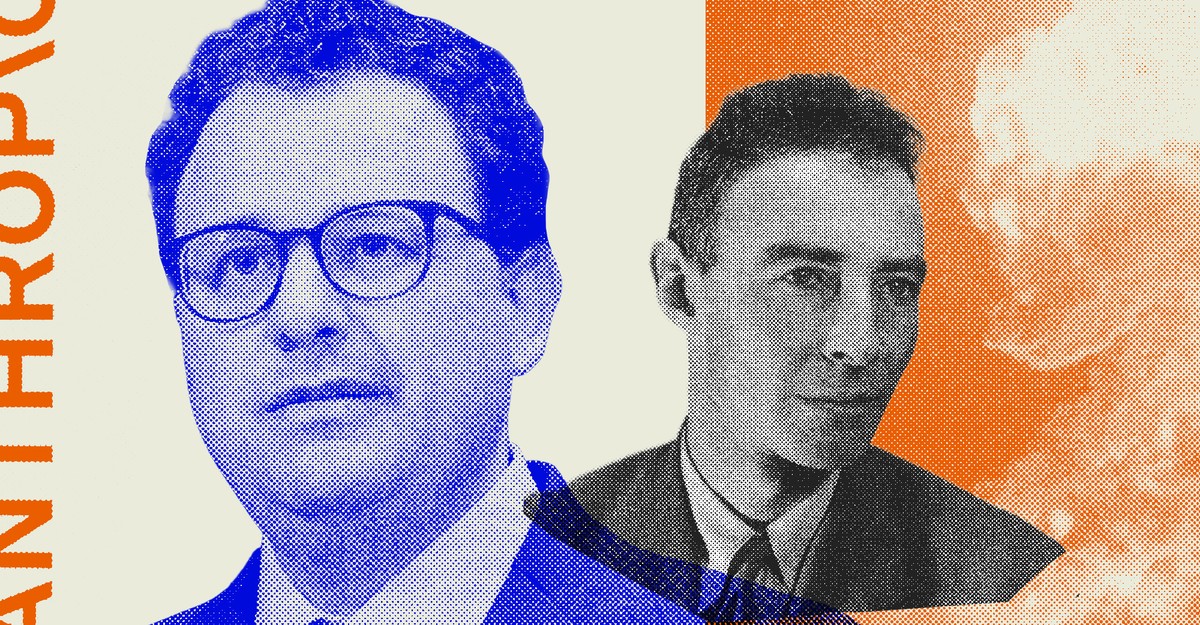

达里奥·阿莫代的奥本海默时刻

作者:Ross Andersen

在最近与五角大楼发生对峙的一年多前,Anthropic 首席执行官达里奥·阿莫迪 (Dario Amodei) 发表了一份 15,000 字的宣言,描述了人工智能的辉煌未来。它的标题“慈爱的机器”是借用理查德·布劳蒂根的一首诗,但正如阿莫迪尴尬地承认的那样,它的乌托邦愿景与科幻小说有一些相似之处。据阿莫代称,我们很快将创造出第一批博学人工智能,其能力超越“最相关领域”的诺贝尔奖获得者,而且我们将拥有数百万个人工智能,一个“天才的国家”,所有这些人工智能都被装在数据中心发光的服务器机架中,一起工作。通过使用直接在我们的物理世界上运行的工具,这些人工智能将能够做出大量危险的恶作剧,但根据阿莫迪的说法,如果它们得到开发——或者——成长——正如 Anthropic 工作人员喜欢说的那样——以正确的方式,它们将决定极大地改善我们的生活。

阿莫迪没有准确解释人工智能将如何实现这一目标。在大多数情况下,他希望他们能做最聪明的人类所做的事情,但速度要快得多,从而压缩了数十年的科学进步。他说,到 2035 年,我们可以拥有 22 世纪初的理论、治疗方法和技术。我们的传染病和癌症可以被治愈,我们的寿命可以延长一倍,并且可以减缓大脑的衰退。谷歌 DeepMind 的负责人 Demis Hassabis 也同样将超级智能 AI 视为加速科学发现的终极工具,而 OpenAI 首席执行官 Sam Altman 表示,先进的 AI 甚至可以解决物理问题。

阿莫迪并没有说这种乌托邦般的人工智能未来是不可避免的。相反,在顶级人工智能实验室的首席执行官中,他可能是最担心该技术危险的人。《慈爱的机器》是他出版的大量著作中乐观的异类,其中大部分涉及创造超越人类的智能所面临的风险。阿莫迪似乎认为当今的人工智能研究人员与曼哈顿计划的科学家相当,并且众所周知推荐原子弹的制造。在他的讲述中,超人类的人工智能可能比核武器更危险,这就是为什么人工智能需要由正确的人以正确的方式开发,这样它就不会压倒人类,也不会让全球力量平衡向独裁倾斜。

这一愿景隐含着这样的希望:最终,当形势危急时,阿莫迪或非常像他的人能够对人工智能的使用方式拥有一些发言权。但如果 Anthropic 最近与五角大楼的经历有任何迹象的话,那么他很可能不会做出这样的决定。尽管阿莫代伊阅读并思考了早期核时代,但他可能还没有完全内化其含义。

在核技术出现之前,就存在核乌托邦主义,物理学家利奥·西拉德是其第一个认真的追随者。和阿莫代一样,他的思想深受科幻小说的影响。1932 年,即西拉德对核链式反应产生先见之明的前一年,他读到世界获得自由是 H·G·威尔斯 (H. G. Wells) 所著的小说,其中一场伟大的战争将人类带入了新的持久和平。威尔斯于 1914 年出版的小说预见了原子弹的发展,甚至为它创造了这个名字。它设想了一个核技术大幅降低能源成本的世界,将人们从劳作中解放出来,使他们能够成为艺术家。

氢弹之父爱德华·泰勒也设想了原子能的多种用途,包括剧烈重塑地球表面。泰勒表示,如果核武器在正确的地点引爆,它们可以改变河流的方向。(苏联人后来引爆了三枚核炸药,试图将西伯利亚伯朝拉河的水输送到后退的里海。)泰勒声称,这些爆炸中的一小部分就可以炸穿顽固的山岩,炸毁高山公路,而数百次则可以开辟一条新的巴拿马运河。泰勒告诉记者,如果阿拉斯加居民愿意,他可以利用核爆炸挖出一个北极熊形状的港口。

随着核乌托邦主义者数量的增加,他们想象中的能源带来的好处也随之增加,正如原子能委员会主席刘易斯·施特劳斯(Lewis Strauss)所描述的那样,“太便宜而无法计量”。(奥特曼最近反复强调这一点,声称智力很快就会变得廉价而无法计量。)施特劳斯说,原子工程将允许一种化学元素转变为另一种化学元素,实现炼金术的古老梦想;他说,饥荒将成为历史记忆,而用于医学研究的新核动力基础设施将延长人类的寿命。

没有什么问题是不能通过掌握原子来解决的,或者至少是有很大帮助的。丹麦物理学家尼尔斯·玻尔甚至希望它能带来和平。原子武器的可怕威力会直接吓到政治家。他们会认识到世界受到这项技术的严重威胁,并对对手采取彻底开放的姿态,以阻止冲突并防止世界末日般的误解。用玻尔的话说,原子弹是如此可怕,以至于人类别无选择,只能成长,甚至导致物种道德进化的一步改变。

分裂原子的人们相信他们正在将人类带入一个新世界,这是正确的。但这并不是他们想象的那样。抽象地思考核技术的纯粹潜力是令人兴奋的,但科幻小说的想法并不总是那么顺利地融入现实世界的混乱现实。需要相当昂贵的对准机制来弯曲和引导裂变反应释放的巨大能量以达到人类目的。为了产生可用的电力,这些反应必须在厚重的、辐射屏蔽的结构内进行,而建造和冷却这些反应堆的成本,同时还要清除它们的废物,消耗了节省的燃料成本。有一天,核电可能会变得便宜得无法计量,但那一天还没有到来。

世界并没有像威尔斯和西拉德所希望的那样获得自由。原子能不允许人们在天空或地球表面自由飞行。1958 年,当核热炒作接近顶峰时,福特汽车公司推出了 Nucleon 概念车,这是一款由小型后置反应堆提供动力的家用汽车。斯图贝克-帕卡德设想了一种不同的车辆,它不仅可以依靠原子能运行,而且可以在自身周围产生力场以防止碰撞。这两个想法都没有成功,当时设想的各种原子飞机概念也没有成功。特德·泰勒和弗里曼·戴森是另外两位中世纪的原子专家,他们在通用原子公司花了数年时间设计了一艘重达数千吨的巨型航天器,并通过核爆炸将自己推进到火星、土星和附近的恒星。国防部高级研究计划局提供了初始资金,但很快就失去了兴趣。空军接受了它,希望这项研究能够产生一个武器平台,但最终也放弃了。

泰勒确实实现了他用核爆炸塑造陆地形态的梦想。原子能委员会致力于这些和平爆炸的计划“犁铧计划”进行了 27 次单独的测试,但除了污染和激励环保运动之外,什么也没取得。与此同时,核武器并没有像玻尔所希望的那样让世界领导人进入一个和平与坦诚的新时代。广岛原子弹爆炸前一年,玻尔前往白宫向富兰克林·罗斯福阐述国际社会在这些问题上采取开放态度的理由。总统在任期的最后几个月,据说对玻尔的观点表示同情,但当温斯顿·丘吉尔听到这些观点时,他感到震惊。丘吉尔告诉一名助手,玻尔应该被关起来,因为他甚至暗示盟友展示了他们的核手。

战后,J·罗伯特·奥本海默复兴了玻尔的一些想法,并将其转化为一项关于建立一个新的国际机构来控制所有危险核活动的提案。1946 年 6 月,一项类似的计划被提交给联合国。苏联拒绝了该计划,并建议美国首先销毁其核武库。

美国并没有摧毁其核武库,而是对其进行了扩充,并开发了新武器,其威力比夷平广岛的武器强1000倍以上。如今,九个国家拥有核武库,总数超过 12,000 枚弹头,其中许多是一触即发的弹头。这些武库在重大交战中不断被使用的可能性是核时代真正持久的遗产。最后剩下的条约限制了其中两个最大的国家,即美国和俄罗斯,该条约已于上个月到期,但没有被替换。就像玻尔和奥本海默提出的建议一样,这些条约被竞争优势的冷酷逻辑击败,这也可能塑造人工智能的全球未来。

2 月 27 日,阿莫迪发布了另一篇文章,这是一份针对较小受众(他的员工)的备忘录。四天前,五角大楼发布了最后通牒,要求 Anthropic 取消对军队如何使用其人工智能模型的任何超出现有法律的限制。该模型自去年以来一直在美国的机密网络上运行,据报道已经用于美国对委内瑞拉和伊朗的攻击。

令人惊讶的是,大型语言模型出现仅仅几年,这些模型似乎已经成为世界上最强大军队最复杂行动的核心,但阿莫迪并不普遍反对人工智能在战争中的使用。他急切地寻求国防部合同,部分原因是他认为民主国家应该利用人工智能来保持对中国和世界其他独裁国家的军事优势,而这些国家几乎肯定会在未来几年越来越多地使用人工智能。

阿莫代在与五角大楼的谈判中一直坚守着两条红线:他不希望 Anthropic 人工智能强大的信息处理能力用于对美国公民的大规模监视,也不希望它指挥可以在没有人类监督的情况下杀人的自主武器。五角大楼拒绝了,要求不受限制地使用人类模型克劳德。谈判破裂后,它使用了一种以前从未针对美国公司使用过的强制工具,即供应链风险指定,这可能会危及 Anthropic 的业务。(人类自此提起诉讼将其删除。该公司拒绝对本文发表评论。)就在这一切发生的同时,Altman 突然介入,敲定了他自己对 OpenAI 的五角大楼交易。

阿莫代伊对本周发生的事件的沮丧情绪渗透到了他写给员工的备忘录中。它的语气与“慈爱的机器”有很大不同。阿莫迪严厉斥责了 OpenAI,并将其交易的报道条款描述为“安全剧场”。(后来 OpenAI添加了OpenAI 领导层与五角大楼达成协议的仓促态度显然让阿莫迪感到恼火。他说,这一集揭示了“他们的真实身份”。

但阿莫代似乎没有考虑到这里更大的结构性教训。Anthropic 与五角大楼的争端提醒人们,创造强大技术的人通常无法对如何使用该技术拥有最终决定权。这些模型与未来的模型相比甚至还没有那么先进,而且在委内瑞拉和伊朗,美国并没有与世界上伟大的人工智能冠军对抗。然而,五角大楼仍然对其对 Anthropic 人工智能的使用可能受到限制的想法感到愤怒,面对阻力,它威胁要烧毁一家私营公司。如果人工智能成为一种更加危险的武器,并且美国发现自己与一个拥有与自己一样强大的前沿模型的国家竞争,那么政府几乎肯定会要求完全控制或彻底征用该技术。

原子弹的制造者在新墨西哥沙漠完成了他们的工作后,他们很快就意识到他们在使用原子弹时几乎没有发言权。这些武器被卡车运走,几周后,没有人打电话给科学家,为轰炸广岛或长崎开绿灯。也没有人要求他们签署未来增加美国核武库的协议。他们的影响力是预先加载的:他们可以选择是否制造可怕的武器,但一旦他们成功测试了一种武器,他们就已经放弃了它。

阿莫代现在发现自己处于类似的境地。他很可能是对的,很快,整个“天才国家”将占领世界各地正在大规模建设的数据中心。但是否有人能够控制这样一支技术力量仍然是一个悬而未决的问题,无论如何,那肯定不会是他。

关于《达里奥·阿莫代的奥本海默时刻》的评论

tree service(游客) 2026-05-04 06:31:03

Great information on storm cleanup planning. As a team that works around tree service and tree care, we know clear guidance helps property owners reduce safety risks and prevent avoidable damage.