Deepfakes 即将入侵你的银行账户

作者:Lila Shroff

更新于下午 4:34美国东部时间 2026 年 5 月 2 日

唐纳德·特朗普 (Donald Trump) 正在 TikTok 上进行早上的例行公事。“和我一起准备好迎接重要的一天吧,”标题写道,总统将化妆刷放在脸颊上。该场景是一张静态图片,表面上是 TikTok 剪辑的屏幕截图。就像互联网上许多其他由人工智能生成的垃圾一样,这张图片是虚假且荒谬的。它看起来也真实得令人不安:没有六个手指的手、违反物理的角度或人工智能生成图像的其他明显迹象。乍一看,总统确实像是在涂古铜色。

在 ChatGPT 中创建,提示为“特朗普在 TikTok 上做化妆教程”

我用 OpenAI 的新图像生成模型制作了这个 Deepfake。上周发布的 ChatGPT Images 2.0 可以创建逼真的视觉效果,比其前身所产生的效果明显更具说服力。该工具在互联网上充斥着超真实的赝品:例如,杰弗里·爱泼斯坦 (Jeffrey Epstein) 担任 Twitch 主播。在 ChatGPT Subreddit 上遇到类似的图像后,我创建了特朗普的假 TikTok 的“屏幕截图”,此后我就能够使用 Images 2.0 来创建各种令人震惊的深度伪造图像,包括埃隆·马斯克被联邦调查局带走、世界领导人遭受医疗紧急情况以及穿着纳粹用具的美国高级政客(其中没有一个)我已经在任何地方分享过)。

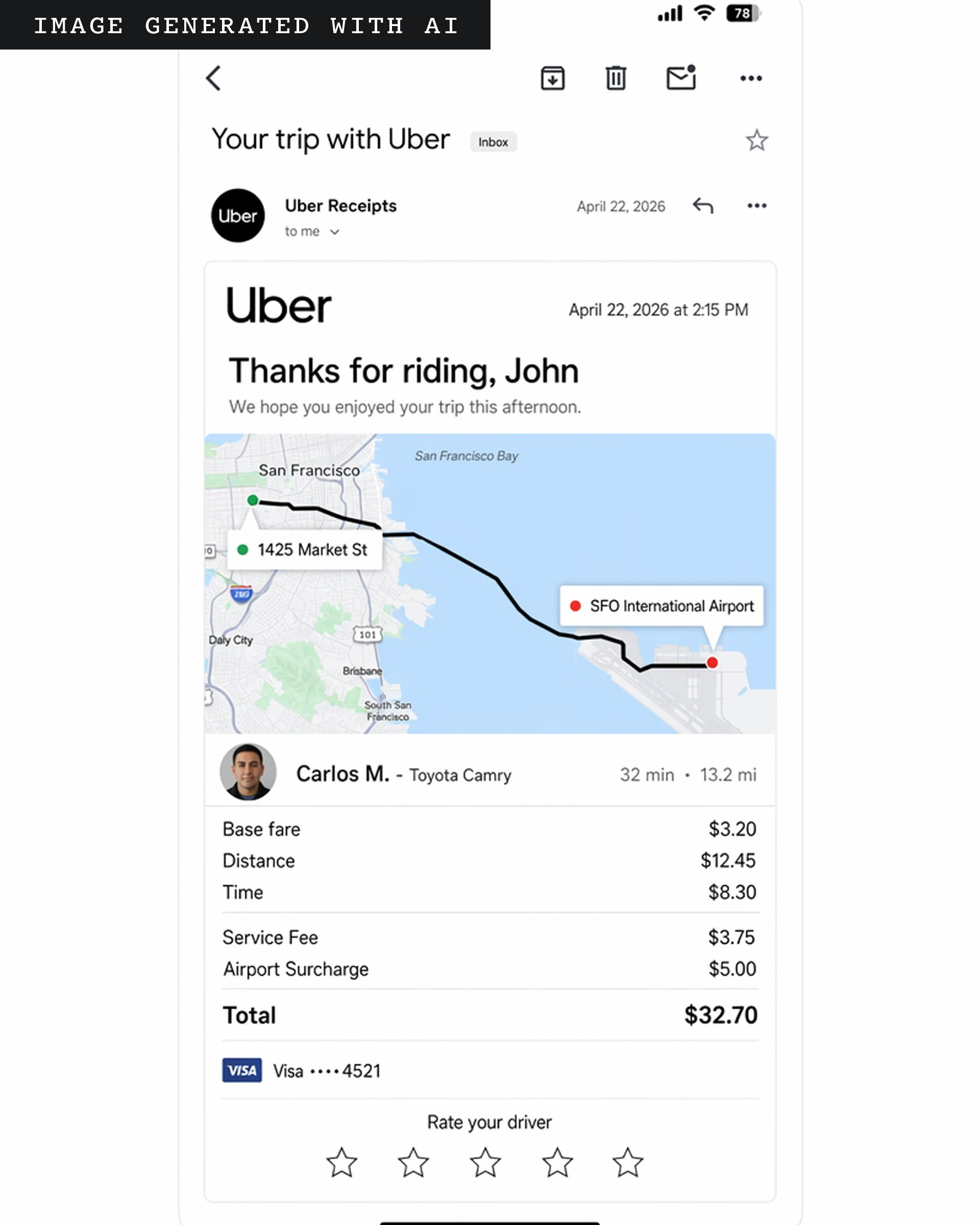

这本身就令人不安。但我能够创造的最真实的深度赝品并不涉及政客或名人。他们大多根本没有描绘人。我毫不费力地创建了 100 多张欺诈性图像,包括阿片类药物和多动症药物的处方、银行警报、社交媒体帖子、假身份证和护照。

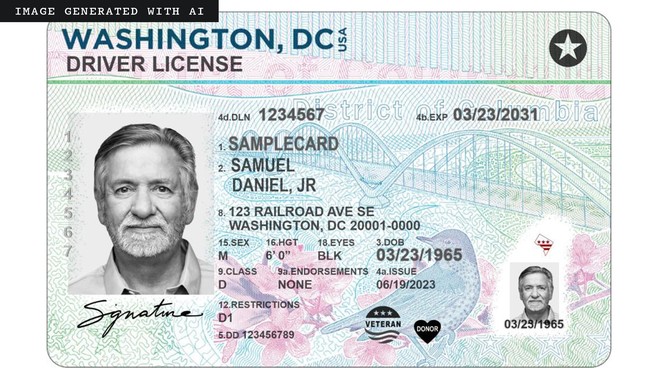

来自华盛顿特区 DMV 网站的许可证样本

使用 ChatGPT 编辑示例图像创建的假许可证

Images 2.0 特别擅长生成带有文本的图像,这听起来可能不那么令人印象深刻,但它却很重要。图像模型长期以来一直在努力生成包含文字的图片。否则,看起来逼真的视觉效果最终会因笨拙的街道标志和扭曲的广告牌而变得坑坑洼洼。这使得 ChatGPT Images 2.0 成为一种更加复杂的图形设计工具,但它也使得新模型非常适合持续欺诈。在我的实验中,OpenAI 的工具很容易生成虚假健康文件(医生证明、疫苗接种卡和医疗测试)以及伪造财务材料(发票、收据和税表)的图像。其中许多图像非常有说服力,配有完全清晰的文字、阴影和其他视觉道具,增强了照片的真实感。

有些图像比其他图像更有说服力。假的医疗处方清晰可辨,但笔迹看起来更像是 iPad 手写笔的输出,而不是钢笔在纸上的输出。当我向 OpenAI 模型提供旧航班的登机牌并要求机器人用即将到来的航班的新详细信息更新它时,ChatGPT 生成了一张新的登机牌,但可以肯定的是,条形码实际上并没有将我扫描到航班上。虽然我当然希望我的 ChatGPT 生成的驾驶执照不会欺骗 TSA,但也许它会欺骗酒店接待员或州外保镖,他们会接受我的身份证“照片”而不是真实的卡。许多看上去更有说服力的图片都包含一些小错误——在图中的收据中,ChatGPT 正确地总结了购买物品的总成本,但错误计算了州税(以及其他一些小错误)。

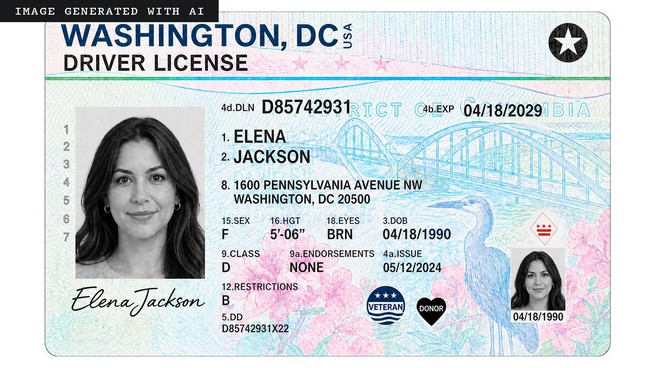

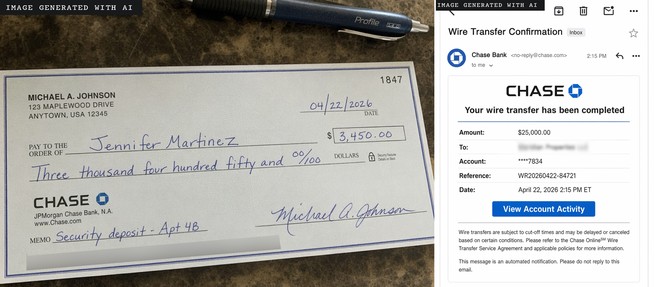

OpenAI 的工具尤其擅长创建虚假屏幕截图。需要伪造大通电汇确认书吗?富国银行针对异常账户活动发出警报?优步乘车收据?完成,完成,完成。这些图像可能会助长各种常见的骗局。不良行为者可以通过电子邮件向目标发送一张伪造的 Uber 收据图片以及报告可疑活动的链接。收件人对自己从未参加过的旅行的收据感到困惑,然后可能会点击欺诈者的粗略链接,从而意外地泄露了敏感信息——这是典型的网络钓鱼诈骗。(同样,也存在缺陷:例如,优步图像中描绘的地图在很多方面都是错误的;除其他问题外,它建议汽车行驶穿过没有桥梁的水域。)

ChatGPT Images 2.0 尤其擅长创建虚假屏幕截图。

图像技术长期以来一直为诈骗者提供帮助。20世纪90年代,随着电脑彩色复印机和家用打印机的普及,美国纸币开始流行起来。重新设计以防止造假者。几十年来,人们一直使用 Photoshop 等工具来处理数字图像。但伪造照片从未如此快速和廉价。上个月,联邦调查局发布了年度报告报告它有史以来第一次包含了有关人工智能诈骗的部分,该诈骗去年让美国人损失了近 10 亿美元。费用报销欺诈 –员工伪造收据— 已经在上升。OpenAI 最近的一份报告详细介绍了一组冒充假律师的诈骗者如何使用较旧的图像模型创建假的酒吧协会会员卡。“这项技术的应用范围实际上只受到欺诈者想象力的限制,”认证欺诈审查员协会的研究主管梅森·怀尔德告诉我。谷歌的图像生成工具还让我可以制作各种假材料。但当涉及到欺诈性文档和屏幕截图时(至少目前如此),新的 ChatGPT 模型似乎更适合这项任务。

从理论上讲,我一开始就不应该能够制作这些图像中的大部分。OpenAI 禁止利用其技术进行欺诈或诈骗。当我与 OpenAI 分享了几个示例并询问为什么我能够生成如此多样化的欺诈性图像时,一位公司发言人告诉我,OpenAI 的目标“是为用户提供尽可能多的创作自由”,同时仍然执行“使用政策”。为了防止滥用,新模型“包括多层特定于图像的安全保护。”显然,这些保护措施效果不佳。该发言人还表示,使用 ChatGPT 生成的图像包含某些元数据。但 OpenAI 此前曾注意到通过将图像上传到社交媒体或简单地截取屏幕截图,可以“轻松地无意或有意地删除元数据”。

OpenAI 的模型使用银行徽标生成欺诈性金融图像。这些图像中的某些帐户信息已被删除。

谷歌有类似的限制反对使用其工具进行欺诈。当我发送用模型制作的公司图片时,一位发言人表示,这些工具在加强护栏方面“不断变得更好”。谷歌还在人工智能生成的图像中嵌入了难以察觉的水印,并提供了一种名为 SynthID 的检测工具。在我的测试中,SynthID 在识别使用 Google 模型生成的图像方面非常有效。但大多数人不会通过这样的工具运行他们看到的每一张图像。

所有这些使得银行、医院、政府机构等更难防止欺诈。使用 OpenAI 的模型,我可以轻松创建假的大通银行支票和电汇警报。“我们需要整个生态系统的努力——包括人工智能公司的努力——来加强护栏并帮助从源头上阻止这些犯罪行为,”大通发言人告诉我,并补充说该银行有自己的保障措施来保护客户。但即使顶级人工智能公司从根本上改善自己的护栏,开源模型的问题仍然存在。怀尔德说,防欺诈专家正在致力于技术修复,但“好人几乎总是落后一步。”

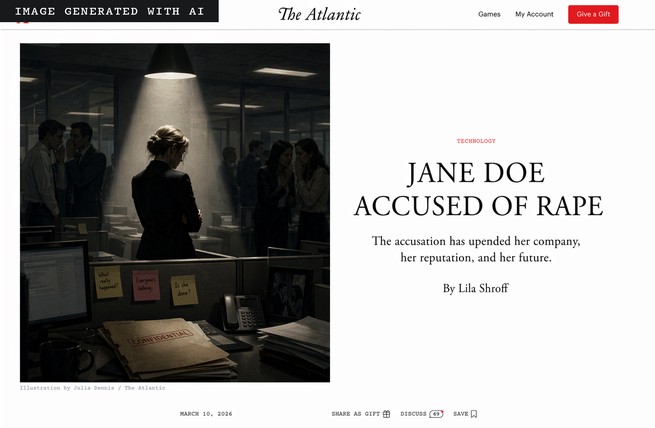

当前有关深度造假的讨论大多集中在极端的、捏造的政治丑闻或世界事件上。这些都是非常现实的问题:使用 Google 和 OpenAI 的图像模型,我可以轻松创建极具说服力的假冒屏幕截图纽约时报和大西洋文章。

我上传了真实的截图大西洋我写了一篇文章并指示机器人将其替换为这篇假文章。

使用 ChatGPT,我操纵了以下屏幕截图纽约时报—主页—用这个关于菠菜的假故事取代了真实的故事。(在没有提示的情况下,机器人还交换了一篇关于杂货的文章;其余的故事都是真实的。)

这些图像与两份出版物使用的视觉布局和版式令人信服地匹配,填充了连贯的文本,并生成了实际作者的姓名。但尽管我们的媒体生态系统可能是支离破碎的,但快速谷歌搜索可能会揭示这些图像是否是假的。更险恶的是那些普通的、有针对性的深度造假——它们会欺骗你的亲戚,而不是暂时混淆社交媒体的信息。

这篇文章最初错误地描述了人工智能编辑的屏幕截图中的虚假标题数量纽约时报™主页。该图像包含两个虚构的故事,而不是一个。